Modelos suportados pela Ultralytics

Bem-vindo à documentação de modelos da Ultralytics! Oferecemos suporte para uma ampla gama de modelos, cada um adaptado a tarefas específicas como detecção de objetos, segmentação de instâncias, classificação de imagens, estimativa de pose e rastreamento de múltiplos objetos. Se você estiver interessado em contribuir com sua arquitetura de modelo para a Ultralytics, confira nosso Guia de Contribuição.

Modelos em Destaque

Aqui estão alguns dos principais modelos suportados:

- YOLOv3: A terceira iteração da família de modelos YOLO, originalmente de Joseph Redmon, conhecida por suas capacidades eficientes de detecção de objetos em tempo real.

- YOLOv4: Uma atualização nativa do darknet para YOLOv3, lançada por Alexey Bochkovskiy em 2020.

- YOLOv5: Uma versão aprimorada da arquitetura YOLO da Ultralytics, oferecendo melhores compensações de desempenho e velocidade em comparação com as versões anteriores.

- YOLOv6: Lançado pela Meituan em 2022 e em uso em muitos dos robôs de entrega autônomos da empresa.

- YOLOv7: Modelos YOLO atualizados lançados em 2022 pelos autores do YOLOv4. Apenas a inferência é suportada.

- YOLOv8: Um modelo versátil com recursos aprimorados, como segmentação de instâncias, estimativa de pose/pontos-chave e classificação.

- YOLOv9: Um modelo experimental treinado na base de código Ultralytics YOLOv5 que implementa a Informação de Gradiente Programável (PGI).

- YOLOv10: Desenvolvido pela Universidade de Tsinghua, apresentando treinamento sem NMS e arquitetura orientada pela eficiência-precisão, oferecendo desempenho e latência de última geração.

- YOLO11: Modelos YOLO da Ultralytics que oferecem alto desempenho em várias tarefas, incluindo detecção, segmentação, estimativa de pose, track e classificação.

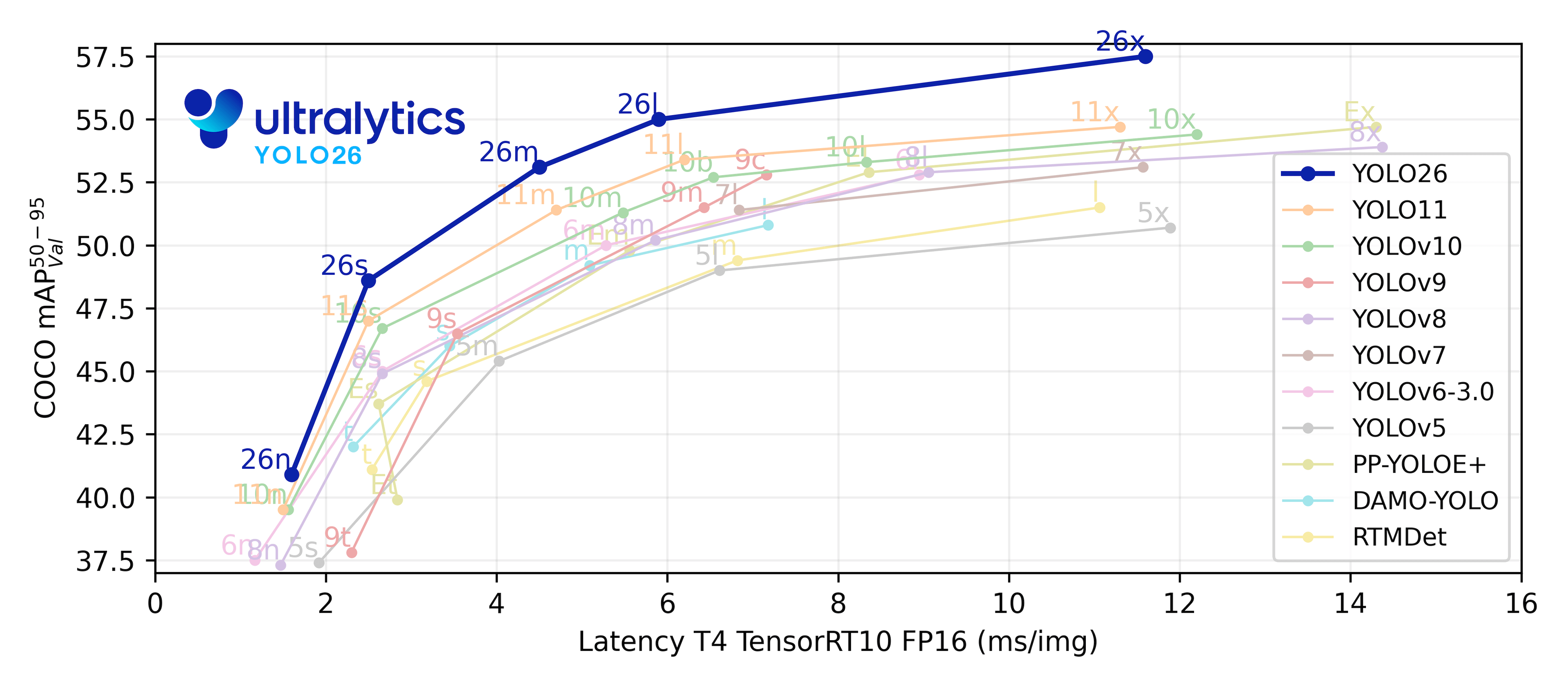

- YOLO26 🚀 NOVO: O mais recente modelo YOLO de próxima geração da Ultralytics, otimizado para implantação em edge com inferência end-to-end sem NMS.

- Segment Anything Model (SAM): Segment Anything Model (SAM) original da Meta.

- Segment Anything Model 2 (SAM2): A próxima geração do Segment Anything Model da Meta para vídeos e imagens.

- Segment Anything Model 3 (SAM3) 🚀 NOVO: Terceira geração do Segment Anything Model da Meta com Segmentação de Conceitos Promptable para segmentação baseada em exemplos de texto e imagem.

- Mobile Segment Anything Model (MobileSAM): MobileSAM para aplicações móveis, da Universidade de Kyung Hee.

- Fast Segment Anything Model (FastSAM): FastSAM do Image & Video Analysis Group, Institute of Automation, Academia Chinesa de Ciências.

- YOLO-NAS: Modelos YOLO Neural Architecture Search (NAS).

- Real-Time Detection Transformers (RT-DETR): Modelos Detection Transformer (RT-DETR) em tempo real do PaddlePaddle da Baidu.

- YOLO-World: Modelos de Detecção de Objetos de Vocabulário Aberto em Tempo Real do Tencent AI Lab.

- YOLOE: Um detector de objetos de vocabulário aberto aprimorado que mantém o desempenho em tempo real do YOLO enquanto deteta classes arbitrárias além dos seus dados de treino.

Assista: Execute modelos Ultralytics YOLO com apenas algumas linhas de código.

Começando: Exemplos de Uso

Este exemplo fornece exemplos simples de treinamento e inferência YOLO. Para obter a documentação completa sobre estes e outros modos, consulte as páginas de documentação Predict, Train, Val e Export.

Observe que o exemplo abaixo destaca os modelos YOLO11 Detect para detecção de objetos. Para tarefas suportadas adicionais, consulte os documentos Segment, Classify e Pose.

Exemplo

PyTorch pré-treinados *.pt modelos, bem como a configuração *.yaml os arquivos podem ser passados para o YOLO(), SAM(), NAS() e RTDETR() classes para criar uma instância de modelo em python:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")

Comandos da CLI estão disponíveis para executar os modelos diretamente:

# Load a COCO-pretrained YOLO26n model and train it on the COCO8 example dataset for 100 epochs

yolo train model=yolo26n.pt data=coco8.yaml epochs=100 imgsz=640

# Load a COCO-pretrained YOLO26n model and run inference on the 'bus.jpg' image

yolo predict model=yolo26n.pt source=path/to/bus.jpg

Contribuindo com Novos Modelos

Tem interesse em contribuir com seu modelo para a Ultralytics? Ótimo! Estamos sempre abertos a expandir nosso portfólio de modelos.

Faça um Fork do Repositório: Comece fazendo um fork do repositório Ultralytics no GitHub.

Clone Seu Fork: Clone seu fork para sua máquina local e crie uma nova branch para trabalhar.

Implemente Seu Modelo: Adicione seu modelo seguindo os padrões de codificação e as diretrizes fornecidas em nosso Guia de Contribuição.

Teste Exaustivamente: Certifique-se de testar seu modelo rigorosamente, tanto isoladamente quanto como parte do pipeline.

Crie um Pull Request: Depois de estar satisfeito com seu modelo, crie um pull request para o repositório principal para revisão.

Revisão de Código e Fusão: Após a revisão, se o seu modelo atender aos nossos critérios, ele será incorporado ao repositório principal.

Para obter instruções detalhadas, consulte nosso Guia de Contribuição.

FAQ

Qual é o modelo Ultralytics YOLO mais recente?

O modelo mais recente do Ultralytics YOLO é o YOLO26, lançado em janeiro de 2026. O YOLO26 apresenta inferência end-to-end sem NMS, implantação otimizada em edge e suporta todas as cinco tarefas (detecção, segmentação, classificação, estimativa de pose e OBB), além de versões de vocabulário aberto. Para cargas de trabalho de produção estáveis, tanto o YOLO26 quanto o YOLO11 são escolhas recomendadas.

Como posso treinar um modelo YOLO em dados personalizados?

Treinar um modelo YOLO em dados personalizados pode ser facilmente realizado usando as bibliotecas da Ultralytics. Aqui está um exemplo rápido:

Exemplo

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)

yolo train model=yolo26n.pt data='custom_data.yaml' epochs=100 imgsz=640

Para obter instruções mais detalhadas, visite a página de documentação Train.

Quais versões do YOLO são suportadas pela Ultralytics?

A Ultralytics suporta uma gama abrangente de versões YOLO (You Only Look Once) do YOLOv3 ao YOLO11, juntamente com modelos como YOLO-NAS, SAM e RT-DETR. Cada versão é otimizada para várias tarefas, como detection, segmentação e classificação. Para obter informações detalhadas sobre cada modelo, consulte a documentação Modelos Suportados pela Ultralytics.

Por que devo usar a Plataforma Ultralytics para projetos de machine learning?

A Plataforma Ultralytics oferece uma plataforma no-code e end-to-end para treinar, implantar e gerenciar modelos YOLO. Ela simplifica fluxos de trabalho complexos, permitindo que os usuários se concentrem no desempenho e na aplicação do modelo. O HUB também oferece capacidades de treinamento em nuvem, gerenciamento abrangente de conjuntos de dados e interfaces amigáveis para iniciantes e desenvolvedores experientes.

Que tipos de tarefas os modelos Ultralytics YOLO podem realizar?

Os modelos Ultralytics YOLO são versáteis e podem realizar tarefas como detecção de objetos, segmentação de instâncias, classificação, estimativa de pose e detecção de objetos orientados (OBB). O modelo mais recente, YOLO26, suporta todas as cinco tarefas, além da detecção de vocabulário aberto. Para detalhes sobre tarefas específicas, consulte as páginas de Tarefas.