Link to this sectionМодели, поддерживаемые Ultralytics#

Добро пожаловать в документацию по моделям Ultralytics! Мы предлагаем поддержку широкого спектра моделей, каждая из которых адаптирована для конкретных задач, таких как обнаружение объектов, сегментация экземпляров, семантическая сегментация, классификация изображений, оценка позы и отслеживание нескольких объектов. Если ты хочешь внести свой вклад в архитектуру моделей Ultralytics, ознакомься с нашим Руководством по внесению вклада.

Link to this sectionРекомендуемые модели#

Вот некоторые из ключевых поддерживаемых моделей:

- YOLOv3: Третья итерация семейства моделей YOLO, первоначально созданная Джозефом Редмоном, известная своей эффективностью при обнаружении объектов в реальном времени.

- YOLOv4: Обновление YOLOv3 на базе darknet, выпущенное Алексеем Бочковским в 2020 году.

- YOLOv5: Улучшенная версия архитектуры YOLO от Ultralytics, предлагающая лучшие компромиссы между производительностью и скоростью по сравнению с предыдущими версиями.

- YOLOv6: Выпущена компанией Meituan в 2022 году и используется во многих автономных роботах-доставщиках этой компании.

- YOLOv7: Обновленные модели YOLO, выпущенные в 2022 году авторами YOLOv4. Поддерживается только инференс.

- YOLOv8: Универсальная модель с расширенными возможностями, такими как сегментация экземпляров, оценка позы/ключевых точек и классификация.

- YOLOv9: Экспериментальная модель, обученная на кодовой базе YOLOv5 от Ultralytics, реализующая Programmable Gradient Information (PGI).

- YOLOv10: Разработана Университетом Цинхуа, отличается обучением без NMS и архитектурой, ориентированной на эффективность и точность, обеспечивая передовую производительность и минимальную задержку.

- YOLO11: Модели YOLO от Ultralytics, обеспечивающие высокую производительность при выполнении различных задач, включая обнаружение, сегментацию, оценку позы, отслеживание и классификацию.

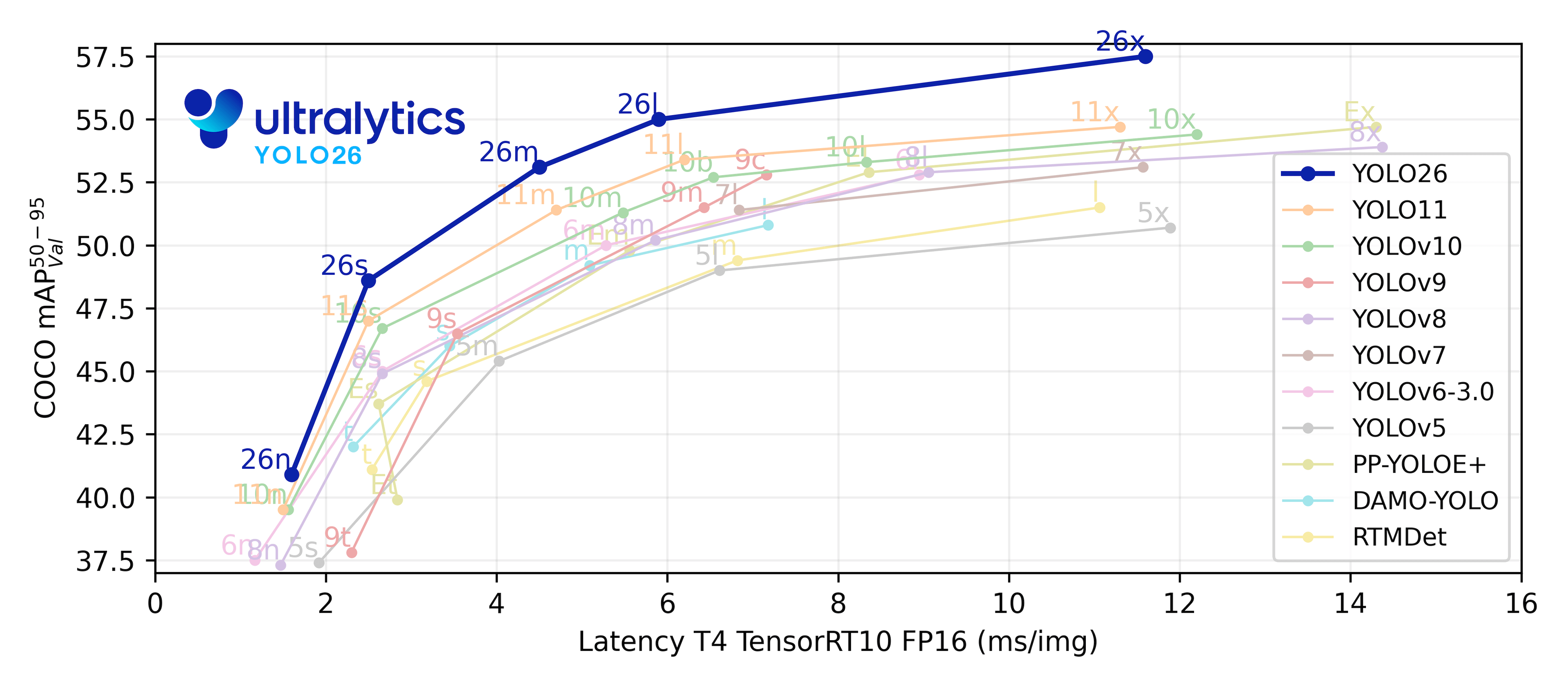

- YOLO26 🚀 NEW: Последняя модель YOLO нового поколения от Ultralytics, оптимизированная для развертывания на периферийных устройствах с поддержкой сквозного инференса без NMS.

- Segment Anything Model (SAM): Оригинальная модель Segment Anything Model (SAM) от Meta.

- Segment Anything Model 2 (SAM2): Следующее поколение модели Segment Anything Model от Meta для видео и изображений.

- Segment Anything Model 3 (SAM3) 🚀 NEW: Третье поколение модели Segment Anything Model от Meta с поддержкой сегментации на основе концепций с подсказками (Promptable Concept Segmentation) для текстовых и образцовых сегментаций изображений.

- Mobile Segment Anything Model (MobileSAM): MobileSAM для мобильных приложений от Университета Кёнхи.

- Fast Segment Anything Model (FastSAM): FastSAM от группы анализа изображений и видео Института автоматизации Китайской академии наук.

- YOLO-NAS: Модели YOLO Neural Architecture Search (NAS).

- Real-Time Detection Transformers (RT-DETR): Модели реального времени Detection Transformer (RT-DETR) от PaddlePaddle (Baidu).

- YOLO-World: Модели для обнаружения объектов с открытым словарем в реальном времени от Tencent AI Lab.

- YOLOE: Улучшенный детектор объектов с открытым словарем, который сохраняет производительность YOLO в реальном времени, обнаруживая произвольные классы за пределами своих обучающих данных.

Watch: Run Ultralytics YOLO models in just a few lines of code.

Link to this sectionНачало работы: примеры использования#

Этот пример содержит простые примеры обучения и инференса YOLO. Для получения полной документации по этим и другим режимам ознакомься со страницами Predict, Train, Val и Export.

Обрати внимание, что в примере ниже освещаются модели YOLO11 Detect для обнаружения объектов. Дополнительные поддерживаемые задачи смотри в документации Segment, Classify и Pose.

PyTorch pretrained *.pt models as well as configuration *.yaml files can be passed to the YOLO(), SAM(), NAS() and RTDETR() classes to create a model instance in Python:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")Link to this sectionВклад в разработку новых моделей#

Хочешь добавить свою модель в Ultralytics? Отлично! Мы всегда открыты для расширения нашего портфеля моделей.

-

Сделай форк репозитория: Начни с форка репозитория Ultralytics на GitHub.

-

Клонируй свой форк: Клонируй свой форк на локальный компьютер и создай новую ветку для работы.

-

Реализуй свою модель: Добавь свою модель, следуя стандартам кодирования и рекомендациям, представленным в нашем Руководстве по внесению вклада.

-

Тщательно протестируй: Обязательно тщательно протестируй свою модель как в изоляции, так и в составе конвейера.

-

Создай Pull Request: Когда будешь доволен своей моделью, создай Pull Request в основной репозиторий для проверки.

-

Проверка кода и слияние: После проверки, если твоя модель соответствует нашим критериям, она будет объединена с основным репозиторием.

Подробные шаги описаны в нашем Руководстве по внесению вклада.

Link to this sectionЧасто задаваемые вопросы (FAQ)#

Link to this sectionКакая последняя модель Ultralytics YOLO?#

Последняя модель Ultralytics YOLO — это YOLO26, выпущенная в январе 2026 года. YOLO26 поддерживает сквозной инференс без NMS, оптимизированное развертывание на периферийных устройствах, а также обнаружение, сегментацию экземпляров, семантическую сегментацию, классификацию, оценку позы, OBB и версии с открытым словарем. Для стабильных производственных рабочих нагрузок рекомендуются как YOLO26, так и YOLO11.

Link to this sectionКак обучить модель YOLO на своих данных?#

Обучение модели YOLO на своих данных легко выполняется с помощью библиотек Ultralytics. Вот краткий пример:

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)Более подробные инструкции можно найти на странице документации Train.

Link to this sectionКакие версии YOLO поддерживаются Ultralytics?#

Ultralytics поддерживает полный спектр версий YOLO (You Only Look Once) от YOLOv3 до YOLO26, а также такие модели, как YOLO-NAS, SAM и RT-DETR. Каждая версия оптимизирована для различных задач, таких как обнаружение, сегментация, семантическая сегментация и классификация. Для получения подробной информации о каждой модели обратись к документации Models Supported by Ultralytics.

Link to this sectionПочему стоит использовать платформу Ultralytics для проектов по машинному обучению?#

Платформа Ultralytics предоставляет сквозную платформу без кода для обучения, развертывания и управления моделями YOLO. Она упрощает сложные рабочие процессы, позволяя пользователям сосредоточиться на производительности моделей и приложениях. HUB также предлагает возможности облачного обучения, комплексное управление наборами данных и удобные интерфейсы как для новичков, так и для опытных разработчиков.

Link to this sectionКакие типы задач могут выполнять модели Ultralytics YOLO?#

Модели Ultralytics YOLO универсальны и могут выполнять задачи, включая обнаружение объектов, сегментацию экземпляров, семантическую сегментацию, классификацию, оценку позы и ориентированное обнаружение объектов (OBB). Последняя модель, YOLO26, поддерживает все шесть задач плюс обнаружение с открытым словарем. Подробности о конкретных задачах смотри на страницах Task pages.