Ultralytics YOLO Hiperparametre Ayarlama Rehberi

Giriş

Hiperparametre ayarlaması, tek seferlik bir kurulumdan ibaret değildir; aksine, doğruluk, kesinlik ve geri çağırma gibi makine öğrenimi modelinin performans ölçütlerini optimize etmeyi amaçlayan yinelemeli bir süreçtir. Ultralytics YOLO bağlamında bu hiperparametreler, öğrenme hızından katman sayısı veya kullanılan aktivasyon fonksiyonlarının türleri gibi mimari ayrıntılara kadar uzanabilir. Ultralytics ayrıca, yapılandırılabilir hiperparametreler ve gerçek zamanlı metrik izleme özellikleriyle bulut üzerinde eğitimi desteklemektedir.

İzle: Daha İyi Model Performansı İçin Hiperparametreler Nasıl Ayarlanır 🚀

Hiperparametreler nelerdir?

Hiperparametreler, algoritma için üst düzey, yapısal ayarlardır. Eğitim aşamasından önce ayarlanır ve bu aşama sırasında sabit kalır. İşte Ultralytics YOLO'da yaygın olarak ayarlanan bazı hiperparametreler:

- Öğrenme Oranı

lr0: İçinde bir minimuma doğru hareket ederken her yinelemede adım boyutunu belirler. kayıp fonksiyonu. - Yığın Boyutu

batch: Bir ileri geçişte aynı anda işlenen görüntü sayısı. - Epok Sayısı

epochs: Bir epoch, tüm eğitim örneklerinin bir tam ileri ve geri geçişidir. - Mimari Özellikleri: Kanal sayıları, katman sayısı, aktivasyon fonksiyonlarının türleri vb.

YOLO26'da kullanılan artırma hiperparametrelerinin tam listesi için lütfen yapılandırmalar sayfasına bakın.

Genetik Evrim ve Mutasyon

Ultralytics YOLO, hiperparametreleri optimize etmek için genetik algoritmalar kullanır. Genetik algoritmalar, doğal seçilim ve genetik mekanizmasından esinlenmiştir.

- Çaprazlama: Her yineleme, uygunluk ağırlıklı ebeveyn seçimi ile BLX-α çaprazlama yöntemini kullanarak, o ana kadar gözlemlenen en yüksek uygunluklu yapılandırmalardan en fazla dokuz tanesinin genlerini birleştirir.

- Mutasyon: Yeniden birleştirilen aday, daha sonra her bir hiperparametreye uygulanan log-normal bir çarpım faktörüyle (parametre başına 0,5 olasılıkla) bozulur. Mutasyon gücü sigma, ilk 300 yineleme boyunca 0,2'den 0,1'e doğrusal olarak azalır; böylece algoritma başlangıçta geniş bir alanı tarar ve yakınsama sürecinde daha da hassaslaşır. 1. yinelemede çaprazlama yapılacak ebeveyn yoktur ve varsayılan eğitim hiperparametreleri temel alınır.

Hiperparametre Ayarlamaya Hazırlık

İyileştirme işlemine başlamadan önce şunlar önemlidir:

- Metrikleri Belirleyin: Modelin performansını değerlendirmek için kullanacağınız metrikleri belirleyin. Bu AP50, F1-skoru veya başkaları olabilir.

- Ayarlama Bütçesini Ayarlayın: Ayırmak istediğiniz işlem kaynaklarının miktarını tanımlayın. Hiperparametre ayarlama, yoğun işlem gerektirebilir.

İlgili Adımlar

Hiperparametreleri başlat

Makul bir başlangıç hiperparametreleri kümesiyle başlayın. Bu, Ultralytics YOLO tarafından ayarlanan varsayılan hiperparametreler veya alan bilginize veya önceki deneylerinize dayalı bir şey olabilir.

Hiperparametreleri Değiştir

Şunu kullanın: _mutate mevcut kümeye dayalı olarak yeni bir hiperparametre kümesi üretme method'u. The Tuner sınıfı bu süreci otomatik olarak yönetir.

Model Eğitimi

Eğitim, mutasyona uğramış hiperparametreler kümesi kullanılarak gerçekleştirilir. Eğitim performansı daha sonra seçtiğiniz metrikler kullanılarak değerlendirilir.

Modeli Değerlendirin

Modelin performansını değerlendirmek için AP50, F1 skoru veya özel metrikler gibi metrikleri kullanın. Değerlendirme süreci, mevcut hiperparametrelerin öncekilerden daha iyi olup olmadığını belirlemeye yardımcı olur.

Sonuçları Kaydet

İleride başvurmak üzere hem performans ölçütlerini hem de ilgili hiperparametreleri kaydetmek çok önemlidir. Ultralytics YOLO , bu sonuçlarıYOLO NDJSON formatında kaydeder.

Tekrarla

Süreç, ayarlanan yineleme sayısına ulaşılana veya performans metriği tatmin edici olana kadar tekrarlanır. Her yineleme, önceki çalıştırmalardan elde edilen bilgi üzerine inşa edilir.

Varsayılan Arama Alanı Açıklaması

Aşağıdaki tablo, YOLO26'da hiperparametre ayarlaması için varsayılan arama alanı parametrelerini listeler. Her parametrenin bir demet ile tanımlanmış belirli bir değer aralığı vardır. (min, max).

| Parametre | Tür | Değer Aralığı | Açıklama |

|---|---|---|---|

lr0 | float | (1e-5, 1e-2) | Eğitimin başlangıcındaki ilk öğrenme oranı. Daha düşük değerler daha kararlı bir eğitim ancak daha yavaş yakınsama sağlar |

lrf | float | (0.01, 1.0) | lr0'ın bir kesri olarak nihai öğrenme oranı faktörü. Öğrenme oranının eğitim sırasında ne kadar azalacağını kontrol eder |

momentum | float | (0.7, 0.98) | SGD momentum faktörü. Daha yüksek değerler tutarlı gradyan yönünü korumaya yardımcı olur ve yakınsamayı hızlandırabilir |

weight_decay | float | (0.0, 0.001) | Aşırı öğrenmeyi önlemek için L2 düzenlileştirme faktörü. Daha büyük değerler, daha güçlü düzenlileştirme uygular |

warmup_epochs | float | (0.0, 5.0) | Doğrusal öğrenme oranı ısınması için dönem sayısı. Erken eğitim istikrarsızlığını önlemeye yardımcı olur. |

warmup_momentum | float | (0.0, 0.95) | Isınma aşamasındaki başlangıç momentumu. Kademeli olarak nihai momentum değerine yükselir. |

box | float | (1.0, 20.0) | Toplam kayıp fonksiyonunda sınırlayıcı kutu kayıp ağırlığı. Kutu regresyonunu sınıflandırmaya karşı dengeler |

cls | float | (0.1, 4.0) | Toplam kayıp fonksiyonunda sınıflandırma kaybı ağırlığı. Daha yüksek değerler, doğru sınıf tahminini vurgular |

cls_pw | float | (0.0, 1.0) | Sınıf dengesizliğini gidermek için sınıf ağırlıklandırma gücü. Daha yüksek değerler, nadir sınıfların ağırlığını artırır |

dfl | float | (0.4, 12.0) | Toplam kayıp fonksiyonundaki DFL (Distribution Focal Loss) ağırlığı. Daha yüksek değerler, hassas sınırlayıcı kutu yerelleştirmesini vurgular |

hsv_h | float | (0.0, 0.1) | HSV renk uzayında rastgele renk tonu artırma aralığı. Modelin renk varyasyonları arasında genelleme yapmasına yardımcı olur |

hsv_s | float | (0.0, 0.9) | HSV uzayında rastgele doygunluk artırma aralığı. Farklı aydınlatma koşullarını simüle eder |

hsv_v | float | (0.0, 0.9) | Rastgele değer (parlaklık) artırma aralığı. Modelin farklı pozlama seviyelerini işlemesine yardımcı olur |

degrees | float | (0.0, 45.0) | Derece cinsinden maksimum döndürme artırımı. Modelin nesne yönüne karşı değişmez hale gelmesine yardımcı olur |

translate | float | (0.0, 0.9) | Görüntü boyutunun kesri olarak maksimum öteleme artırımı. Nesne konumuna karşı sağlamlığı artırır |

scale | float | (0.0, 0.95) | Rastgele ölçeklendirme artırma aralığı. Modelin farklı boyutlardaki nesneleri algılamasına yardımcı olur |

shear | float | (0.0, 10.0) | Derece cinsinden maksimum kayma artırımı. Eğitim görüntülerine perspektif benzeri bozulmalar ekler |

perspective | float | (0.0, 0.001) | Rastgele perspektif artırma aralığı. Farklı görüş açılarını simüle eder |

flipud | float | (0.0, 1.0) | Eğitim sırasında dikey görüntü çevirme olasılığı. Havadan/hava görüntüleri için kullanışlıdır |

fliplr | float | (0.0, 1.0) | Yatay görüntü çevirme olasılığı. Modelin nesne yönüne karşı değişmez hale gelmesine yardımcı olur |

bgr | float | (0.0, 1.0) | Renk kanallarını değiştiren BGR artırması kullanma olasılığı. Renk değişmezliğine yardımcı olabilir |

mosaic | float | (0.0, 1.0) | 4 görüntüyü birleştiren mozaik artırmayı kullanma olasılığı. Özellikle küçük nesne tespiti için kullanışlıdır |

mixup | float | (0.0, 1.0) | İki görüntüyü karıştıran mixup artırmayı kullanma olasılığı. Modelin sağlamlığını artırabilir |

cutmix | float | (0.0, 1.0) | Cutmix artırmasını kullanma olasılığı. Yerel özellikleri korurken görüntü bölgelerini birleştirir. |

copy_paste | float | (0.0, 1.0) | Kopyala-yapıştır artırmayı kullanma olasılığı. Örnek bölümleme performansını artırmaya yardımcı olur |

close_mosaic | float | (0.0, 10.0) | Eğitimi tamamlanmadan önce stabilize etmek için son N epokta mozaik özelliğini devre dışı bırakır. |

Özel Arama Alanı Örneği

İşte bir arama alanı tanımlama ve şunu kullanma yöntemi model.tune() kullanma yöntemi Tuner YOLO26n'nin COCO8 üzerinde 30 epok için AdamW optimize edici ile hiperparametre ayarlaması ve daha hızlı ayarlama için son epok dışındaki çizim, kontrol noktası oluşturma ve doğrulamayı atlama sınıfı.

Uyarı

Bu örnek yalnızca gösteri amaçlıdır. Kısa veya küçük ölçekli ayarlama çalıştırmalarından elde edilen hiperparametreler, gerçek dünya eğitimi için nadiren optimaldir. Uygulamada, güvenilir ve aktarılabilir sonuçlar sağlamak için ayarlama, karşılaştırılabilir veri kümeleri, epoklar ve artırmalar dahil olmak üzere tam eğitime benzer ayarlarda gerçekleştirilmelidir. Hızlı ayarlama, parametreleri daha hızlı yakınsamaya veya genelleşmeyen kısa vadeli doğrulama kazanımlarına doğru yönlendirebilir.

Örnek

from ultralytics import YOLO

# Initialize the YOLO model

model = YOLO("yolo26n.pt")

# Define search space

search_space = {

"lr0": (1e-5, 1e-2),

"degrees": (0.0, 45.0),

}

# Tune hyperparameters on COCO8 for 30 epochs

model.tune(

data="coco8.yaml",

epochs=30,

iterations=300,

optimizer="AdamW",

space=search_space,

plots=False,

save=False,

val=False,

)

Kesintiye Uğramış Bir Hiperparametre Ayarlama Oturumuna Devam Etme

Kesintiye uğramış bir hiperparametre ayarlama oturumuna şunu ileterek devam edebilirsiniz: resume=True. İsteğe bağlı olarak dizini geçirebilirsiniz name altında kullanılır runs/{task} devam etmek için. Aksi takdirde, son kesintiye uğrayan oturuma devam eder. Ayrıca, aşağıdakiler de dahil olmak üzere önceki tüm eğitim argümanlarını da sağlamanız gerekir: data, epochs, iterations ve space.

Kullanarak resume=True ile model.tune()

from ultralytics import YOLO

# Define a YOLO model

model = YOLO("yolo26n.pt")

# Define search space

search_space = {

"lr0": (1e-5, 1e-2),

"degrees": (0.0, 45.0),

}

# Resume previous run

results = model.tune(data="coco8.yaml", epochs=50, iterations=300, space=search_space, resume=True)

# Resume tuning run with name 'tune_exp'

results = model.tune(data="coco8.yaml", epochs=50, iterations=300, space=search_space, name="tune_exp", resume=True)

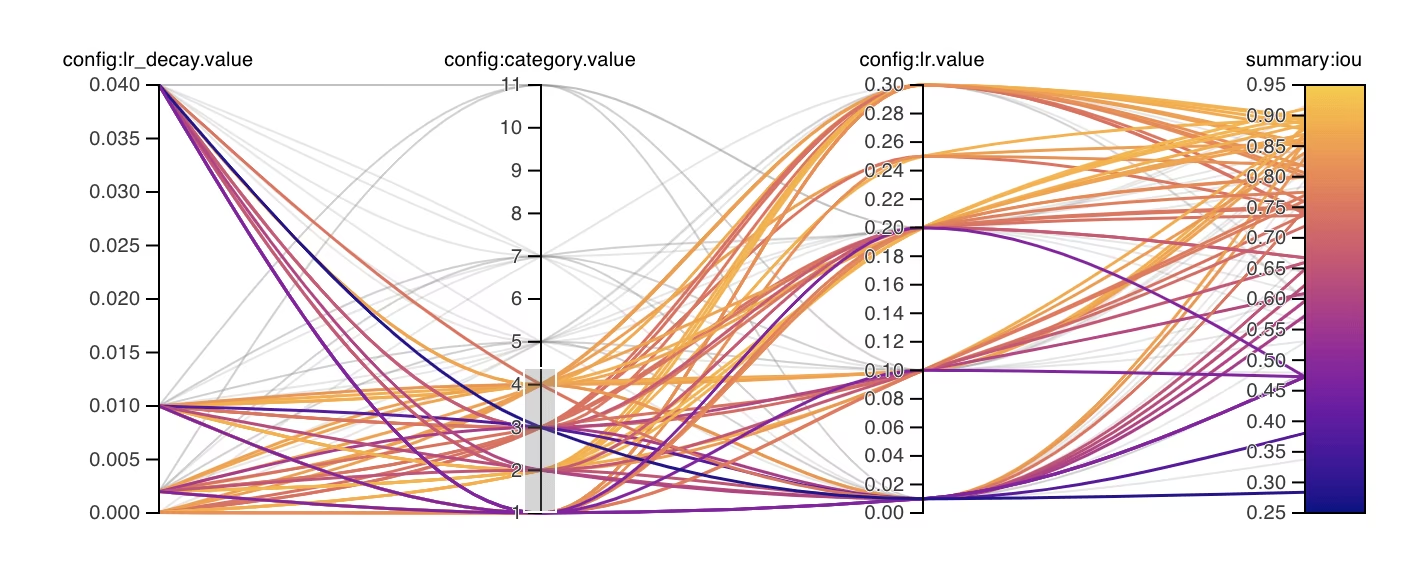

Sonuçlar

Hiperparametre ayarlama işlemini başarıyla tamamladıktan sonra, ayarlama sonuçlarını kapsayan çeşitli dosya ve dizinler elde edeceksiniz. Aşağıda her biri açıklanmaktadır:

Dosya Yapısı

İşte sonuçların dizin yapısının nasıl görüneceği. Eğitim dizinleri şuna benzer: train1/ bireysel ayarlama yinelemeleri içerir, yani bir hiperparametre kümesiyle eğitilmiş bir model. Bu tune/ dizininde, tüm bireysel model eğitimlerinden elde edilen ayarlama sonuçları bulunur:

runs/

└── detect/

├── train1/

├── train2/

├── ...

└── tune/

├── best_hyperparameters.yaml

├── tune_fitness.png

├── tune_results.ndjson

├── tune_scatter_plots.png

└── weights/

├── last.pt

└── best.pt

Dosya Açıklamaları

best_hyperparameters.yaml

Bu YAML dosyası, ayarlama işlemi sırasında bulunan en iyi performansı gösteren hiperparametreleri içerir. Gelecekteki eğitimleri bu optimize edilmiş ayarlarla başlatmak için bu dosyayı kullanabilirsiniz.

- Format: YAML

- Kullanım: Hiperparametre sonuçları

Örnek:

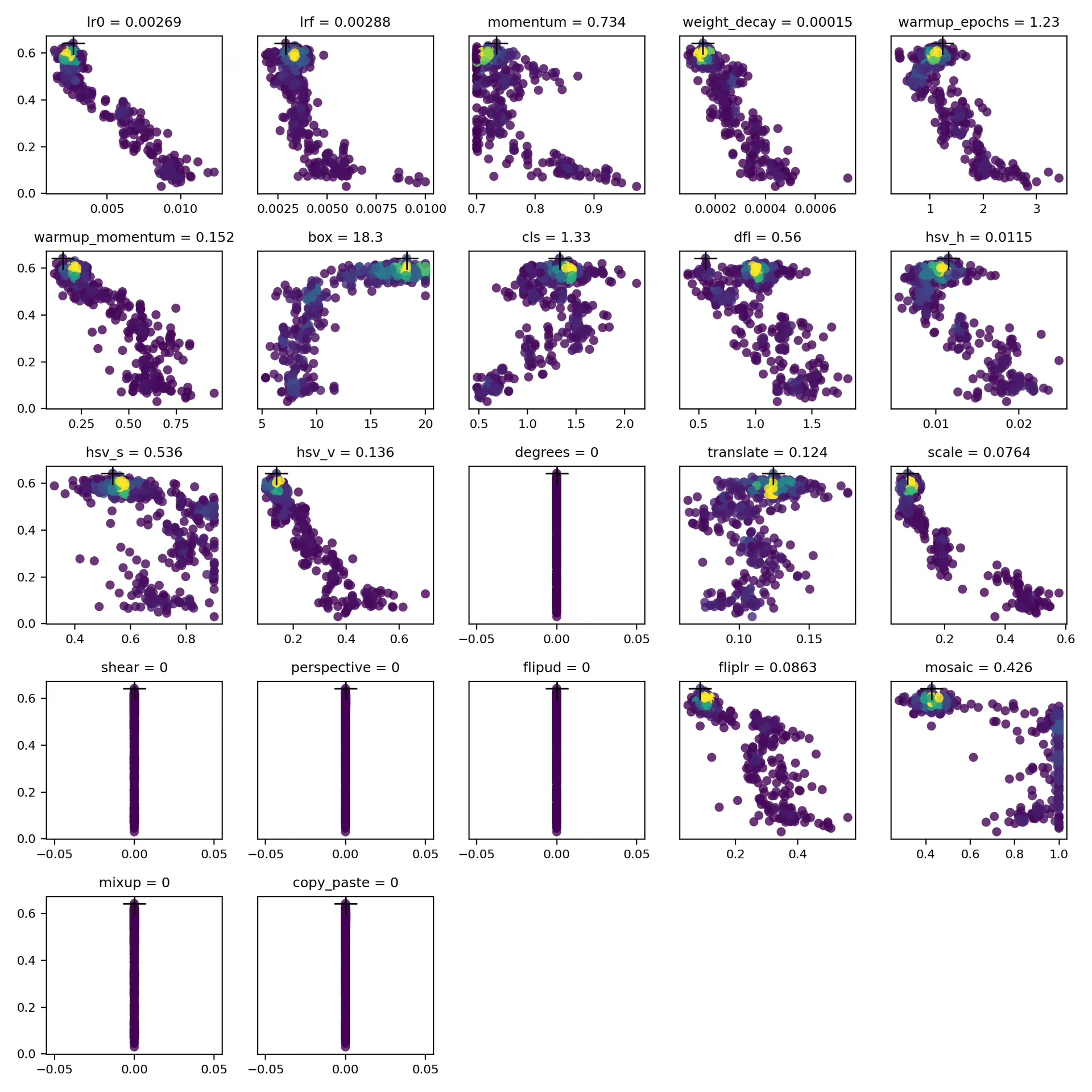

# 558/900 iterations complete ✅ (45536.81s) # Results saved to /usr/src/ultralytics/runs/detect/tune # Best fitness=0.64297 observed at iteration 498 # Best fitness metrics are {'metrics/precision(B)': 0.87247, 'metrics/recall(B)': 0.71387, 'metrics/mAP50(B)': 0.79106, 'metrics/mAP50-95(B)': 0.62651, 'val/box_loss': 2.79884, 'val/cls_loss': 2.72386, 'val/dfl_loss': 0.68503, 'fitness': 0.64297} # Best fitness model is /usr/src/ultralytics/runs/detect/train498 # Best fitness hyperparameters are printed below. lr0: 0.00269 lrf: 0.00288 momentum: 0.73375 weight_decay: 0.00015 warmup_epochs: 1.22935 warmup_momentum: 0.1525 box: 18.27875 cls: 1.32899 dfl: 0.56016 hsv_h: 0.01148 hsv_s: 0.53554 hsv_v: 0.13636 degrees: 0.0 translate: 0.12431 scale: 0.07643 shear: 0.0 perspective: 0.0 flipud: 0.0 fliplr: 0.08631 mosaic: 0.42551 mixup: 0.0 copy_paste: 0.0

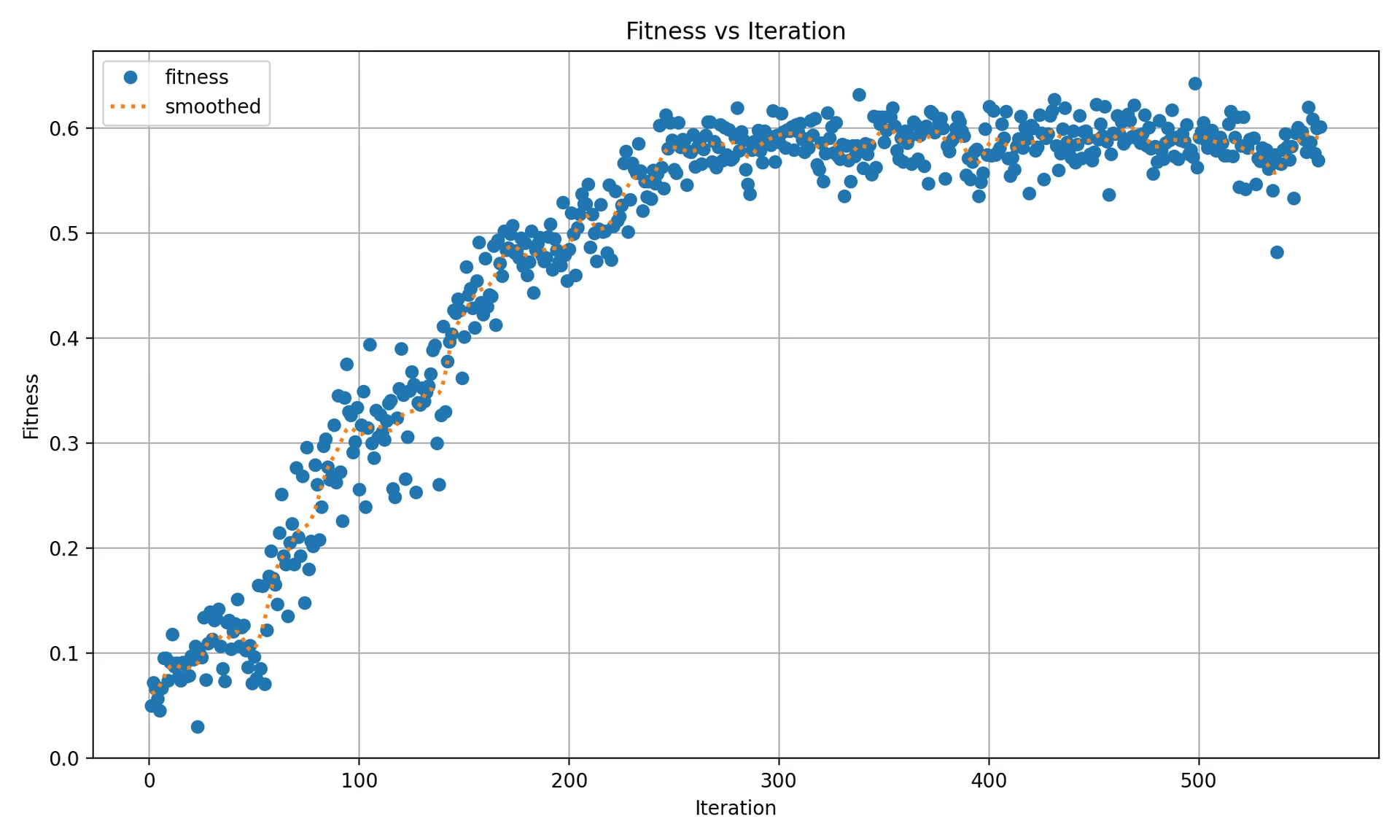

tune_fitness.png

Bu grafik, uygunluk değerini yineleme sayısına göre göstermektedir. Genetik algoritmanın zaman içinde nasıl bir performans sergilediğini görselleştirmenize yardımcı olur.

- Format: PNG

- Kullanım: Performans görselleştirmesi

Arazide şunlar bulunmaktadır:

- Her veri kümesi için her yinelemede bir işaretçi gösterilir; dolayısıyla tek veri kümesi çalıştırmasında her yinelemede bir nokta, çoklu veri kümesi çalıştırmasında ise her yinelemede her veri kümesi için bir nokta gösterilir.

- Noktalı "düzeltilmiş ortalama" çizgisi Gauss düzeltmesi olarak hesaplanır (

sigma=3) her yineleme için en üst düzeydeki uygunluk değerleri üzerinden.

tune_results.ndjson

Her ayarlama döngüsünün ayrıntılı sonuçlarını içeren bir NDJSON dosyası. Her satır, toplam uygunluk değeri, ayarlanmış hiperparametreler ve veri kümesi başına metrikleri içeren bir JSON nesnesidir. Tek veri kümesi ve çoklu veri kümesi ayarlamaları aynı dosya biçimini kullanır.

- Biçim: NDJSON

- Kullanım: Yineleme başına sonuç izleme.

- Örnek:

Okunabilirliği artırmak amacıyla aşağıda biçimlendirilmiş bir örnek verilmiştir. Gerçekte .ndjson dosyada, her nesne tek bir satırda saklanır.

{

"iteration": 1,

"fitness": 0.48628,

"hyperparameters": {

"lr0": 0.01,

"lrf": 0.01,

"momentum": 0.937,

"weight_decay": 0.0005

},

"datasets": {

"coco8": {

"metrics/precision(B)": 0.65666,

"metrics/recall(B)": 0.85,

"metrics/mAP50(B)": 0.85086,

"metrics/mAP50-95(B)": 0.64104,

"val/box_loss": 1.57958,

"val/cls_loss": 1.04986,

"val/dfl_loss": 1.32641,

"fitness": 0.64104

},

"coco8-grayscale": {

"metrics/precision(B)": 0.6582,

"metrics/recall(B)": 0.51667,

"metrics/mAP50(B)": 0.59106,

"metrics/mAP50-95(B)": 0.33152,

"val/box_loss": 1.95424,

"val/cls_loss": 1.64059,

"val/dfl_loss": 1.70226,

"fitness": 0.33152

}

},

"save_dirs": {

"coco8": "runs/detect/coco8",

"coco8-grayscale": "runs/detect/coco8-grayscale"

}

}

En üst düzey fitness her veri kümesi için aritmetik ortalamadır fitness değerler. Tek veri kümesi ile ayarlama için datasets dict'te, değeri fitness en üst düzeyle eşittir fitness. Tamamlanan her yineleme için bir JSON nesnesi kaydedilir. Gerçek save_dirs yollar mutlak yollardır; okunabilirlik amacıyla yukarıda kısaltılmıştır.

tune_scatter_plots.png

Bu dosya, şuradan oluşturulan dağılım grafiklerini içerir: tune_results.ndjson, farklı hiperparametreler ile performans ölçütleri arasındaki ilişkileri görselleştirmenize yardımcı olur. Varsayılan değeri 0 olan hiperparametreler (örneğin, degrees ve shear (aşağıda) ilk tohumlarından çok yavaş bir şekilde evrimleşebilirler; çünkü çarpımsal mutasyon faktörü, sıfıra yakın bir değerden yola çıkarak genişleyecek çok az bir potansiyele sahiptir.

- Format: PNG

- Kullanım: Keşifsel veri analizi

weights/

Bu dizin, hiperparametre ayarlama işlemi sırasında son ve en iyi yinelemeler için kaydedilmiş PyTorch modellerini içerir.

last.pt: last.pt, eğitimin son yinelemesinden elde edilen ağırlıklardır.best.pt: En iyi uygunluk puanına ulaşan yineleme için best.pt ağırlıkları.

Bu sonuçları kullanarak, gelecekteki model eğitimleriniz ve analizleriniz için daha bilinçli kararlar verebilirsiniz. Modelinizin ne kadar iyi performans gösterdiğini ve daha da nasıl geliştirebileceğinizi anlamak için bu yapıtlara danışmaktan çekinmeyin.

Sonuç

YOLO hiperparametre ayarlama süreci, BLX-α çaprazlamasını log-normal mutasyonla birleştiren genetik algoritma tabanlı yaklaşımı sayesinde hem basit hem deYOLO . Bu kılavuzda açıklanan adımları takip etmek, daha iyi performans elde etmek için modelinizi sistematik bir şekilde ayarlamanıza yardımcı olacaktır.

Daha Fazla Okuma

- Wikipedia'da Hiperparametre Optimizasyonu

- YOLOv5 Hiperparametre Evrimi Kılavuzu

- Ray Tune ve YOLO26 ile Verimli Hiperparametre Ayarlaması

Daha derin bilgiler için şurayı inceleyebilirsiniz: Tuner sınıf kaynak kodu ve beraberindeki belgeler. Herhangi bir sorunuz, özellik isteğiniz olması veya daha fazla yardıma ihtiyacınız olması durumunda, lütfen bizimle iletişime geçmekten çekinmeyin: GitHub veya Discord.

SSS

Hiperparametre ayarlama sırasında Ultralytics YOLO için öğrenme oranını nasıl optimize ederim?

Ultralytics YOLO için öğrenme oranını optimize etmek için, kullanarak bir başlangıç öğrenme oranı belirleyerek başlayın. lr0 parametresi. Yaygın değerler şu aralıktadır: 0.001 için 0.01. Hiperparametre ayarlama sürecinde, bu değer en uygun ayarı bulmak için değiştirilecektir. Şunu kullanabilirsiniz: model.tune() Bu süreci otomatikleştirmek için yöntem. Örneğin:

Örnek

from ultralytics import YOLO

# Initialize the YOLO model

model = YOLO("yolo26n.pt")

# Tune hyperparameters on COCO8 for 30 epochs

model.tune(data="coco8.yaml", epochs=30, iterations=300, optimizer="AdamW", plots=False, save=False, val=False)

Daha fazla ayrıntı için Ultralytics YOLO yapılandırma sayfasını inceleyin.

YOLO26'da hiperparametre ayarlaması için genetik algoritmalar kullanmanın faydaları nelerdir?

Ultralytics YOLO26'daki genetik algoritmalar, hiperparametre uzayını keşfetmek için sağlam bir yöntem sunarak yüksek düzeyde optimize edilmiş model performansına yol açar. Başlıca faydaları şunlardır:

- Etkili Arama: BLX-α melezleme yöntemi, en yüksek uygunluğa sahip ebeveynlerin genlerini birleştirirken, log-normal mutasyon süreci sonucu bozarak yeni adaylar keşfeder.

- Yerel Minimumlardan Kaçınma: Rastgelelik sağlayarak, daha iyi küresel optimizasyon sağlayarak yerel minimumlardan kaçınmaya yardımcı olurlar.

- Performans Göstergeleri: Göreve özgü bir uygunluk puanına göre uyarlanırlar (algılama içinmAP50).

Genetik algoritmaların hiperparametreleri nasıl optimize edebileceğini görmek için hiperparametre evrimi kılavuzuna göz atın.

Ultralytics YOLO için hiperparametre ayarlama işlemi ne kadar sürer?

Ultralytics YOLO ile hiperparametre ayarlaması için gereken süre, veri kümesinin boyutu, model mimarisinin karmaşıklığı, iterasyon sayısı ve mevcut hesaplama kaynakları gibi çeşitli faktörlere büyük ölçüde bağlıdır. Örneğin, COCO8 gibi bir veri kümesinde YOLO26n'yi 30 epok için ayarlamak, donanıma bağlı olarak birkaç saatten günlere kadar sürebilir.

Ayar süresini etkili bir şekilde yönetmek için, önceden net bir ayarlama bütçesi tanımlayın (dahili bölüm bağlantısı). Bu, kaynak tahsisini ve optimizasyon hedeflerini dengelemede yardımcı olur.

YOLO'da hiperparametre ayarlaması sırasında model performansını değerlendirmek için hangi metrikleri kullanmalıyım?

YOLO'da hiperparametre ayarlaması sırasında model performansını değerlendirirken, çeşitli temel metrikleri kullanabilirsiniz:

- AP50: 0.50 IoU eşiğindeki ortalama kesinlik.

- F1-Skoru: Kesinlik ve hatırlamanın harmonik ortalamasıdır.

- Hassasiyet ve Geri Çağırma: Modelin yanlış pozitiflere ve yanlış negatiflere karşı gerçek pozitifleri belirlemedeki doğruluğunu gösteren bireysel metrikler.

Bu metrikler, modelinizin performansının farklı yönlerini anlamanıza yardımcı olur. Kapsamlı bir genel bakış için Ultralytics YOLO performans metrikleri kılavuzuna bakın.

YOLO26 ile gelişmiş hiperparametre optimizasyonu için Ray Tune kullanabilir miyim?

Evet, Ultralytics YOLO26, gelişmiş hiperparametre optimizasyonu için Ray Tune ile entegre olur. Ray Tune, Bayesian Optimizasyonu ve Hyperband gibi gelişmiş arama algoritmaları ile birlikte ayarlama sürecini hızlandırmak için paralel yürütme yetenekleri sunar.

Ray Tune'u YOLO26 ile kullanmak için, sadece şunu ayarlayın: use_ray=True parametresi içinde model.tune() yöntem çağrısı. Daha fazla ayrıntı ve örnek için şuraya göz atın: Ray Tune entegrasyon kılavuzu.