Ultralytics Platform

Ultralytics Platform 是一个全面的端到端计算机视觉平台,它简化了从数据准备到模型部署的整个机器学习工作流程。它专为需要生产级计算机视觉解决方案但又不想处理复杂基础设施的团队和个人而设计。

什么是 Ultralytics Platform?

Ultralytics Platform 旨在用统一的解决方案取代分散的机器学习工具。它结合了以下功能:

- Roboflow - 数据管理和标注

- Weights & Biases - 实验跟踪

- SageMaker - 云训练

- HuggingFace - 模型部署

- Arize - 监控

工作流程:上传 → 标注 → 训练 → 导出 → 部署

该平台提供端到端的工作流程:

graph LR

subgraph Data["📁 Data"]

A[Upload] --> B[Annotate]

B --> C[Analyze]

end

subgraph Train["🚀 Train"]

D[Configure] --> E[Train on GPU]

E --> F[View Metrics]

end

subgraph Deploy["🌐 Deploy"]

G[Export] --> H[Deploy Endpoint]

H --> I[Monitor]

end

Data --> Train --> Deploy| 阶段 | 功能 |

|---|---|

| 上传 | 图像 (50MB)、视频 (1GB) 和数据集文件 (ZIP、TAR,包括 .tar.gz/.tgzNDJSON) 并进行自动处理 |

| 标注 | 手动工具、SAM智能标注、YOLO自动标注,支持所有5种任务类型(参见支持的任务) |

| 训练 | 云端 GPU (20 个免费 + 3 个专业版专属),实时指标,项目组织 |

| 导出 | 17种部署格式 (ONNX、TensorRT、CoreML、TFLite 等;参见支持的格式) |

| 部署 | 43 个全球区域,提供专用端点、自动扩缩和监控 |

您可以执行以下操作:

- 上传图像、视频和数据集文件以创建训练数据集

- 可视化 所有5种YOLO任务类型的交互式叠加标注(参见支持的任务)

- 训练模型:在云端 GPU 上训练模型 (20 个免费,专业版共 23 个),并附带实时指标

- 导出到17种部署格式(ONNX、TensorRT、CoreML、TFLite等)

- 部署到 43 个全球区域,通过一键式专用端点

- 监控训练进度、部署健康状况和使用指标

- 协作,通过将项目和数据集公开给社区

多区域基础设施

您的数据保留在您所在的区域。Ultralytics Platform 在全球三个区域运营基础设施:

| 区域 | 标签 | 位置 | 最适合 |

|---|---|---|---|

| 美国 | 美洲 | 爱荷华州,美国 | 美洲用户,美洲地区最快 |

| 欧盟 | 欧洲、中东和非洲 | 比利时,欧洲 | 欧洲用户,符合 GDPR 规定 |

| AP | 亚太地区 | 香港,亚太地区 | 亚太用户,亚太地区延迟最低 |

您在入职时选择您的区域,所有数据、模型和部署都将保留在该区域。

区域永久性

您的数据区域在账户创建后无法更改。在入职过程中,平台会测量到每个区域的延迟并推荐最近的区域。请谨慎选择。

主要功能

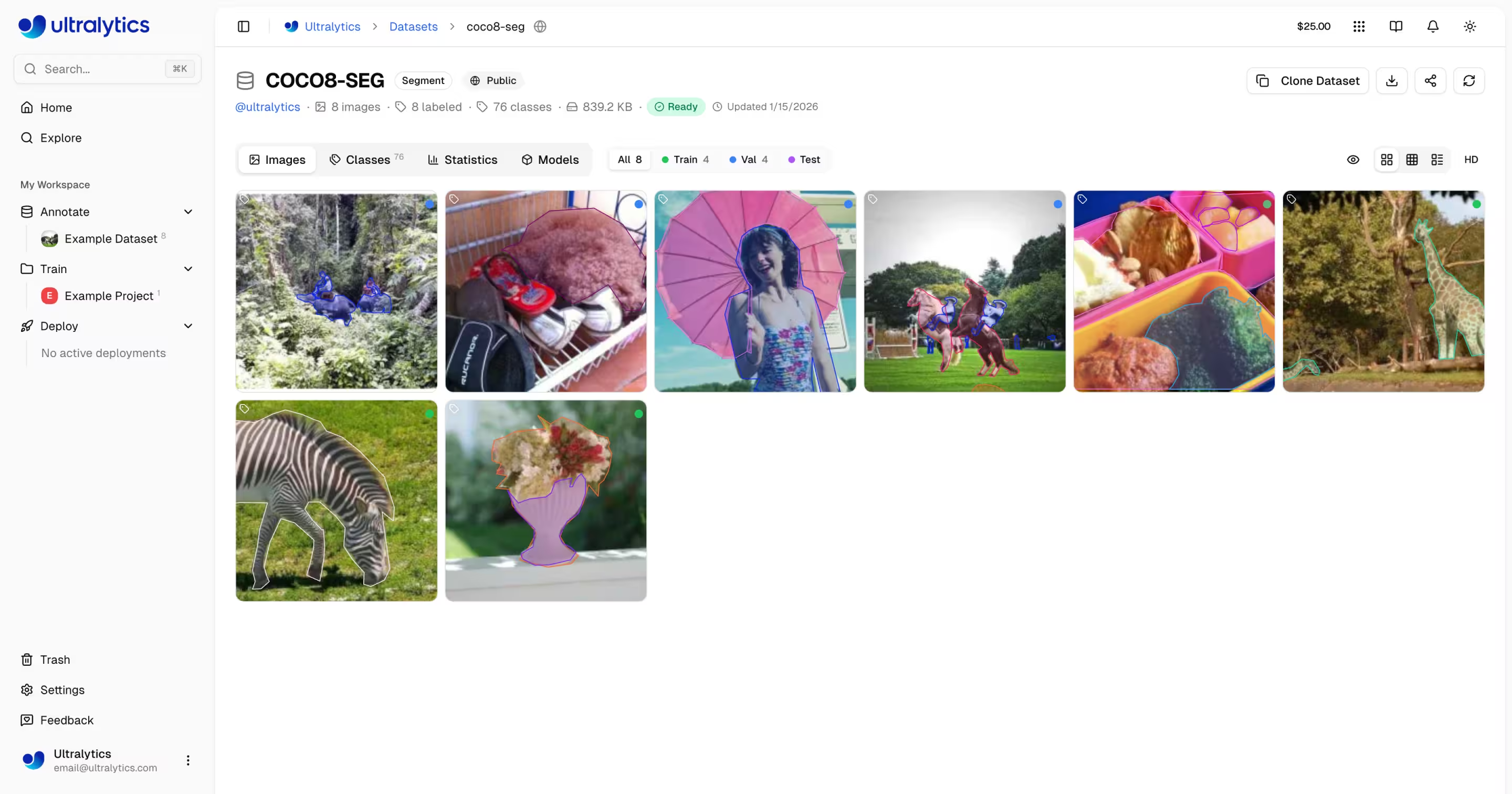

数据准备

- 数据集管理:上传图像、视频或数据集文件并进行自动处理

- 标注编辑器:支持所有5种YOLO任务类型(detect、segment、姿势估计、旋转框检测、classify;参见支持的任务)的手动标注

- 骨架模板:内置(人物、手、脸、狗、框)和自定义骨架模板,用于一键姿势标注

- SAM 智能标注: 基于点击的智能标注,提供 5 种模型 — SAM 2.1(Tiny、Small、Base、Large)和新的 SAM 3,以实现最高精度。可从标注工具栏按图像切换模型。

- 自动标注: 使用训练好的模型预标注新数据

- 数据集版本控制:创建带描述的编号NDJSON快照,用于可复现的训练

- 统计数据: 类别分布、位置热图和维度分析

graph LR

A[Upload Dataset/Images/Video] --> B[Auto-Process]

B --> C[Browse & Filter]

C --> D{Annotate}

D --> E[Manual Tools]

D --> F[SAM Smart]

D --> G[YOLO Auto-Label]

E --> H[Train-Ready Dataset]

F --> H

G --> H支持的任务类型

标注编辑器支持所有 5 种 YOLO 任务类型:detect(边界框)、segment(多边形)、姿势估计(关键点)、旋转框检测(有向框)和 classify(图像级标签)。每种任务类型都有专用的绘图工具和键盘快捷键。

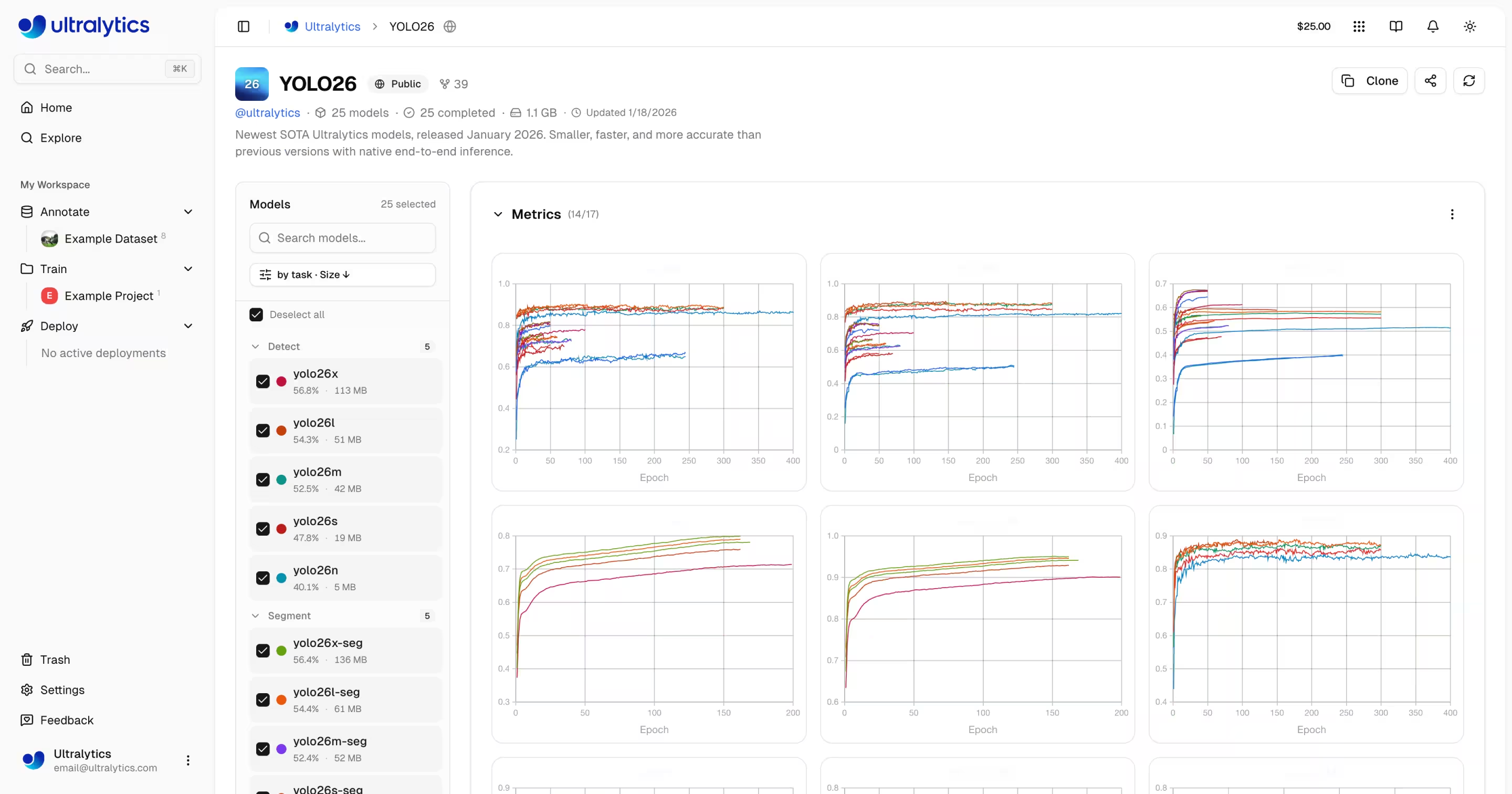

模型训练

- 云端训练:在云端 GPU 上训练 (20 个免费,专业版共 23 个),并附带实时指标

- 远程训练:随时随地进行训练,并将指标流式传输到平台(W&B风格)

- 项目组织: 对相关模型进行分组、比较实验、跟踪活动

- 17种导出格式: ONNX, TensorRT, CoreML, TFLite 等(参见支持的格式)

您可以通过 Web UI(云训练)或从您自己的机器(远程训练)来训练模型:

- 导航到您的项目

- 点击

Train Model - 选择数据集、模型、GPU和训练轮次

- 监控实时损失曲线和指标

# Install ultralytics

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train and stream metrics to the platform

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Metrics stream to Platform automatically

部署

- 推理测试: 直接在浏览器中使用自定义图像测试模型

- 专用端点: 部署到全球43个区域,支持自动扩缩容

- 监控: 实时指标、请求日志和性能仪表板

graph LR

A[Trained Model] --> B{Action}

B --> C[Browser Predict]

B --> D[Export Format]

B --> E[Deploy Endpoint]

D --> F[ONNX / TensorRT / CoreML / TFLite / ...]

E --> G[43 Global Regions]

G --> H[API Endpoint URL]

H --> I[Monitor & Scale]部署后,即可从任何语言调用您的端点:

import requests

url = "https://your-endpoint-url/predict"

headers = {"Authorization": "Bearer YOUR_API_KEY"}

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, files={"file": f})

print(response.json())

curl -X POST "https://your-endpoint-url/predict" \

-H "Authorization: Bearer YOUR_API_KEY" \

-F "file=@image.jpg"

const form = new FormData();

form.append("file", fileInput.files[0]);

const response = await fetch("https://your-endpoint-url/predict", {

method: "POST",

headers: { Authorization: "Bearer YOUR_API_KEY" },

body: form,

});

const results = await response.json();

console.log(results);

账户管理

- 团队与组织:与团队成员协作,管理角色和邀请

- API密钥: 用于远程训练和API访问的安全密钥管理

- 积分与计费: 按需付费训练,价格透明

- 活动动态:track 所有账户事件和操作

- 回收站与恢复:30 天软删除及项目恢复

- GDPR合规性: 数据导出和账户删除

计划层级

| 特性 | 免费版 | 专业版($29/月) | 企业版 |

|---|---|---|---|

| 注册积分 | 5美元 / 25美元* | - | 自定义 |

| 每月额度 | - | 每席位每月30美元 | 自定义 |

| 模型 | 100 | 500 | 无限制 |

| 并发训练 | 3 | 10 | 无限制 |

| 部署 | 3 | 10 | 无限制 |

| 存储 | 100 GB | 500 GB | 无限制 |

| 云端 GPU 类型 | 20 | 23 (包括 H200/B200) | 23 |

| 团队 | - | 最多 5 名成员 | 最多 50 个 |

| 支持 | 社区 | 优先级 | 专用 |

*注册时5美元,或使用经过验证的公司/工作邮箱25美元。

快速链接

通过以下资源开始使用:

- 快速入门: 在几分钟内创建您的第一个项目并训练模型

- 数据集: 上传和管理您的训练数据

- 标注: 使用手动和AI辅助工具标注您的数据

- 项目: 组织您的模型和实验

- 云端训练: 在云端GPU上进行训练

- 推理: 测试您的模型

- 端点: 将模型部署到生产环境

- 监控:跟踪部署性能

- API 密钥:管理 API 访问

- 计费:积分与支付

- 活动:track 账户事件

- 回收站:恢复已删除项目

- REST API:API 参考

常见问题

如何开始使用 Ultralytics Platform?

开始使用Ultralytics Platform:

- 注册:在platform.ultralytics.com创建账户

- 选择区域:在入职过程中选择您的数据区域(美国、欧盟或亚太地区)

- 上传数据集:导航到数据集部分上传您的数据

- 训练模型:创建项目并在云 GPU 上开始训练

- 部署:测试您的模型并部署到专用端点

有关详细指南,请参阅快速入门页面。

Ultralytics Platform 有哪些优势?

- 统一工作流:数据、训练和部署一站式完成

- 多区域支持:数据驻留在美国、欧盟或亚太地区

- 无代码训练:无需编写代码即可训练高级 YOLO 模型

- 实时指标:实时传输训练进度并监控部署

- 43 个部署区域:在全球范围内将模型部署到靠近用户的位置

- 5种任务类型: 支持 detect、segment、姿势估计、旋转框检测 和 分类(参见任务文档)

- AI 辅助标注:SAM 和自动标注以加快数据准备

云训练有哪些 GPU 选项可用?

Ultralytics Platform 支持多种 GPU 类型用于云训练:

| GPU | 代次 | 显存 | 每小时费用 | 最适合 |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | 小型数据集,测试 |

| RTX A4500 | Ampere | 20 GB | $0.25 | 中小型数据集 |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | 中型数据集 |

| RTX A5000 | Ampere | 24 GB | $0.27 | 中型数据集 |

| L4 | Ada | 24 GB | $0.39 | 推理优化 |

| A40 | Ampere | 48 GB | $0.40 | 更大的批次大小 |

| RTX 3090 | Ampere | 24 GB | $0.46 | 通用训练 |

| RTX A6000 | Ampere | 48 GB | $0.49 | 大型模型 |

| RTX PRO 4500 | Blackwell | 32 GB | $0.54 | 卓越的性价比 |

| RTX 4090 | Ada | 24 GB | $0.59 | 最佳性价比 |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | 大批次训练 |

| L40S | Ada | 48 GB | $0.86 | 大批次训练 |

| RTX 5090 | Blackwell | 32 GB | $0.89 | 最新消费级代次 |

| L40 | Ada | 48 GB | $0.99 | 大型模型 |

| A100 PCIe | Ampere | 80 GB | $1.39 | 生产训练 |

| A100 SXM | Ampere | 80 GB | $1.49 | 生产训练 |

| RTX PRO 6000 | Blackwell | 96 GB | $1.69 | 推荐默认值 |

| H100 PCIe | Hopper | 80 GB | $2.39 | 高性能训练 |

| H100 SXM | Hopper | 80 GB | $2.69 | 最快训练 |

| H100 NVL | Hopper | 94 GB | $3.07 | 最高性能 |

| H200 NVL | Hopper | 143 GB | $3.39 | 最大内存 (专业版+) |

| H200 SXM | Hopper | 141 GB | $3.59 | 最大性能 (专业版+) |

| B200 | Blackwell | 180 GB | $4.99 | 最大模型 (专业版+) |

请参阅 云训练 以获取完整的定价和 GPU 选项。

远程训练如何运作?

您可以在您自己的硬件上训练模型,并将实时指标流式传输到平台,类似于 Weights & Biases。

软件包版本要求

平台集成需要ultralytics>=8.4.14。更低版本将无法与平台配合使用。

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train with project/name to stream metrics

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Train using a Platform dataset directly

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 project=username/my-project name=exp1

有关远程训练的更多详细信息,请参阅云训练。

有哪些标注工具可用?

平台包含一个功能齐全的标注编辑器,支持:

- 手动工具:边界框、多边形、带骨架模板的关键点、旋转框、分类

- 骨架模板:使用内置(人物、手、脸、狗、框)或自定义模板一次性放置所有关键点

- SAM 智能标注: 点击生成精确掩码 — 通过工具栏模型选择器,从 SAM 2.1 的 Tiny/Small/Base/Large 版本或新的 SAM 3 中选择

- 键盘快捷键:通过热键实现高效工作流

| 快捷键 | 操作 |

|---|---|

V | 选择模式 |

S | SAM 智能标注模式 |

A | 自动标注模式 |

1 - 9 | 按数字选择类别 |

Delete | 删除选定标注 |

Ctrl+Z | 撤销 |

Ctrl+Y | 重做 |

Escape | 取消当前操作 |

有关完整指南,请参阅标注。

支持哪些导出格式?

平台支持 17 种部署格式:

| 格式 | 文件扩展名 | 用例 |

|---|---|---|

| ONNX | .onnx | 跨平台部署 |

| TorchScript | .torchscript | C++ 部署 |

| OpenVINO | _openvino_model | Intel 硬件 |

| TensorRT | .engine | NVIDIA GPU 推理 |

| CoreML | .mlpackage | Apple 设备 |

| TFLite | .tflite | 移动/边缘设备 |

| TF SavedModel | _saved_model | TensorFlow 生态系统 |

| TF GraphDef | .pb | TensorFlow 传统版 |

| PaddlePaddle | _paddle_model | 百度生态系统 |

| NCNN | _ncnn_model | 移动设备 (Android/ARM) |

| Edge TPU | _edgetpu.tflite | Google Coral 设备 |

| TF.js | _web_model | 浏览器部署 |

| MNN | .mnn | 阿里巴巴移动 |

| RKNN | _rknn_model | 瑞芯微 NPU |

| IMX500 | _imx_model | 索尼 IMX500 传感器 |

| Axelera | _axelera_model | Axelera AI 加速器 |

| ExecuTorch | _executorch_model | PyTorch mobile |

请参阅 模型导出、导出模式指南 和 集成索引,以了解特定格式的选项。

故障排除

数据集问题

| 问题 | 解决方案 |

|---|---|

| 数据集无法处理 | 检查文件格式是否受支持(JPEG、PNG、WebP 等)。最大文件大小:图像 50MB,视频 1GB,数据集在免费版为 10GB,专业版为 20GB,企业版为 50GB |

| 缺少标注 | 验证标签是否在 YOLO 格式 使用 .txt 与图像文件名匹配的文件 |

| “需要训练集划分” | 添加 train/ 文件夹到您的数据集结构中,或在其中创建拆分 数据集设置 |

| 类名未定义 | 添加一个 data.yaml 文件,其中包含 names: 列表(见 YOLO 格式),或在数据集设置中定义类别 |

训练问题

| 问题 | 解决方案 |

|---|---|

| 训练无法启动 | 在“设置”>“账单”中检查信用余额。需要正余额 |

| 内存不足错误 | 减小批处理大小,使用更小的模型(n/s),或选择具有更多显存的 GPU |

| 指标不佳 | 检查数据集质量,增加训练轮次(epochs),尝试数据增强,验证类别平衡 |

| 训练缓慢 | 选择更快的 GPU,减小图像尺寸,检查数据集是否成为瓶颈 |

部署问题

| 问题 | 解决方案 |

|---|---|

| 端点无响应 | 检查端点状态(就绪 vs 停止)。冷启动可能需要5-15秒 |

| 401 未授权 | 验证 API 密钥是否正确并具有所需的范围 |

| 推理缓慢 | 检查模型大小,考虑TensorRT导出,选择更近的区域 |

| 导出失败 | 某些格式需要特定的模型架构。尝试ONNX以获得最广泛的兼容性 |

常见问题

注册后可以更改用户名吗?

不可以,用户名是永久的,无法更改。请在注册时仔细选择。

我可以更改我的数据区域吗?

不可以,数据区域在注册时选择,无法更改。要切换区域,请创建一个新账户并重新上传您的数据。

如何获取更多积分?

前往“设置”>“账单”>“添加积分”。购买5美元至1000美元的积分。购买的积分永不过期。

如果训练失败怎么办?

您只需为已完成的计算时间付费。检查点已保存,您可以恢复训练。

我可以下载我训练好的模型吗?

是的,点击任意模型页面上的下载图标即可下载 .pt 文件或导出格式。

如何公开分享我的作品?

编辑您的项目或数据集设置,并将可见性切换为“公开”。公开内容将显示在“探索”页面上。

文件大小限制是多少?

图像:50MB,视频:1GB,数据集:免费版 10GB,专业版 20GB,企业版 50GB。对于更大的文件,请分多次上传。

已删除的项目在回收站中保留多久?

30天。之后,项目将被永久删除且无法恢复。

我可以将平台模型用于商业用途吗?

免费版和专业版计划使用 AGPL 许可证。对于无需 AGPL 要求的商业用途,请联系 sales@ultralytics.com 获取企业版许可证。