Guide de démarrage rapide : NVIDIA Jetson avec Ultralytics YOLO26

Ce guide complet fournit une présentation détaillée du déploiement d'Ultralytics YOLO26 sur les appareils NVIDIA Jetson. De plus, il présente des benchmarks de performance pour démontrer les capacités de YOLO26 sur ces appareils petits et puissants.

Nouvelle prise en charge de produits

Nous avons mis à jour ce guide avec le dernier NVIDIA Jetson AGX Thor Developer Kit qui offre jusqu'à 2070 FP4 TFLOPS de calcul d'IA et 128 Go de mémoire avec une puissance configurable entre 40 W et 130 W. Il offre un calcul d'IA plus de 7,5 fois supérieur à celui de NVIDIA Jetson AGX Orin, avec une efficacité énergétique 3,5 fois supérieure pour exécuter de manière transparente les modèles d'IA les plus populaires.

Regarder : Comment utiliser Ultralytics YOLO26 sur les appareils NVIDIA Jetson

Remarque

Ce guide a été testé avec le NVIDIA Jetson AGX Thor Developer Kit (Jetson T5000) exécutant la dernière version stable de JetPack JP7.0, le NVIDIA Jetson AGX Orin Developer Kit (64GB) exécutant la version JetPack JP6.2, le NVIDIA Jetson Orin Nano Super Developer Kit exécutant la version JetPack JP6.1, le Seeed Studio reComputer J4012 basé sur NVIDIA Jetson Orin NX 16GB exécutant la version JetPack JP6.0/ la version JetPack JP5.1.3 et le Seeed Studio reComputer J1020 v2 basé sur NVIDIA Jetson Nano 4GB exécutant la version JetPack JP4.6.1. Il devrait fonctionner sur toute la gamme de matériel NVIDIA Jetson, y compris les appareils les plus récents et les plus anciens.

Qu'est-ce que NVIDIA Jetson ?

NVIDIA Jetson est une série de cartes informatiques embarquées conçues pour apporter le calcul d'IA (intelligence artificielle) accéléré aux appareils périphériques. Ces appareils compacts et puissants sont construits autour de l'architecture GPU de NVIDIA et peuvent exécuter des algorithmes d'IA complexes et des modèles de deep learning directement sur l'appareil, sans dépendre des ressources de cloud computing. Les cartes Jetson sont souvent utilisées en robotique, dans les véhicules autonomes, l'automatisation industrielle et d'autres applications où l'inférence d'IA doit être effectuée localement avec une faible latence et une grande efficacité. De plus, ces cartes sont basées sur l'architecture ARM64 et fonctionnent avec une consommation d'énergie inférieure à celle des appareils de calcul GPU traditionnels.

Comparaison des séries NVIDIA Jetson

NVIDIA Jetson AGX Thor est la dernière itération de la famille NVIDIA Jetson basée sur l'architecture NVIDIA Blackwell, qui apporte une performance d'IA considérablement améliorée par rapport aux générations précédentes. Le tableau ci-dessous compare quelques-uns des appareils Jetson de l'écosystème.

| Jetson AGX Thor(T5000) | Jetson AGX Orin 64 Go | Jetson Orin NX 16 Go | Jetson Orin Nano Super | Jetson AGX Xavier | Jetson Xavier NX | Jetson Nano | |

|---|---|---|---|---|---|---|---|

| Performance de l'IA | 2070 TFLOPS | 275 TOPS | 100 TOPS | 67 TOPS | 32 TOPS | 21 TOPS | 472 GFLOPS |

| GPU | GPU architecture NVIDIA Blackwell à 2560 cœurs avec 96 Tensor Cores | GPU NVIDIA architecture Ampere à 2048 cœurs avec 64 Tensor Cores | GPU NVIDIA Ampere à architecture 1024 cœurs avec 32 Tensor Cores | GPU NVIDIA Ampere à architecture 1024 cœurs avec 32 Tensor Cores | GPU NVIDIA Volta architecture à 512 cœurs avec 64 cœurs Tensor | GPU NVIDIA architecture Volta™ à 384 cœurs avec 48 Tensor Cores | GPU NVIDIA Maxwell™ à architecture 128 cœurs |

| Fréquence maximale du GPU | 1.57 GHz | 1.3 GHz | 918 MHz | 1020 MHz | 1377 MHz | 1100 MHz | 921 MHz |

| CPU | CPU Arm® Neoverse®-V3AE 64 bits à 14 cœurs, 1 Mo de L2 + 16 Mo de L3 | CPU 12 cœurs NVIDIA Arm® Cortex A78AE v8.2 64 bits 3 Mo L2 + 6 Mo L3 | CPU NVIDIA Arm® Cortex A78AE v8.2 64 bits à 8 cœurs, 2 Mo de L2 + 4 Mo de L3 | CPU Arm® Cortex®-A78AE v8.2 64 bits à 6 cœurs, 1,5 Mo de L2 + 4 Mo de L3 | CPU NVIDIA Carmel Arm®v8.2 64 bits à 8 cœurs, 8 Mo de L2 + 4 Mo de L3 | CPU NVIDIA Carmel Arm®v8.2 64 bits à 6 cœurs, 6 Mo de L2 + 4 Mo de L3 | Processeur Quad-Core Arm® Cortex®-A57 MPCore |

| Fréquence CPU maximale | 2.6 GHz | 2.2 GHz | 2.0 GHz | 1.7 GHz | 2.2 GHz | 1.9 GHz | 1,43 GHz |

| Mémoire | 128 Go LPDDR5X 256 bits 273 Go/s | 64 Go LPDDR5 256 bits 204,8 Go/s | 16 Go LPDDR5 128 bits 102,4 Go/s | 8 Go LPDDR5 128 bits 102 Go/s | 32 Go LPDDR4x 256 bits 136,5 Go/s | 8 Go LPDDR4x 128 bits 59,7 Go/s | 4 Go 64 bits LPDDR4 25,6 Go/s |

Pour un tableau de comparaison plus détaillé, veuillez consulter la section Comparer les spécifications de la page officielle NVIDIA Jetson.

Qu'est-ce que NVIDIA JetPack ?

Le NVIDIA JetPack SDK, qui alimente les modules Jetson, est la solution la plus complète et fournit un environnement de développement complet pour la création d'applications d'IA accélérées de bout en bout et réduit les délais de commercialisation. JetPack comprend Jetson Linux avec bootloader, le noyau Linux, l'environnement de bureau Ubuntu et un ensemble complet de bibliothèques pour l'accélération du calcul GPU, du multimédia, des graphiques et de la vision par ordinateur. Il comprend également des exemples, de la documentation et des outils de développement pour l'ordinateur hôte et le kit de développement, et prend en charge les SDK de niveau supérieur tels que DeepStream pour l'analyse de flux vidéo, Isaac pour la robotique et Riva pour l'IA conversationnelle.

Flasher JetPack sur NVIDIA Jetson

La première étape après avoir acquis un appareil NVIDIA Jetson consiste à flasher NVIDIA JetPack sur l'appareil. Il existe plusieurs façons de flasher les appareils NVIDIA Jetson.

- Si vous possédez un kit de développement NVIDIA officiel tel que le Jetson AGX Thor Developer Kit, vous pouvez télécharger une image et préparer une clé USB bootable pour flasher JetPack sur le SSD inclus.

- Si vous possédez un kit de développement NVIDIA officiel tel que le kit de développement Jetson Orin Nano, vous pouvez télécharger une image et préparer une carte SD avec JetPack pour démarrer l'appareil.

- Si vous possédez un autre kit de développement NVIDIA, vous pouvez flasher JetPack sur l'appareil à l'aide de SDK Manager.

- Si vous possédez un appareil Seeed Studio reComputer J4012, vous pouvez flasher JetPack sur le SSD inclus et si vous possédez un appareil Seeed Studio reComputer J1020 v2, vous pouvez flasher JetPack sur l'eMMC/SSD.

- Si vous possédez un autre appareil tiers alimenté par le module NVIDIA Jetson, il est recommandé de suivre le flashage en ligne de commande.

Remarque

Pour les méthodes 1, 4 et 5 ci-dessus, après avoir flashé le système et démarré l'appareil, veuillez saisir « sudo apt update && sudo apt install nvidia-jetpack -y » sur le terminal de l'appareil pour installer tous les composants JetPack restants nécessaires.

Prise en charge de JetPack basée sur le périphérique Jetson

Le tableau ci-dessous met en évidence les versions de NVIDIA JetPack prises en charge par différents appareils NVIDIA Jetson.

| JetPack 4 | JetPack 5 | JetPack 6 | JetPack 7 | |

|---|---|---|---|---|

| Jetson Nano | ✅ | ❌ | ❌ | ❌ |

| Jetson TX2 | ✅ | ❌ | ❌ | ❌ |

| Jetson Xavier NX | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Xavier | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Orin | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin NX | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin Nano | ❌ | ✅ | ✅ | ❌ |

| Jetson AGX Thor | ❌ | ❌ | ❌ | ✅ |

Démarrage rapide avec Docker

Le moyen le plus rapide de démarrer avec Ultralytics YOLO26 sur NVIDIA Jetson est d'utiliser des images Docker pré-construites pour Jetson. Référez-vous au tableau ci-dessus et choisissez la version de JetPack en fonction de l'appareil Jetson que vous possédez.

t=ultralytics/ultralytics:latest-jetson-jetpack4

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack5

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack6

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-nvidia-arm64

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

Une fois cela fait, passez à la section Utiliser TensorRT sur NVIDIA Jetson.

Commencer avec l'installation native

Pour une installation native sans Docker, veuillez vous référer aux étapes ci-dessous.

Exécution sur JetPack 7.0

Installer le paquet Ultralytics

Ici, nous allons installer le package Ultralytics sur le Jetson avec les dépendances optionnelles afin de pouvoir exporter les modèles PyTorch vers d'autres formats différents. Nous nous concentrerons principalement sur les exportations NVIDIA TensorRT car TensorRT nous permettra d'obtenir les performances maximales des appareils Jetson.

Mettre à jour la liste des paquets, installer pip et mettre à niveau vers la dernière version

sudo apt update sudo apt install python3-pip -y pip install -U pipInstaller

ultralyticsPaquet pip avec des dépendances optionnellespip install ultralytics[export]Redémarrez l'appareil

sudo reboot

Installer PyTorch et Torchvision

L'installation Ultralytics ci-dessus installera Torch et Torchvision. Cependant, ces 2 packages installés via pip ne sont pas compatibles pour fonctionner sur Jetson AGX Thor qui est livré avec JetPack 7.0 et CUDA 13. Par conséquent, nous devons les installer manuellement.

Installer torch et torchvision selon JP7.0

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu130

Installer onnxruntime-gpu

L'argument onnxruntime-gpu package hébergé dans PyPI n'a pas aarch64 binaires pour le Jetson. Nous devons donc installer ce paquet manuellement. Ce paquet est nécessaire pour certaines des exportations.

Ici, nous allons télécharger et installer onnxruntime-gpu 1.24.0 avec Python3.12 support.

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.24.0-cp312-cp312-linux_aarch64.whl

Exécuter sur JetPack 6.1

Installer le paquet Ultralytics

Ici, nous allons installer le package Ultralytics sur le Jetson avec les dépendances optionnelles afin de pouvoir exporter les modèles PyTorch vers d'autres formats différents. Nous nous concentrerons principalement sur les exportations NVIDIA TensorRT car TensorRT nous permettra d'obtenir les performances maximales des appareils Jetson.

Mettre à jour la liste des paquets, installer pip et mettre à niveau vers la dernière version

sudo apt update sudo apt install python3-pip -y pip install -U pipInstaller

ultralyticsPaquet pip avec des dépendances optionnellespip install ultralytics[export]Redémarrez l'appareil

sudo reboot

Installer PyTorch et Torchvision

L'installation Ultralytics ci-dessus installera Torch et Torchvision. Cependant, ces deux packages installés via pip ne sont pas compatibles avec la plateforme Jetson, qui est basée sur l'architecture ARM64. Par conséquent, nous devons installer manuellement une roue pip PyTorch pré-construite et compiler ou installer Torchvision à partir de la source.

Installer torch 2.10.0 et torchvision 0.25.0 conformément à JP6.1

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.10.0-cp310-cp310-linux_aarch64.whl

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.25.0-cp310-cp310-linux_aarch64.whl

Remarque

Consultez la page PyTorch pour Jetson pour accéder à toutes les différentes versions de PyTorch pour différentes versions de JetPack. Pour une liste plus détaillée sur la compatibilité de PyTorch, Torchvision, consultez la page de compatibilité PyTorch et Torchvision.

Installer cuDSS pour corriger un problème de dépendance avec torch 2.10.0

wget https://developer.download.nvidia.com/compute/cudss/0.7.1/local_installers/cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo dpkg -i cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo cp /var/cudss-local-tegra-repo-ubuntu2204-0.7.1/cudss-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cudss

Installer onnxruntime-gpu

L'argument onnxruntime-gpu package hébergé dans PyPI n'a pas aarch64 binaires pour le Jetson. Nous devons donc installer ce paquet manuellement. Ce paquet est nécessaire pour certaines des exportations.

Vous pouvez trouver tous les onnxruntime-gpu packages, organisés par version de JetPack, version de Python et autres détails de compatibilité, dans le Matrice de compatibilité Jetson Zoo ONNX Runtime.

Pour JetPack 6 avec Python 3.10 support, vous pouvez installer onnxruntime-gpu 1.23.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.23.0-cp310-cp310-linux_aarch64.whl

Alternativement, pour onnxruntime-gpu 1.20.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.20.0-cp310-cp310-linux_aarch64.whl

Exécuter sur JetPack 5.1.2

Installer le paquet Ultralytics

Ici, nous allons installer le package Ultralytics sur le Jetson avec les dépendances optionnelles afin de pouvoir exporter les modèles PyTorch vers d'autres formats différents. Nous nous concentrerons principalement sur les exportations NVIDIA TensorRT car TensorRT nous permettra d'obtenir les performances maximales des appareils Jetson.

Mettre à jour la liste des paquets, installer pip et mettre à niveau vers la dernière version

sudo apt update sudo apt install python3-pip -y pip install -U pipInstaller

ultralyticsPaquet pip avec des dépendances optionnellespip install ultralytics[export]Redémarrez l'appareil

sudo reboot

Installer PyTorch et Torchvision

L'installation Ultralytics ci-dessus installera Torch et Torchvision. Cependant, ces deux packages installés via pip ne sont pas compatibles avec la plateforme Jetson, qui est basée sur l'architecture ARM64. Par conséquent, nous devons installer manuellement une roue pip PyTorch pré-construite et compiler ou installer Torchvision à partir de la source.

Désinstaller PyTorch et Torchvision actuellement installés

pip uninstall torch torchvisionInstaller

torch 2.1.0ettorchvision 0.16.2conformément à JP5.1.2pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.1.0a0+41361538.nv23.06-cp38-cp38-linux_aarch64.whl pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.16.2+c6f3977-cp38-cp38-linux_aarch64.whl

Remarque

Consultez la page PyTorch pour Jetson pour accéder à toutes les différentes versions de PyTorch pour différentes versions de JetPack. Pour une liste plus détaillée sur la compatibilité de PyTorch, Torchvision, consultez la page de compatibilité PyTorch et Torchvision.

Installer onnxruntime-gpu

L'argument onnxruntime-gpu package hébergé dans PyPI n'a pas aarch64 binaires pour le Jetson. Nous devons donc installer ce paquet manuellement. Ce paquet est nécessaire pour certaines des exportations.

Vous pouvez trouver tous les onnxruntime-gpu packages, organisés par version de JetPack, version de Python et autres détails de compatibilité, dans le Matrice de compatibilité Jetson Zoo ONNX Runtime. Ici, nous allons télécharger et installer onnxruntime-gpu 1.17.0 avec Python3.8 support.

wget https://nvidia.box.com/shared/static/zostg6agm00fb6t5uisw51qi6kpcuwzd.whl -O onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

pip install onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

Remarque

onnxruntime-gpu restaurera automatiquement la version numpy à la dernière version. Nous devons donc réinstaller numpy pour 1.23.5 pour résoudre un problème en exécutant :

pip install numpy==1.23.5

Utiliser TensorRT sur NVIDIA Jetson

Parmi tous les formats d’exportation de modèles pris en charge par Ultralytics, TensorRT offre les meilleures performances d’inférence sur les appareils NVIDIA Jetson, ce qui en fait notre principale recommandation pour les déploiements Jetson. Pour obtenir des instructions de configuration et une utilisation avancée, consultez notre guide d’intégration TensorRT dédié.

Convertir le modèle en TensorRT et exécuter l'inférence

Le modèle YOLO26n au format PyTorch est converti en TensorRT pour exécuter l'inférence avec le modèle exporté.

Exemple

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT

model.export(format="engine") # creates 'yolo26n.engine'

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format

yolo export model=yolo26n.pt format=engine # creates 'yolo26n.engine'

# Run inference with the exported model

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Remarque

Consultez la page d’exportation pour accéder à des arguments supplémentaires lors de l’exportation de modèles vers différents formats de modèles.

Utiliser NVIDIA Deep Learning Accelerator (DLA)

NVIDIA Deep Learning Accelerator (DLA) est un composant matériel spécialisé intégré aux appareils NVIDIA Jetson qui optimise l'inférence du deep learning pour l'efficacité énergétique et la performance. En déchargeant les tâches du GPU (le libérant pour des processus plus intensifs), DLA permet aux modèles de fonctionner avec une consommation d'énergie plus faible tout en maintenant un débit élevé, idéal pour les systèmes embarqués et les applications d'IA en temps réel.

Les appareils Jetson suivants sont équipés du matériel DLA :

| Périphérique Jetson | Cœurs DLA | Fréquence maximale DLA |

|---|---|---|

| Série Jetson AGX Orin | 2 | 1.6 GHz |

| Jetson Orin NX 16 Go | 2 | 614 MHz |

| Jetson Orin NX 8GB | 1 | 614 MHz |

| Série Jetson AGX Xavier | 2 | 1.4 GHz |

| Série Jetson Xavier NX | 2 | 1.1 GHz |

Exemple

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT with DLA enabled (only works with FP16 or INT8)

model.export(format="engine", device="dla:0", half=True) # dla:0 or dla:1 corresponds to the DLA cores

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format with DLA enabled (only works with FP16 or INT8)

# Once DLA core number is specified at export, it will use the same core at inference

yolo export model=yolo26n.pt format=engine device="dla:0" half=True # dla:0 or dla:1 corresponds to the DLA cores

# Run inference with the exported model on the DLA

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Remarque

Lors de l'utilisation des exportations DLA, certaines couches peuvent ne pas être prises en charge pour s'exécuter sur DLA et reviendront au GPU pour l'exécution. Ce repli peut introduire une latence supplémentaire et avoir un impact sur les performances globales de l'inférence. Par conséquent, DLA n'est pas principalement conçu pour réduire la latence d'inférence par rapport à TensorRT s'exécutant entièrement sur le GPU. Au lieu de cela, son objectif principal est d'augmenter le débit et d'améliorer l'efficacité énergétique.

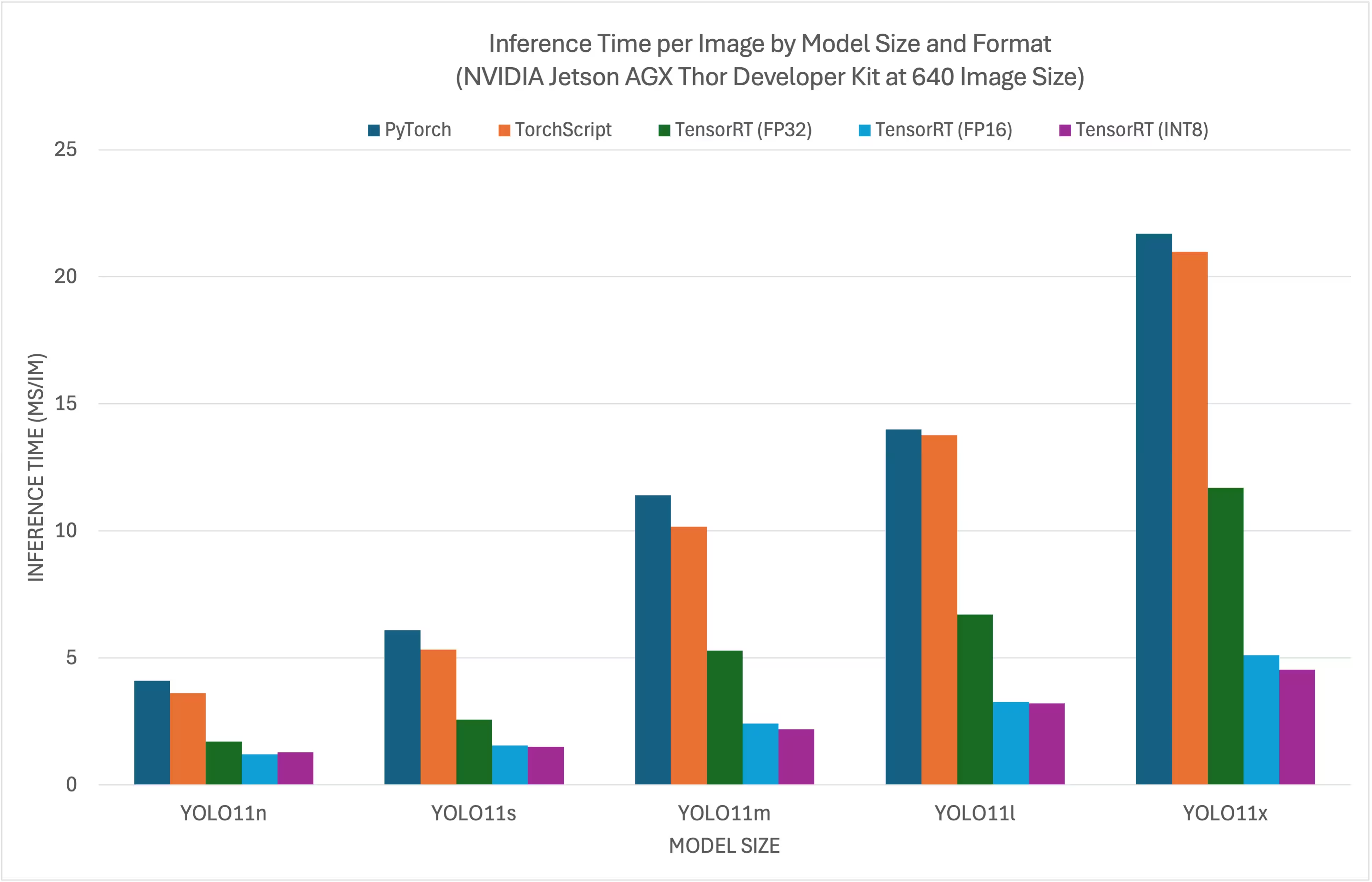

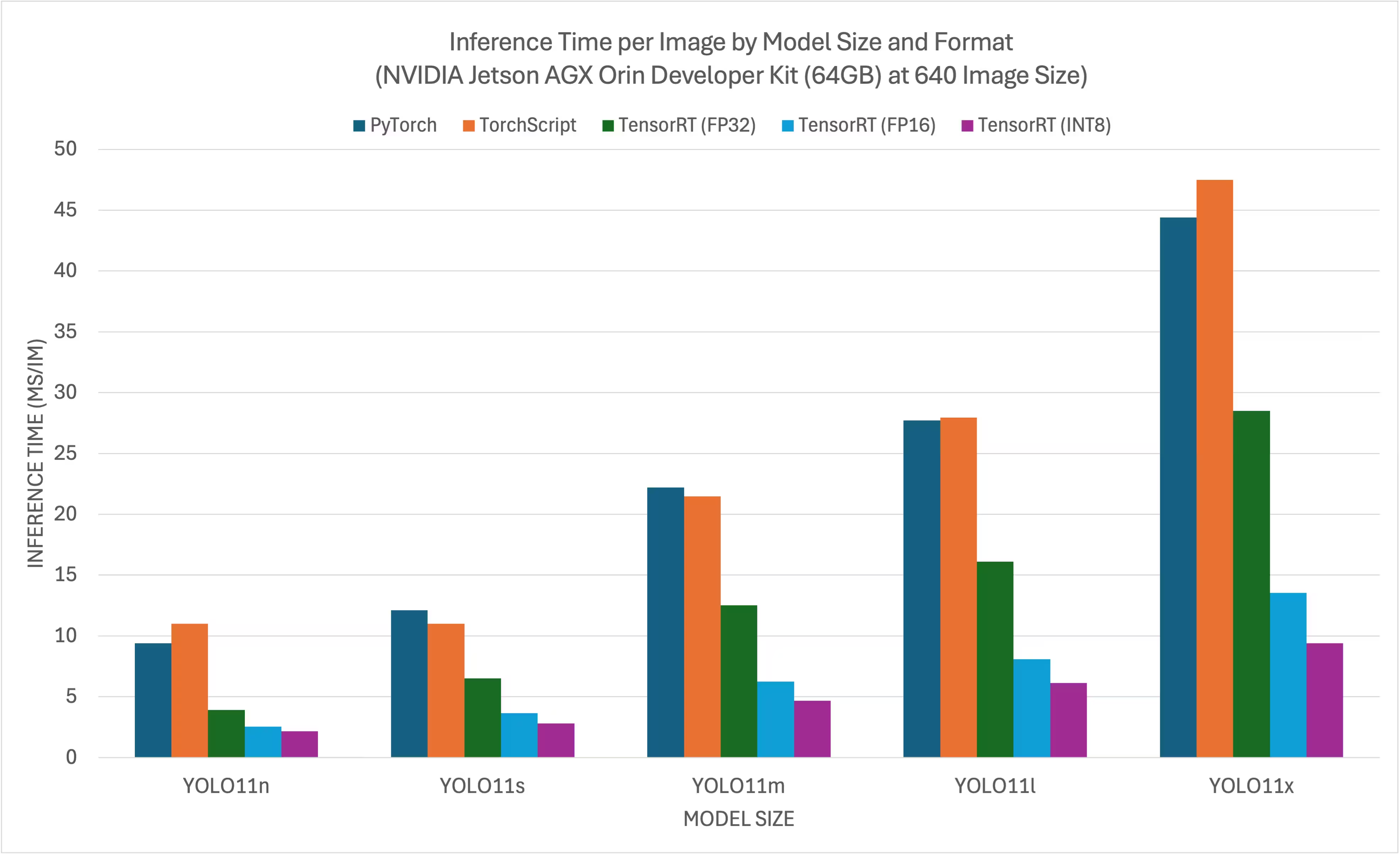

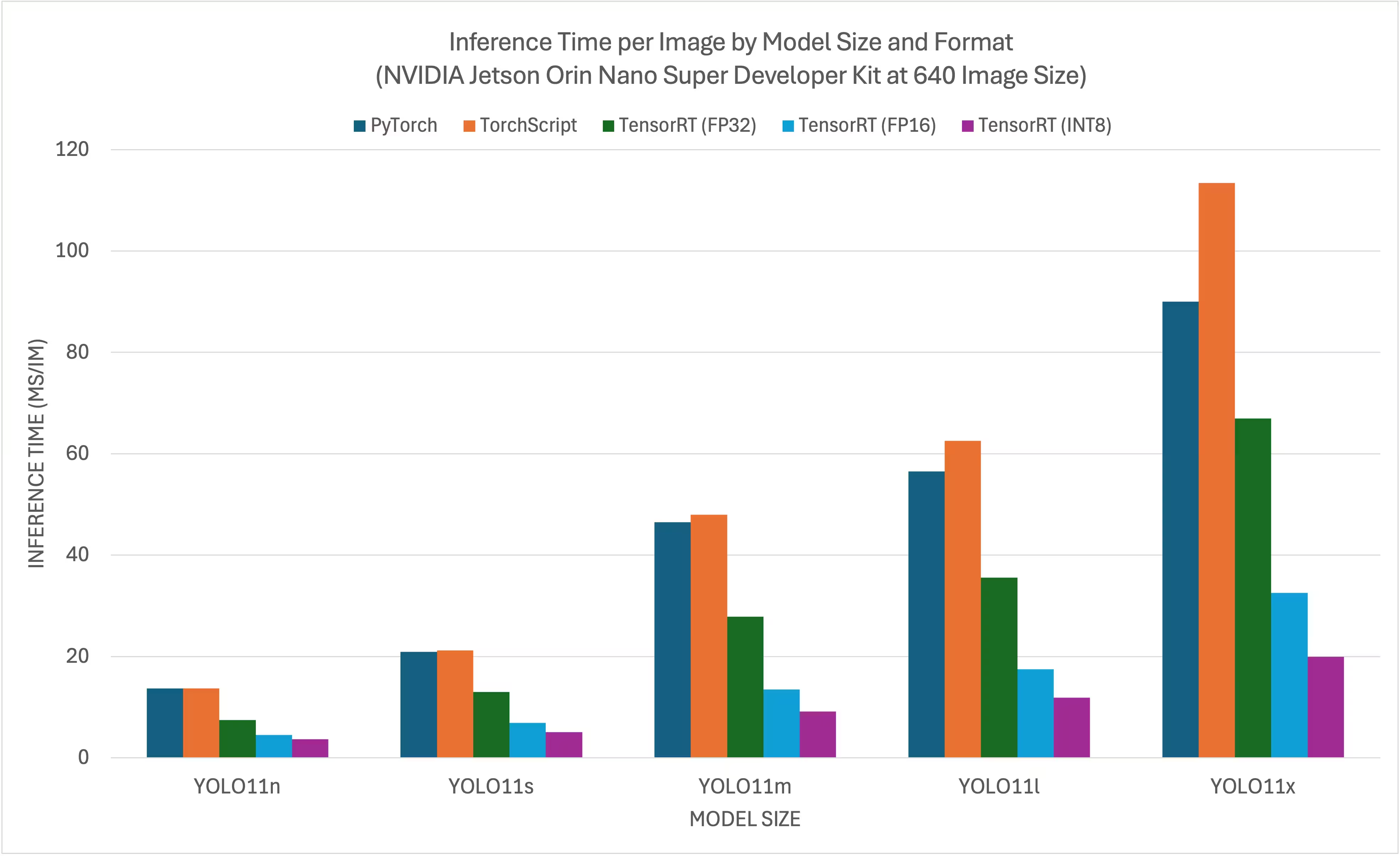

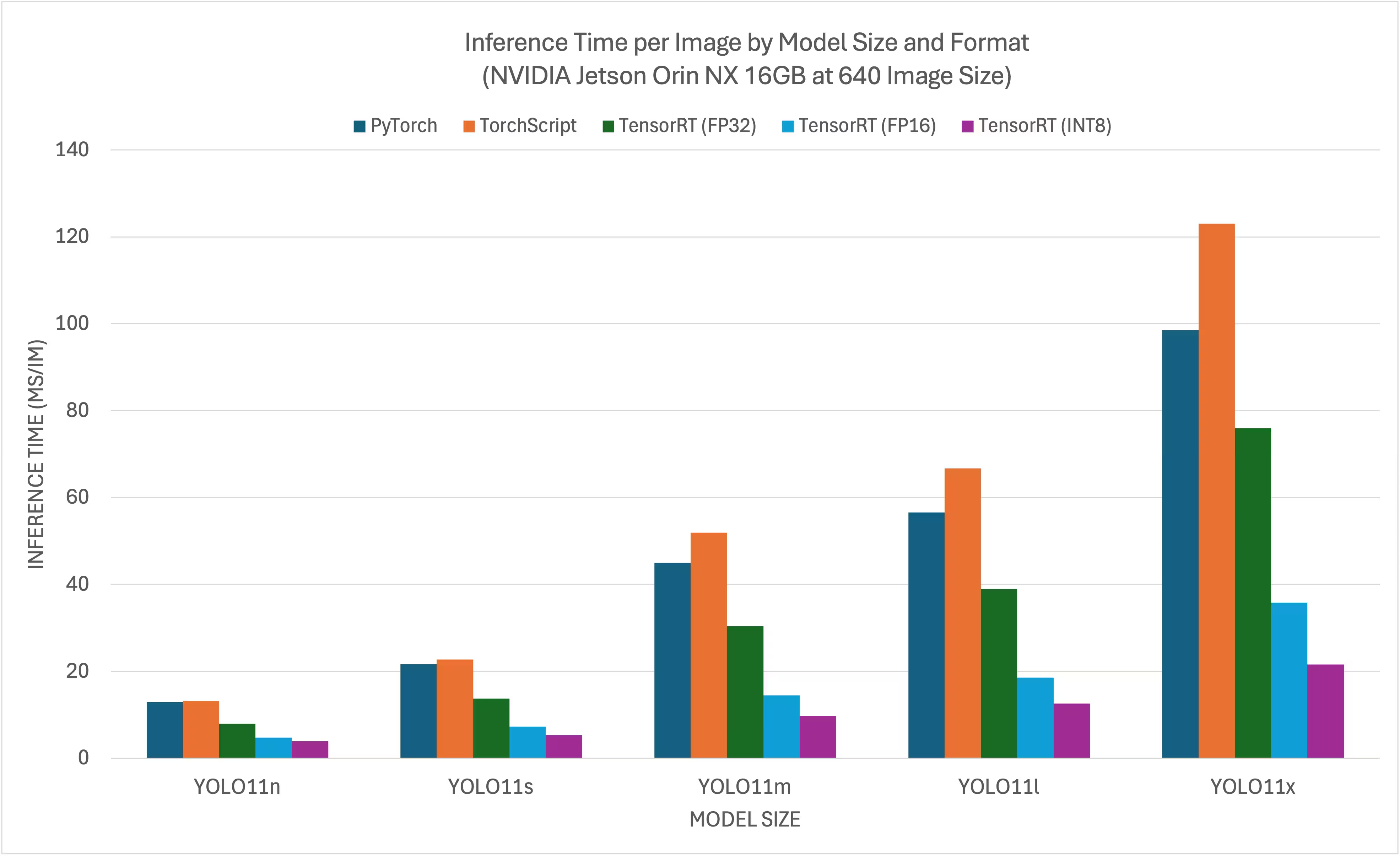

Benchmarks NVIDIA YOLO11 YOLO26

Les benchmarks YOLO11 ont été exécutés par Ultralytics sur 11 formats de modèles différents afin de mesurer la vitesse et la précision: PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF , MNN, NCNN, ExecuTorch. Les benchmarks ont été exécutés sur le kit de développement NVIDIA AGX Thor, le kit de développement NVIDIA AGX Orin (64 Go), le kit de développement NVIDIA Orin Nano Super et le Seeed Studio reComputer J4012 équipé d'un dispositif Jetson Orin NX 16 Go avec une précision FP32 et une taille d'image d'entrée par défaut de 640.

Tableaux comparatifs

Même si toutes les exportations de modèles fonctionnent sur NVIDIA Jetson, nous n'avons inclus que PyTorch, TorchScript, TensorRT dans le tableau comparatif ci-dessous, car ils exploitent le GPU du Jetson et garantissent les meilleurs résultats. Toutes les autres exportations n'utilisent que le CPU et leurs performances ne sont pas aussi bonnes que celles des trois précédentes. Vous trouverez les benchmarks de toutes les exportations dans la section suivant ce tableau.

Kit de développement NVIDIA Jetson AGX Thor

Kit de développement NVIDIA Jetson AGX Orin (64 Go)

Kit de super développement NVIDIA Jetson Orin Nano

NVIDIA Jetson Orin NX 16GB

Tableaux comparatifs détaillés

Le tableau ci-dessous représente les résultats de benchmark pour cinq modèles différents (YOLO11n, YOLO11s, YOLO11m, YOLO11l, YOLO11x) dans 11 formats différents (PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch), nous donnant l'état, la taille, la métrique mAP50-95(B) et le temps d'inférence pour chaque combinaison.

Kit de développement NVIDIA Jetson AGX Thor

Performance

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4798 | 7.39 |

| TorchScript | ✅ | 9.8 | 0.4789 | 4.21 |

| ONNX | ✅ | 9.5 | 0.4767 | 6.58 |

| OpenVINO | ✅ | 10.1 | 0.4794 | 17.50 |

| TensorRT (FP32) | ✅ | 13.9 | 0.4791 | 1.90 |

| TensorRT (FP16) | ✅ | 7.6 | 0.4797 | 1.39 |

| TensorRT (INT8) | ✅ | 6.5 | 0.4273 | 1.52 |

| TF SavedModel | ✅ | 25.7 | 0.4764 | 47.24 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 45.98 |

| TF Lite | ✅ | 9.9 | 0.4764 | 182.04 |

| MNN | ✅ | 9.4 | 0.4784 | 21.83 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 7.99 |

| TorchScript | ✅ | 36.8 | 0.5664 | 6.01 |

| ONNX | ✅ | 36.5 | 0.5666 | 9.31 |

| OpenVINO | ✅ | 38.5 | 0.5656 | 35.56 |

| TensorRT (FP32) | ✅ | 38.9 | 0.5664 | 2.95 |

| TensorRT (FP16) | ✅ | 21.0 | 0.5650 | 1.77 |

| TensorRT (INT8) | ✅ | 13.5 | 0.5010 | 1.75 |

| TF SavedModel | ✅ | 96.6 | 0.5665 | 88.87 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 89.20 |

| TF Lite | ✅ | 36.9 | 0.5665 | 604.25 |

| MNN | ✅ | 36.4 | 0.5651 | 53.75 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 10.76 |

| TorchScript | ✅ | 78.5 | 0.6217 | 10.57 |

| ONNX | ✅ | 78.2 | 0.6211 | 14.91 |

| OpenVINO | ✅ | 82.2 | 0.6204 | 86.27 |

| TensorRT (FP32) | ✅ | 82.2 | 0.6230 | 5.56 |

| TensorRT (FP16) | ✅ | 41.6 | 0.6209 | 2.58 |

| TensorRT (INT8) | ✅ | 24.3 | 0.5595 | 2.49 |

| TF SavedModel | ✅ | 205.8 | 0.6229 | 200.96 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 203.00 |

| TF Lite | ✅ | 78.6 | 0.6229 | 1867.12 |

| MNN | ✅ | 78.0 | 0.6176 | 142.00 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 13.34 |

| TorchScript | ✅ | 95.5 | 0.6248 | 13.86 |

| ONNX | ✅ | 95.0 | 0.6247 | 18.44 |

| OpenVINO | ✅ | 99.9 | 0.6238 | 106.67 |

| TensorRT (FP32) | ✅ | 99.0 | 0.6249 | 6.74 |

| TensorRT (FP16) | ✅ | 50.3 | 0.6243 | 3.34 |

| TensorRT (INT8) | ✅ | 29.0 | 0.5708 | 3.24 |

| TF SavedModel | ✅ | 250.0 | 0.6245 | 259.74 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 263.42 |

| TF Lite | ✅ | 95.4 | 0.6245 | 2367.83 |

| MNN | ✅ | 94.8 | 0.6272 | 174.39 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6565 | 20.92 |

| TorchScript | ✅ | 213.5 | 0.6595 | 21.76 |

| ONNX | ✅ | 212.9 | 0.6590 | 26.72 |

| OpenVINO | ✅ | 223.6 | 0.6620 | 205.27 |

| TensorRT (FP32) | ✅ | 217.2 | 0.6593 | 12.29 |

| TensorRT (FP16) | ✅ | 112.1 | 0.6611 | 5.16 |

| TensorRT (INT8) | ✅ | 58.9 | 0.5222 | 4.72 |

| TF SavedModel | ✅ | 559.2 | 0.6593 | 498.85 |

| TF GraphDef | ✅ | 213.0 | 0.6593 | 507.43 |

| TF Lite | ✅ | 213.3 | 0.6593 | 5134.22 |

| MNN | ✅ | 212.8 | 0.6625 | 347.84 |

Évalué avec Ultralytics 8.4.7

Remarque

Le temps d'inférence n'inclut pas le prétraitement ni le post-traitement.

Kit de développement NVIDIA Jetson AGX Orin (64 Go)

Performance

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 11.58 |

| TorchScript | ✅ | 9.8 | 0.4770 | 4.60 |

| ONNX | ✅ | 9.5 | 0.4770 | 9.87 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 28.80 |

| TensorRT (FP32) | ✅ | 11.5 | 0.0450 | 4.18 |

| TensorRT (FP16) | ✅ | 7.9 | 0.0450 | 2.62 |

| TensorRT (INT8) | ✅ | 5.4 | 0.4640 | 2.30 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 71.10 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 70.02 |

| TF Lite | ✅ | 9.9 | 0.4760 | 227.94 |

| MNN | ✅ | 9.4 | 0.4760 | 32.46 |

| NCNN | ✅ | 9.3 | 0.4810 | 29.93 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 13.18 |

| TorchScript | ✅ | 36.8 | 0.5670 | 11.48 |

| ONNX | ✅ | 36.5 | 0.5660 | 13.47 |

| OpenVINO | ✅ | 36.7 | 0.5650 | 58.30 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5660 | 6.82 |

| TensorRT (FP16) | ✅ | 21.9 | 0.5660 | 3.76 |

| TensorRT (INT8) | ✅ | 12.5 | 0.5480 | 2.98 |

| TF SavedModel | ✅ | 92.2 | 0.5660 | 145.62 |

| TF GraphDef | ✅ | 36.5 | 0.5660 | 146.26 |

| TF Lite | ✅ | 36.9 | 0.5660 | 753.52 |

| MNN | ✅ | 36.4 | 0.5650 | 79.50 |

| NCNN | ✅ | 36.4 | 0.5700 | 58.73 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 19.36 |

| TorchScript | ✅ | 78.5 | 0.6230 | 20.02 |

| ONNX | ✅ | 78.2 | 0.6230 | 25.40 |

| OpenVINO | ✅ | 78.3 | 0.6190 | 130.76 |

| TensorRT (FP32) | ✅ | 80.2 | 0.6220 | 12.60 |

| TensorRT (FP16) | ✅ | 42.5 | 0.6220 | 6.24 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5820 | 4.72 |

| TF SavedModel | ✅ | 196.3 | 0.6230 | 306.76 |

| TF GraphDef | ✅ | 78.2 | 0.6230 | 314.23 |

| TF Lite | ✅ | 78.5 | 0.6230 | 2331.63 |

| MNN | ✅ | 78.0 | 0.6220 | 206.93 |

| NCNN | ✅ | 78.0 | 0.6220 | 143.03 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 23.53 |

| TorchScript | ✅ | 95.5 | 0.6250 | 24.23 |

| ONNX | ✅ | 95.0 | 0.6250 | 31.73 |

| OpenVINO | ✅ | 95.3 | 0.6240 | 162.80 |

| TensorRT (FP32) | ✅ | 97.3 | 0.6250 | 15.90 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6240 | 7.93 |

| TensorRT (INT8) | ✅ | 29.9 | 0.5920 | 5.97 |

| TF SavedModel | ✅ | 238.4 | 0.6250 | 394.30 |

| TF GraphDef | ✅ | 95.0 | 0.6250 | 398.63 |

| TF Lite | ✅ | 95.4 | 0.6250 | 2925.27 |

| MNN | ✅ | 94.8 | 0.6250 | 255.87 |

| NCNN | ✅ | 94.8 | 0.6320 | 177.70 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 114 | 0.6610 | 38.37 |

| TorchScript | ✅ | 213.5 | 0.6590 | 41.23 |

| ONNX | ✅ | 212.9 | 0.6590 | 52.03 |

| OpenVINO | ✅ | 213.2 | 0.6590 | 300.40 |

| TensorRT (FP32) | ✅ | 215.2 | 0.6590 | 28.43 |

| TensorRT (FP16) | ✅ | 110.3 | 0.6570 | 13.50 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6080 | 9.33 |

| TF SavedModel | ✅ | 533.3 | 0.6590 | 738.60 |

| TF GraphDef | ✅ | 212.9 | 0.6590 | 785.70 |

| TF Lite | ✅ | 217.6 | 0.6900 | 6476.80 |

| MNN | ✅ | 213.3 | 0.6590 | 519.77 |

| NCNN | ✅ | 212.8 | 0.6670 | 300.00 |

Test de performance réalisé avec Ultralytics .4.32

Remarque

Le temps d'inférence n'inclut pas le prétraitement ni le post-traitement.

Kit de super développement NVIDIA Jetson Orin Nano

Performance

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 15.60 |

| TorchScript | ✅ | 9.8 | 0.4770 | 12.60 |

| ONNX | ✅ | 9.5 | 0.4760 | 15.76 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 56.23 |

| TensorRT (FP32) | ✅ | 11.3 | 0.4770 | 7.53 |

| TensorRT (FP16) | ✅ | 8.1 | 0.4800 | 4.57 |

| TensorRT (INT8) | ✅ | 5.3 | 0.4490 | 3.80 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 118.33 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 116.30 |

| TF Lite | ✅ | 9.9 | 0.4760 | 286.00 |

| MNN | ✅ | 9.4 | 0.4760 | 68.77 |

| NCNN | ✅ | 9.3 | 0.4810 | 47.50 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 22.83 |

| TorchScript | ✅ | 36.8 | 0.5670 | 21.83 |

| ONNX | ✅ | 36.5 | 0.5664 | 26.29 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 127.09 |

| TensorRT (FP32) | ✅ | 38.2 | 0.5664 | 13.60 |

| TensorRT (FP16) | ✅ | 21.3 | 0.5649 | 7.17 |

| TensorRT (INT8) | ✅ | 12.7 | 0.5468 | 5.25 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 263.69 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 268.21 |

| TF Lite | ✅ | 36.9 | 0.5665 | 949.63 |

| MNN | ✅ | 36.4 | 0.5644 | 184.68 |

| NCNN | ✅ | 36.4 | 0.5697 | 107.48 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 44.43 |

| TorchScript | ✅ | 78.5 | 0.6230 | 44.00 |

| ONNX | ✅ | 78.2 | 0.6225 | 53.44 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 303.26 |

| TensorRT (FP32) | ✅ | 80.0 | 0.6217 | 28.19 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 13.59 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 9.30 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 636.03 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 659.57 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2905.17 |

| MNN | ✅ | 78.0 | 0.6168 | 500.09 |

| NCNN | ✅ | 78.0 | 0.6224 | 332.39 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 60.97 |

| TorchScript | ✅ | 95.5 | 0.6250 | 56.20 |

| ONNX | ✅ | 95.0 | 0.6247 | 68.12 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 397.84 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 35.88 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 17.42 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 11.83 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 835.83 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 852.16 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3650.85 |

| MNN | ✅ | 94.8 | 0.6257 | 612.37 |

| NCNN | ✅ | 94.8 | 0.6323 | 405.45 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 98.44 |

| TorchScript | ✅ | 214.0 | 0.6593 | 98.0 |

| ONNX | ✅ | 212.9 | 0.6595 | 122.43 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 760.72 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 67.17 |

| TensorRT (FP16) | ✅ | 110.2 | 0.6637 | 32.60 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6170 | 19.99 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1647.06 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1670.30 |

| TF Lite | ✅ | 213.3 | 0.6590 | 8066.30 |

| MNN | ✅ | 212.8 | 0.6600 | 1227.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 782.24 |

Test de performance réalisé avec Ultralytics .4.33

Remarque

Le temps d'inférence n'inclut pas le prétraitement ni le post-traitement.

NVIDIA Jetson Orin NX 16GB

Performance

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4799 | 13.90 |

| TorchScript | ✅ | 9.8 | 0.4787 | 11.60 |

| ONNX | ✅ | 9.5 | 0.4763 | 14.18 |

| OpenVINO | ✅ | 9.6 | 0.4819 | 40.19 |

| TensorRT (FP32) | ✅ | 11.4 | 0.4770 | 7.01 |

| TensorRT (FP16) | ✅ | 8.0 | 0.4789 | 4.13 |

| TensorRT (INT8) | ✅ | 5.5 | 0.4489 | 3.49 |

| TF SavedModel | ✅ | 24.6 | 0.4764 | 92.34 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 92.06 |

| TF Lite | ✅ | 9.9 | 0.4764 | 254.43 |

| MNN | ✅ | 9.4 | 0.4760 | 48.55 |

| NCNN | ✅ | 9.3 | 0.4805 | 34.31 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 20.40 |

| TorchScript | ✅ | 36.8 | 0.5664 | 19.20 |

| ONNX | ✅ | 36.5 | 0.5664 | 24.35 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 88.18 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5664 | 12.62 |

| TensorRT (FP16) | ✅ | 21.5 | 0.5652 | 6.41 |

| TensorRT (INT8) | ✅ | 12.6 | 0.5468 | 4.78 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 195.16 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 197.57 |

| TF Lite | ✅ | 36.9 | 0.5665 | 827.48 |

| MNN | ✅ | 36.4 | 0.5649 | 123.47 |

| NCNN | ✅ | 36.4 | 0.5697 | 74.04 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 38.60 |

| TorchScript | ✅ | 78.5 | 0.6227 | 40.50 |

| ONNX | ✅ | 78.2 | 0.6225 | 48.87 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 205.69 |

| TensorRT (FP32) | ✅ | 80.1 | 0.6217 | 24.69 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 11.66 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 8.22 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 451.48 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 460.94 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2555.53 |

| MNN | ✅ | 78.0 | 0.6217 | 333.33 |

| NCNN | ✅ | 78.0 | 0.6224 | 214.60 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 48.60 |

| TorchScript | ✅ | 95.5 | 0.6249 | 51.60 |

| ONNX | ✅ | 95.0 | 0.6247 | 61.95 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 272.47 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 31.64 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 14.77 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 10.49 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 596.46 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 606.10 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3275.55 |

| MNN | ✅ | 94.8 | 0.6247 | 408.15 |

| NCNN | ✅ | 94.8 | 0.6323 | 262.99 |

| Format | Statut | Taille sur le disque (Mo) | mAP50-95(B) | Temps d'inférence (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 84.40 |

| TorchScript | ✅ | 213.5 | 0.6594 | 91.20 |

| ONNX | ✅ | 212.9 | 0.6595 | 109.34 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 520.88 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 57.18 |

| TensorRT (FP16) | ✅ | 109.7 | 0.6632 | 26.76 |

| TensorRT (INT8) | ✅ | 60.0 | 0.6170 | 17.32 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1170.50 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1217.87 |

| TF Lite | ✅ | 213.3 | 0.6593 | 7247.11 |

| MNN | ✅ | 212.8 | 0.6591 | 820.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 534.30 |

Test de performance réalisé avec Ultralytics .4.33

Remarque

Le temps d'inférence n'inclut pas le prétraitement ni le post-traitement.

Explorez d'autres efforts de benchmarking de Seeed Studio s'exécutant sur différentes versions du matériel NVIDIA Jetson.

Reproduire nos résultats

Pour reproduire les benchmarks Ultralytics ci-dessus sur tous les formats d’exportation, exécutez ce code :

Exemple

from ultralytics import YOLO

# Load a YOLO11n PyTorch model

model = YOLO("yolo11n.pt")

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

results = model.benchmark(data="coco128.yaml", imgsz=640)

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

yolo benchmark model=yolo11n.pt data=coco128.yaml imgsz=640

Notez que les résultats de benchmarking peuvent varier en fonction de la configuration matérielle et logicielle exacte d'un système, ainsi que de la charge de travail actuelle du système au moment de l'exécution des benchmarks. Pour les résultats les plus fiables, utilisez un jeu de données avec un grand nombre d'images, par exemple, data='coco.yaml' (5000 images de validation).

Meilleures pratiques lors de l'utilisation de NVIDIA Jetson

Lors de l'utilisation de NVIDIA Jetson, il y a quelques bonnes pratiques à suivre afin d'obtenir des performances maximales sur le NVIDIA Jetson exécutant YOLO26.

Activer le mode de puissance MAX

L'activation du mode de puissance MAX sur le Jetson permettra de s'assurer que tous les cœurs du CPU et du GPU sont activés.

sudo nvpmodel -m 0Activer les horloges Jetson

L'activation des horloges Jetson garantira que tous les cœurs CPU et GPU sont cadencés à leur fréquence maximale.

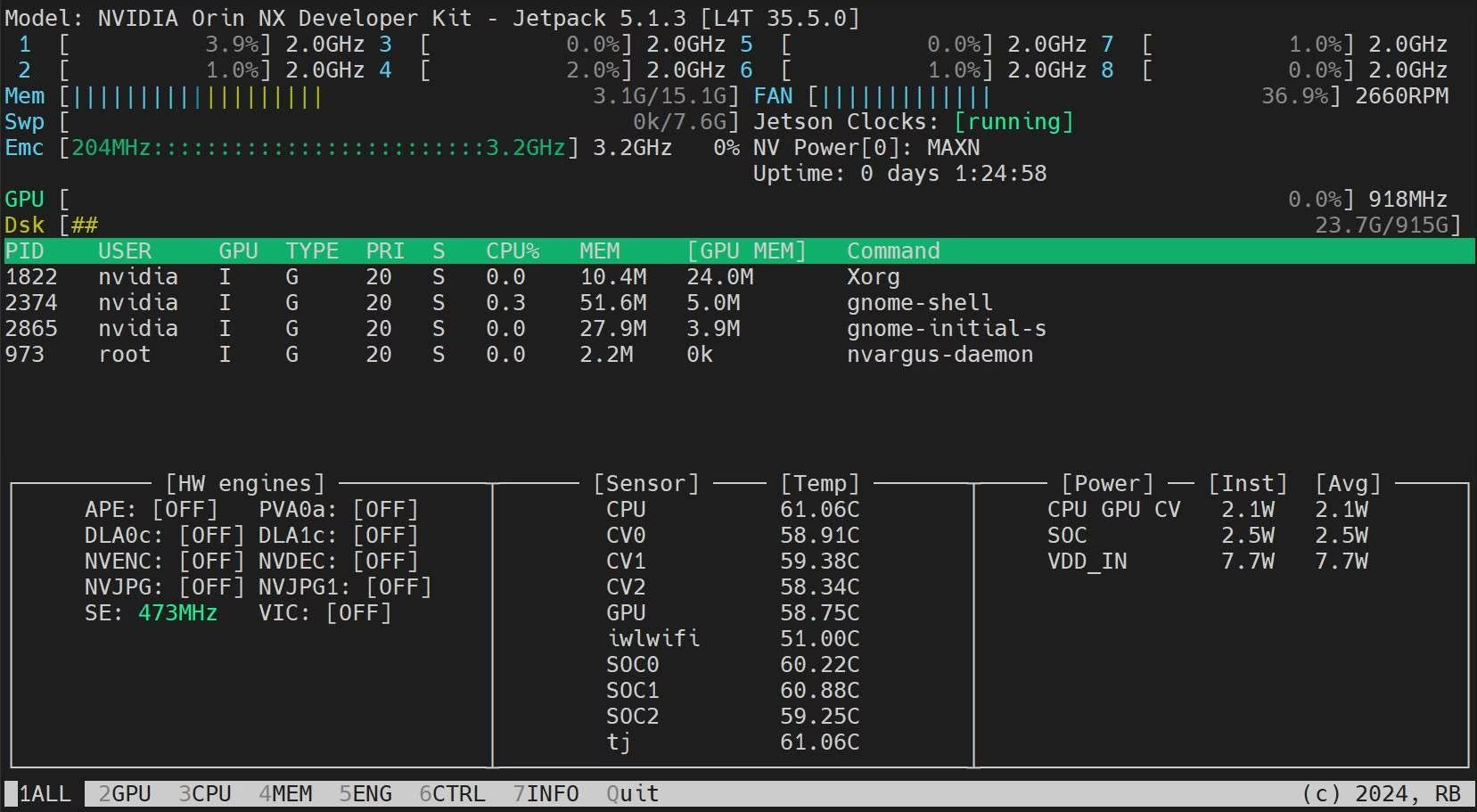

sudo jetson_clocksInstaller l’application Jetson Stats

Nous pouvons utiliser l'application jetson stats pour surveiller les températures des composants du système et vérifier d'autres détails du système tels que l'utilisation du CPU, du GPU, de la RAM, modifier les modes d'alimentation, régler les horloges au maximum, vérifier les informations de JetPack.

sudo apt update sudo pip install jetson-stats sudo reboot jtop

Conseils d'optimisation de la mémoire pour NVIDIA

La mémoire disponible constitue souvent le facteur limitant sur les appareils Jetson, en particulier sur les modèles dotés d'une mémoire réduite, tels que le Jetson Orin Nano (8 Go) ou l'Orin NX 8 Go. Les conseils ci-dessous constituent des modifications pratiques et peu risquées qui, mises en œuvre conjointement, peuvent libérer plusieurs centaines de mégaoctets et vous permettre d'exécuter YOLO plus volumineux ou de prendre en charge des charges de travail parallèles supplémentaires. Pour une analyse approfondie, consultez l'article NVIDIA consacré à l'optimisation de l'efficacité de la mémoire sur les appareils Jetson.

1. Passer au démarrage sans interface graphique (Headless)

Si votre Jetson est connecté via SSH ou fonctionne en tant qu'appareil de production sans écran connecté, la suppression de l'environnement de bureau et du serveur d'affichage peut permettre de récupérer jusqu'à 865 Mo de RAM :

sudo systemctl set-default multi-user.target

sudo reboot

Pour restaurer le bureau ultérieurement :

sudo systemctl set-default graphical.target

sudo reboot

2. Désactiver les services système inutilisés

Les services d'arrière-plan non essentiels (Bluetooth, gestionnaires de connectivité, démons matériels inutilisés) consomment environ 32 Mo au total. Répertoriez les services actifs et désactivez tous ceux dont votre déploiement n'a pas besoin :

# List running services

systemctl list-units --type=service --state=running

# Disable a service

sudo systemctl disable <service-name>

3. Utilisation de la mémoire par les profils

Avant de procéder à l'optimisation, identifiez les processus qui consomment réellement de la mémoire vive. procrank trie les processus selon le PSS (Proportional Set Size), qui reflète plus fidèlement l'empreinte mémoire réelle de chaque processus que le RSS (Resident Set Size, soit le nombre total de pages de mémoire physique mappées par un processus, y compris les pages partagées avec d'autres processus) :

git clone https://github.com/csimmonds/procrank_linux.git

cd procrank_linux && make

sudo ./procrank

Pour afficher les allocations de ressources GPU NvMap (pipelineCUDA) par processus :

sudo cat /sys/kernel/debug/nvmap/iovmm/clients

4. Exécuter Inference sans affichage en environnement de production

Pour les pipelines d'inférence qui ne nécessitent pas d'aperçu en temps réel, la désactivation des composants liés à l'affichage (Tiler, OSD, DisplaySink) peut permettre d'économiser plus de 200 Mo rien que sur le pipeline. Avec Ultralytics YOLO, désactivez la visionneuse et enregistrez plutôt les résultats sur le disque :

Exemple

from ultralytics import YOLO

model = YOLO("yolo11n.engine")

# show=False prevents any display window; save=True writes annotated output to disk

results = model.predict(source="video.mp4", show=False, save=True)

yolo predict model=yolo11n.engine source=video.mp4 show=False save=True

Impact cumulé

| Optimisation | Économie de mémoire (environ) |

|---|---|

| Désactiver l'interface graphique du bureau | environ 865 Mo |

| Désactiver les services du système d'exploitation inutilisés | environ 32 Mo |

| Pipeline d'inférence sans interface graphique (sans affichage) | ~200 Mo et plus |

| Total (gains faciles) | ~1 Go et plus |

La combinaison de ces modifications s'avère particulièrement utile lorsqu'on cible des modèles TensorRT sur des appareils à mémoire limitée : cela peut faire la différence entre pouvoir ou non faire tenir une variante de modèle plus volumineuse en mémoire.

Prochaines étapes

Pour plus d'informations et de support, consultez la documentation Ultralytics YOLO26.

FAQ

Comment déployer Ultralytics YOLO26 sur les appareils NVIDIA Jetson ?

Le déploiement d'Ultralytics YOLO26 sur les appareils NVIDIA Jetson est un processus simple. Tout d'abord, flashez votre appareil Jetson avec le SDK NVIDIA JetPack. Ensuite, utilisez une image Docker pré-construite pour une configuration rapide ou installez manuellement les paquets requis. Les étapes détaillées pour chaque approche se trouvent dans les sections Démarrage rapide avec Docker et Démarrage avec installation native.

Quels benchmarks de performance puis-je attendre des modèles YOLO11 sur les appareils NVIDIA Jetson ?

Les modèles YOLO11 ont été évalués sur divers appareils NVIDIA Jetson, ce qui a permis de constater des améliorations significatives en termes de performances. Par exemple, le format TensorRT offre les meilleures performances d'inférence. Le tableau de la section Tableaux de comparaison détaillés donne une vue d'ensemble des mesures de performance telles que mAP50-95 et le temps d'inférence pour différents formats de modèles.

Pourquoi devrais-je utiliser TensorRT pour déployer YOLO26 sur NVIDIA Jetson ?

TensorRT est fortement recommandé pour le déploiement de modèles YOLO26 sur NVIDIA Jetson en raison de ses performances optimales. Il accélère l'inférence en exploitant les capacités GPU du Jetson, garantissant une efficacité et une vitesse maximales. Apprenez-en davantage sur la conversion vers TensorRT et l'exécution de l'inférence dans la section Utiliser TensorRT sur NVIDIA Jetson.

Comment puis-je installer PyTorch et Torchvision sur NVIDIA Jetson ?

Pour installer PyTorch et Torchvision sur NVIDIA Jetson, désinstallez d'abord toutes les versions existantes qui ont pu être installées via pip. Ensuite, installez manuellement les versions compatibles de PyTorch et Torchvision pour l'architecture ARM64 de Jetson. Des instructions détaillées pour ce processus sont fournies dans la section Installer PyTorch et Torchvision.

Quelles sont les meilleures pratiques pour maximiser les performances sur NVIDIA Jetson lors de l'utilisation de YOLO26 ?

Pour maximiser les performances sur NVIDIA Jetson avec YOLO26, suivez ces meilleures pratiques :

- Activez le mode de puissance MAX pour utiliser tous les cœurs CPU et GPU.

- Activez les horloges Jetson pour exécuter tous les cœurs à leur fréquence maximale.

- Installer l'application Jetson Stats pour surveiller les métriques du système.

Pour les commandes et les détails supplémentaires, consultez la section Meilleures pratiques lors de l'utilisation de NVIDIA Jetson.

Comment libérer de la mémoire sur NVIDIA pour exécuter YOLO plus volumineux ?

La mémoire vive disponible constitue souvent un goulot d'étranglement sur les appareils Jetson dotés d'une mémoire limitée. Voici trois astuces simples qui, combinées, permettent de récupérer plus d'1 Go :

- Passer en mode de démarrage sans interface graphique (

sudo systemctl set-default multi-user.target) pour désactiver l'interface graphique du bureau (économie d'environ 865 Mo). - Désactivez les services inutilisés, tels que le Bluetooth ou les gestionnaires de connectivité (économie d'environ 32 Mo).

- Exécuter l'inférence sans affichage en réglant

show=Falsedans ton YOLOpredictappel, ce qui évite d'allouer de la mémoire au pipeline d'affichage (économie d'environ 200 Mo).

Utilisez procrank pour analyser l'utilisation de la mémoire vive par processus et sudo cat /sys/kernel/debug/nvmap/iovmm/clients pour vérifier GPU . Consultez le Conseils pour optimiser la mémoire Consultez cette section pour plus de détails.

Pourquoi l'exportation TensorRT désactive-t-elle le mode de bout en bout sur JetPack 6 ?

TensorRT .3.0, fourni avec JetPack 6, présente un problème connu qui empêche la compilation du moteur INT8 lorsque end2end=True est activée. Lorsque Ultralytics cette combinaison, il désactive automatiquement la branche end2end afin de garantir la réussite de l'exportation.

Pour rétablir les exportations INT8 de bout en bout, mettez à jour TensorRT une version plus récente (par exemple, 10.7.0 ou supérieure) :

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/arm64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get install -y tensorrt

Après la mise à jour, relancez votre exportation. Pour plus d'informations, consultez le ticket GitHub n° 23841.