Link to this sectionDataset Fashion-MNIST#

Il dataset Fashion-MNIST è un database di immagini di articoli di Zalando, composto da un set di addestramento di 60.000 esempi e un set di test di 10.000 esempi. Ogni esempio è un'immagine in scala di grigi 28x28, associata a un'etichetta appartenente a 10 classi. Fashion-MNIST è pensato per fungere da sostituto diretto del dataset MNIST originale per il benchmarking di algoritmi di machine learning.

Link to this sectionCaratteristiche principali#

- Fashion-MNIST contiene 60.000 immagini di addestramento e 10.000 immagini di test tratte dagli articoli di Zalando.

- Il dataset comprende immagini in scala di grigi di dimensioni 28x28 pixel.

- Ogni pixel ha un singolo valore associato che indica la sua luminosità o oscurità, dove numeri più alti indicano colori più scuri. Questo valore di pixel è un intero compreso tra 0 e 255.

- Fashion-MNIST è ampiamente utilizzato per l'addestramento e il testing nel campo del machine learning, specialmente per compiti di classificazione di immagini.

Link to this sectionStruttura del dataset#

Il dataset Fashion-MNIST è suddiviso in due sottoinsiemi:

- Training Set: questo sottoinsieme contiene 60.000 immagini utilizzate per addestrare modelli di machine learning.

- Testing Set: questo sottoinsieme consiste in 10.000 immagini utilizzate per testare e valutare i modelli addestrati.

Link to this sectionEtichette#

Ogni esempio di addestramento e di test è assegnato a una delle seguenti etichette:

0. T-shirt/top

1. Trouser

2. Pullover

3. Dress

4. Coat

5. Sandal

6. Shirt

7. Sneaker

8. Bag

9. Ankle bootLink to this sectionApplicazioni#

Il dataset Fashion-MNIST è ampiamente utilizzato per addestrare e valutare modelli di deep learning in compiti di classificazione di immagini, come Convolutional Neural Networks (CNN), Support Vector Machines (SVM) e vari altri algoritmi di machine learning. Il formato semplice e ben strutturato del dataset lo rende una risorsa essenziale per ricercatori e professionisti nel campo del machine learning e della computer vision.

Link to this sectionUtilizzo#

Per addestrare un modello CNN sul dataset Fashion-MNIST per 100 epoch con una dimensione immagine di 28x28, puoi utilizzare i seguenti frammenti di codice. Per un elenco completo degli argomenti disponibili, fai riferimento alla pagina Training del modello.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-cls.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="fashion-mnist", epochs=100, imgsz=28)Link to this sectionImmagini campione e annotazioni#

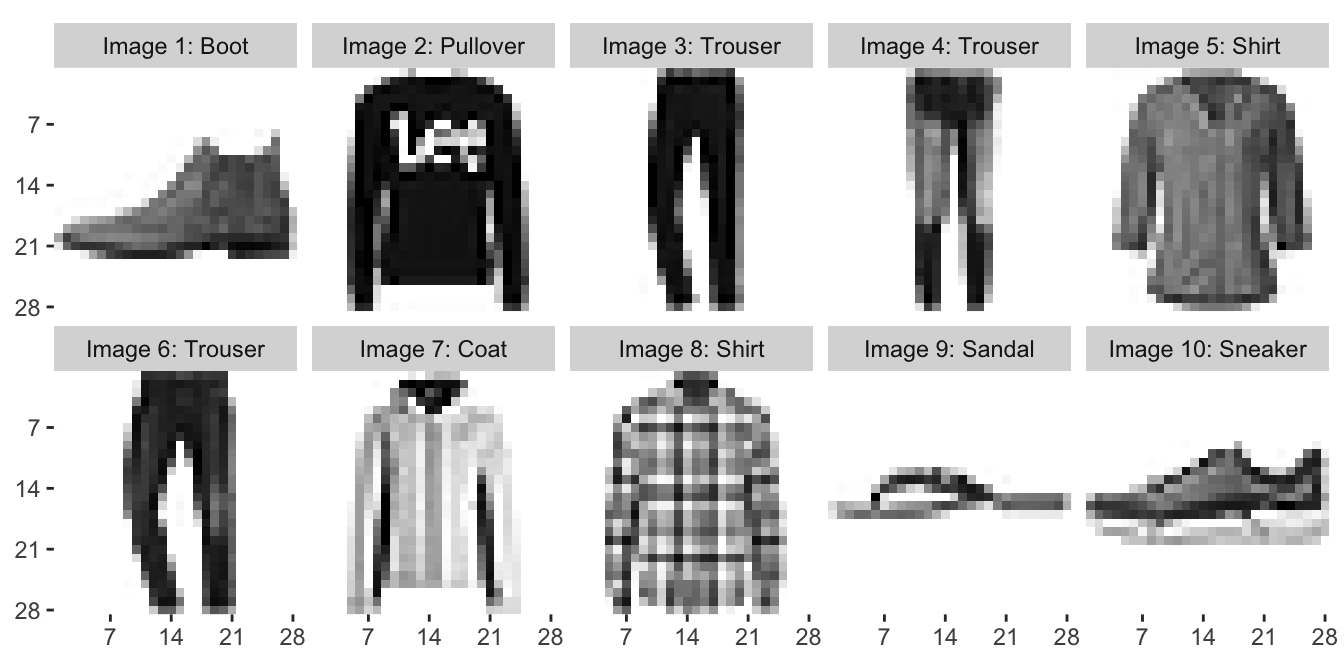

Il dataset Fashion-MNIST contiene immagini in scala di grigi degli articoli di Zalando, fornendo un dataset ben strutturato per compiti di classificazione di immagini. Ecco alcuni esempi di immagini dal dataset:

L'esempio mostra la varietà e la complessità delle immagini nel dataset Fashion-MNIST, evidenziando l'importanza di un dataset diversificato per l'addestramento di modelli di classificazione di immagini robusti.

Link to this sectionRiconoscimenti#

Se utilizzi il dataset Fashion-MNIST nel tuo lavoro di ricerca o sviluppo, ti preghiamo di citare il dataset inserendo un link al repository GitHub. Questo dataset è stato reso disponibile da Zalando Research.

Link to this sectionFAQ#

Link to this sectionCos'è il dataset Fashion-MNIST e in cosa differisce da MNIST?#

Il dataset Fashion-MNIST è una raccolta di 70.000 immagini in scala di grigi di articoli di Zalando, intesa come un moderno sostituto del dataset MNIST originale. Serve come benchmark per modelli di machine learning nel contesto di compiti di classificazione di immagini. A differenza di MNIST, che contiene cifre scritte a mano, Fashion-MNIST consiste in immagini da 28x28 pixel categorizzate in 10 classi legate alla moda, come T-shirt/top, pantaloni e stivaletti.

Link to this sectionCome posso addestrare un modello YOLO sul dataset Fashion-MNIST?#

Per addestrare un modello Ultralytics YOLO sul dataset Fashion-MNIST, puoi usare sia Python che comandi CLI. Ecco un rapido esempio per iniziare:

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n-cls.pt")

# Train the model on Fashion-MNIST

results = model.train(data="fashion-mnist", epochs=100, imgsz=28)Per parametri di addestramento più dettagliati, fai riferimento alla pagina Training.

Link to this sectionPerché dovrei usare il dataset Fashion-MNIST per il benchmarking dei miei modelli di machine learning?#

Il dataset Fashion-MNIST è ampiamente riconosciuto nella comunità del deep learning come una robusta alternativa a MNIST. Offre un set di immagini più complesso e variegato, rendendolo una scelta eccellente per il benchmarking di modelli di classificazione di immagini. La struttura del dataset, comprendente 60.000 immagini di addestramento e 10.000 immagini di test, ciascuna etichettata con una delle 10 classi, lo rende ideale per valutare le prestazioni di diversi algoritmi di machine learning in un contesto più stimolante.

Link to this sectionPosso usare Ultralytics YOLO per compiti di classificazione di immagini come Fashion-MNIST?#

Sì, i modelli Ultralytics YOLO possono essere usati per compiti di classificazione di immagini, inclusi quelli che coinvolgono il dataset Fashion-MNIST. YOLO26, ad esempio, supporta vari compiti di visione come rilevamento, segmentazione di istanze, segmentazione semantica, classificazione, stima della posa e rilevamento orientato di oggetti. Per iniziare con i compiti di classificazione di immagini, consulta la pagina Classificazione.

Link to this sectionQuali sono le caratteristiche principali e la struttura del dataset Fashion-MNIST?#

Il dataset Fashion-MNIST è diviso in due sottoinsiemi principali: 60.000 immagini di addestramento e 10.000 immagini di test. Ogni immagine è una foto in scala di grigi di 28x28 pixel che rappresenta una delle 10 classi legate alla moda. La semplicità e il formato ben strutturato lo rendono ideale per addestrare e valutare modelli in compiti di machine learning e computer vision. Per ulteriori dettagli sulla struttura del dataset, vedi la sezione Struttura del dataset.

Link to this sectionCome posso riconoscere l'uso del dataset Fashion-MNIST nella mia ricerca?#

Se utilizzi il dataset Fashion-MNIST nei tuoi progetti di ricerca o sviluppo, è importante riconoscerlo inserendo un link al repository GitHub. Questo aiuta ad attribuire i dati a Zalando Research, che ha reso il dataset disponibile per l'uso pubblico.