Guida rapida: NVIDIA Jetson con Ultralytics YOLO26

Questa guida completa fornisce una procedura dettagliata per la distribuzione di Ultralytics YOLO26 sui dispositivi NVIDIA Jetson. Inoltre, presenta benchmark di performance per dimostrare le capacità di YOLO26 su questi dispositivi piccoli e potenti.

Nuovo supporto per i prodotti

Abbiamo aggiornato questa guida con l'ultimo NVIDIA Jetson AGX Thor Developer Kit che offre fino a 2070 FP4 TFLOPS di calcolo AI e 128 GB di memoria con potenza configurabile tra 40 W e 130 W. Offre oltre 7,5 volte il calcolo AI di NVIDIA Jetson AGX Orin, con un'efficienza energetica 3,5 volte superiore per eseguire senza problemi i modelli AI più diffusi.

Guarda: Come utilizzare Ultralytics YOLO26 sui dispositivi NVIDIA Jetson

Nota

Questa guida è stata testata con NVIDIA Jetson AGX Thor Developer Kit (Jetson T5000) con l'ultima versione stabile di JetPack JP7.0, NVIDIA Jetson AGX Orin Developer Kit (64GB) con la versione JetPack JP6.2, NVIDIA Jetson Orin Nano Super Developer Kit con la versione JetPack JP6.1, Seeed Studio reComputer J4012 basato su NVIDIA Jetson Orin NX 16GB con la versione JetPack JP6.0/ versione JetPack JP5.1.3 e Seeed Studio reComputer J1020 v2 basato su NVIDIA Jetson Nano 4GB con la versione JetPack JP4.6.1. Si prevede che funzioni su tutta la gamma hardware NVIDIA Jetson, inclusi i dispositivi più recenti e quelli legacy.

Cos'è NVIDIA Jetson?

NVIDIA Jetson è una serie di schede di elaborazione embedded progettate per portare l'intelligenza artificiale (AI) accelerata ai dispositivi edge. Questi dispositivi compatti e potenti sono costruiti attorno all'architettura GPU di NVIDIA e possono eseguire algoritmi AI complessi e modelli di deep learning direttamente sul dispositivo, senza dipendere dalle risorse di cloud computing. Le schede Jetson sono spesso utilizzate in robotica, veicoli autonomi, automazione industriale e altre applicazioni in cui l'inferenza AI deve essere eseguita localmente con bassa latenza e alta efficienza. Inoltre, queste schede sono basate sull'architettura ARM64 e funzionano a un consumo energetico inferiore rispetto ai tradizionali dispositivi di elaborazione GPU.

Confronto tra le serie NVIDIA Jetson

NVIDIA Jetson AGX Thor è l'ultima versione della famiglia NVIDIA Jetson basata sull'architettura NVIDIA Blackwell, che offre prestazioni di AI drasticamente migliorate rispetto alle generazioni precedenti. La tabella seguente confronta alcuni dei dispositivi Jetson nell'ecosistema.

| Jetson AGX Thor(T5000) | Jetson AGX Orin 64GB | Jetson Orin NX 16GB | Jetson Orin Nano Super | Jetson AGX Xavier | Jetson Xavier NX | Jetson Nano | |

|---|---|---|---|---|---|---|---|

| Prestazioni AI | 2070 TFLOPS | 275 TOPS | 100 TOPS | 67 TOPS | 32 TOPS | 21 TOPS | 472 GFLOPS |

| GPU | GPU NVIDIA Blackwell con architettura a 2560 core e 96 Tensor Core | GPU NVIDIA Architettura Ampere a 2048 core con 64 Tensor Core | GPU NVIDIA Ampere architecture da 1024 core con 32 Tensor Core | GPU NVIDIA Ampere architecture da 1024 core con 32 Tensor Core | GPU NVIDIA con architettura Volta a 512 core e 64 Tensor Core | GPU NVIDIA Volta™ con architettura a 384 core e 48 Tensor Core | GPU NVIDIA Maxwell™ architecture da 128 core |

| Frequenza massima della GPU | 1.57 GHz | 1.3 GHz | 918 MHz | 1020 MHz | 1377 MHz | 1100 MHz | 921MHz |

| CPU | CPU Arm® Neoverse®-V3AE a 14 core a 64 bit 1MB L2 + 16MB L3 | CPU NVIDIA Arm® Cortex A78AE v8.2 a 64 bit da 12 core 3MB L2 + 6MB L3 | CPU 8-core NVIDIA Arm® Cortex A78AE v8.2 64-bit 2MB L2 + 4MB L3 | CPU Arm® Cortex®-A78AE v8.2 a 6 core, 64 bit, 1,5 MB L2 + 4 MB L3 | CPU 8-core NVIDIA Carmel Arm®v8.2 64-bit 8MB L2 + 4MB L3 | CPU NVIDIA Carmel Arm®v8.2 a 6 core, 64 bit, 6 MB L2 + 4 MB L3 | Processore Quad-Core Arm® Cortex®-A57 MPCore |

| Frequenza massima della CPU | 2.6 GHz | 2.2 GHz | 2.0 GHz | 1.7 GHz | 2.2 GHz | 1.9 GHz | 1.43GHz |

| Memoria | 128GB 256-bit LPDDR5X 273GB/s | 64 GB LPDDR5 a 256 bit 204,8 GB/s | 16GB 128-bit LPDDR5 102.4GB/s | 8GB 128-bit LPDDR5 102 GB/s | 32GB 256-bit LPDDR4x 136.5GB/s | 8GB 128-bit LPDDR4x 59.7GB/s | 4GB 64-bit LPDDR4 25.6GB/s |

Per una tabella di confronto più dettagliata, visita la sezione Confronta le specifiche della pagina ufficiale NVIDIA Jetson.

Cos'è NVIDIA JetPack?

NVIDIA JetPack SDK che alimenta i moduli Jetson è la soluzione più completa e fornisce un ambiente di sviluppo completo per la creazione di applicazioni AI accelerate end-to-end e riduce i tempi di commercializzazione. JetPack include Jetson Linux con bootloader, kernel Linux, ambiente desktop Ubuntu e un set completo di librerie per l'accelerazione del calcolo GPU, multimedia, grafica e computer vision. Include anche esempi, documentazione e strumenti per sviluppatori sia per computer host che per kit di sviluppo e supporta SDK di livello superiore come DeepStream per l'analisi di video in streaming, Isaac per la robotica e Riva per l'AI conversazionale.

Flash JetPack su NVIDIA Jetson

Il primo passo dopo aver ottenuto un dispositivo NVIDIA Jetson è installare NVIDIA JetPack sul dispositivo. Esistono diversi modi per installare NVIDIA Jetson.

- Se possiedi un Kit di sviluppo NVIDIA ufficiale come il Jetson AGX Thor Developer Kit, puoi scaricare un'immagine e preparare una chiavetta USB avviabile per flashare JetPack sull'SSD incluso.

- Se possiedi un kit di sviluppo NVIDIA ufficiale come il Jetson Orin Nano Developer Kit, puoi scaricare un'immagine e preparare una scheda SD con JetPack per l'avvio del dispositivo.

- Se possiedi qualsiasi altro kit di sviluppo NVIDIA, puoi flashare JetPack sul dispositivo utilizzando SDK Manager.

- Se possiedi un dispositivo Seeed Studio reComputer J4012, puoi flashare JetPack sull'SSD incluso e, se possiedi un dispositivo Seeed Studio reComputer J1020 v2, puoi flashare JetPack sull'eMMC/SSD.

- Se si possiede un altro dispositivo di terze parti alimentato dal modulo NVIDIA Jetson, si consiglia di seguire il flashing da riga di comando.

Nota

Per i metodi 1, 4 e 5 sopra indicati, dopo aver flashato il sistema e avviato il dispositivo, inserire "sudo apt update && sudo apt install nvidia-jetpack -y" sul terminale del dispositivo per installare tutti i componenti JetPack rimanenti necessari.

Supporto JetPack basato sul dispositivo Jetson

La tabella seguente evidenzia le versioni di NVIDIA JetPack supportate da diversi dispositivi NVIDIA Jetson.

| JetPack 4 | JetPack 5 | JetPack 6 | JetPack 7 | |

|---|---|---|---|---|

| Jetson Nano | ✅ | ❌ | ❌ | ❌ |

| Jetson TX2 | ✅ | ❌ | ❌ | ❌ |

| Jetson Xavier NX | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Xavier | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Orin | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin NX | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin Nano | ❌ | ✅ | ✅ | ❌ |

| Jetson AGX Thor | ❌ | ❌ | ❌ | ✅ |

Guida rapida con Docker

Il modo più rapido per iniziare con Ultralytics YOLO26 su NVIDIA Jetson è eseguire con immagini Docker pre-costruite per Jetson. Fare riferimento alla tabella sopra e scegliere la versione di JetPack in base al dispositivo Jetson in proprio possesso.

t=ultralytics/ultralytics:latest-jetson-jetpack4

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack5

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack6

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-nvidia-arm64

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

Dopo aver fatto ciò, passa alla sezione Usa TensorRT su NVIDIA Jetson.

Inizia con l'installazione nativa

Per un'installazione nativa senza Docker, fare riferimento ai passaggi seguenti.

Esegui su JetPack 7.0

Installa il pacchetto Ultralytics

Qui installeremo il pacchetto Ultralytics su Jetson con dipendenze opzionali in modo da poter esportare i modelli PyTorch in altri formati diversi. Ci concentreremo principalmente sulle esportazioni NVIDIA TensorRT perché TensorRT farà in modo di ottenere le massime prestazioni dai dispositivi Jetson.

Aggiorna l'elenco dei pacchetti, installa pip ed esegui l'aggiornamento all'ultima versione

sudo apt update sudo apt install python3-pip -y pip install -U pipInstalla

ultralyticspacchetto pip con dipendenze opzionalipip install ultralytics[export]Riavvia il dispositivo

sudo reboot

Installa PyTorch e Torchvision

L'installazione di Ultralytics di cui sopra installerà Torch e Torchvision. Tuttavia, questi 2 pacchetti installati tramite pip non sono compatibili per l'esecuzione su Jetson AGX Thor che viene fornito con JetPack 7.0 e CUDA 13. Pertanto, dobbiamo installarli manualmente.

Installa torch e torchvision secondo JP7.0

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu130

Installa onnxruntime-gpu

Il onnxruntime-gpu package ospitato in PyPI non ha aarch64 binari per Jetson. Quindi dobbiamo installare manualmente questo pacchetto. Questo pacchetto è necessario per alcune delle esportazioni.

Qui scaricheremo e installeremo onnxruntime-gpu 1.24.0 con Python3.12 supporto.

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.24.0-cp312-cp312-linux_aarch64.whl

Esegui su JetPack 6.1

Installa il pacchetto Ultralytics

Qui installeremo il pacchetto Ultralytics su Jetson con dipendenze opzionali in modo da poter esportare i modelli PyTorch in altri formati diversi. Ci concentreremo principalmente sulle esportazioni NVIDIA TensorRT perché TensorRT farà in modo di ottenere le massime prestazioni dai dispositivi Jetson.

Aggiorna l'elenco dei pacchetti, installa pip ed esegui l'aggiornamento all'ultima versione

sudo apt update sudo apt install python3-pip -y pip install -U pipInstalla

ultralyticspacchetto pip con dipendenze opzionalipip install ultralytics[export]Riavvia il dispositivo

sudo reboot

Installa PyTorch e Torchvision

L'installazione di Ultralytics di cui sopra installerà Torch e Torchvision. Tuttavia, questi due pacchetti installati tramite pip non sono compatibili con la piattaforma Jetson, che si basa sull'architettura ARM64. Pertanto, dobbiamo installare manualmente una ruota pip PyTorch precompilata e compilare o installare Torchvision dai sorgenti.

Installa torch 2.10.0 e torchvision 0.25.0 secondo JP6.1

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.10.0-cp310-cp310-linux_aarch64.whl

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.25.0-cp310-cp310-linux_aarch64.whl

Nota

Visita la pagina PyTorch per Jetson per accedere a tutte le diverse versioni di PyTorch per le diverse versioni di JetPack. Per un elenco più dettagliato sulla compatibilità di PyTorch e Torchvision, visita la pagina di compatibilità di PyTorch e Torchvision.

Installa cuDSS per risolvere un problema di dipendenza con torch 2.10.0

wget https://developer.download.nvidia.com/compute/cudss/0.7.1/local_installers/cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo dpkg -i cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo cp /var/cudss-local-tegra-repo-ubuntu2204-0.7.1/cudss-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cudss

Installa onnxruntime-gpu

Il onnxruntime-gpu package ospitato in PyPI non ha aarch64 binari per Jetson. Quindi dobbiamo installare manualmente questo pacchetto. Questo pacchetto è necessario per alcune delle esportazioni.

Puoi trovare tutti i onnxruntime-gpu pacchetti, organizzati per versione di JetPack, versione di Python e altri dettagli di compatibilità, nel Matrice di compatibilità di Jetson Zoo ONNX Runtime.

Per JetPack 6 con Python 3.10 supporto, puoi installare onnxruntime-gpu 1.23.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.23.0-cp310-cp310-linux_aarch64.whl

In alternativa, per onnxruntime-gpu 1.20.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.20.0-cp310-cp310-linux_aarch64.whl

Esegui su JetPack 5.1.2

Installa il pacchetto Ultralytics

Qui installeremo il pacchetto Ultralytics su Jetson con dipendenze opzionali in modo da poter esportare i modelli PyTorch in altri formati diversi. Ci concentreremo principalmente sulle esportazioni NVIDIA TensorRT perché TensorRT farà in modo di ottenere le massime prestazioni dai dispositivi Jetson.

Aggiorna l'elenco dei pacchetti, installa pip ed esegui l'aggiornamento all'ultima versione

sudo apt update sudo apt install python3-pip -y pip install -U pipInstalla

ultralyticspacchetto pip con dipendenze opzionalipip install ultralytics[export]Riavvia il dispositivo

sudo reboot

Installa PyTorch e Torchvision

L'installazione di Ultralytics di cui sopra installerà Torch e Torchvision. Tuttavia, questi due pacchetti installati tramite pip non sono compatibili con la piattaforma Jetson, che si basa sull'architettura ARM64. Pertanto, dobbiamo installare manualmente una ruota pip PyTorch precompilata e compilare o installare Torchvision dai sorgenti.

Disinstallare PyTorch e Torchvision attualmente installati

pip uninstall torch torchvisionInstalla

torch 2.1.0etorchvision 0.16.2secondo JP5.1.2pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.1.0a0+41361538.nv23.06-cp38-cp38-linux_aarch64.whl pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.16.2+c6f3977-cp38-cp38-linux_aarch64.whl

Nota

Visita la pagina PyTorch per Jetson per accedere a tutte le diverse versioni di PyTorch per le diverse versioni di JetPack. Per un elenco più dettagliato sulla compatibilità di PyTorch e Torchvision, visita la pagina di compatibilità di PyTorch e Torchvision.

Installa onnxruntime-gpu

Il onnxruntime-gpu package ospitato in PyPI non ha aarch64 binari per Jetson. Quindi dobbiamo installare manualmente questo pacchetto. Questo pacchetto è necessario per alcune delle esportazioni.

Puoi trovare tutti i onnxruntime-gpu pacchetti, organizzati per versione di JetPack, versione di Python e altri dettagli di compatibilità, nel Matrice di compatibilità di Jetson Zoo ONNX Runtime. Qui scaricheremo e installeremo onnxruntime-gpu 1.17.0 con Python3.8 supporto.

wget https://nvidia.box.com/shared/static/zostg6agm00fb6t5uisw51qi6kpcuwzd.whl -O onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

pip install onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

Nota

onnxruntime-gpu ripristinerà automaticamente la versione di numpy all'ultima. Quindi dobbiamo reinstallare numpy a 1.23.5 per risolvere un problema eseguendo:

pip install numpy==1.23.5

Utilizza TensorRT su NVIDIA Jetson

Tra tutti i formati di export dei modelli supportati da Ultralytics, TensorRT offre le massime prestazioni di inferenza sui dispositivi NVIDIA Jetson, rendendolo la nostra raccomandazione principale per i deployment su Jetson. Per istruzioni di configurazione e utilizzo avanzato, consulta la nostra guida dedicata all'integrazione di TensorRT.

Converti il modello in TensorRT ed esegui l'inferenza

Il modello YOLO26n in formato PyTorch viene convertito in TensorRT per eseguire l'inferenza con il modello esportato.

Esempio

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT

model.export(format="engine") # creates 'yolo26n.engine'

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format

yolo export model=yolo26n.pt format=engine # creates 'yolo26n.engine'

# Run inference with the exported model

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Nota

Visita la pagina di esportazione per accedere ad argomenti aggiuntivi durante l'esportazione di modelli in diversi formati

Utilizza NVIDIA Deep Learning Accelerator (DLA)

NVIDIA Deep Learning Accelerator (DLA) è un componente hardware specializzato integrato nei dispositivi NVIDIA Jetson che ottimizza l'inferenza di deep learning per l'efficienza energetica e le prestazioni. Scaricando i compiti dalla GPU (liberandola per processi più intensivi), DLA consente ai modelli di funzionare con un consumo energetico inferiore pur mantenendo un'elevata produttività, ideale per sistemi embedded e applicazioni di IA in tempo reale.

I seguenti dispositivi Jetson sono dotati di hardware DLA:

| Dispositivo Jetson | Core DLA | Frequenza massima DLA |

|---|---|---|

| Serie Jetson AGX Orin | 2 | 1.6 GHz |

| Jetson Orin NX 16GB | 2 | 614 MHz |

| Jetson Orin NX 8GB | 1 | 614 MHz |

| Serie Jetson AGX Xavier | 2 | 1.4 GHz |

| Serie Jetson Xavier NX | 2 | 1.1 GHz |

Esempio

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT with DLA enabled (only works with FP16 or INT8)

model.export(format="engine", device="dla:0", half=True) # dla:0 or dla:1 corresponds to the DLA cores

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format with DLA enabled (only works with FP16 or INT8)

# Once DLA core number is specified at export, it will use the same core at inference

yolo export model=yolo26n.pt format=engine device="dla:0" half=True # dla:0 or dla:1 corresponds to the DLA cores

# Run inference with the exported model on the DLA

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Nota

Quando si utilizzano le esportazioni DLA, alcuni livelli potrebbero non essere supportati per l'esecuzione su DLA e torneranno alla GPU per l'esecuzione. Questo fallback può introdurre ulteriore latenza e influire sulle prestazioni complessive dell'inferenza. Pertanto, DLA non è progettato principalmente per ridurre la latenza dell'inferenza rispetto a TensorRT in esecuzione interamente sulla GPU. Invece, il suo scopo principale è aumentare il throughput e migliorare l'efficienza energetica.

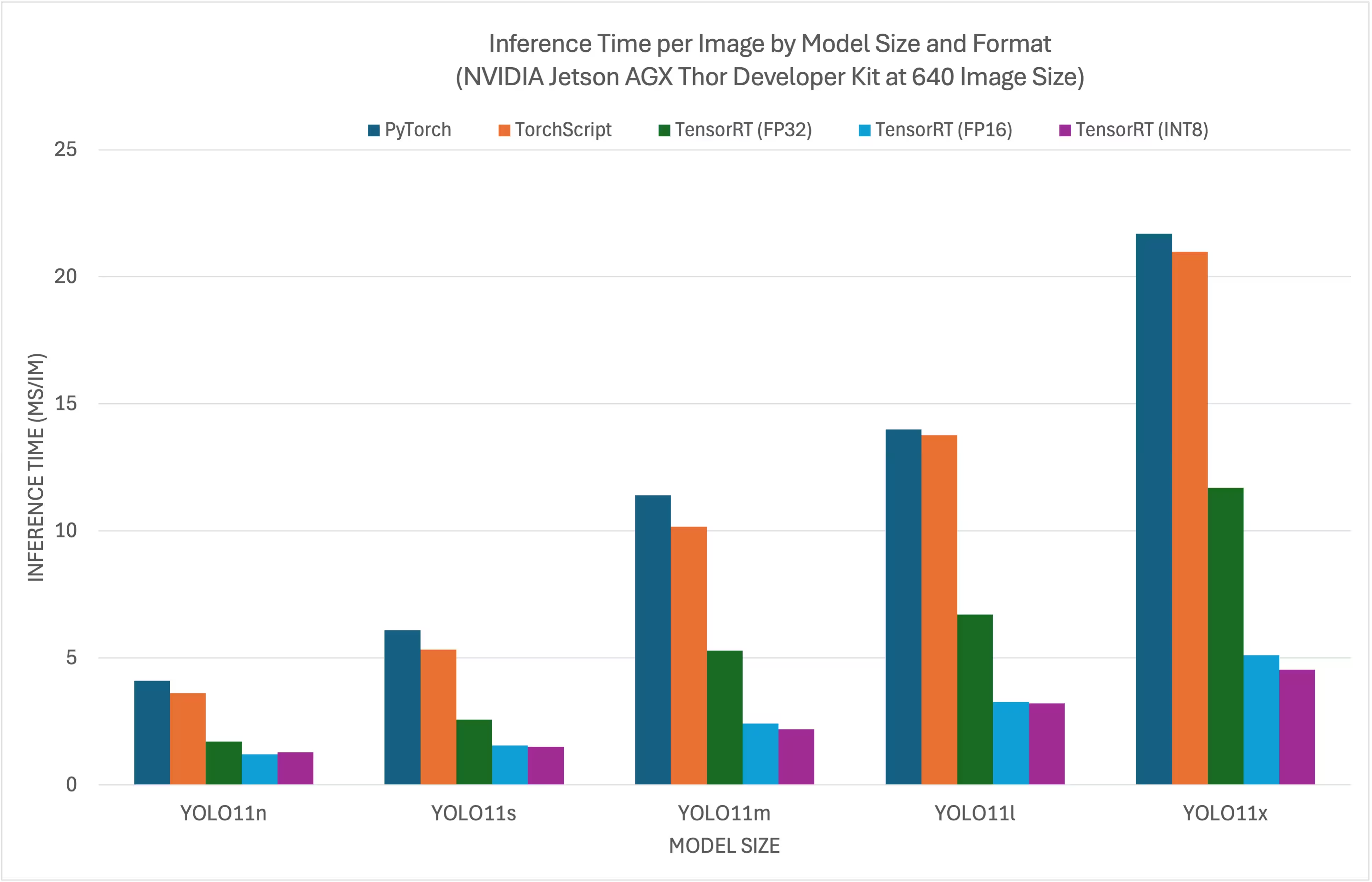

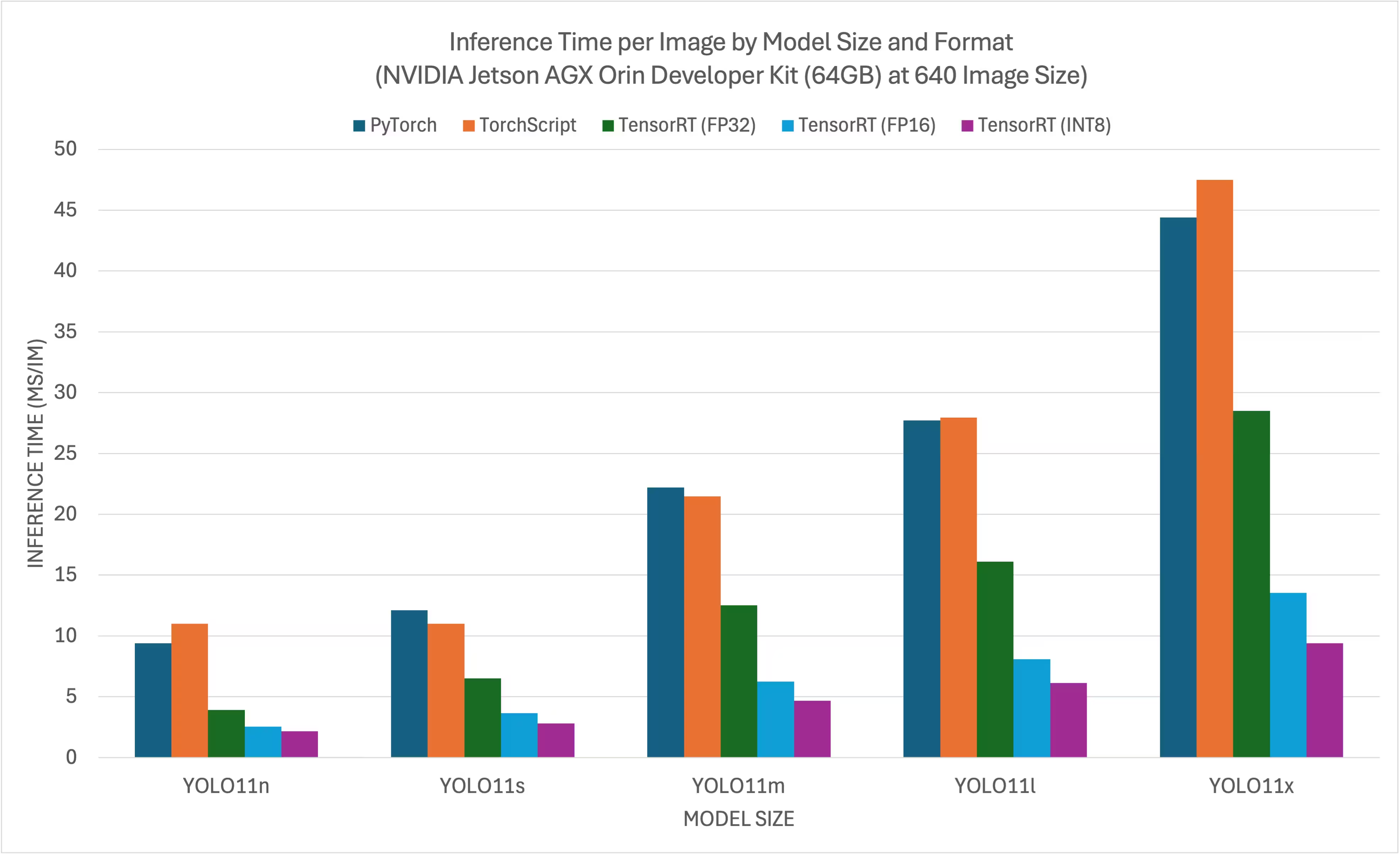

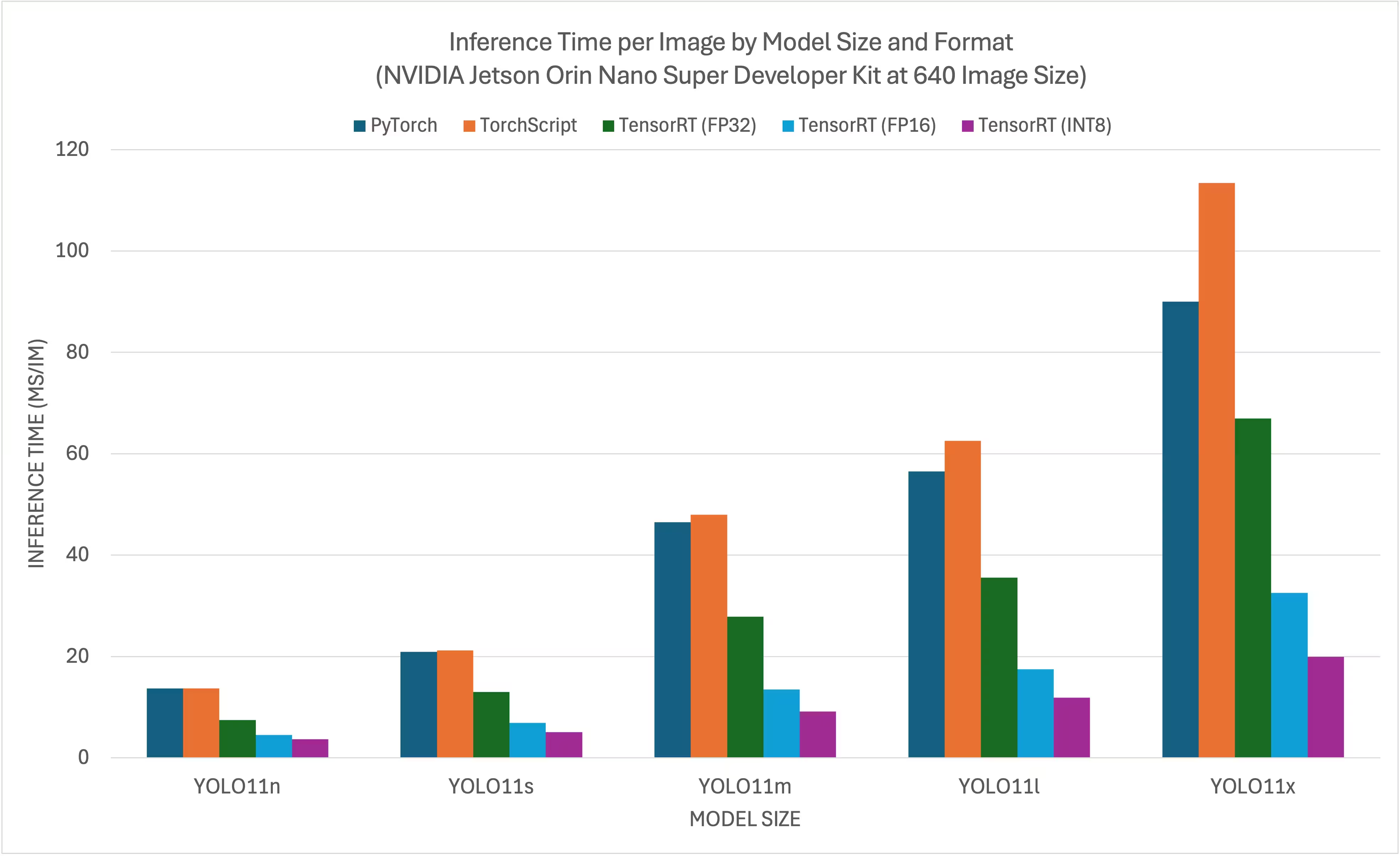

Benchmark NVIDIA Jetson YOLO11/ YOLO26

I benchmark di YOLO11/YOLO26 sono stati eseguiti dal team Ultralytics su 11 diversi formati di modello, misurando velocità e precisione: PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch. I benchmark sono stati eseguiti su NVIDIA Jetson AGX Thor Developer Kit, NVIDIA Jetson AGX Orin Developer Kit (64GB), NVIDIA Jetson Orin Nano Super Developer Kit e Seeed Studio reComputer J4012 alimentato da un dispositivo Jetson Orin NX 16GB con precisione FP32 e dimensione predefinita dell'immagine di input di 640.

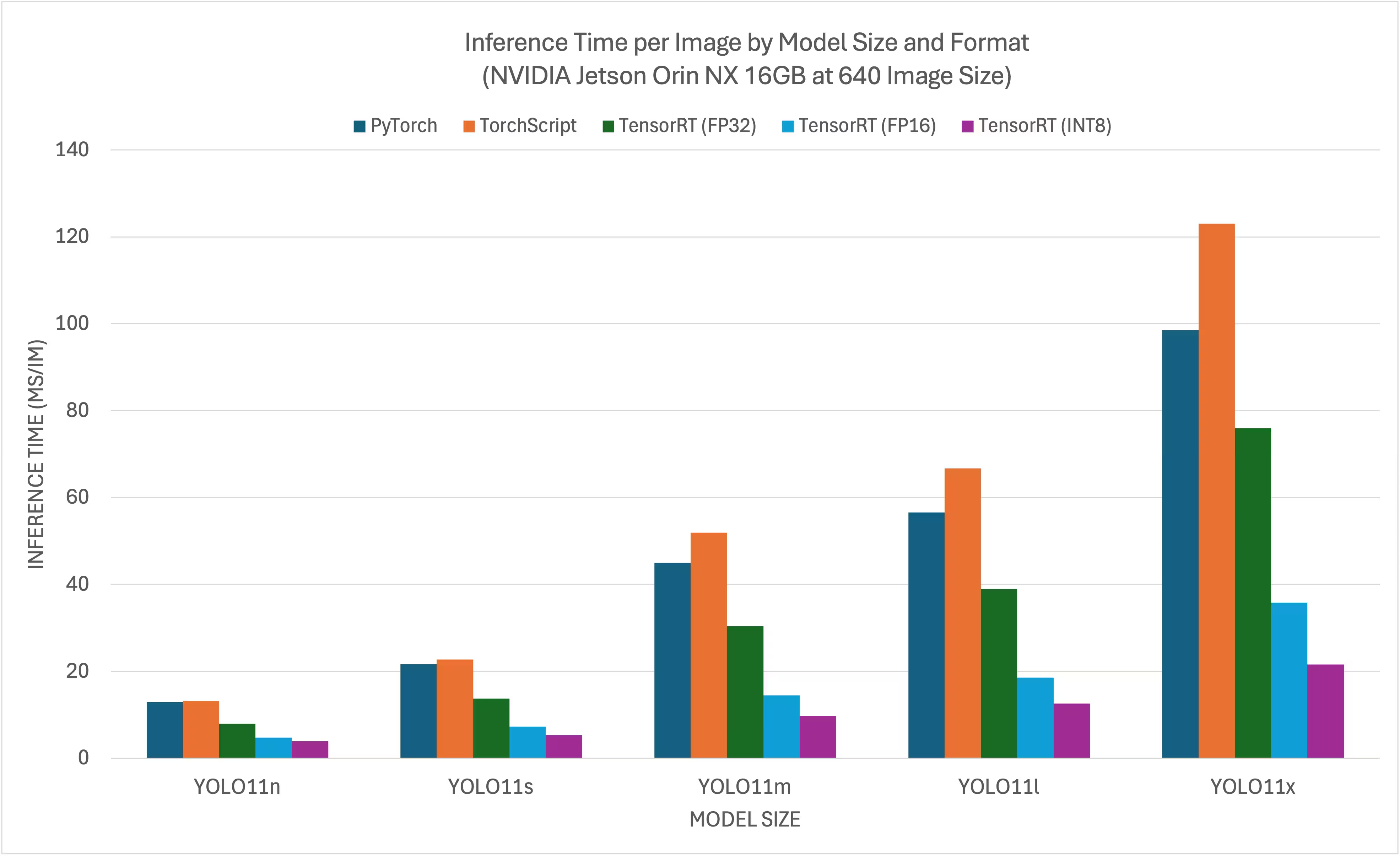

Grafici di confronto

Anche se tutte le esportazioni di modelli funzionano su NVIDIA Jetson, abbiamo incluso solo PyTorch, TorchScript, TensorRT per il grafico comparativo sottostante perché utilizzano la GPU sul Jetson e garantiscono i migliori risultati. Tutte le altre esportazioni utilizzano solo la CPU e le prestazioni non sono altrettanto buone come le tre sopra menzionate. È possibile trovare i benchmark per tutte le esportazioni nella sezione successiva a questo grafico.

NVIDIA Jetson AGX Thor Developer Kit

NVIDIA Jetson AGX Orin Developer Kit (64GB)

NVIDIA Jetson Orin Nano Super Developer Kit

NVIDIA Jetson Orin NX 16GB

Tabelle di confronto dettagliate

La tabella seguente rappresenta i risultati del benchmark per cinque diversi modelli (YOLO11n, YOLO11s, YOLO11m, YOLO11l, YOLO11x) in 11 diversi formati (PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch), fornendoci lo stato, le dimensioni, la metrica mAP50-95(B) e il tempo di inferenza per ogni combinazione.

NVIDIA Jetson AGX Thor Developer Kit

Prestazioni

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4798 | 7.39 |

| TorchScript | ✅ | 9.8 | 0.4789 | 4.21 |

| ONNX | ✅ | 9.5 | 0.4767 | 6.58 |

| OpenVINO | ✅ | 10.1 | 0.4794 | 17.50 |

| TensorRT (FP32) | ✅ | 13.9 | 0.4791 | 1.90 |

| TensorRT (FP16) | ✅ | 7.6 | 0.4797 | 1.39 |

| TensorRT (INT8) | ✅ | 6.5 | 0.4273 | 1.52 |

| TF SavedModel | ✅ | 25.7 | 0.4764 | 47.24 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 45.98 |

| TF Lite | ✅ | 9.9 | 0.4764 | 182.04 |

| MNN | ✅ | 9.4 | 0.4784 | 21.83 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 7.99 |

| TorchScript | ✅ | 36.8 | 0.5664 | 6.01 |

| ONNX | ✅ | 36.5 | 0.5666 | 9.31 |

| OpenVINO | ✅ | 38.5 | 0.5656 | 35.56 |

| TensorRT (FP32) | ✅ | 38.9 | 0.5664 | 2.95 |

| TensorRT (FP16) | ✅ | 21.0 | 0.5650 | 1.77 |

| TensorRT (INT8) | ✅ | 13.5 | 0.5010 | 1.75 |

| TF SavedModel | ✅ | 96.6 | 0.5665 | 88.87 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 89.20 |

| TF Lite | ✅ | 36.9 | 0.5665 | 604.25 |

| MNN | ✅ | 36.4 | 0.5651 | 53.75 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 10.76 |

| TorchScript | ✅ | 78.5 | 0.6217 | 10.57 |

| ONNX | ✅ | 78.2 | 0.6211 | 14.91 |

| OpenVINO | ✅ | 82.2 | 0.6204 | 86.27 |

| TensorRT (FP32) | ✅ | 82.2 | 0.6230 | 5.56 |

| TensorRT (FP16) | ✅ | 41.6 | 0.6209 | 2.58 |

| TensorRT (INT8) | ✅ | 24.3 | 0.5595 | 2.49 |

| TF SavedModel | ✅ | 205.8 | 0.6229 | 200.96 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 203.00 |

| TF Lite | ✅ | 78.6 | 0.6229 | 1867.12 |

| MNN | ✅ | 78.0 | 0.6176 | 142.00 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 13.34 |

| TorchScript | ✅ | 95.5 | 0.6248 | 13.86 |

| ONNX | ✅ | 95.0 | 0.6247 | 18.44 |

| OpenVINO | ✅ | 99.9 | 0.6238 | 106.67 |

| TensorRT (FP32) | ✅ | 99.0 | 0.6249 | 6.74 |

| TensorRT (FP16) | ✅ | 50.3 | 0.6243 | 3.34 |

| TensorRT (INT8) | ✅ | 29.0 | 0.5708 | 3.24 |

| TF SavedModel | ✅ | 250.0 | 0.6245 | 259.74 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 263.42 |

| TF Lite | ✅ | 95.4 | 0.6245 | 2367.83 |

| MNN | ✅ | 94.8 | 0.6272 | 174.39 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6565 | 20.92 |

| TorchScript | ✅ | 213.5 | 0.6595 | 21.76 |

| ONNX | ✅ | 212.9 | 0.6590 | 26.72 |

| OpenVINO | ✅ | 223.6 | 0.6620 | 205.27 |

| TensorRT (FP32) | ✅ | 217.2 | 0.6593 | 12.29 |

| TensorRT (FP16) | ✅ | 112.1 | 0.6611 | 5.16 |

| TensorRT (INT8) | ✅ | 58.9 | 0.5222 | 4.72 |

| TF SavedModel | ✅ | 559.2 | 0.6593 | 498.85 |

| TF GraphDef | ✅ | 213.0 | 0.6593 | 507.43 |

| TF Lite | ✅ | 213.3 | 0.6593 | 5134.22 |

| MNN | ✅ | 212.8 | 0.6625 | 347.84 |

Benchmark eseguito con Ultralytics 8.4.7

Nota

Il tempo di inferenza non include il pre/post-processing.

NVIDIA Jetson AGX Orin Developer Kit (64GB)

Prestazioni

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 11.58 |

| TorchScript | ✅ | 9.8 | 0.4770 | 4.60 |

| ONNX | ✅ | 9.5 | 0.4770 | 9.87 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 28.80 |

| TensorRT (FP32) | ✅ | 11.5 | 0.0450 | 4.18 |

| TensorRT (FP16) | ✅ | 7.9 | 0.0450 | 2.62 |

| TensorRT (INT8) | ✅ | 5.4 | 0.4640 | 2.30 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 71.10 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 70.02 |

| TF Lite | ✅ | 9.9 | 0.4760 | 227.94 |

| MNN | ✅ | 9.4 | 0.4760 | 32.46 |

| NCNN | ✅ | 9.3 | 0.4810 | 29.93 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 13.18 |

| TorchScript | ✅ | 36.8 | 0.5670 | 11.48 |

| ONNX | ✅ | 36.5 | 0.5660 | 13.47 |

| OpenVINO | ✅ | 36.7 | 0.5650 | 58.30 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5660 | 6.82 |

| TensorRT (FP16) | ✅ | 21.9 | 0.5660 | 3.76 |

| TensorRT (INT8) | ✅ | 12.5 | 0.5480 | 2.98 |

| TF SavedModel | ✅ | 92.2 | 0.5660 | 145.62 |

| TF GraphDef | ✅ | 36.5 | 0.5660 | 146.26 |

| TF Lite | ✅ | 36.9 | 0.5660 | 753.52 |

| MNN | ✅ | 36.4 | 0.5650 | 79.50 |

| NCNN | ✅ | 36.4 | 0.5700 | 58.73 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 19.36 |

| TorchScript | ✅ | 78.5 | 0.6230 | 20.02 |

| ONNX | ✅ | 78.2 | 0.6230 | 25.40 |

| OpenVINO | ✅ | 78.3 | 0.6190 | 130.76 |

| TensorRT (FP32) | ✅ | 80.2 | 0.6220 | 12.60 |

| TensorRT (FP16) | ✅ | 42.5 | 0.6220 | 6.24 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5820 | 4.72 |

| TF SavedModel | ✅ | 196.3 | 0.6230 | 306.76 |

| TF GraphDef | ✅ | 78.2 | 0.6230 | 314.23 |

| TF Lite | ✅ | 78.5 | 0.6230 | 2331.63 |

| MNN | ✅ | 78.0 | 0.6220 | 206.93 |

| NCNN | ✅ | 78.0 | 0.6220 | 143.03 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 23.53 |

| TorchScript | ✅ | 95.5 | 0.6250 | 24.23 |

| ONNX | ✅ | 95.0 | 0.6250 | 31.73 |

| OpenVINO | ✅ | 95.3 | 0.6240 | 162.80 |

| TensorRT (FP32) | ✅ | 97.3 | 0.6250 | 15.90 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6240 | 7.93 |

| TensorRT (INT8) | ✅ | 29.9 | 0.5920 | 5.97 |

| TF SavedModel | ✅ | 238.4 | 0.6250 | 394.30 |

| TF GraphDef | ✅ | 95.0 | 0.6250 | 398.63 |

| TF Lite | ✅ | 95.4 | 0.6250 | 2925.27 |

| MNN | ✅ | 94.8 | 0.6250 | 255.87 |

| NCNN | ✅ | 94.8 | 0.6320 | 177.70 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 114 | 0.6610 | 38.37 |

| TorchScript | ✅ | 213.5 | 0.6590 | 41.23 |

| ONNX | ✅ | 212.9 | 0.6590 | 52.03 |

| OpenVINO | ✅ | 213.2 | 0.6590 | 300.40 |

| TensorRT (FP32) | ✅ | 215.2 | 0.6590 | 28.43 |

| TensorRT (FP16) | ✅ | 110.3 | 0.6570 | 13.50 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6080 | 9.33 |

| TF SavedModel | ✅ | 533.3 | 0.6590 | 738.60 |

| TF GraphDef | ✅ | 212.9 | 0.6590 | 785.70 |

| TF Lite | ✅ | 217.6 | 0.6900 | 6476.80 |

| MNN | ✅ | 213.3 | 0.6590 | 519.77 |

| NCNN | ✅ | 212.8 | 0.6670 | 300.00 |

Testato con Ultralytics .4.32

Nota

Il tempo di inferenza non include il pre/post-processing.

NVIDIA Jetson Orin Nano Super Developer Kit

Prestazioni

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 15.60 |

| TorchScript | ✅ | 9.8 | 0.4770 | 12.60 |

| ONNX | ✅ | 9.5 | 0.4760 | 15.76 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 56.23 |

| TensorRT (FP32) | ✅ | 11.3 | 0.4770 | 7.53 |

| TensorRT (FP16) | ✅ | 8.1 | 0.4800 | 4.57 |

| TensorRT (INT8) | ✅ | 5.3 | 0.4490 | 3.80 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 118.33 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 116.30 |

| TF Lite | ✅ | 9.9 | 0.4760 | 286.00 |

| MNN | ✅ | 9.4 | 0.4760 | 68.77 |

| NCNN | ✅ | 9.3 | 0.4810 | 47.50 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 22.83 |

| TorchScript | ✅ | 36.8 | 0.5670 | 21.83 |

| ONNX | ✅ | 36.5 | 0.5664 | 26.29 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 127.09 |

| TensorRT (FP32) | ✅ | 38.2 | 0.5664 | 13.60 |

| TensorRT (FP16) | ✅ | 21.3 | 0.5649 | 7.17 |

| TensorRT (INT8) | ✅ | 12.7 | 0.5468 | 5.25 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 263.69 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 268.21 |

| TF Lite | ✅ | 36.9 | 0.5665 | 949.63 |

| MNN | ✅ | 36.4 | 0.5644 | 184.68 |

| NCNN | ✅ | 36.4 | 0.5697 | 107.48 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 44.43 |

| TorchScript | ✅ | 78.5 | 0.6230 | 44.00 |

| ONNX | ✅ | 78.2 | 0.6225 | 53.44 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 303.26 |

| TensorRT (FP32) | ✅ | 80.0 | 0.6217 | 28.19 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 13.59 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 9.30 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 636.03 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 659.57 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2905.17 |

| MNN | ✅ | 78.0 | 0.6168 | 500.09 |

| NCNN | ✅ | 78.0 | 0.6224 | 332.39 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 60.97 |

| TorchScript | ✅ | 95.5 | 0.6250 | 56.20 |

| ONNX | ✅ | 95.0 | 0.6247 | 68.12 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 397.84 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 35.88 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 17.42 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 11.83 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 835.83 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 852.16 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3650.85 |

| MNN | ✅ | 94.8 | 0.6257 | 612.37 |

| NCNN | ✅ | 94.8 | 0.6323 | 405.45 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 98.44 |

| TorchScript | ✅ | 214.0 | 0.6593 | 98.0 |

| ONNX | ✅ | 212.9 | 0.6595 | 122.43 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 760.72 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 67.17 |

| TensorRT (FP16) | ✅ | 110.2 | 0.6637 | 32.60 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6170 | 19.99 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1647.06 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1670.30 |

| TF Lite | ✅ | 213.3 | 0.6590 | 8066.30 |

| MNN | ✅ | 212.8 | 0.6600 | 1227.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 782.24 |

Testato con Ultralytics .4.33

Nota

Il tempo di inferenza non include il pre/post-processing.

NVIDIA Jetson Orin NX 16GB

Prestazioni

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4799 | 13.90 |

| TorchScript | ✅ | 9.8 | 0.4787 | 11.60 |

| ONNX | ✅ | 9.5 | 0.4763 | 14.18 |

| OpenVINO | ✅ | 9.6 | 0.4819 | 40.19 |

| TensorRT (FP32) | ✅ | 11.4 | 0.4770 | 7.01 |

| TensorRT (FP16) | ✅ | 8.0 | 0.4789 | 4.13 |

| TensorRT (INT8) | ✅ | 5.5 | 0.4489 | 3.49 |

| TF SavedModel | ✅ | 24.6 | 0.4764 | 92.34 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 92.06 |

| TF Lite | ✅ | 9.9 | 0.4764 | 254.43 |

| MNN | ✅ | 9.4 | 0.4760 | 48.55 |

| NCNN | ✅ | 9.3 | 0.4805 | 34.31 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 20.40 |

| TorchScript | ✅ | 36.8 | 0.5664 | 19.20 |

| ONNX | ✅ | 36.5 | 0.5664 | 24.35 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 88.18 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5664 | 12.62 |

| TensorRT (FP16) | ✅ | 21.5 | 0.5652 | 6.41 |

| TensorRT (INT8) | ✅ | 12.6 | 0.5468 | 4.78 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 195.16 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 197.57 |

| TF Lite | ✅ | 36.9 | 0.5665 | 827.48 |

| MNN | ✅ | 36.4 | 0.5649 | 123.47 |

| NCNN | ✅ | 36.4 | 0.5697 | 74.04 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 38.60 |

| TorchScript | ✅ | 78.5 | 0.6227 | 40.50 |

| ONNX | ✅ | 78.2 | 0.6225 | 48.87 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 205.69 |

| TensorRT (FP32) | ✅ | 80.1 | 0.6217 | 24.69 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 11.66 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 8.22 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 451.48 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 460.94 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2555.53 |

| MNN | ✅ | 78.0 | 0.6217 | 333.33 |

| NCNN | ✅ | 78.0 | 0.6224 | 214.60 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 48.60 |

| TorchScript | ✅ | 95.5 | 0.6249 | 51.60 |

| ONNX | ✅ | 95.0 | 0.6247 | 61.95 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 272.47 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 31.64 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 14.77 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 10.49 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 596.46 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 606.10 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3275.55 |

| MNN | ✅ | 94.8 | 0.6247 | 408.15 |

| NCNN | ✅ | 94.8 | 0.6323 | 262.99 |

| Formato | Stato | Dimensione su disco (MB) | mAP50-95(B) | Tempo di inferenza (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 84.40 |

| TorchScript | ✅ | 213.5 | 0.6594 | 91.20 |

| ONNX | ✅ | 212.9 | 0.6595 | 109.34 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 520.88 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 57.18 |

| TensorRT (FP16) | ✅ | 109.7 | 0.6632 | 26.76 |

| TensorRT (INT8) | ✅ | 60.0 | 0.6170 | 17.32 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1170.50 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1217.87 |

| TF Lite | ✅ | 213.3 | 0.6593 | 7247.11 |

| MNN | ✅ | 212.8 | 0.6591 | 820.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 534.30 |

Testato con Ultralytics .4.33

Nota

Il tempo di inferenza non include il pre/post-processing.

Esplora ulteriori attività di benchmarking di Seeed Studio eseguite su diverse versioni di hardware NVIDIA Jetson.

Riproduci i nostri risultati

Per riprodurre i benchmark Ultralytics di cui sopra su tutti i formati di esportazione, esegui questo codice:

Esempio

from ultralytics import YOLO

# Load a YOLO11n PyTorch model

model = YOLO("yolo11n.pt")

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

results = model.benchmark(data="coco128.yaml", imgsz=640)

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

yolo benchmark model=yolo11n.pt data=coco128.yaml imgsz=640

Si noti che i risultati del benchmarking potrebbero variare in base all'esatta configurazione hardware e software di un sistema, nonché al carico di lavoro corrente del sistema al momento dell'esecuzione dei benchmark. Per i risultati più affidabili, utilizzare un dataset con un gran numero di immagini, ad esempio, data='coco.yaml' (5000 immagini val).

Best practice quando si utilizza NVIDIA Jetson

Quando si utilizza NVIDIA Jetson, ci sono alcune best practice da seguire per abilitare le massime prestazioni su NVIDIA Jetson con YOLO26.

Abilita la modalità di massima potenza

Abilitare la modalità MAX Power su Jetson assicurerà che tutti i core di CPU e GPU siano attivati.

sudo nvpmodel -m 0Abilita gli orologi Jetson

Abilitare Jetson Clocks assicurerà che tutti i core di CPU e GPU siano impostati alla loro massima frequenza.

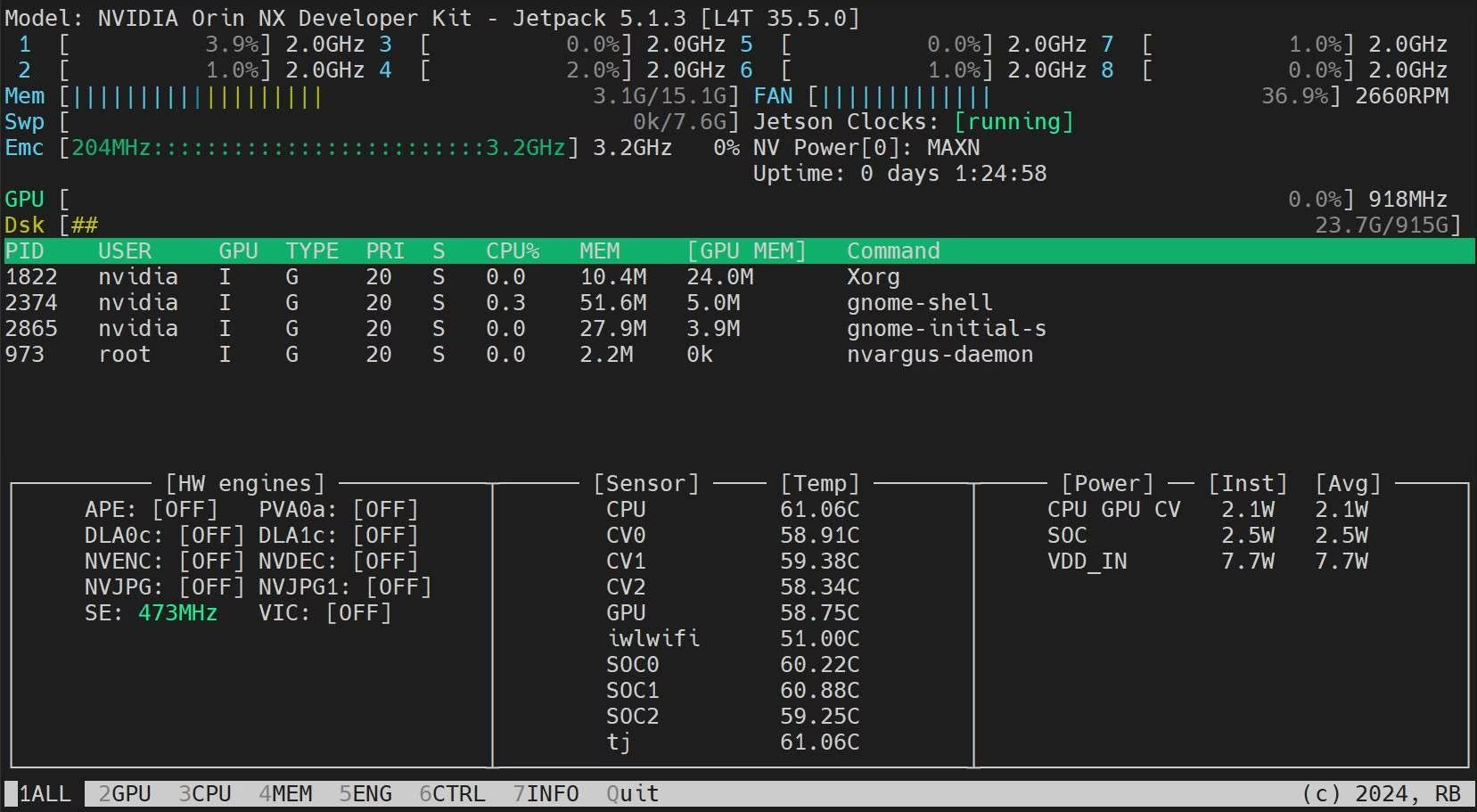

sudo jetson_clocksInstalla l'applicazione Jetson Stats

Possiamo utilizzare l'applicazione jetson stats per monitorare le temperature dei componenti del sistema e controllare altri dettagli del sistema come la visualizzazione dell'utilizzo di CPU, GPU, RAM, modificare le modalità di alimentazione, impostare al massimo gli orologi, controllare le informazioni di JetPack

sudo apt update sudo pip install jetson-stats sudo reboot jtop

Suggerimenti per l'ottimizzazione della memoria su NVIDIA

La memoria disponibile rappresenta spesso il fattore limitante sui dispositivi Jetson, in particolare sulle varianti con meno memoria come il Jetson Orin Nano (8 GB) o l'Orin NX da 8 GB. I suggerimenti riportati di seguito sono modifiche pratiche e a basso rischio che, nel loro insieme, consentono di liberare diverse centinaia di megabyte e permettono di eseguire YOLO più grandi o di gestire ulteriori carichi di lavoro in parallelo. Per un approfondimento completo, consulta il NVIDIA su come ottimizzare l'efficienza della memoria sui dispositivi Jetson.

1. Passare all'avvio in modalità headless (senza interfaccia grafica)

Se il tuo Jetson è connesso tramite SSH o funziona come dispositivo di produzione senza uno schermo collegato, eliminando l'ambiente desktop e il server di visualizzazione è possibile recuperare fino a 865 MB di RAM:

sudo systemctl set-default multi-user.target

sudo reboot

Per ripristinare il desktop in un secondo momento:

sudo systemctl set-default graphical.target

sudo reboot

2. Disattivare i servizi di sistema inutilizzati

I servizi in background non essenziali (Bluetooth, gestori di connettività, demoni hardware inutilizzati) consumano complessivamente circa 32 MB. Elenca i servizi attivi e disattiva quelli che non sono necessari per la tua distribuzione:

# List running services

systemctl list-units --type=service --state=running

# Disable a service

sudo systemctl disable <service-name>

3. Utilizzo della memoria del profilo

Prima di procedere all'ottimizzazione, individua quali processi stanno effettivamente consumando RAM. procrank ordina i processi in base al PSS (Proportional Set Size), che riflette l'effettivo ingombro di memoria per processo in modo più accurato rispetto all'RSS (Resident Set Size, ovvero il totale delle pagine di RAM fisica mappate da un processo, comprese quelle condivise con altri processi):

git clone https://github.com/csimmonds/procrank_linux.git

cd procrank_linux && make

sudo ./procrank

Per visualizzare le allocazioni GPU di NvMap (pipelineCUDA) per ciascun processo:

sudo cat /sys/kernel/debug/nvmap/iovmm/clients

4. Eseguire Inference senza display in ambiente di produzione

Per le pipeline di inferenza che non richiedono l'anteprima in tempo reale, disabilitare i componenti relativi alla visualizzazione (Tiler, OSD, DisplaySink) può far risparmiare oltre 200 MB solo a livello della pipeline. Con Ultralytics YOLO, disattivare il visualizzatore e salvare invece i risultati su disco:

Esempio

from ultralytics import YOLO

model = YOLO("yolo11n.engine")

# show=False prevents any display window; save=True writes annotated output to disk

results = model.predict(source="video.mp4", show=False, save=True)

yolo predict model=yolo11n.engine source=video.mp4 show=False save=True

Impatto cumulativo

| Ottimizzazione | Memoria risparmiata (circa) |

|---|---|

| Disattiva l'interfaccia grafica del desktop | circa 865 MB |

| Disattiva i servizi del sistema operativo non utilizzati | circa 32 MB |

| Pipeline di inferenza senza interfaccia grafica (senza display) | circa 200 MB |

| Totale (risultati facili) | circa 1 GB o più |

La combinazione di queste modifiche risulta particolarmente utile quando si utilizzano modelli TensorRT su dispositivi con memoria limitata: può fare la differenza tra riuscire o meno a caricare in memoria una variante del modello più grande.

Prossimi passi

Per ulteriori informazioni e supporto, consultare la documentazione di Ultralytics YOLO26.

FAQ

Come si distribuisce Ultralytics YOLO26 sui dispositivi NVIDIA Jetson?

La distribuzione di Ultralytics YOLO26 sui dispositivi NVIDIA Jetson è un processo semplice. Innanzitutto, eseguire il flashing del dispositivo Jetson con l'SDK NVIDIA JetPack. Quindi, utilizzare un'immagine Docker pre-costruita per una configurazione rapida o installare manualmente i pacchetti richiesti. I passaggi dettagliati per ciascun approccio sono disponibili nelle sezioni Guida rapida con Docker e Inizio con l'installazione nativa.

Quali benchmark di performance posso aspettarmi dai modelli YOLO11 sui dispositivi NVIDIA Jetson?

I modelli YOLO11 sono stati sottoposti a benchmark su vari dispositivi NVIDIA Jetson, mostrando miglioramenti significativi delle prestazioni. Ad esempio, il formato TensorRT offre le migliori prestazioni di inferenza. La tabella nella sezione Tabelle di confronto dettagliate fornisce una visione completa delle metriche di performance come mAP50-95 e tempo di inferenza attraverso diversi formati di modello.

Perché dovrei usare TensorRT per distribuire YOLO26 su NVIDIA Jetson?

TensorRT è altamente raccomandato per la distribuzione dei modelli YOLO26 su NVIDIA Jetson grazie alle sue prestazioni ottimali. Accelera l'inferenza sfruttando le capacità della GPU di Jetson, garantendo massima efficienza e velocità. Ulteriori informazioni su come convertire in TensorRT ed eseguire l'inferenza sono disponibili nella sezione Utilizzare TensorRT su NVIDIA Jetson.

Come posso installare PyTorch e Torchvision su NVIDIA Jetson?

Per installare PyTorch e Torchvision su NVIDIA Jetson, disinstallare prima eventuali versioni esistenti installate tramite pip. Quindi, installare manualmente le versioni compatibili di PyTorch e Torchvision per l'architettura ARM64 di Jetson. Istruzioni dettagliate per questo processo sono fornite nella sezione Installazione di PyTorch e Torchvision.

Quali sono le best practice per massimizzare le prestazioni su NVIDIA Jetson quando si utilizza YOLO26?

Per massimizzare le prestazioni su NVIDIA Jetson con YOLO26, seguire queste best practice:

- Abilita la modalità di massima potenza per utilizzare tutti i core della CPU e della GPU.

- Abilita gli orologi Jetson per eseguire tutti i core alla loro massima frequenza.

- Installa l'applicazione Jetson Stats per monitorare le metriche di sistema.

Per i comandi e ulteriori dettagli, consultare la sezione Best practice quando si utilizza NVIDIA Jetson.

Come posso liberare memoria su NVIDIA per eseguire YOLO più grandi?

La RAM disponibile rappresenta spesso il collo di bottiglia sui dispositivi Jetson con poca memoria. Ecco tre semplici accorgimenti che, messi insieme, consentono di recuperare oltre 1 GB:

- Passa all'avvio headless (

sudo systemctl set-default multi-user.target) per eliminare l'interfaccia grafica del desktop (~865 MB risparmiati). - Disattiva i servizi non utilizzati, come il Bluetooth o i gestori di connettività (risparmio di circa 32 MB).

- Esegui l'inferenza senza visualizzazione impostando

show=Falsenel tuo YOLOpredictchiamata, che evita l'allocazione di memoria nella pipeline di visualizzazione (risparmio di circa 200+ MB).

Usa procrank per analizzare l'utilizzo della RAM per ogni processo e sudo cat /sys/kernel/debug/nvmap/iovmm/clients per controllare GPU . Vedi il Consigli per l'ottimizzazione della memoria Sezione per tutti i dettagli.

Perché l'esportazione TensorRT disabilita la modalità end-to-end su JetPack 6?

TensorRT .3.0, incluso in JetPack 6, presenta un problema noto che impedisce la compilazione del motore INT8 quando end2end=True è abilitata. Quando Ultralytics questa combinazione, disabilita automaticamente il ramo end2end per garantire che l'esportazione vada a buon fine.

Per ripristinare le esportazioni end-to-end in formato INT8, aggiorna TensorRT una versione più recente (ad es. 10.7.0 o successive):

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/arm64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get install -y tensorrt

Dopo l'aggiornamento, riesegui l'esportazione. Per ulteriori dettagli, consulta l'issue GitHub n. 23841.