Plataforma Ultralytics

A Ultralytics Platform é uma plataforma abrangente de visão computacional de ponta a ponta que otimiza todo o fluxo de trabalho de ML, desde a preparação de dados até a implementação do modelo. Desenvolvida para equipes e indivíduos que precisam de soluções de visão computacional prontas para produção, sem a complexidade da infraestrutura.

O que é a Ultralytics Platform?

A Ultralytics Platform foi projetada para substituir ferramentas de ML fragmentadas por uma solução unificada. Ela combina as capacidades de:

- Roboflow - Gerenciamento de dados e anotação

- Weights & Biases - Rastreamento de experimentos

- SageMaker - Treinamento em nuvem

- HuggingFace - Implementação de modelos

- Arize - Monitoramento

Plataforma completa com suporte nativo para modelos YOLO26 e YOLO11.

Fluxo de trabalho: Carregar → Anotar → Treinar → Exportar → Implementar

A Plataforma oferece um fluxo de trabalho de ponta a ponta:

graph LR

subgraph Data["📁 Data"]

A[Upload] --> B[Annotate]

B --> C[Analyze]

end

subgraph Train["🚀 Train"]

D[Configure] --> E[Train on GPU]

E --> F[View Metrics]

end

subgraph Deploy["🌐 Deploy"]

G[Export] --> H[Deploy Endpoint]

H --> I[Monitor]

end

Data --> Train --> Deploy| Etapa | Recursos |

|---|---|

| Carregar | Imagens (50 MB), vídeos (1 GB) e ficheiros de conjuntos de dados (ZIP, TAR, incluindo .tar.gz/.tgz, NDJSON) com processamento automático |

| Anotar | Ferramentas manuais, anotação inteligente SAM, auto-rotulagem YOLO para todos os 5 tipos de tarefa (ver tarefas suportadas) |

| Treinar | GPUs na nuvem (20 gratuitas + 3 exclusivas para Pro), métricas em tempo real, organização de projetos |

| Exportar | 17 formatos de implantação (ONNX, TensorRT, CoreML, TFLite, etc.; veja formatos suportados) |

| Implantação | 43 regiões globais com endpoints dedicados, autoescalonamento, monitoramento |

O que você pode fazer:

- Carregue imagens, vídeos e ficheiros de conjuntos de dados para criar conjuntos de dados de treino

- Visualize anotações com sobreposições interativas para todos os 5 tipos de tarefas YOLO (ver tarefas suportadas)

- Treine modelos em GPUs na nuvem (20 gratuitas, 23 com Pro) com métricas em tempo real

- Exportar para 17 formatos de implantação (ONNX, TensorRT, CoreML, TFLite, etc.)

- Implante em 43 regiões globais com endpoints dedicados de um clique

- Monitore o progresso do treinamento, a saúde da implantação e as métricas de uso

- Colabore tornando projetos e conjuntos de dados públicos para a comunidade

Infraestrutura Multirregional

Seus dados permanecem na sua região. A Ultralytics Platform opera sua infraestrutura em três regiões globais:

| Região | Rótulo | Localização | Ideal Para |

|---|---|---|---|

| EUA | Américas | Iowa, EUA | Usuários das Américas, mais rápido para as Américas |

| UE | Europa, Oriente Médio e África | Bélgica, Europa | Usuários europeus, conformidade com GDPR |

| AP | Ásia-Pacífico | Hong Kong, Ásia-Pacífico | Usuários da Ásia-Pacífico, menor latência APAC |

Você seleciona sua região durante o processo de integração, e todos os seus dados, modelos e implementações permanecem nessa região.

A Região é Permanente

Sua região de dados não pode ser alterada após a criação da conta. Durante o onboarding, a plataforma mede a latência para cada região e recomenda a mais próxima. Escolha com cuidado.

Principais Características

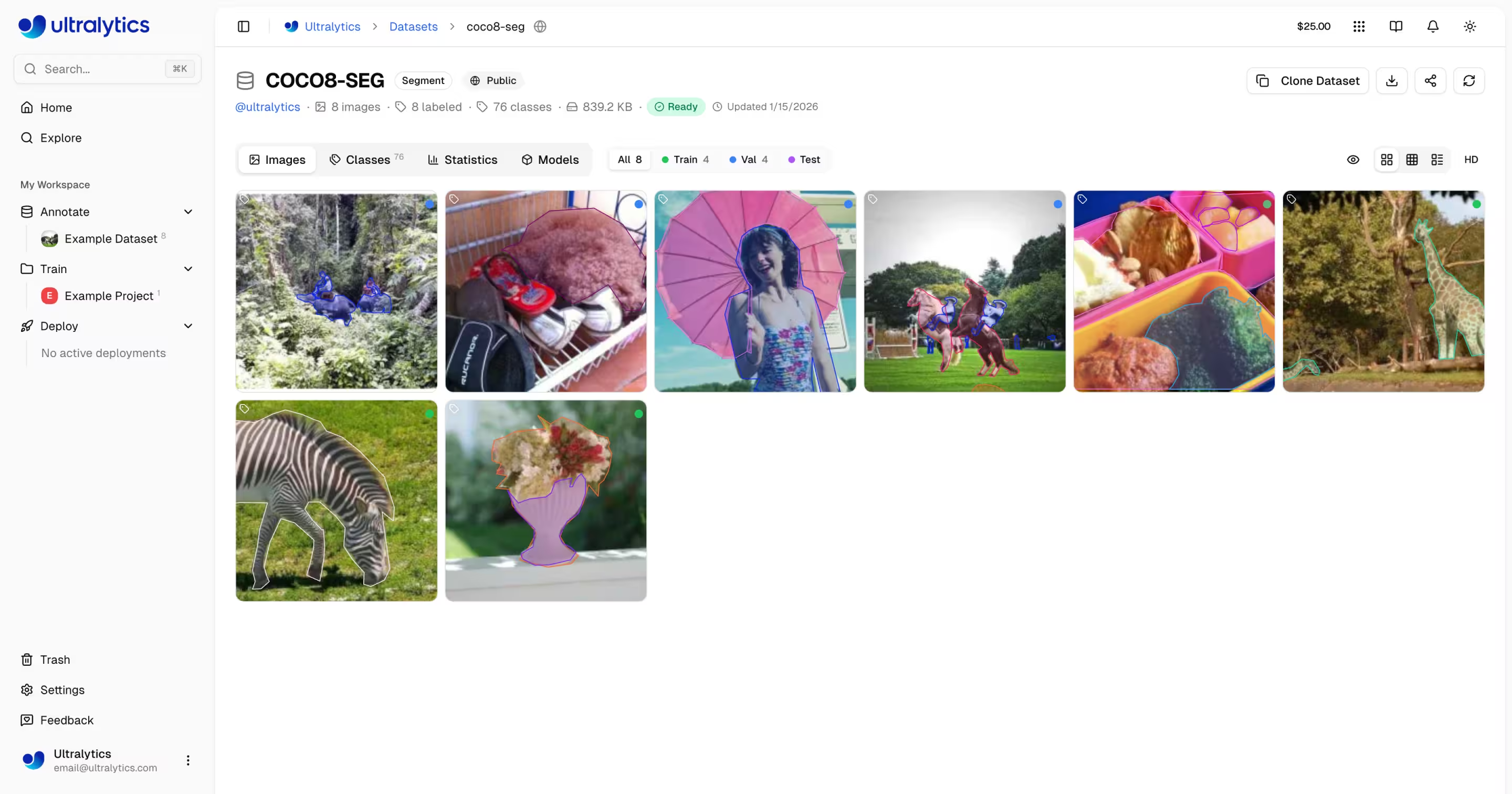

Preparação de Dados

- Gestão de conjuntos de dados: Carregue imagens, vídeos ou ficheiros de conjuntos de dados com processamento automático

- Editor de Anotação: Anotação manual para todos os 5 tipos de tarefas YOLO (detect, segment, pose, obb, classify; veja tarefas suportadas)

- Modelos de Esqueletos: Modelos de esqueletos integrados (Pessoa, Mão, Rosto, Cão, Caixa) e personalizados para anotação de pose com um clique

- Anotação Inteligente SAM: Anotação inteligente baseada em clique com 5 modelos — SAM 2.1 (Tiny, Small, Base, Large) e o novo SAM 3 para a mais alta precisão. Alterne os modelos por imagem na barra de ferramentas de anotação.

- Autoanotação: Use modelos treinados para pré-rotular novos dados

- Versionamento de Conjuntos de Dados: Crie snapshots NDJSON numerados com descrições para treinamento reproduzível

- Estatísticas: Distribuição de classes, mapas de calor de localização e análise de dimensões

graph LR

A[Upload Dataset/Images/Video] --> B[Auto-Process]

B --> C[Browse & Filter]

C --> D{Annotate}

D --> E[Manual Tools]

D --> F[SAM Smart]

D --> G[YOLO Auto-Label]

E --> H[Train-Ready Dataset]

F --> H

G --> HTipos de Tarefas Suportados

O editor de anotações suporta todos os 5 tipos de tarefas YOLO: detect (caixas delimitadoras), segment (polígonos), pose (pontos-chave), OBB (caixas orientadas) e classify (rótulos de nível de imagem). Cada tipo de tarefa possui ferramentas de desenho e atalhos de teclado dedicados.

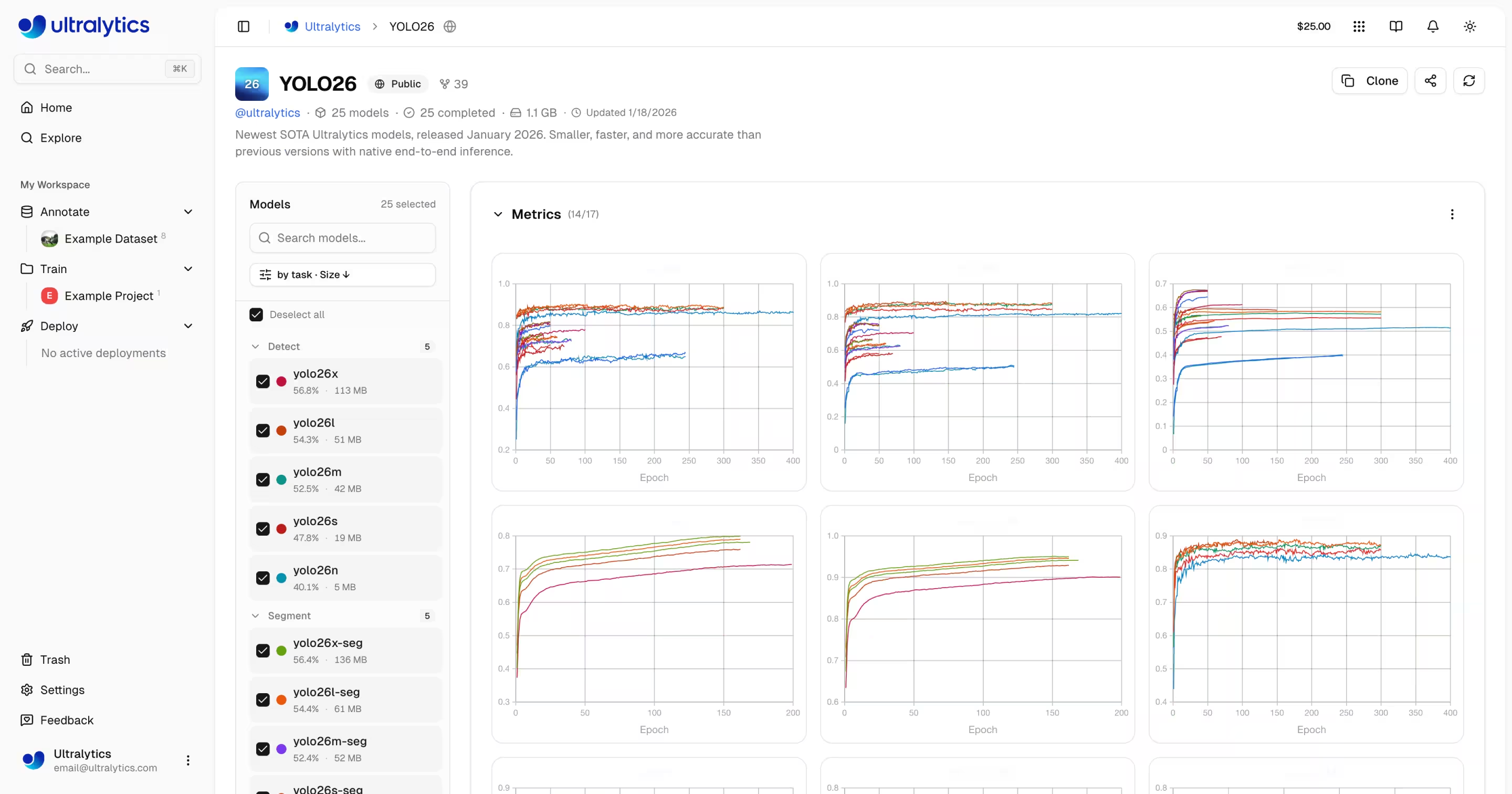

Treinamento de Modelos

- Treinamento na Nuvem: Treine em GPUs na nuvem (20 gratuitas, 23 com Pro) com métricas em tempo real

- Treinamento Remoto: Treine em qualquer lugar e transmita métricas para a plataforma (estilo W&B)

- Organização de Projetos: Agrupe modelos relacionados, compare experimentos e track atividades

- 17 Formatos de Exportação: ONNX, TensorRT, CoreML, TFLite, e mais (ver formatos suportados)

Você pode treinar modelos tanto pela interface web (treinamento em nuvem) quanto a partir de sua própria máquina (treinamento remoto):

- Navegue até seu projeto

- Clique

Train Model - Selecione o conjunto de dados, modelo, GPU e épocas

- Monitorar curvas de perda e métricas em tempo real

# Install ultralytics

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train and stream metrics to the platform

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Metrics stream to Platform automatically

Implantação

- Teste de Inferência: Teste modelos diretamente no navegador com imagens personalizadas

- Endpoints Dedicados: Implante em 43 regiões globais com autoescalabilidade

- Monitoramento: Métricas em tempo real, logs de requisição e painéis de desempenho

graph LR

A[Trained Model] --> B{Action}

B --> C[Browser Predict]

B --> D[Export Format]

B --> E[Deploy Endpoint]

D --> F[ONNX / TensorRT / CoreML / TFLite / ...]

E --> G[43 Global Regions]

G --> H[API Endpoint URL]

H --> I[Monitor & Scale]Uma vez implantado, chame seu endpoint de qualquer linguagem:

import requests

url = "https://your-endpoint-url/predict"

headers = {"Authorization": "Bearer YOUR_API_KEY"}

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, files={"file": f})

print(response.json())

curl -X POST "https://your-endpoint-url/predict" \

-H "Authorization: Bearer YOUR_API_KEY" \

-F "file=@image.jpg"

const form = new FormData();

form.append("file", fileInput.files[0]);

const response = await fetch("https://your-endpoint-url/predict", {

method: "POST",

headers: { Authorization: "Bearer YOUR_API_KEY" },

body: form,

});

const results = await response.json();

console.log(results);

Gerenciamento de Conta

- Equipes e Organizações: Colabore com membros da equipe, gerencie funções e convites

- Chaves de API: Gerenciamento seguro de chaves para treinamento remoto e acesso à API

- Créditos e Faturamento: Treinamento pay-as-you-go com preços transparentes

- Feed de Atividade: track todos os eventos e ações da conta

- Lixeira e Restauração: exclusão suave de 30 dias com recuperação de itens

- Conformidade com GDPR: Exportação de dados e exclusão de conta

Níveis de Plano

| Funcionalidade | Gratuito | Pro (US$ 29/mês) | Empresarial |

|---|---|---|---|

| Crédito de Inscrição | $5 / $25* | - | Personalizado |

| Crédito Mensal | - | $30/assento/mês | Personalizado |

| Modelos | 100 | 500 | Ilimitado |

| Treinamentos Concorrentes | 3 | 10 | Ilimitado |

| Implantações | 3 | 10 | Ilimitado |

| Armazenamento | 100 GB | 500 GB | Ilimitado |

| Tipos de GPU na Nuvem | 20 | 23 (incl. H200/B200) | 23 |

| Equipes | - | Até 5 membros | Até 50 |

| Suporte | Comunidade | Prioridade | Dedicado |

*$5 no cadastro, ou $25 com um e-mail corporativo/de trabalho verificado.

Links Rápidos

Comece com estes recursos:

- Início Rápido: Crie seu primeiro projeto e treine um modelo em minutos

- Conjuntos de Dados: Carregue e gerencie seus dados de treinamento

- Anotação: Rotule seus dados com ferramentas manuais e assistidas por IA

- Projetos: Organize seus modelos e experimentos

- Treinamento na Nuvem: Treine em GPUs na nuvem

- Inferência: Teste seus modelos

- Endpoints: Implante modelos em produção

- Monitoramento: Acompanhar o desempenho da implantação

- Chaves de API: Gerencie o acesso à API

- Faturamento: Créditos e pagamento

- Atividade: track eventos da conta

- Lixeira: Recuperar itens excluídos

- REST API: Referência da API

FAQ

Como começar com a Ultralytics Platform?

Para começar com a Plataforma Ultralytics:

- Cadastre-se: Crie uma conta em platform.ultralytics.com

- Selecione a Região: Escolha sua região de dados (EUA, UE ou AP) durante o processo de integração

- Carregar Conjunto de Dados: Navegue até a seção Conjuntos de Dados para carregar seus dados

- Treinar Modelo: Crie um projeto e comece a treinar em GPUs na nuvem

- Implementar: Teste seu modelo e implemente em um endpoint dedicado

Para um guia detalhado, consulte a página Início Rápido.

Quais são os benefícios da Ultralytics Platform?

Plataforma Ultralytics oferece:

- Fluxo de Trabalho Unificado: Dados, treinamento e implementação em um só lugar

- Multirregião: Residência de dados nas regiões dos EUA, UE ou AP

- Treinamento Sem Código: Treine modelos YOLO avançados sem escrever código

- Métricas em Tempo Real: Transmita o progresso do treinamento e monitore as implementações

- 43 Regiões de Implementação: Implemente modelos perto de seus usuários em todo o mundo

- 5 Tipos de Tarefa: Suporte para detection, segmentation, pose, OBB e classificação (ver documentação das tarefas)

- Anotação Assistida por IA: SAM e rotulagem automática para acelerar a preparação de dados

Quais opções de GPU estão disponíveis para treinamento em nuvem?

A Plataforma Ultralytics suporta vários tipos de GPU para treinamento em nuvem:

| GPU | Geração | VRAM | Custo/Hora | Ideal Para |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Pequenos conjuntos de dados, testes |

| RTX A4500 | Ampere | 20 GB | $0.25 | Conjuntos de dados pequenos e médios |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Conjuntos de dados médios |

| RTX A5000 | Ampere | 24 GB | $0.27 | Conjuntos de dados médios |

| L4 | Ada | 24 GB | $0.39 | Otimizado para inferência |

| A40 | Ampere | 48 GB | $0.40 | Tamanhos de lote maiores |

| RTX 3090 | Ampere | 24 GB | $0.46 | Treinamento geral |

| RTX A6000 | Ampere | 48 GB | $0.49 | Modelos grandes |

| RTX PRO 4500 | Blackwell | 32 GB | $0.54 | Excelente relação preço/desempenho |

| RTX 4090 | Ada | 24 GB | $0.59 | Melhor relação preço/desempenho |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Treinamento com lotes grandes |

| L40S | Ada | 48 GB | $0.86 | Treinamento com lotes grandes |

| RTX 5090 | Blackwell | 32 GB | $0.89 | Última geração para consumidores |

| L40 | Ada | 48 GB | $0.99 | Modelos grandes |

| A100 PCIe | Ampere | 80 GB | $1.39 | Treinamento para produção |

| A100 SXM | Ampere | 80 GB | $1.49 | Treinamento para produção |

| RTX PRO 6000 | Blackwell | 96 GB | $1.69 | Padrão recomendado |

| H100 PCIe | Hopper | 80 GB | $2.39 | Treinamento de alto desempenho |

| H100 SXM | Hopper | 80 GB | $2.69 | Treinamento mais rápido |

| H100 NVL | Hopper | 94 GB | $3.07 | Desempenho máximo |

| H200 NVL | Hopper | 143 GB | $3.39 | Memória máxima (Pro+) |

| H200 SXM | Hopper | 141 GB | $3.59 | Desempenho máximo (Pro+) |

| B200 | Blackwell | 180 GB | $4.99 | Modelos maiores (Pro+) |

Consulte Treinamento em Nuvem para opções completas de preços e GPU.

Como funciona o treinamento remoto?

Você pode treinar modelos em seu próprio hardware e transmitir métricas em tempo real para a plataforma, de forma similar ao Weights & Biases.

Requisito de Versão do Pacote

A integração com a Plataforma requer ultralytics>=8.4.14. Versões anteriores NÃO funcionarão com a Plataforma.

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train with project/name to stream metrics

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Train using a Platform dataset directly

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 project=username/my-project name=exp1

Consulte Treinamento em Nuvem para mais detalhes sobre treinamento remoto.

Quais ferramentas de anotação estão disponíveis?

A Plataforma inclui um editor de anotação completo com suporte para:

- Ferramentas Manuais: Caixas delimitadoras, polígonos, pontos-chave com modelos de esqueleto, caixas orientadas, classificação

- Modelos de Esqueletos: Posicione todos os pontos-chave de uma vez usando modelos integrados (Pessoa, Mão, Rosto, Cão, Caixa) ou personalizados

- Anotação Inteligente SAM: Clique para gerar máscaras precisas — escolha entre SAM 2.1 Tiny/Small/Base/Large ou o novo SAM 3 através do seletor de modelo da barra de ferramentas

- Atalhos de Teclado: Fluxos de trabalho eficientes com teclas de atalho

| Atalho | Ação |

|---|---|

V | Selecione o modo |

S | Modo de anotação inteligente SAM |

A | Modo de autoanotação |

1 - 9 | Selecione a classe pelo número |

Delete | Excluir anotação selecionada |

Ctrl+Z | Desfazer |

Ctrl+Y | Refazer |

Escape | Cancelar ação atual |

Consulte Anotação para o guia completo.

Quais formatos de exportação são suportados?

A Plataforma suporta 17 formatos de implantação:

| Formato | Extensão de Arquivo | Caso de Uso |

|---|---|---|

| ONNX | .onnx | Implantação multiplataforma |

| TorchScript | .torchscript | Implantação em C++ |

| OpenVINO | _openvino_model | hardware Intel |

| TensorRT | .engine | Inferência com GPU NVIDIA |

| CoreML | .mlpackage | dispositivos Apple |

| TFLite | .tflite | Dispositivos móveis/de borda |

| TF SavedModel | _saved_model | Ecossistema TensorFlow |

| TF GraphDef | .pb | TensorFlow legado |

| PaddlePaddle | _paddle_model | Ecossistema Baidu |

| NCNN | _ncnn_model | Móvel (Android/ARM) |

| Edge TPU | _edgetpu.tflite | Dispositivos Google Coral |

| TF.js | _web_model | Implantação em navegador |

| MNN | .mnn | Alibaba mobile |

| RKNN | _rknn_model | NPU Rockchip |

| IMX500 | _imx_model | Sensor Sony IMX500 |

| Axelera | _axelera_model | Aceleradores de IA Axelera |

| ExecuTorch | _executorch_model | PyTorch mobile |

Consulte Models Export, o guia do modo Export e o índice de Integrações para opções específicas de formato.

Resolução de Problemas

Problemas com o conjunto de dados

| Problema | Solução |

|---|---|

| Conjunto de dados não processa | Verifique se o formato do ficheiro é suportado (JPEG, PNG, WebP, etc.). Tamanho máximo do ficheiro: imagens 50 MB, vídeos 1 GB, conjuntos de dados 10 GB na versão Gratuita / 20 GB na versão Pro / 50 GB na versão Enterprise |

| Anotações ausentes | Verifique se os rótulos estão em formato YOLO com .txt arquivos correspondentes aos nomes dos arquivos de imagem |

| "Divisão de treinamento necessária" | Adicionar train/ pasta para a estrutura do seu conjunto de dados, ou crie divisões em configurações do conjunto de dados |

| Nomes de classes indefinidos | Adicionar um data.yaml arquivo com names: lista (ver formato YOLO), ou definir classes nas configurações do conjunto de dados |

Problemas de treinamento

| Problema | Solução |

|---|---|

| O treinamento não será iniciado | Verifique o saldo de créditos em Configurações > Faturamento. Saldo positivo é necessário |

| Erro de falta de memória | Reduza o tamanho do lote (batch size), use um modelo menor (n/s) ou selecione uma GPU com mais VRAM |

| Métricas insatisfatórias | Verifique a qualidade do conjunto de dados, aumente as épocas, experimente aumento de dados (data augmentation), verifique o balanceamento das classes |

| Treinamento lento | Selecione uma GPU mais rápida, reduza o tamanho da imagem, verifique se o conjunto de dados não está causando gargalo |

Problemas de implementação

| Problema | Solução |

|---|---|

| Endpoint não respondendo | Verifique o status do endpoint (Pronto vs Parado). A inicialização a frio pode levar de 5 a 15 segundos |

| 401 Não Autorizado | Verifique se a chave da API está correta e possui os escopos necessários |

| Inferência lenta | Verifique o tamanho do modelo, considere a exportação TensorRT, selecione uma região mais próxima |

| Exportação falhou | Alguns formatos exigem arquiteturas de modelo específicas. Experimente ONNX para a mais ampla compatibilidade |

Perguntas frequentes

Posso alterar meu nome de usuário após o cadastro?

Não, os nomes de usuário são permanentes e não podem ser alterados. Escolha com cuidado durante o cadastro.

Posso alterar a minha região de dados?

Não, a região de dados é selecionada durante o cadastro e não pode ser alterada. Para mudar de região, crie uma nova conta e reenvie seus dados.

Como consigo mais créditos?

Vá para Configurações > Faturamento > Adicionar Créditos. Compre créditos de $5 a $1000. Créditos comprados nunca expiram.

O que acontece se o treinamento falhar?

Você só é cobrado pelo tempo de computação concluído. Os checkpoints são salvos e você pode retomar o treinamento.

Posso baixar meu modelo treinado?

Sim, clique no ícone de download em qualquer página de modelo para baixar o .pt arquivo ou formatos exportados.

Como partilho o meu trabalho publicamente?

Edite as configurações do seu projeto ou conjunto de dados e alterne a visibilidade para "Público". O conteúdo público aparece na página Explorar.

Quais são os limites de tamanho dos ficheiros?

Imagens: 50 MB, Vídeos: 1 GB, conjuntos de dados: 10 GB na versão Gratuita, 20 GB na versão Pro, 50 GB na versão Enterprise. Para ficheiros maiores, divida-os em vários envios.

Por quanto tempo os itens eliminados são mantidos na Lixeira?

30 dias. Após esse período, os itens são permanentemente eliminados e não podem ser recuperados.

Posso usar modelos da Plataforma comercialmente?

Os planos Gratuito e Pro utilizam a licença AGPL. Para uso comercial sem os requisitos da AGPL, contacte sales@ultralytics.com para licenciamento Empresarial.