Link to this sectionModelos suportados pela Ultralytics#

Bem-vindo à documentação de modelos da Ultralytics! Oferecemos suporte para uma ampla gama de modelos, cada um adaptado a tarefas específicas como detecção de objetos, segmentação de instâncias, segmentação semântica, classificação de imagens, estimativa de pose e rastreamento de múltiplos objetos. Se tiver interesse em contribuir com a arquitetura do seu modelo para a Ultralytics, confira nosso Guia de Contribuição.

Link to this sectionModelos em Destaque#

Aqui estão alguns dos principais modelos suportados:

- YOLOv3: A terceira iteração da família de modelos YOLO, originalmente de Joseph Redmon, conhecida por suas capacidades eficientes de detecção de objetos em tempo real.

- YOLOv4: Uma atualização nativa do darknet para o YOLOv3, lançada por Alexey Bochkovskiy em 2020.

- YOLOv5: Uma versão aprimorada da arquitetura YOLO pela Ultralytics, oferecendo melhores compensações de desempenho e velocidade em comparação com as versões anteriores.

- YOLOv6: Lançado pela Meituan em 2022 e em uso em muitos dos robôs de entrega autônomos da empresa.

- YOLOv7: Modelos YOLO atualizados lançados em 2022 pelos autores do YOLOv4. Apenas a inferência é suportada.

- YOLOv8: Um modelo versátil com capacidades aprimoradas, como segmentação de instâncias, estimativa de pose/pontos-chave e classificação.

- YOLOv9: Um modelo experimental treinado na base de código do YOLOv5 da Ultralytics, implementando Informação de Gradiente Programável (PGI).

- YOLOv10: Da Universidade Tsinghua, apresentando treinamento livre de NMS e uma arquitetura orientada pela eficiência e precisão, entregando desempenho e latência de ponta.

- YOLO11: Modelos YOLO da Ultralytics que entregam alto desempenho em múltiplas tarefas, incluindo detecção, segmentação, estimativa de pose, rastreamento e classificação.

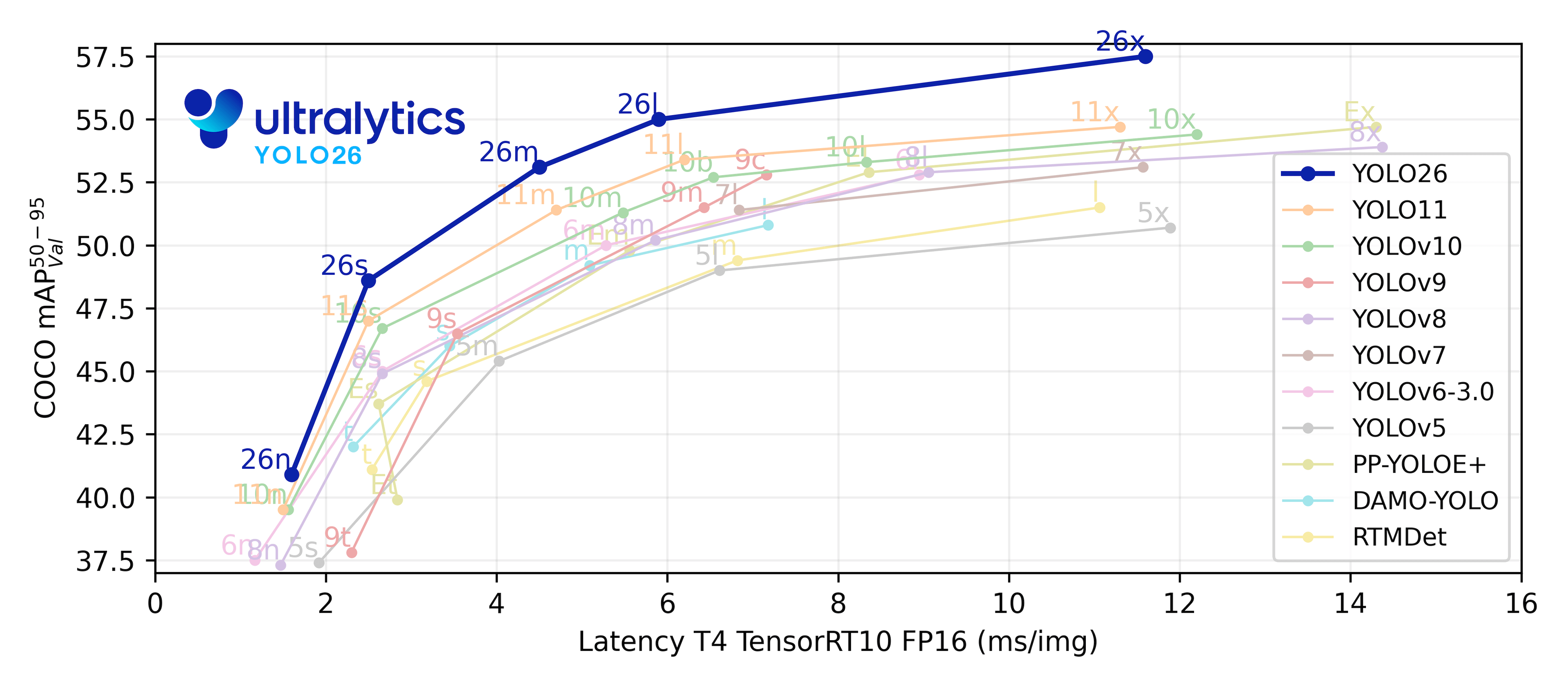

- YOLO26 🚀 NOVO: O mais recente modelo YOLO de próxima geração da Ultralytics, otimizado para implantação na borda (edge) com inferência end-to-end livre de NMS.

- Segment Anything Model (SAM): O Segment Anything Model (SAM) original da Meta.

- Segment Anything Model 2 (SAM2): A próxima geração do Segment Anything Model da Meta para vídeos e imagens.

- Segment Anything Model 3 (SAM3) 🚀 NOVO: A terceira geração do Segment Anything Model da Meta com Segmentação de Conceito Promptável para texto e segmentação baseada em exemplares de imagem.

- Mobile Segment Anything Model (MobileSAM): MobileSAM para aplicações móveis, da Universidade Kyung Hee.

- Fast Segment Anything Model (FastSAM): FastSAM do Grupo de Análise de Imagem e Vídeo, Instituto de Automação, Academia Chinesa de Ciências.

- YOLO-NAS: Modelos YOLO Neural Architecture Search (NAS).

- Real-Time Detection Transformers (RT-DETR): Modelos de Transformer de detecção em tempo real PaddlePaddle da Baidu (RT-DETR).

- YOLO-World: Modelos de Detecção de Objetos de Vocabulário Aberto em tempo real do Tencent AI Lab.

- YOLOE: Um detector de objetos de vocabulário aberto aprimorado que mantém o desempenho em tempo real do YOLO enquanto detecta classes arbitrárias além dos seus dados de treinamento.

Watch: Run Ultralytics YOLO models in just a few lines of code.

Link to this sectionPrimeiros Passos: Exemplos de Uso#

Este exemplo fornece exemplos simples de treinamento e inferência YOLO. Para a documentação completa sobre estes e outros modos, consulte as páginas de documentação de Predict, Train, Val e Export.

Observe que o exemplo abaixo destaca os modelos Detect do YOLO11 para detecção de objetos. Para outras tarefas suportadas, consulte as documentações de Segment, Classify e Pose.

PyTorch pretrained *.pt models as well as configuration *.yaml files can be passed to the YOLO(), SAM(), NAS() and RTDETR() classes to create a model instance in Python:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")Link to this sectionContribuindo com Novos Modelos#

Interessado em contribuir com o seu modelo para a Ultralytics? Ótimo! Estamos sempre abertos a expandir nosso portfólio de modelos.

-

Faça um Fork do Repositório: Comece fazendo um fork do repositório GitHub da Ultralytics.

-

Clone Seu Fork: Clone seu fork para sua máquina local e crie uma nova branch para trabalhar.

-

Implemente Seu Modelo: Adicione seu modelo seguindo os padrões de codificação e diretrizes fornecidos no nosso Guia de Contribuição.

-

Teste Exaustivamente: Certifique-se de testar seu modelo rigorosamente, tanto isoladamente quanto como parte do pipeline.

-

Crie um Pull Request: Assim que estiver satisfeito com seu modelo, crie um pull request para o repositório principal para revisão.

-

Revisão de Código & Fusão: Após a revisão, se seu modelo atender aos nossos critérios, ele será mesclado ao repositório principal.

Para etapas detalhadas, consulte nosso Guia de Contribuição.

Link to this sectionFAQ#

Link to this sectionQual é o modelo Ultralytics YOLO mais recente?#

O modelo Ultralytics YOLO mais recente é o YOLO26, lançado em janeiro de 2026. O YOLO26 apresenta inferência end-to-end livre de NMS, implantação otimizada para borda (edge) e suporta detecção, segmentação de instâncias, segmentação semântica, classificação, estimativa de pose e OBB, além de versões de vocabulário aberto. Para cargas de trabalho de produção estáveis, tanto o YOLO26 quanto o YOLO11 são escolhas recomendadas.

Link to this sectionComo posso treinar um modelo YOLO em dados personalizados?#

Treinar um modelo YOLO em dados personalizados pode ser facilmente realizado usando as bibliotecas da Ultralytics. Aqui está um exemplo rápido:

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)Para instruções mais detalhadas, visite a página de documentação Train.

Link to this sectionQuais versões do YOLO são suportadas pela Ultralytics?#

A Ultralytics suporta uma gama abrangente de versões do YOLO (You Only Look Once), desde o YOLOv3 até o YOLO26, junto com modelos como YOLO-NAS, SAM e RT-DETR. Cada versão é otimizada para várias tarefas, como detecção, segmentação, segmentação semântica e classificação. Para informações detalhadas sobre cada modelo, consulte a documentação de Modelos Suportados pela Ultralytics.

Link to this sectionPor que devo usar a Plataforma Ultralytics para projetos de machine learning?#

A Plataforma Ultralytics fornece uma plataforma no-code end-to-end para treinar, implantar e gerenciar modelos YOLO. Ela simplifica fluxos de trabalho complexos, permitindo que os usuários se concentrem no desempenho e na aplicação do modelo. O HUB também oferece capacidades de treinamento em nuvem, gerenciamento abrangente de conjuntos de dados e interfaces amigáveis tanto para iniciantes quanto para desenvolvedores experientes.

Link to this sectionQue tipos de tarefas os modelos Ultralytics YOLO podem realizar?#

Os modelos Ultralytics YOLO são versáteis e podem realizar tarefas que incluem detecção de objetos, segmentação de instâncias, segmentação semântica, classificação, estimativa de pose e detecção de objetos orientados (OBB). O modelo mais recente, YOLO26, suporta todas as seis tarefas, além de detecção de vocabulário aberto. Para detalhes sobre tarefas específicas, consulte as páginas de Tarefas.