COCO-segment 数据集

The COCO-segment数据集是 COCO(通用对象上下文)数据集的扩展,专门设计用于辅助目标实例 segmentation研究。它使用与 COCO 相同的图像,但引入了更详细的 segmentation 注释。该数据集对于从事实例 segmentation 任务的研究人员和开发人员来说是一个至关重要的资源,特别是用于训练Ultralytics YOLO模型。

COCO-segment 预训练模型

| 模型 | 尺寸 (像素) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | 速度 CPU ONNX (毫秒) | 速度 T4 TensorRT10 (毫秒) | 参数 (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

主要功能

- COCO-segment 保留了来自 COCO 的原始 33 万张图像。

- 该数据集包含与原始 COCO 数据集中相同的 80 个对象类别。

- 现在,标注包括图像中每个对象更详细的实例分割掩码。

- COCO-segment 提供了标准化的评估指标,例如用于目标 detect 的平均精度 (mAP),以及用于实例 segment 任务的平均召回率 (mAR),从而能够有效比较模型性能。

数据集结构

COCO-Seg 数据集分为三个子集:

- Train2017:11.8万张图像,用于训练实例segment模型。

- Val2017: 5K张图像,用于模型开发期间的验证。

- Test2017:2万张图像用于基准测试。此子集的真实标注不公开,因此预测结果必须提交到 COCO 评估服务器进行评分。

应用

COCO-segment 广泛用于训练和评估实例 segment 中的深度学习模型,例如 YOLO 模型。大量的标注图像、多样的目标类别以及标准化的评估指标使其成为计算机视觉研究人员和从业者的不可或缺的资源。

数据集 YAML

YAML(Yet Another Markup Language)文件用于定义数据集配置。它包含数据集的路径、类别及其他相关信息。对于COCO分割数据集, coco.yaml 文件保存在 https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco.yaml.

ultralytics/cfg/datasets/coco.yaml

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco # dataset root dir

train: train2017.txt # train images (relative to 'path') 118287 images

val: val2017.txt # val images (relative to 'path') 5000 images

test: test-dev2017.txt # 20288 of 40670 images, submit to https://competitions.codalab.org/competitions/20794

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

segments = True # segment or box labels

dir = Path(yaml["path"]) # dataset root dir

urls = [ASSETS_URL + ("/coco2017labels-segments.zip" if segments else "/coco2017labels.zip")] # labels

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)

用法

要在 COCO-Seg 数据集上训练 YOLO26n-seg 模型 100 个 epoch,图像尺寸为 640,您可以使用以下代码片段。有关可用参数的完整列表,请参阅模型训练页面。

训练示例

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)

# Start training from a pretrained *.pt model

yolo segment train data=coco.yaml model=yolo26n-seg.pt epochs=100 imgsz=640

Sample Images 和注释

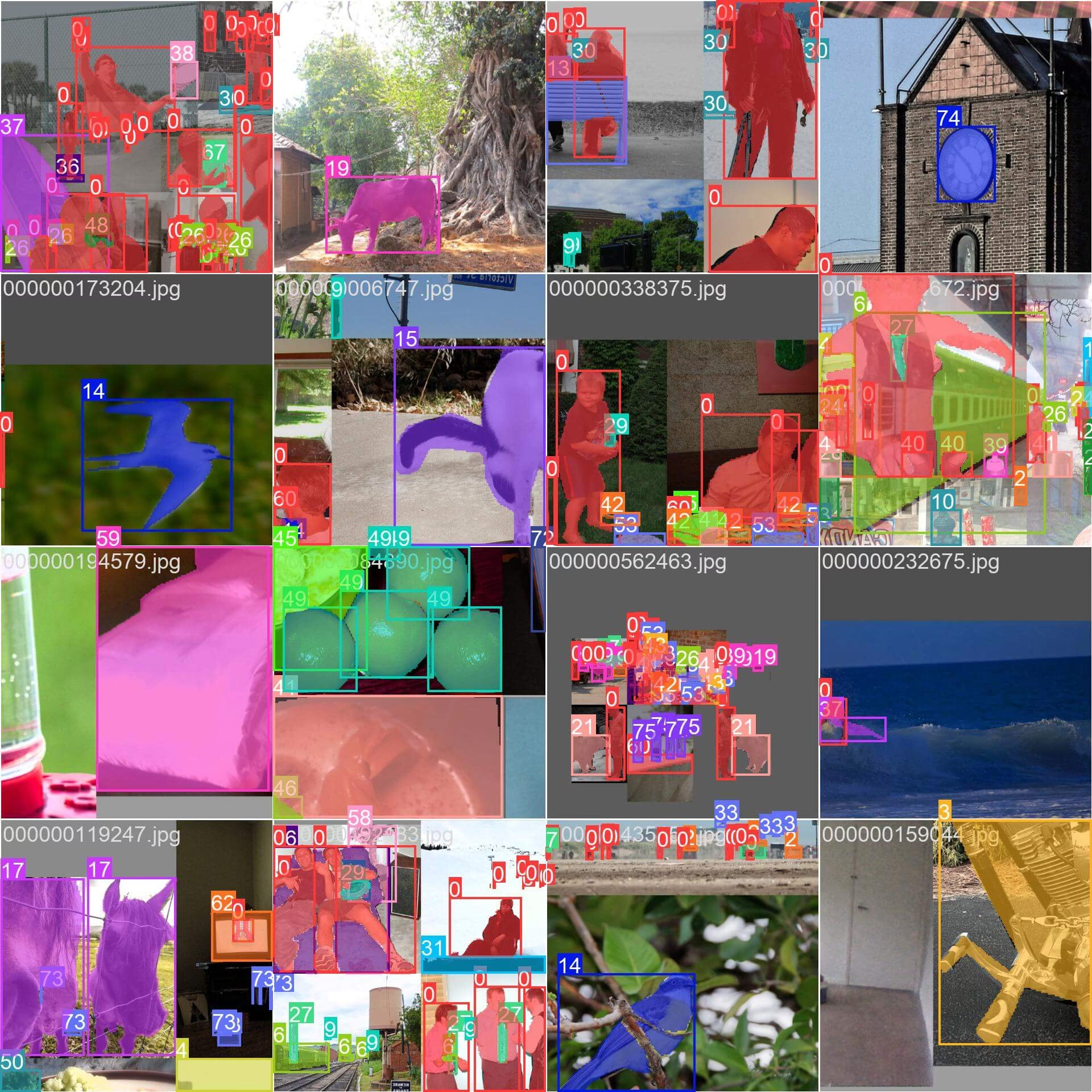

COCO-segment,与其前身 COCO 一样,包含多样化的图像集,具有各种目标类别和复杂场景。然而,COCO-segment 为图像中的每个目标引入了更详细的实例 segment 掩码。以下是该数据集中的一些图像示例,以及它们对应的实例 segment 掩码:

- 马赛克图像: 此图像展示了一个由马赛克数据集图像组成的训练批次。马赛克处理是一种在训练期间使用的技术,它将多个图像组合成一个图像,以增加每个训练批次中对象和场景的多样性。这有助于模型泛化到不同的对象大小、纵横比和上下文。

该示例展示了 COCO-Seg 数据集中图像的多样性和复杂性,以及在训练过程中使用马赛克增强的好处。

引用和致谢

如果您在研究或开发工作中使用 COCO-Seg 数据集,请引用原始 COCO 论文并致谢对 COCO-Seg 的扩展:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

我们感谢 COCO 联盟为计算机视觉社区创建和维护这一宝贵资源。有关 COCO 数据集及其创建者的更多信息,请访问 COCO 数据集网站。

常见问题

COCO-Seg数据集是什么,它与原始COCO数据集有何不同?

The COCO-segment数据集是原始 COCO(通用对象上下文)数据集的扩展,专门为实例 segmentation 任务设计。虽然它使用与 COCO 数据集相同的图像,但 COCO-segment 包含更详细的 segmentation 注释,使其成为专注于目标实例 segmentation的研究人员和开发人员的强大资源。

我如何使用 COCO-Seg 数据集训练 YOLO26 模型?

要在 COCO-Seg 数据集上训练 YOLO26n-seg 模型 100 个 epoch,图像尺寸为 640,您可以使用以下代码片段。有关可用参数的详细列表,请参阅模型训练页面。

训练示例

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)

# Start training from a pretrained *.pt model

yolo segment train data=coco.yaml model=yolo26n-seg.pt epochs=100 imgsz=640

COCO-Seg数据集的主要特性是什么?

COCO-Seg 数据集包含几个主要特性:

- 保留来自 COCO 数据集的原始33万张图像。

- 标注了与原始 COCO 中相同的 80 个目标类别。

- 为每个对象提供更详细的实例分割掩码。

- 使用标准化评估指标,例如用于目标检测的平均精度 (mAP) 和用于实例分割任务的平均召回率 (mAR)。

COCO-Seg有哪些可用的预训练模型,它们的性能指标是什么?

COCO-Seg 数据集支持多种预训练的 YOLO26 segment 模型,具有不同的性能指标。以下是可用模型及其关键指标的摘要:

| 模型 | 尺寸 (像素) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | 速度 CPU ONNX (毫秒) | 速度 T4 TensorRT10 (毫秒) | 参数 (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

这些模型从轻量级的 YOLO26n-seg 到更强大的 YOLO26x-seg,在速度和准确性之间提供了不同的权衡,以适应各种应用需求。有关模型选择的更多信息,请访问Ultralytics 模型页面。

COCO-segment数据集的结构是怎样的,它包含哪些子集?

COCO-Seg 数据集分为三个子集,以满足特定的训练和评估需求:

- Train2017:包含118K图像,主要用于训练实例分割模型。

- Val2017:包含5K图像,用于训练过程中的验证。

- Test2017:包含2万张图像,专用于测试和基准测试训练模型。请注意,此子集的真实标注不公开,性能结果将提交到 COCO 评估服务器进行评估。

对于较小的实验需求,您也可以考虑使用COCO8-seg数据集,这是一个紧凑版本,仅包含COCO train 2017集中的8张图像。