Link to this sectionDataset COCO-Seg#

El dataset COCO-Seg, una extensión del dataset COCO (Common Objects in Context), está diseñado específicamente para ayudar en la investigación de la segmentación de instancias de objetos. Utiliza las mismas imágenes que COCO, pero incorpora anotaciones de segmentación más detalladas. Este dataset es un recurso fundamental para investigadores y desarrolladores que trabajan en tareas de segmentación de instancias, especialmente para entrenar modelos de Ultralytics YOLO.

Link to this sectionModelos preentrenados de COCO-Seg#

| Modelo | tamaño (píxeles) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Velocidad CPU ONNX (ms) | Velocidad T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Link to this sectionCaracterísticas clave#

- COCO-Seg conserva las 330K imágenes originales de COCO.

- El dataset consta de las mismas 80 categorías de objetos presentes en el dataset COCO original.

- Las anotaciones ahora incluyen máscaras de segmentación de instancias más detalladas para cada objeto en las imágenes.

- COCO-Seg proporciona métricas de evaluación estandarizadas como la precisión media (mAP) para la detección de objetos y el recuerdo medio (mAR) para tareas de segmentación de instancias, lo que permite comparar eficazmente el rendimiento de los modelos.

Link to this sectionEstructura del dataset#

El dataset COCO-Seg se divide en tres subconjuntos:

- Train2017: 118K imágenes para entrenar modelos de segmentación de instancias.

- Val2017: 5K imágenes utilizadas para la validación durante el desarrollo del modelo.

- Test2017: 20K imágenes utilizadas para evaluación. Las anotaciones de verdad fundamental (ground-truth) para este subconjunto no están disponibles públicamente, por lo que las predicciones deben enviarse al servidor de evaluación de COCO para su puntuación.

Link to this sectionAplicaciones#

COCO-Seg se utiliza ampliamente para entrenar y evaluar modelos de deep learning en segmentación de instancias, como los modelos YOLO. La gran cantidad de imágenes anotadas, la diversidad de categorías de objetos y las métricas de evaluación estandarizadas lo convierten en un recurso indispensable para investigadores y profesionales de la visión artificial.

Link to this sectionYAML del dataset#

Se utiliza un archivo YAML (Yet Another Markup Language) para definir la configuración del dataset. Contiene información sobre las rutas del dataset, clases y otros datos relevantes. En el caso del dataset COCO-Seg, el archivo coco.yaml se mantiene en https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco # dataset root dir

train: train2017.txt # train images (relative to 'path') 118287 images

val: val2017.txt # val images (relative to 'path') 5000 images

test: test-dev2017.txt # 20288 of 40670 images, submit via https://cocodataset.org/#detection-eval

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

segments = True # segment or box labels

dir = Path(yaml["path"]) # dataset root dir

urls = [ASSETS_URL + ("/coco2017labels-segments.zip" if segments else "/coco2017labels.zip")] # labels

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)Link to this sectionUso#

Para entrenar un modelo YOLO26n-seg en el dataset COCO-Seg durante 100 épocas con un tamaño de imagen de 640, puedes usar los siguientes fragmentos de código. Para obtener una lista completa de los argumentos disponibles, consulta la página de Entrenamiento del modelo.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionMuestras de imágenes y anotaciones#

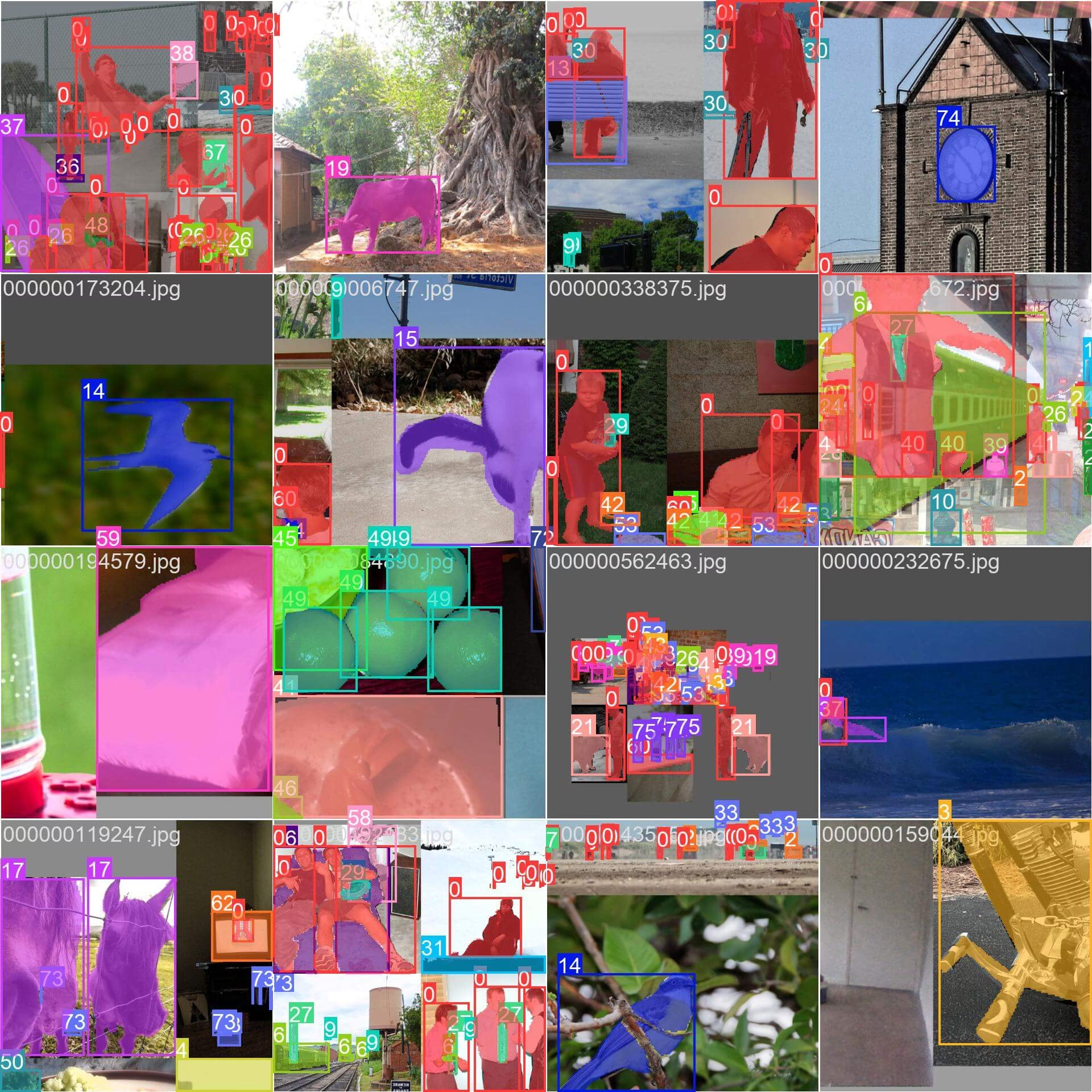

COCO-Seg, al igual que su predecesor COCO, contiene un conjunto diverso de imágenes con varias categorías de objetos y escenas complejas. Sin embargo, COCO-Seg introduce máscaras de segmentación de instancias más detalladas para cada objeto en las imágenes. Aquí tienes algunos ejemplos de imágenes del dataset, junto con sus correspondientes máscaras de segmentación de instancias:

- Imagen en mosaico: Esta imagen demuestra un lote de entrenamiento compuesto por imágenes del dataset en mosaico. El mosaico es una técnica utilizada durante el entrenamiento que combina varias imágenes en una sola para aumentar la variedad de objetos y escenas dentro de cada lote de entrenamiento. Esto ayuda a la capacidad del modelo para generalizar a diferentes tamaños de objeto, relaciones de aspecto y contextos.

El ejemplo muestra la variedad y complejidad de las imágenes en el dataset COCO-Seg y los beneficios de usar mosaicos durante el proceso de entrenamiento.

Link to this sectionCitas y agradecimientos#

Si utilizas el dataset COCO-Seg en tu trabajo de investigación o desarrollo, por favor cita el documento original de COCO y reconoce la extensión a COCO-Seg:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Extendemos nuestro agradecimiento al Consorcio COCO por crear y mantener este recurso invaluable para la comunidad de visión artificial. Para obtener más información sobre el dataset COCO y sus creadores, visita el sitio web del dataset COCO.

Link to this sectionFAQ#

Link to this section¿Qué es el dataset COCO-Seg y en qué se diferencia del dataset COCO original?#

El dataset COCO-Seg es una extensión del dataset COCO (Common Objects in Context) original, diseñado específicamente para tareas de segmentación de instancias. Aunque utiliza las mismas imágenes que el dataset COCO, COCO-Seg incluye anotaciones de segmentación más detalladas, lo que lo convierte en un recurso potente para investigadores y desarrolladores que se centran en la segmentación de instancias de objetos.

Link to this section¿Cómo puedo entrenar un modelo YOLO26 usando el dataset COCO-Seg?#

Para entrenar un modelo YOLO26n-seg en el dataset COCO-Seg durante 100 épocas con un tamaño de imagen de 640, puedes usar los siguientes fragmentos de código. Para obtener una lista detallada de los argumentos disponibles, consulta la página de Entrenamiento del modelo.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this section¿Cuáles son las características clave del dataset COCO-Seg?#

El dataset COCO-Seg incluye varias características clave:

- Conserva las 330K imágenes originales del dataset COCO.

- Anota las mismas 80 categorías de objetos encontradas en el COCO original.

- Proporciona máscaras de segmentación de instancias más detalladas para cada objeto.

- Utiliza métricas de evaluación estandarizadas como la media de precisión (mAP) para la detección de objetos y la media de recuerdo (mAR) para tareas de segmentación de instancias.

Link to this section¿Qué modelos preentrenados están disponibles para COCO-Seg y cuáles son sus métricas de rendimiento?#

El dataset COCO-Seg admite múltiples modelos de segmentación YOLO26 preentrenados con diferentes métricas de rendimiento. Aquí tienes un resumen de los modelos disponibles y sus métricas clave:

| Modelo | tamaño (píxeles) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Velocidad CPU ONNX (ms) | Velocidad T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Estos modelos van desde el ligero YOLO26n-seg hasta el más potente YOLO26x-seg, ofreciendo diferentes compromisos entre velocidad y precisión para adaptarse a diversos requisitos de aplicación. Para obtener más información sobre la selección de modelos, visita la página de modelos de Ultralytics.

Link to this section¿Cómo está estructurado el dataset COCO-Seg y qué subconjuntos contiene?#

El dataset COCO-Seg se divide en tres subconjuntos para necesidades específicas de entrenamiento y evaluación:

- Train2017: Contiene 118K imágenes utilizadas principalmente para entrenar modelos de segmentación de instancias.

- Val2017: Comprende 5K imágenes utilizadas para la validación durante el proceso de entrenamiento.

- Test2017: Abarca 20K imágenes reservadas para pruebas y evaluación comparativa de modelos entrenados. Ten en cuenta que las anotaciones de verdad fundamental para este subconjunto no están disponibles públicamente y los resultados de rendimiento se envían al servidor de evaluación de COCO para su valoración.

Para necesidades de experimentación más pequeñas, también podrías considerar el uso del dataset COCO8-seg, que es una versión compacta que contiene solo 8 imágenes del conjunto COCO train 2017.