Conjunto de Dados COCO-Seg

O dataset COCO-Seg, uma extensão do dataset COCO (Common Objects in Context), é especialmente projetado para auxiliar na pesquisa em segmentação de instâncias de objetos. Ele usa as mesmas imagens do COCO, mas introduz anotações de segmentação mais detalhadas. Este dataset é um recurso crucial para pesquisadores e desenvolvedores que trabalham em tarefas de segmentação de instâncias, especialmente para treinar modelos Ultralytics YOLO.

Modelos Pré-Treinados COCO-Seg

| Modelo | tamanho (pixels) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Velocidade CPU ONNX (ms) | Velocidade T4 TensorRT10 (ms) | parâmetros (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Principais Características

- COCO-Seg retém as 330 mil imagens originais do COCO.

- O conjunto de dados consiste nas mesmas 80 categorias de objetos encontradas no conjunto de dados COCO original.

- As anotações agora incluem máscaras de segmentação de instância mais detalhadas para cada objeto nas imagens.

- COCO-Seg fornece métricas de avaliação padronizadas como mean Average Precision (mAP) para object detection e mean Average Recall (mAR) para tarefas de instance segmentation, permitindo uma comparação eficaz do desempenho do modelo.

Estrutura do Conjunto de Dados

O conjunto de dados COCO-Seg é dividido em três subconjuntos:

- Train2017: 118 mil imagens para treinar modelos de segmentação de instâncias.

- Val2017: 5 mil imagens usadas para validação durante o desenvolvimento do modelo.

- Test2017: 20 mil imagens usadas para benchmarking. As anotações de ground-truth para este subconjunto não estão disponíveis publicamente, portanto, as previsões devem ser submetidas ao servidor de avaliação COCO para pontuação.

Aplicações

COCO-Seg é amplamente utilizado para treinar e avaliar modelos de deep learning em instance segmentation, como os modelos YOLO. O grande número de imagens anotadas, a diversidade de categorias de objetos e as métricas de avaliação padronizadas tornam-no um recurso indispensável para pesquisadores e profissionais de computer vision.

YAML do Conjunto de Dados

Um arquivo YAML (Yet Another Markup Language) é usado para definir a configuração do conjunto de dados. Ele contém informações sobre os caminhos, classes e outras informações relevantes do conjunto de dados. No caso do conjunto de dados COCO-Seg, o coco.yaml arquivo é mantido em https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco.yaml.

ultralytics/cfg/datasets/coco.yaml

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco # dataset root dir

train: train2017.txt # train images (relative to 'path') 118287 images

val: val2017.txt # val images (relative to 'path') 5000 images

test: test-dev2017.txt # 20288 of 40670 images, submit to https://competitions.codalab.org/competitions/20794

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

segments = True # segment or box labels

dir = Path(yaml["path"]) # dataset root dir

urls = [ASSETS_URL + ("/coco2017labels-segments.zip" if segments else "/coco2017labels.zip")] # labels

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)

Utilização

Para treinar um modelo YOLO26n-seg no conjunto de dados COCO-Seg por 100 épocas com um tamanho de imagem de 640, você pode usar os seguintes trechos de código. Para uma lista abrangente de argumentos disponíveis, consulte a página de Treinamento do modelo.

Exemplo de Treinamento

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)

# Start training from a pretrained *.pt model

yolo segment train data=coco.yaml model=yolo26n-seg.pt epochs=100 imgsz=640

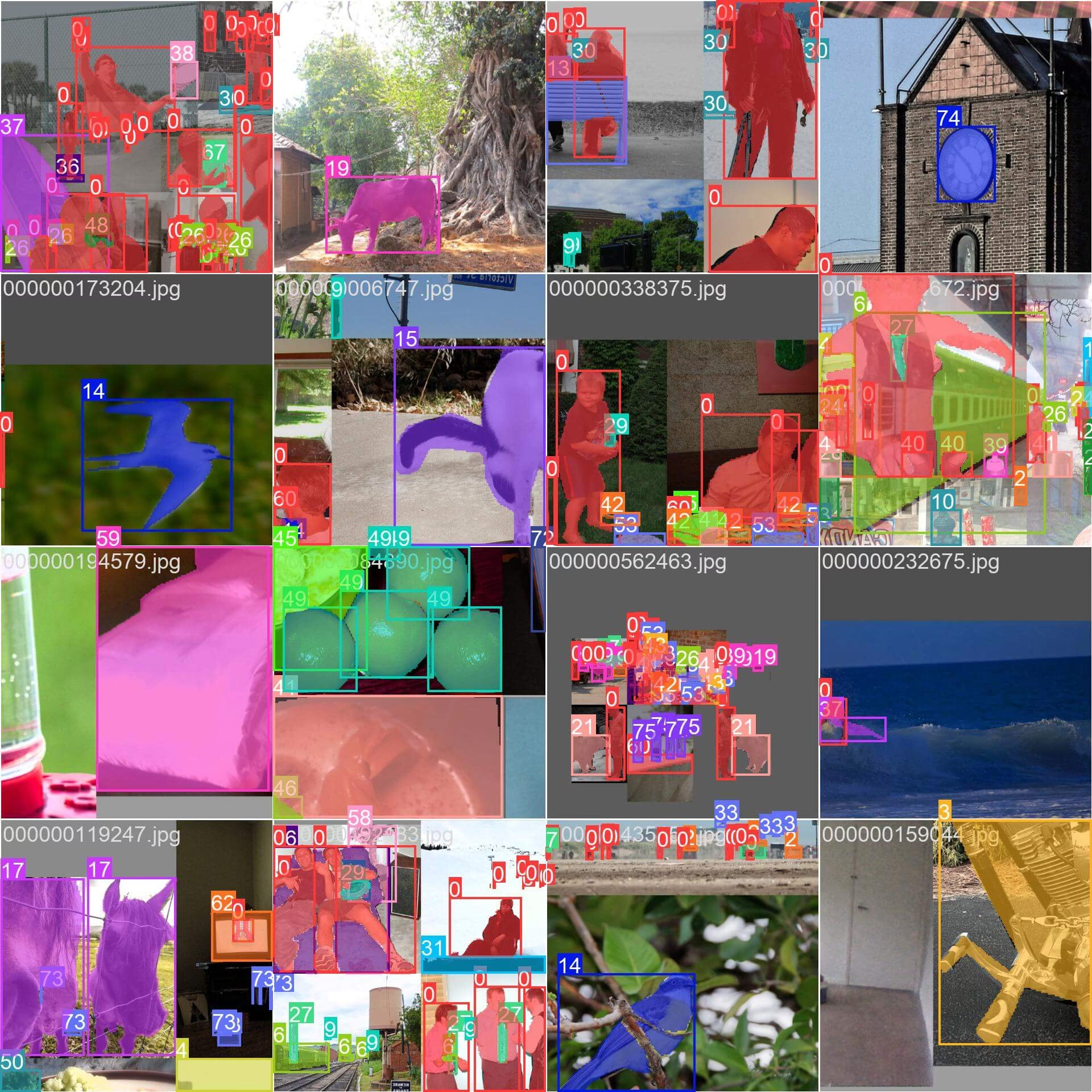

Amostras de Imagens e Anotações

COCO-Seg, assim como seu predecessor COCO, contém um conjunto diversificado de imagens com várias categorias de objetos e cenas complexas. No entanto, COCO-Seg introduz máscaras de segmentação de instância mais detalhadas para cada objeto nas imagens. Aqui estão alguns exemplos de imagens do conjunto de dados, juntamente com suas máscaras de segmentação de instância correspondentes:

- Imagem em Mosaico: Esta imagem demonstra um lote de treinamento composto por imagens de conjunto de dados em mosaico. O Mosaico é uma técnica usada durante o treinamento que combina várias imagens em uma única imagem para aumentar a variedade de objetos e cenas em cada lote de treinamento. Isso auxilia na capacidade do modelo de generalizar para diferentes tamanhos de objetos, proporções e contextos.

O exemplo mostra a variedade e complexidade das imagens no dataset COCO-Seg e os benefícios de usar mosaicos durante o processo de treinamento.

Citações e Agradecimentos

Se você usar o dataset COCO-Seg em seu trabalho de pesquisa ou desenvolvimento, cite o artigo COCO original e reconheça a extensão para COCO-Seg:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

Agradecemos ao COCO Consortium por criar e manter este recurso inestimável para a comunidade de visão computacional. Para obter mais informações sobre o conjunto de dados COCO e seus criadores, visite o site do conjunto de dados COCO.

FAQ

O que é o conjunto de dados COCO-Seg e como ele difere do conjunto de dados COCO original?

O dataset COCO-Seg é uma extensão do dataset COCO (Common Objects in Context) original, projetada especificamente para tarefas de segmentação de instâncias. Embora use as mesmas imagens do dataset COCO, o COCO-Seg inclui anotações de segmentação mais detalhadas, tornando-o um recurso poderoso para pesquisadores e desenvolvedores que se concentram na segmentação de instâncias de objetos.

Como posso treinar um modelo YOLO26 usando o conjunto de dados COCO-Seg?

Para treinar um modelo YOLO26n-seg no conjunto de dados COCO-Seg por 100 épocas com um tamanho de imagem de 640, você pode usar os seguintes trechos de código. Para uma lista detalhada de argumentos disponíveis, consulte a página de Treinamento do modelo.

Exemplo de Treinamento

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)

# Start training from a pretrained *.pt model

yolo segment train data=coco.yaml model=yolo26n-seg.pt epochs=100 imgsz=640

Quais são os principais recursos do conjunto de dados COCO-Seg?

O conjunto de dados COCO-Seg inclui vários recursos principais:

- Retém as 330 mil imagens originais do conjunto de dados COCO.

- Anota as mesmas 80 categorias de objetos encontradas no COCO original.

- Fornece máscaras de segmentação de instância mais detalhadas para cada objeto.

- Utiliza métricas de avaliação padronizadas, como a Precisão Média Média (mAP) para detecção de objetos e a Recuperação Média Média (mAR) para tarefas de segmentação de instâncias.

Quais modelos pré-treinados estão disponíveis para COCO-Seg e quais são suas métricas de desempenho?

O conjunto de dados COCO-Seg suporta múltiplos modelos de segmentation YOLO26 pré-treinados com métricas de desempenho variadas. Aqui está um resumo dos modelos disponíveis e suas principais métricas:

| Modelo | tamanho (pixels) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Velocidade CPU ONNX (ms) | Velocidade T4 TensorRT10 (ms) | parâmetros (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Esses modelos variam do leve YOLO26n-seg ao mais poderoso YOLO26x-seg, oferecendo diferentes compromissos entre velocidade e precisão para atender a diversos requisitos de aplicação. Para mais informações sobre a seleção de modelos, visite a página de modelos da Ultralytics.

Como o dataset COCO-Seg é estruturado e quais subconjuntos ele contém?

O conjunto de dados COCO-Seg é dividido em três subconjuntos para necessidades específicas de treinamento e avaliação:

- Train2017: Contém 118 mil imagens usadas principalmente para treinar modelos de segmentação de instâncias.

- Val2017: Compreende 5 mil imagens utilizadas para validação durante o processo de treinamento.

- Test2017: Abrange 20 mil imagens reservadas para teste e benchmarking de modelos treinados. Note que as anotações de ground truth para este subconjunto não estão disponíveis publicamente, e os resultados de desempenho são submetidos ao servidor de avaliação COCO para avaliação.

Para necessidades de experimentação menores, você também pode considerar usar o conjunto de dados COCO8-seg, que é uma versão compacta contendo apenas 8 imagens do conjunto de treinamento COCO 2017.