Conjunto de Dados Caltech-101

O conjunto de dados Caltech-101 é um conjunto de dados amplamente utilizado para tarefas de reconhecimento de objetos, contendo cerca de 9.000 imagens de 101 categorias de objetos. As categorias foram escolhidas para refletir uma variedade de objetos do mundo real, e as imagens em si foram cuidadosamente selecionadas e anotadas para fornecer um benchmark desafiador para algoritmos de reconhecimento de objetos.

Assista: Como Treinar Classificação de Imagem Modelo usando o Dataset Caltech-256 com a Ultralytics Platform

Divisão Automática de Dados

O conjunto de dados Caltech-101, conforme fornecido, não vem com divisões de treino/validação predefinidas. No entanto, quando você usa os comandos de treinamento fornecidos nos exemplos de uso abaixo, a estrutura Ultralytics dividirá automaticamente o conjunto de dados para você. A divisão padrão usada é 80% para o conjunto de treinamento e 20% para o conjunto de validação.

Principais Características

- O conjunto de dados Caltech-101 compreende cerca de 9.000 imagens coloridas divididas em 101 categorias.

- As categorias abrangem uma ampla variedade de objetos, incluindo animais, veículos, itens domésticos e pessoas.

- O número de imagens por categoria varia, com cerca de 40 a 800 imagens em cada categoria.

- As imagens são de tamanhos variáveis, sendo a maioria de média resolução.

- O Caltech-101 é amplamente utilizado para treino e teste no campo do machine learning, particularmente para tarefas de reconhecimento de objetos.

Estrutura do Conjunto de Dados

Ao contrário de muitos outros conjuntos de dados, o conjunto de dados Caltech-101 não é formalmente dividido em conjuntos de treino e teste. Os utilizadores normalmente criam as suas próprias divisões com base nas suas necessidades específicas. No entanto, uma prática comum é usar um subconjunto aleatório de imagens para treino (por exemplo, 30 imagens por categoria) e as restantes imagens para teste.

Aplicações

O conjunto de dados Caltech-101 é amplamente utilizado para treinar e avaliar modelos de aprendizado profundo em tarefas de reconhecimento de objetos, como Redes Neurais Convolucionais (CNNs), Máquinas de Vetores de Suporte (SVMs) e vários outros algoritmos de aprendizado de máquina. Sua ampla variedade de categorias e imagens de alta qualidade o tornam um excelente conjunto de dados para pesquisa e desenvolvimento no campo de aprendizado de máquina e visão computacional.

Utilização

Para treinar um modelo YOLO no conjunto de dados Caltech-101 por 100 épocas, você pode usar os seguintes trechos de código. Para uma lista abrangente de argumentos disponíveis, consulte a página de Treinamento do modelo.

Exemplo de Treinamento

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-cls.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="caltech101", epochs=100, imgsz=416)

# Start training from a pretrained *.pt model

yolo classify train data=caltech101 model=yolo26n-cls.pt epochs=100 imgsz=416

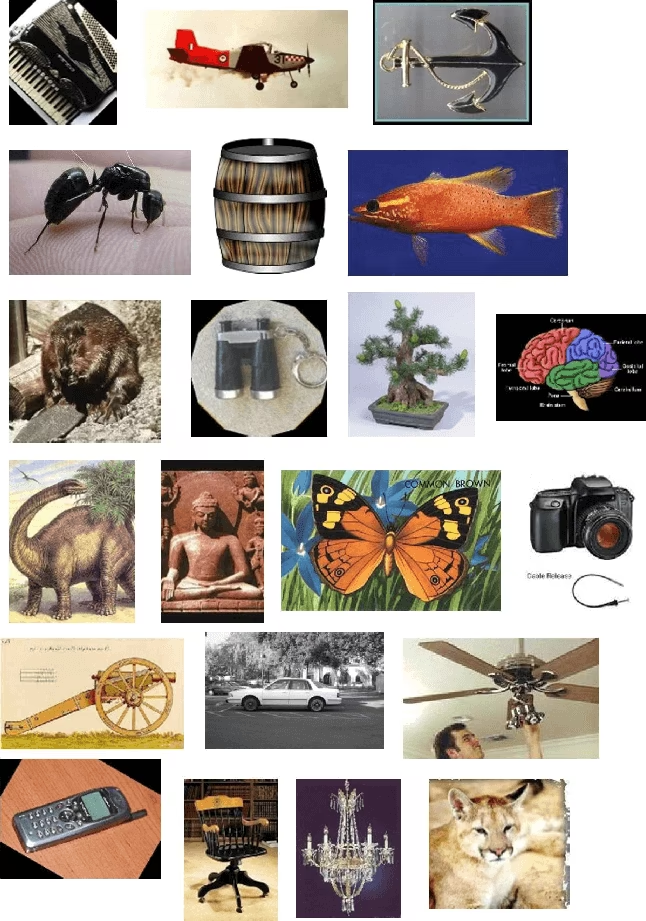

Amostras de Imagens e Anotações

O conjunto de dados Caltech-101 contém imagens coloridas de alta qualidade de vários objetos, fornecendo um conjunto de dados bem estruturado para tarefas de classificação de imagens. Aqui estão alguns exemplos de imagens do conjunto de dados:

O exemplo mostra a variedade e complexidade dos objetos no conjunto de dados Caltech-101, enfatizando a importância de um conjunto de dados diversificado para treinar modelos robustos de reconhecimento de objetos.

Citações e Agradecimentos

Se usar o conjunto de dados Caltech-101 no seu trabalho de pesquisa ou desenvolvimento, cite o seguinte artigo:

@article{fei2007learning,

title={Learning generative visual models from few training examples: An incremental Bayesian approach tested on 101 object categories},

author={Fei-Fei, Li and Fergus, Rob and Perona, Pietro},

journal={Computer vision and Image understanding},

volume={106},

number={1},

pages={59--70},

year={2007},

publisher={Elsevier}

}

Gostaríamos de agradecer a Li Fei-Fei, Rob Fergus e Pietro Perona por criarem e manterem o conjunto de dados Caltech-101 como um recurso valioso para a comunidade de pesquisa em aprendizado de máquina e visão computacional. Para mais informações sobre o conjunto de dados Caltech-101 e seus criadores, visite o site do conjunto de dados Caltech-101.

FAQ

Para que é usado o conjunto de dados Caltech-101 em machine learning?

O conjunto de dados Caltech-101 é amplamente utilizado em aprendizado de máquina para tarefas de reconhecimento de objetos. Ele contém cerca de 9.000 imagens em 101 categorias, fornecendo um benchmark desafiador para avaliar algoritmos de reconhecimento de objetos. Os pesquisadores o utilizam para treinar e testar modelos, especialmente Redes Neurais Convolucionais (CNNs) e Máquinas de Vetores de Suporte (SVMs), em visão computacional.

Como posso treinar um modelo Ultralytics YOLO no conjunto de dados Caltech-101?

Para treinar um modelo Ultralytics YOLO no conjunto de dados Caltech-101, você pode usar os trechos de código fornecidos. Por exemplo, para treinar por 100 épocas:

Exemplo de Treinamento

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-cls.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="caltech101", epochs=100, imgsz=416)

# Start training from a pretrained *.pt model

yolo classify train data=caltech101 model=yolo26n-cls.pt epochs=100 imgsz=416

Para argumentos e opções mais detalhadas, consulte a página de Treinamento do modelo.

Quais são os principais recursos do conjunto de dados Caltech-101?

O conjunto de dados Caltech-101 inclui:

- Cerca de 9.000 imagens coloridas em 101 categorias.

- Categorias que cobrem uma gama diversificada de objetos, incluindo animais, veículos e itens domésticos.

- Número variável de imagens por categoria, normalmente entre 40 e 800.

- Tamanhos de imagem variáveis, sendo a maioria de resolução média.

Esses recursos o tornam uma excelente escolha para treinar e avaliar modelos de reconhecimento de objetos em aprendizado de máquina e visão computacional.

Por que devo citar o conjunto de dados Caltech-101 em minha pesquisa?

Citar o conjunto de dados Caltech-101 em sua pesquisa reconhece as contribuições dos criadores e fornece uma referência para outros que possam usar o conjunto de dados. A citação recomendada é:

@article{fei2007learning,

title={Learning generative visual models from few training examples: An incremental Bayesian approach tested on 101 object categories},

author={Fei-Fei, Li and Fergus, Rob and Perona, Pietro},

journal={Computer vision and Image understanding},

volume={106},

number={1},

pages={59--70},

year={2007},

publisher={Elsevier}

}

Citar ajuda a manter a integridade do trabalho acadêmico e auxilia os colegas a localizar o recurso original.

Posso usar a Ultralytics Platform para treinar modelos no dataset Caltech-101?

Sim, você pode usar a Ultralytics Platform para treinar modelos no dataset Caltech-101. A Ultralytics Platform oferece uma plataforma intuitiva para gerenciar datasets, treinar modelos e implantá-los sem a necessidade de codificação extensiva. Para um guia detalhado, consulte a postagem do blog como treinar seus modelos personalizados com a Ultralytics Platform.