Ensemble de données Caltech-101

L'ensemble de données Caltech-101 est un ensemble de données largement utilisé pour les tâches de reconnaissance d'objets, contenant environ 9 000 images provenant de 101 catégories d'objets. Les catégories ont été choisies pour refléter une variété d'objets du monde réel, et les images elles-mêmes ont été soigneusement sélectionnées et annotées afin de fournir un banc d'essai stimulant pour les algorithmes de reconnaissance d'objets.

Regarder : Comment entraîner Classification d'images Modèle utilisant le jeu de données Caltech-256 avec Ultralytics Platform

Division automatique des données

L'ensemble de données Caltech-101, tel que fourni, n'est pas livré avec des divisions train/validation prédéfinies. Cependant, lorsque vous utilisez les commandes d'entraînement fournies dans les exemples d'utilisation ci-dessous, le framework Ultralytics divisera automatiquement l'ensemble de données pour vous. La division par défaut utilisée est de 80 % pour l'ensemble d'entraînement et de 20 % pour l'ensemble de validation.

Principales caractéristiques

- L'ensemble de données Caltech-101 comprend environ 9 000 images couleur réparties en 101 catégories.

- Les catégories englobent une grande variété d'objets, notamment des animaux, des véhicules, des articles ménagers et des personnes.

- Le nombre d'images par catégorie varie, avec environ 40 à 800 images dans chaque catégorie.

- Les images sont de tailles variables, la plupart étant de résolution moyenne.

- Caltech-101 est largement utilisé pour l'entraînement et les tests dans le domaine de l'apprentissage automatique, en particulier pour les tâches de reconnaissance d'objets.

Structure du jeu de données

Contrairement à de nombreux autres ensembles de données, l'ensemble de données Caltech-101 n'est pas formellement divisé en ensembles d'entraînement et de test. Les utilisateurs créent généralement leurs propres divisions en fonction de leurs besoins spécifiques. Cependant, une pratique courante consiste à utiliser un sous-ensemble aléatoire d'images pour l'entraînement (par exemple, 30 images par catégorie) et les images restantes pour les tests.

Applications

L'ensemble de données Caltech-101 est largement utilisé pour l'entraînement et l'évaluation de modèles de deep learning dans les tâches de reconnaissance d'objets, tels que les Convolutional Neural Networks (CNN), les Support Vector Machines (SVM) et divers autres algorithmes d'apprentissage automatique. Sa grande variété de catégories et ses images de haute qualité en font un excellent ensemble de données pour la recherche et le développement dans le domaine de l'apprentissage automatique et de la vision par ordinateur.

Utilisation

Pour entraîner un modèle YOLO sur le jeu de données Caltech-101 pendant 100 epochs, vous pouvez utiliser les extraits de code suivants. Pour une liste complète des arguments disponibles, consultez la page Training du modèle.

Exemple d'entraînement

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-cls.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="caltech101", epochs=100, imgsz=416)

# Start training from a pretrained *.pt model

yolo classify train data=caltech101 model=yolo26n-cls.pt epochs=100 imgsz=416

Images et annotations d'exemple

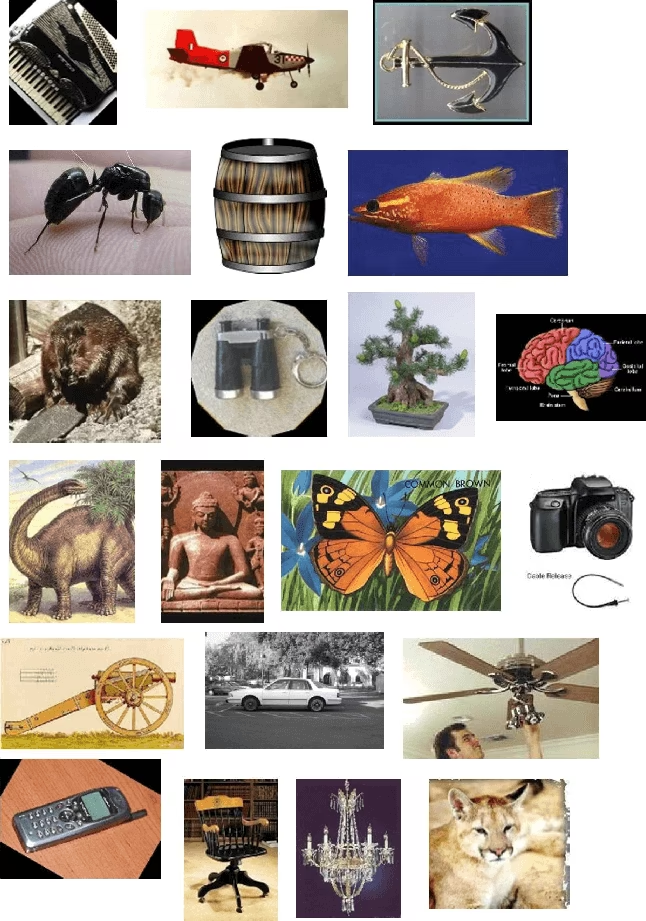

L'ensemble de données Caltech-101 contient des images couleur de haute qualité de divers objets, fournissant un ensemble de données bien structuré pour les tâches de classification d'images. Voici quelques exemples d'images de l'ensemble de données :

L'exemple met en évidence la variété et la complexité des objets dans l'ensemble de données Caltech-101, soulignant l'importance d'un ensemble de données diversifié pour l'entraînement de modèles de reconnaissance d'objets robustes.

Citations et remerciements

Si vous utilisez le jeu de données Caltech-101 dans vos travaux de recherche ou de développement, veuillez citer l'article suivant :

@article{fei2007learning,

title={Learning generative visual models from few training examples: An incremental Bayesian approach tested on 101 object categories},

author={Fei-Fei, Li and Fergus, Rob and Perona, Pietro},

journal={Computer vision and Image understanding},

volume={106},

number={1},

pages={59--70},

year={2007},

publisher={Elsevier}

}

Nous tenons à remercier Li Fei-Fei, Rob Fergus et Pietro Perona pour la création et la maintenance du jeu de données Caltech-101 en tant que ressource précieuse pour la communauté de recherche en apprentissage automatique et en vision par ordinateur. Pour plus d'informations sur le jeu de données Caltech-101 et ses créateurs, consultez le site web du jeu de données Caltech-101.

FAQ

À quoi sert le jeu de données Caltech-101 en apprentissage automatique ?

L'ensemble de données Caltech-101 est largement utilisé dans l'apprentissage automatique pour les tâches de reconnaissance d'objets. Il contient environ 9 000 images réparties dans 101 catégories, ce qui constitue un banc d'essai difficile pour évaluer les algorithmes de reconnaissance d'objets. Les chercheurs l'utilisent pour entraîner et tester des modèles, en particulier les réseaux neuronaux convolutionnels (CNN) et les machines à vecteurs de support (SVM), en vision par ordinateur.

Comment puis-je entraîner un modèle Ultralytics YOLO sur le jeu de données Caltech-101 ?

Pour entraîner un modèle Ultralytics YOLO sur l'ensemble de données Caltech-101, vous pouvez utiliser les extraits de code fournis. Par exemple, pour entraîner pendant 100 epochs :

Exemple d'entraînement

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-cls.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="caltech101", epochs=100, imgsz=416)

# Start training from a pretrained *.pt model

yolo classify train data=caltech101 model=yolo26n-cls.pt epochs=100 imgsz=416

Pour des arguments et options plus détaillés, consultez la page Entraînement du modèle.

Quelles sont les principales caractéristiques du jeu de données Caltech-101 ?

Le jeu de données Caltech-101 comprend :

- Environ 9 000 images couleur réparties dans 101 catégories.

- Catégories couvrant un large éventail d'objets, notamment des animaux, des véhicules et des articles ménagers.

- Nombre variable d'images par catégorie, généralement entre 40 et 800.

- Tailles d'image variables, la plupart étant de résolution moyenne.

Ces caractéristiques en font un excellent choix pour l'entraînement et l'évaluation des modèles de reconnaissance d'objets dans l'apprentissage automatique et la vision par ordinateur.

Pourquoi devrais-je citer le jeu de données Caltech-101 dans mes recherches ?

Citer l'ensemble de données Caltech-101 dans vos recherches reconnaît les contributions des créateurs et fournit une référence pour d'autres personnes susceptibles d'utiliser l'ensemble de données. La citation recommandée est la suivante :

@article{fei2007learning,

title={Learning generative visual models from few training examples: An incremental Bayesian approach tested on 101 object categories},

author={Fei-Fei, Li and Fergus, Rob and Perona, Pietro},

journal={Computer vision and Image understanding},

volume={106},

number={1},

pages={59--70},

year={2007},

publisher={Elsevier}

}

Citer aide à maintenir l'intégrité du travail académique et aide les pairs à localiser la ressource originale.

Puis-je utiliser Ultralytics Platform pour l'entraînement de modèles sur le jeu de données Caltech-101?

Oui, vous pouvez utiliser Ultralytics Platform pour l'entraînement de modèles sur le jeu de données Caltech-101. Ultralytics Platform fournit une plateforme intuitive pour la gestion des jeux de données, l'entraînement des modèles et leur déploiement sans codage intensif. Pour un guide détaillé, consultez l'article de blog "comment entraîner vos modèles personnalisés avec Ultralytics Platform".