Link to this sectionModèles pris en charge par Ultralytics#

Bienvenue dans la documentation des modèles Ultralytics ! Nous offrons une prise en charge pour une large gamme de modèles, chacun adapté à des tâches spécifiques comme la détection d'objets, la segmentation d'instance, la segmentation sémantique, la classification d'images, l' estimation de pose et le suivi multi-objets. Si tu souhaites contribuer en ajoutant ton architecture de modèle à Ultralytics, consulte notre Guide de contribution.

Link to this sectionModèles en vedette#

Voici quelques-uns des principaux modèles pris en charge :

- YOLOv3 : La troisième itération de la famille de modèles YOLO, créée à l'origine par Joseph Redmon, reconnue pour ses capacités de détection d'objets en temps réel efficaces.

- YOLOv4 : Une mise à jour native de Darknet pour YOLOv3, publiée par Alexey Bochkovskiy en 2020.

- YOLOv5 : Une version améliorée de l'architecture YOLO par Ultralytics, offrant de meilleurs compromis performance/vitesse par rapport aux versions précédentes.

- YOLOv6 : Publié par Meituan en 2022 et utilisé dans plusieurs robots de livraison autonomes de l'entreprise.

- YOLOv7 : Modèles YOLO mis à jour publiés en 2022 par les auteurs de YOLOv4. Seule l'inférence est prise en charge.

- YOLOv8 : Un modèle polyvalent doté de capacités améliorées telles que la segmentation d'instance, l'estimation de pose/points clés et la classification.

- YOLOv9 : Un modèle expérimental entraîné sur la base de code Ultralytics YOLOv5 implémentant le PGI (Programmable Gradient Information).

- YOLOv10 : Par l'Université Tsinghua, caractérisé par un entraînement sans NMS et une architecture axée sur l'efficacité et la précision, offrant des performances et une latence de pointe.

- YOLO11 : Les modèles YOLO d'Ultralytics offrant des performances élevées sur plusieurs tâches, notamment la détection, la segmentation, l'estimation de pose, le suivi et la classification.

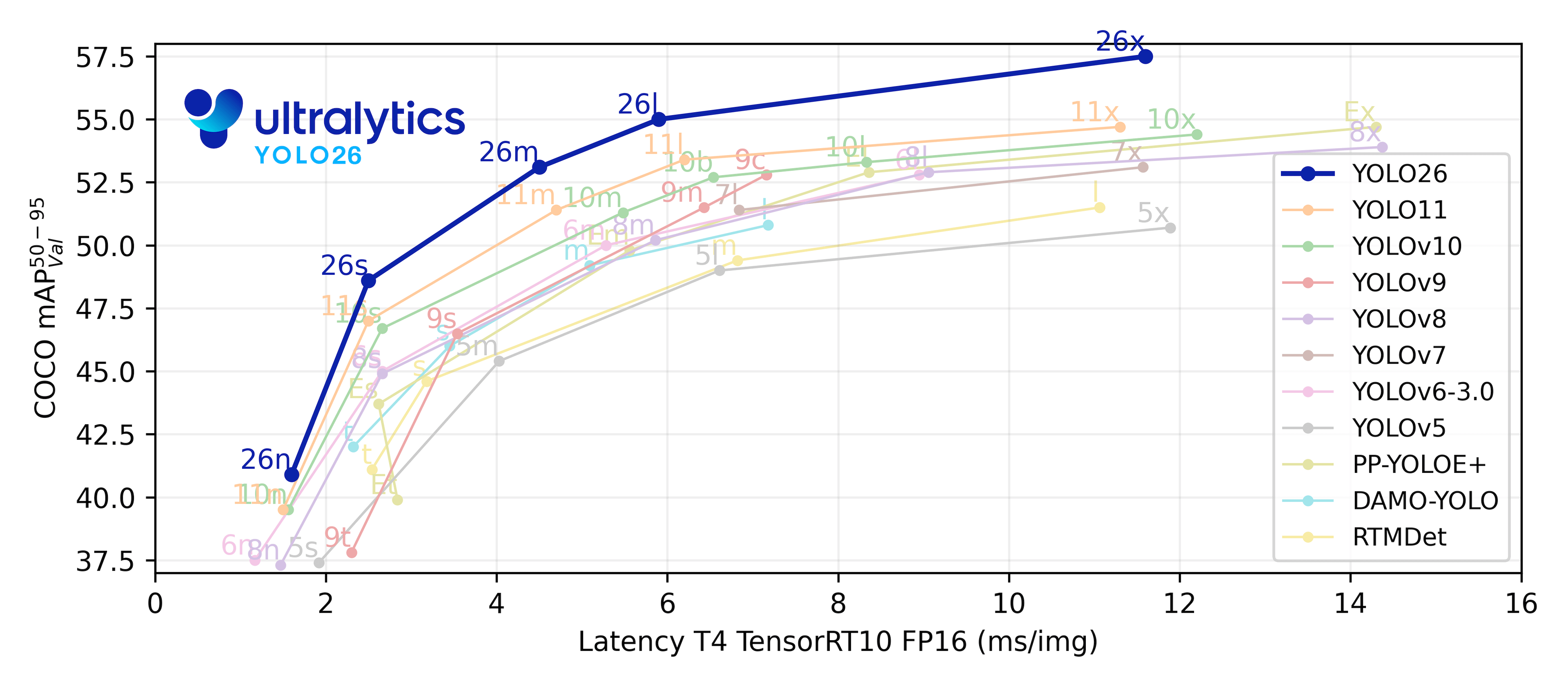

- YOLO26 🚀 NOUVEAU : Le tout dernier modèle YOLO de nouvelle génération d'Ultralytics, optimisé pour le déploiement en périphérie (edge) avec une inférence de bout en bout sans NMS.

- Segment Anything Model (SAM) : Le modèle original Segment Anything Model (SAM) de Meta.

- Segment Anything Model 2 (SAM2) : La nouvelle génération du Segment Anything Model de Meta pour les vidéos et les images.

- Segment Anything Model 3 (SAM3) 🚀 NOUVEAU : La troisième génération du Segment Anything Model de Meta avec segmentation de concept orientable (Promptable Concept Segmentation) pour la segmentation basée sur des exemples textuels et visuels.

- Mobile Segment Anything Model (MobileSAM) : MobileSAM pour les applications mobiles, par l'Université Kyung Hee.

- Fast Segment Anything Model (FastSAM) : FastSAM par le groupe Image & Video Analysis, Institut d'automatisation, Académie chinoise des sciences.

- YOLO-NAS : Modèles YOLO Neural Architecture Search (NAS).

- Real-Time Detection Transformers (RT-DETR) : Modèles de Transformer de détection en temps réel (RT-DETR) de PaddlePaddle par Baidu.

- YOLO-World : Modèles de détection d'objets en temps réel à vocabulaire ouvert du laboratoire d'IA de Tencent.

- YOLOE : Un détecteur d'objets à vocabulaire ouvert amélioré qui maintient les performances en temps réel de YOLO tout en détectant des classes arbitraires au-delà de ses données d'entraînement.

Watch: Run Ultralytics YOLO models in just a few lines of code.

Link to this sectionPour commencer : Exemples d'utilisation#

Cet exemple fournit des cas simples d'entraînement et d'inférence avec YOLO. Pour une documentation complète sur ces modes et d'autres, consulte les pages de documentation Predict, Train, Val et Export.

Note que l'exemple ci-dessous met en lumière les modèles Detect de YOLO11 pour la détection d'objets. Pour d'autres tâches prises en charge, consulte les docs Segment, Classify et Pose.

Les modèles pré-entraînés PyTorch *.pt ainsi que les fichiers de configuration *.yaml peuvent être transmis aux classes YOLO(), SAM(), NAS() et RTDETR() pour créer une instance de modèle en Python :

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")Link to this sectionContribuer à de nouveaux modèles#

Tu souhaites contribuer en ajoutant ton modèle à Ultralytics ? Super ! Nous sommes toujours ouverts à l'élargissement de notre portefeuille de modèles.

-

Forker le dépôt : Commence par forker le dépôt GitHub d'Ultralytics.

-

Cloner ton fork : Clone ton fork sur ta machine locale et crée une nouvelle branche pour travailler.

-

Implémenter ton modèle : Ajoute ton modèle en suivant les normes de codage et les directives fournies dans notre Guide de contribution.

-

Tester minutieusement : Assure-toi de tester rigoureusement ton modèle, aussi bien de manière isolée qu'au sein du pipeline.

-

Créer une Pull Request : Une fois que tu es satisfait de ton modèle, crée une pull request vers le dépôt principal pour examen.

-

Revue de code et fusion : Après examen, si ton modèle répond à nos critères, il sera fusionné dans le dépôt principal.

Pour des étapes détaillées, consulte notre Guide de contribution.

Link to this sectionFAQ#

Link to this sectionQuel est le dernier modèle YOLO d'Ultralytics ?#

Le dernier modèle YOLO d'Ultralytics est YOLO26, publié en janvier 2026. YOLO26 propose une inférence de bout en bout sans NMS, un déploiement optimisé en périphérie, et prend en charge la détection, la segmentation d'instance, la segmentation sémantique, la classification, l'estimation de pose et OBB, ainsi que des versions à vocabulaire ouvert. Pour des charges de travail de production stables, YOLO26 et YOLO11 sont des choix recommandés.

Link to this sectionComment puis-je entraîner un modèle YOLO sur mes propres données ?#

L'entraînement d'un modèle YOLO sur des données personnalisées peut être facilement réalisé en utilisant les bibliothèques d'Ultralytics. Voici un exemple rapide :

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)Pour des instructions plus détaillées, visite la page de documentation Train.

Link to this sectionQuelles versions de YOLO sont prises en charge par Ultralytics ?#

Ultralytics prend en charge une gamme complète de versions de YOLO (You Only Look Once) allant de YOLOv3 à YOLO26, ainsi que des modèles tels que YOLO-NAS, SAM et RT-DETR. Chaque version est optimisée pour diverses tâches telles que la détection, la segmentation, la segmentation sémantique et la classification. Pour des informations détaillées sur chaque modèle, réfère-toi à la documentation Modèles pris en charge par Ultralytics.

Link to this sectionPourquoi devrais-je utiliser la plateforme Ultralytics pour des projets de machine learning ?#

La plateforme Ultralytics fournit une solution sans code de bout en bout pour l'entraînement, le déploiement et la gestion des modèles YOLO. Elle simplifie les flux de travail complexes, permettant aux utilisateurs de se concentrer sur les performances des modèles et leurs applications. Le HUB offre également des capacités d'entraînement dans le cloud, une gestion complète des jeux de données et des interfaces conviviales pour les débutants comme pour les développeurs expérimentés.

Link to this sectionQuels types de tâches les modèles YOLO d'Ultralytics peuvent-ils effectuer ?#

Les modèles YOLO d'Ultralytics sont polyvalents et peuvent effectuer des tâches telles que la détection d'objets, la segmentation d'instance, la segmentation sémantique, la classification, l'estimation de pose et la détection d'objets orientés (OBB). Le modèle le plus récent, YOLO26, prend en charge ces six tâches, ainsi que la détection à vocabulaire ouvert. Pour des détails sur des tâches spécifiques, consulte les pages des tâches.