Link to this sectionUltralyticsでサポートされているモデル#

Ultralyticsのモデルドキュメントへようこそ!当社では、物体検出、インスタンスセグメンテーション、セマンティックセグメンテーション、画像分類、姿勢推定、および複数物体追跡といった特定のタスク向けに調整された幅広いモデルをサポートしています。独自のモデルアーキテクチャをUltralyticsに提供することにご興味がある場合は、コントリビューションガイドをご確認ください。

Link to this section注目モデル#

主要なサポート対象モデルの一部を以下に紹介します。

- YOLOv3: Joseph Redmon氏が考案したYOLOモデルファミリーの第3世代で、効率的なリアルタイム物体検出性能で知られています。

- YOLOv4: 2020年にAlexey Bochkovskiy氏によってリリースされた、YOLOv3をベースとするDarknetネイティブなアップデートモデルです。

- YOLOv5: UltralyticsによるYOLOアーキテクチャの改良版であり、従来バージョンと比較してパフォーマンスと速度のトレードオフが改善されています。

- YOLOv6: 2022年にMeituanによってリリースされ、同社の自律配送ロボットの多くで採用されています。

- YOLOv7: YOLOv4の著者らにより2022年にリリースされた更新モデルです。推論のみサポートされています。

- YOLOv8: インスタンスセグメンテーション、姿勢/キーポイント推定、分類などの強化された機能を備えた汎用性の高いモデルです。

- YOLOv9: Programmable Gradient Information (PGI) を実装した、UltralyticsのYOLOv5コードベースで学習された実験的モデルです。

- YOLOv10: 清華大学によるモデルで、NMSフリーの学習と効率性・精度を重視したアーキテクチャを採用し、最先端の性能と低レイテンシを実現しています。

- YOLO11: 検出、セグメンテーション、姿勢推定、追跡、分類を含む複数のタスクにおいて高いパフォーマンスを発揮するUltralyticsのYOLOモデルです。

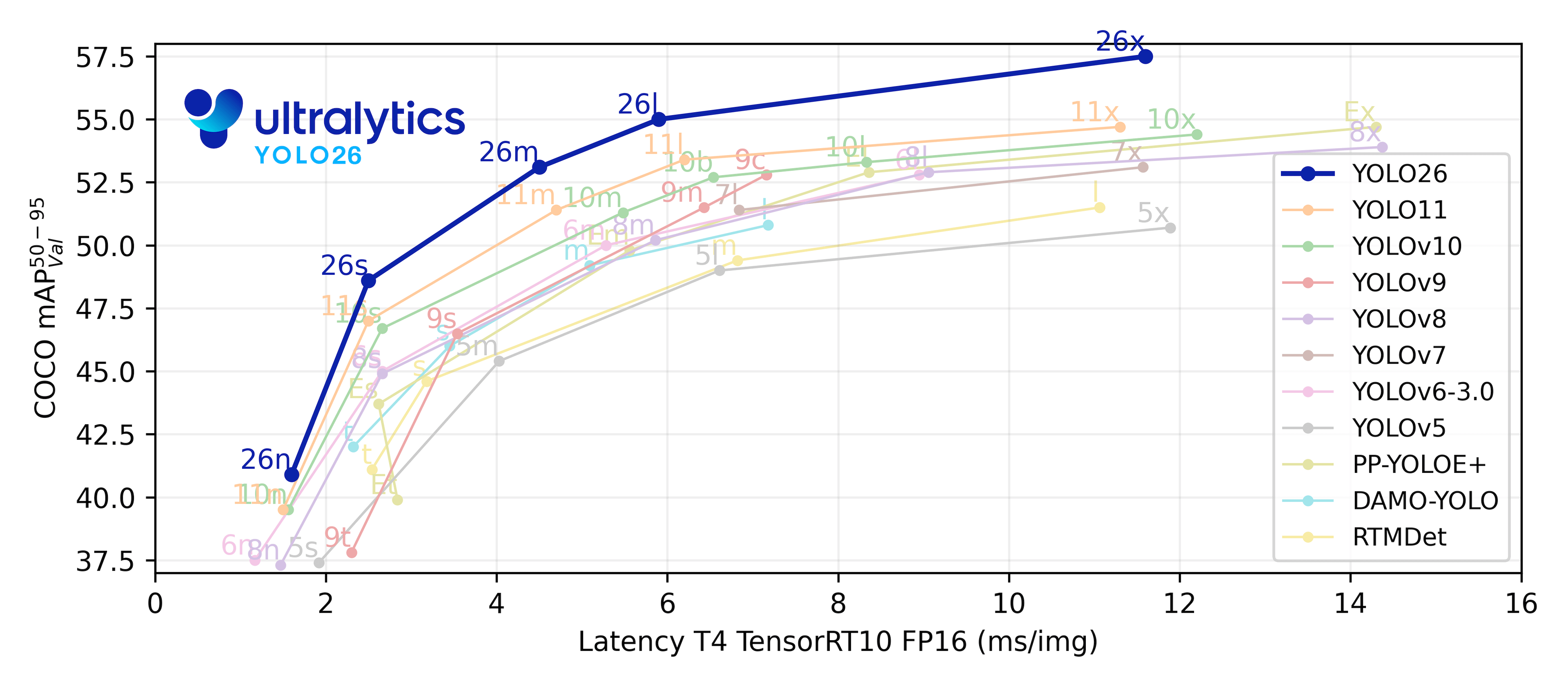

- YOLO26 🚀 NEW: エッジ展開向けに最適化され、エンドツーエンドのNMSフリー推論を実現したUltralyticsの最新次世代YOLOモデルです。

- Segment Anything Model (SAM): Metaが提供するオリジナルのSegment Anything Model (SAM) です。

- Segment Anything Model 2 (SAM2): 動画および画像に対応した、Metaによる次世代Segment Anything Modelです。

- Segment Anything Model 3 (SAM3) 🚀 NEW: テキストおよび画像のエグゼンプラー(実例)ベースのセグメンテーションを実現する、Promptable Concept Segmentationを備えたMetaの第3世代Segment Anything Modelです。

- Mobile Segment Anything Model (MobileSAM): 慶熙大学(Kyung Hee University)による、モバイルアプリケーション向けのMobileSAMです。

- Fast Segment Anything Model (FastSAM): 中国科学院自動化研究所の画像・ビデオ解析グループによるFastSAMです。

- YOLO-NAS: YOLO Neural Architecture Search (NAS) モデルです。

- Real-Time Detection Transformers (RT-DETR): BaiduのPaddlePaddleによるリアルタイムDetection Transformer (RT-DETR) モデルです。

- YOLO-World: Tencent AI Labによるリアルタイムオープンボキャブラリー物体検出モデルです。

- YOLOE: YOLOのリアルタイム性能を維持しながら、学習データに含まれない任意のクラスを検出可能な、改良版オープンボキャブラリー物体検出器です。

Watch: Run Ultralytics YOLO models in just a few lines of code.

Link to this sectionはじめに:使用例#

この例では、シンプルなYOLOの学習と推論の例を紹介します。これらおよびその他のモードに関する詳細なドキュメントについては、Predict、Train、Val、およびExportのドキュメントページを参照してください。

Note the below example spotlights YOLO11 Detect models for object detection. For additional supported tasks see the Segment, Classify and Pose docs.

PyTorchの事前学習済み*.ptモデル、および構成設定の*.yamlファイルをYOLO()、SAM()、NAS()、およびRTDETR()クラスに渡すことで、Python内でモデルインスタンスを作成できます:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")Link to this section新しいモデルのコントリビューション#

ご自身のモデルをUltralyticsに提供することに興味がありますか?素晴らしい試みです!当社は常にモデルポートフォリオの拡大を歓迎しています。

-

リポジトリをフォークする: まず、Ultralytics GitHubリポジトリをフォークすることから始めてください。

-

フォークをクローンする: ローカルマシンにフォークをクローンし、作業用の新しいブランチを作成します。

-

モデルを実装する: コントリビューションガイドに記載されているコーディング標準とガイドラインに従ってモデルを追加します。

-

徹底的にテストする: モデルを単体で、またパイプラインの一部として厳密にテストしてください。

-

プルリクエストを作成する: モデルの準備が整ったら、レビューのためにメインリポジトリに対してプルリクエストを作成してください。

-

コードレビューとマージ: レビューの結果、当社の基準を満たしていると判断された場合、メインリポジトリにマージされます。

詳細な手順については、コントリビューションガイドを参照してください。

Link to this sectionFAQ#

Link to this section最新のUltralytics YOLOモデルは何ですか?#

最新のUltralytics YOLOモデルは、2026年1月にリリースされたYOLO26です。YOLO26は、エンドツーエンドのNMSフリー推論と最適化されたエッジ展開を特徴とし、検出、インスタンスセグメンテーション、セマンティックセグメンテーション、分類、姿勢推定、OBB、およびオープンボキャブラリーバージョンをサポートしています。安定した本番環境でのワークロードには、YOLO26とYOLO11の両方が推奨される選択肢です。

Link to this sectionカスタムデータでYOLOモデルを学習させるにはどうすればよいですか?#

Ultralyticsのライブラリを使用すれば、カスタムデータでのYOLOモデルの学習は簡単に行えます。以下にクイック例を示します:

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)詳細な手順については、Trainドキュメントページを参照してください。

Link to this sectionUltralyticsではどのYOLOバージョンがサポートされていますか?#

Ultralyticsは、YOLOv3からYOLO26に至るまで、包括的な範囲のYOLOバージョンをサポートしており、YOLO-NAS、SAM、RT-DETRなどのモデルも利用可能です。各バージョンは、検出、セグメンテーション、セマンティックセグメンテーション、分類などのさまざまなタスクに最適化されています。各モデルの詳細については、Ultralyticsでサポートされているモデルのドキュメントを参照してください。

Link to this section機械学習プロジェクトにUltralytics Platformを使用すべき理由は何ですか?#

Ultralytics Platformは、YOLOモデルの学習、展開、管理のためのノーコードでエンドツーエンドのプラットフォームを提供します。複雑なワークフローを簡素化し、ユーザーがモデルのパフォーマンスとアプリケーション開発に集中できるようにします。また、HUBではクラウド学習機能、包括的なデータセット管理、初心者から経験豊富な開発者まで使いやすいインターフェースを提供しています。

Link to this sectionUltralytics YOLOモデルではどのような種類のタスクを実行できますか?#

Ultralytics YOLOモデルは汎用性が高く、物体検出、インスタンスセグメンテーション、セマンティックセグメンテーション、分類、姿勢推定、および指向性物体検出(OBB)といったタスクを実行できます。最新のYOLO26は、これら6つのタスクすべてに加えて、オープンボキャブラリー検出もサポートしています。特定のタスクの詳細については、タスクページを参照してください。