Link to this sectionКраткое руководство: Raspberry Pi с Ultralytics YOLO26#

Это подробное руководство содержит пошаговую инструкцию по развертыванию Ultralytics YOLO26 на устройствах Raspberry Pi. Кроме того, здесь приведены результаты тестирования производительности, демонстрирующие возможности YOLO26 на этих компактных и мощных устройствах.

Watch: Raspberry Pi 5 updates and improvements.

Это руководство было протестировано на Raspberry Pi 4 и Raspberry Pi 5 под управлением последней версии Raspberry Pi OS Bookworm (Debian 12). Ожидается, что использование этого руководства для более старых моделей, таких как Raspberry Pi 3, будет работать при условии установки той же Raspberry Pi OS Bookworm.

Link to this sectionЧто такое Raspberry Pi?#

Raspberry Pi — это небольшой доступный одноплатный компьютер. Он стал популярен для широкого спектра проектов и приложений, от любительской автоматизации дома до промышленного использования. Платы Raspberry Pi способны запускать различные операционные системы и оснащены контактами GPIO (General Purpose Input/Output), которые позволяют легко интегрироваться с датчиками, приводами и другими аппаратными компонентами. Они выпускаются в разных моделях с различными характеристиками, но все они разделяют общую философию дизайна: низкая стоимость, компактность и универсальность.

Link to this sectionСравнение серии Raspberry Pi#

| Raspberry Pi 3 | Raspberry Pi 4 | Raspberry Pi 5 | |

|---|---|---|---|

| CPU | Broadcom BCM2837, Cortex-A53 64Bit SoC | Broadcom BCM2711, Cortex-A72 64Bit SoC | Broadcom BCM2712, Cortex-A76 64Bit SoC |

| Макс. частота CPU | 1.4 ГГц | 1.8 ГГц | 2.4 ГГц |

| GPU | Videocore IV | Videocore VI | VideoCore VII |

| Макс. частота GPU | 400 МГц | 500 МГц | 800 МГц |

| Память | 1 ГБ LPDDR2 SDRAM | 1 ГБ, 2 ГБ, 4 ГБ, 8 ГБ LPDDR4-3200 SDRAM | 4 ГБ, 8 ГБ LPDDR4X-4267 SDRAM |

| PCIe | Н/Д | Н/Д | Интерфейс 1xPCIe 2.0 |

| Максимальное энергопотребление | 2.5A@5V | 3A@5V | 5A@5V (с поддержкой PD) |

Link to this sectionЧто такое Raspberry Pi OS?#

Raspberry Pi OS (ранее известная как Raspbian) — это Unix-подобная операционная система на базе дистрибутива Debian GNU/Linux для семейства компактных одноплатных компьютеров Raspberry Pi, распространяемых Raspberry Pi Foundation. Raspberry Pi OS хорошо оптимизирована для Raspberry Pi с ARM-процессорами и использует модифицированную среду рабочего стола LXDE с менеджером окон Openbox. Raspberry Pi OS активно развивается, с акцентом на повышение стабильности и производительности как можно большего количества пакетов Debian на Raspberry Pi.

Link to this sectionУстановка Raspberry Pi OS на Raspberry Pi#

Первое, что нужно сделать после получения Raspberry Pi, — это записать образ Raspberry Pi OS на micro-SD карту, вставить ее в устройство и загрузить ОС. Следуй подробному руководству по началу работы от Raspberry Pi, чтобы подготовить устройство к первому использованию.

Link to this sectionНастройка Ultralytics#

Существует два способа настройки пакета Ultralytics на Raspberry Pi для создания твоего следующего проекта в области компьютерного зрения. Ты можешь использовать любой из них.

Link to this sectionНачни с Docker#

Самый быстрый способ начать работу с Ultralytics YOLO26 на Raspberry Pi — запустить готовый образ Docker для Raspberry Pi.

Выполни команду ниже, чтобы загрузить контейнер Docker и запустить его на Raspberry Pi. Он основан на образе arm64v8/debian, который содержит Debian 12 (Bookworm) в окружении Python3.

t=ultralytics/ultralytics:latest-arm64

sudo docker pull $t && sudo docker run -it --ipc=host $tПосле этого переходи к разделу Использование NCNN на Raspberry Pi.

Link to this sectionНачни без Docker#

Link to this sectionУстановка пакета Ultralytics#

Здесь мы установим пакет Ultralytics на Raspberry Pi с дополнительными зависимостями, чтобы можно было экспортировать модели PyTorch в другие форматы.

-

Обнови список пакетов, установи pip и обновись до последней версии

sudo apt update sudo apt install python3-pip -y pip install -U pip -

Установи pip-пакет

ultralyticsс дополнительными зависимостямиpip install ultralytics[export] -

Перезагрузи устройство

sudo reboot

Link to this sectionИспользование NCNN на Raspberry Pi#

Из всех форматов экспорта моделей, поддерживаемых Ultralytics, NCNN обеспечивает лучшую производительность вывода при работе с устройствами Raspberry Pi, поскольку NCNN высоко оптимизирован для мобильных/встраиваемых платформ (таких как архитектура ARM).

Link to this sectionКонвертация модели в NCNN и выполнение вывода#

Модель YOLO26n в формате PyTorch конвертируется в NCNN для выполнения вывода с помощью экспортированной модели.

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to NCNN format

model.export(format="ncnn") # creates 'yolo26n_ncnn_model'

# Load the exported NCNN model

ncnn_model = YOLO("yolo26n_ncnn_model")

# Run inference

results = ncnn_model("https://ultralytics.com/images/bus.jpg")Для получения дополнительной информации о поддерживаемых вариантах экспорта посети страницу документации Ultralytics по вариантам развертывания.

Link to this sectionУлучшения производительности YOLO26 по сравнению с YOLO11#

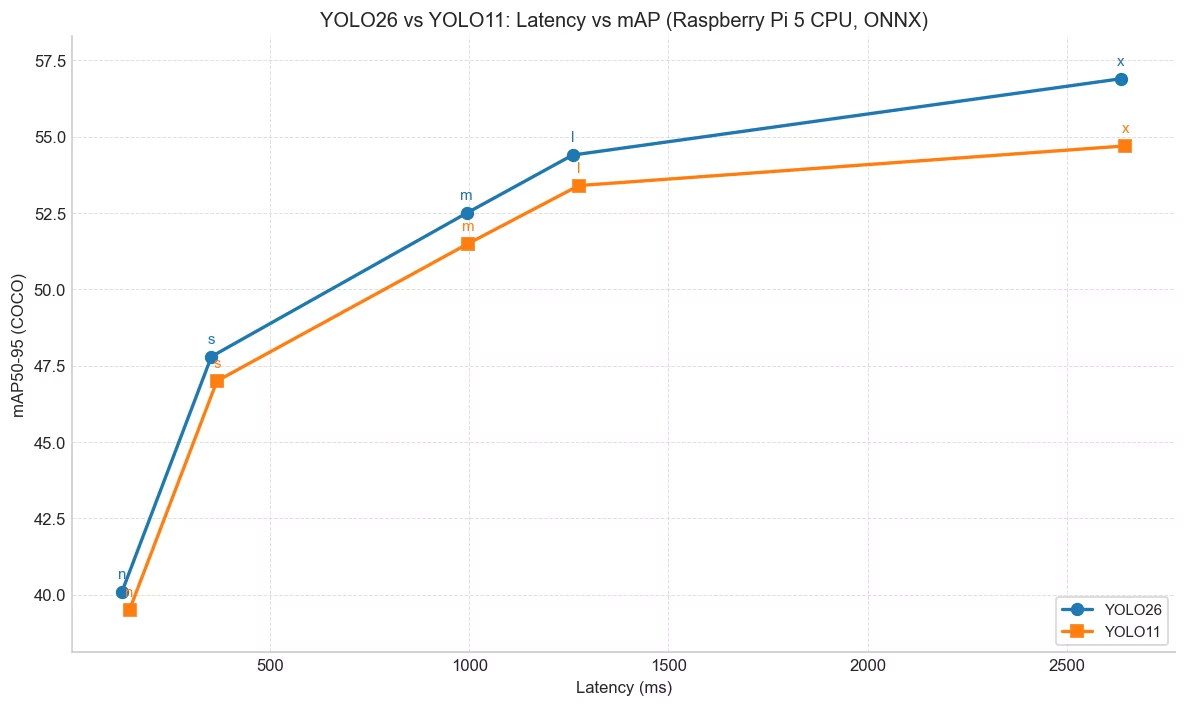

YOLO26 специально разработан для работы на устройствах с ограниченными аппаратными ресурсами, таких как Raspberry Pi 5. По сравнению с YOLO11n, YOLO26n достигает прироста FPS на ~15% (с 6.79 до 7.79), при этом обеспечивая более высокий показатель mAP (40.1 против 39.5) при размере входного изображения 640 с моделями, экспортированными в ONNX на Raspberry Pi 5. Таблица и график ниже демонстрируют это сравнение.

| Модель | mAP50-95(B) | Время инференса (мс/из) |

|---|---|---|

| YOLO26n | 40.1 | 128.42 |

| YOLO26s | 47.8 | 352.84 |

| YOLO26m | 52.5 | 993.78 |

| YOLO26l | 54.4 | 1259.46 |

| YOLO26x | 56.9 | 2636.26 |

Протестировано с Ultralytics 8.4.14.

Link to this sectionРезультаты тестов YOLO26 на Raspberry Pi 5#

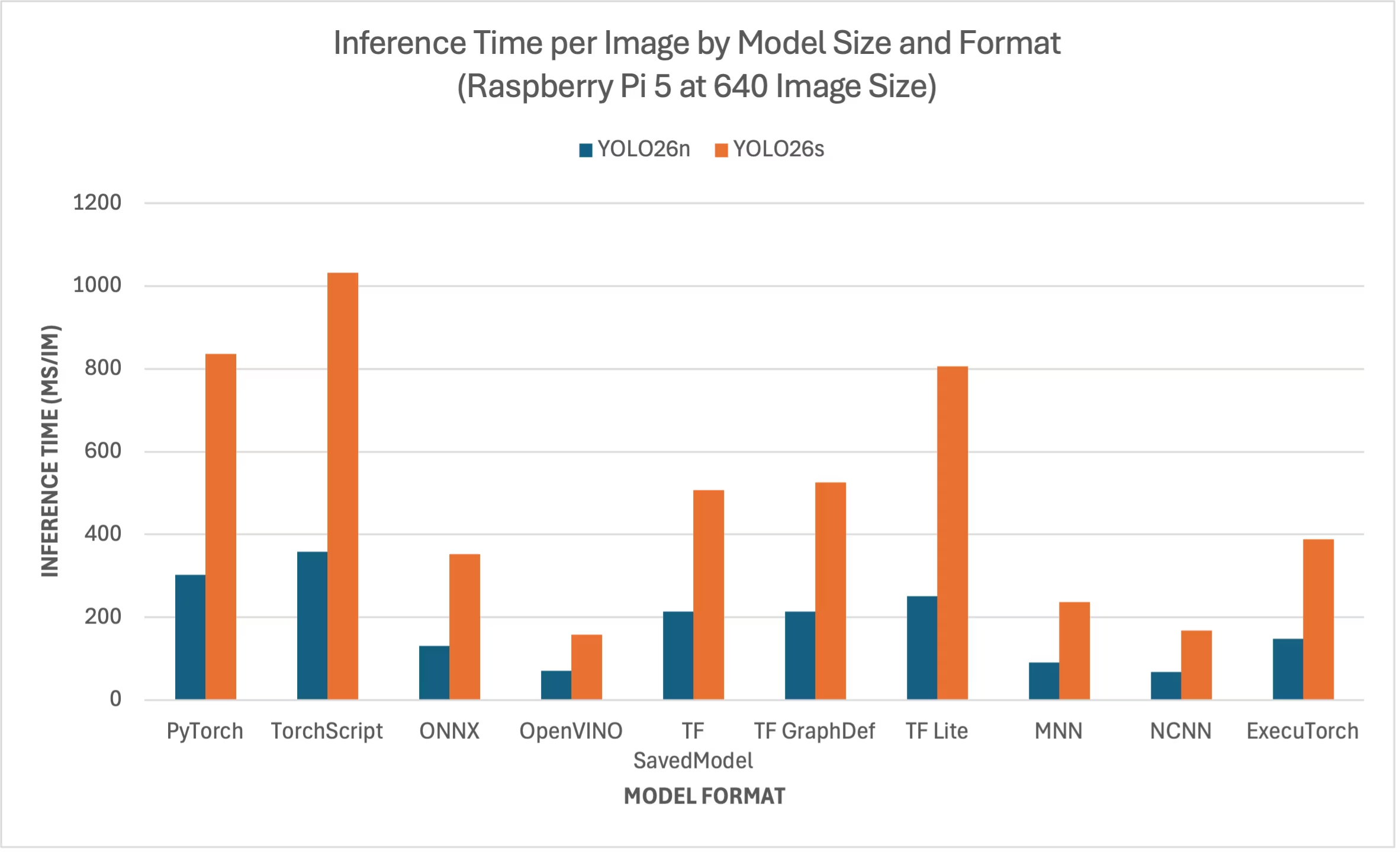

Тесты YOLO26 были проведены командой Ultralytics для десяти различных форматов моделей с измерением скорости и точности: PyTorch, TorchScript, ONNX, OpenVINO, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch. Тестирование проводилось на Raspberry Pi 5 с точностью FP32 и стандартным размером входного изображения 640.

Link to this sectionСравнительная диаграмма#

Мы включили результаты только для моделей YOLO26n и YOLO26s, так как другие размеры моделей слишком велики для запуска на Raspberry Pi и не обеспечивают достойной производительности.

Link to this sectionПодробная сравнительная таблица#

В таблице ниже представлены результаты тестирования для двух различных моделей (YOLO26n, YOLO26s) в десяти различных форматах (PyTorch, TorchScript, ONNX, OpenVINO, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch) на Raspberry Pi 5, с указанием статуса, размера, метрики mAP50-95(B) и времени вывода для каждой комбинации.

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/из) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4798 | 302.15 |

| TorchScript | ✅ | 9.8 | 0.4764 | 357.58 |

| ONNX | ✅ | 9.5 | 0.4764 | 130.33 |

| OpenVINO | ✅ | 9.6 | 0.4818 | 70.74 |

| TF SavedModel | ✅ | 24.6 | 0.4764 | 213.58 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 213.5 |

| TF Lite | ✅ | 9.9 | 0.4764 | 251.41 |

| MNN | ✅ | 9.4 | 0.4784 | 90.89 |

| NCNN | ✅ | 9.4 | 0.4805 | 67.69 |

| ExecuTorch | ✅ | 9.4 | 0.4764 | 148.36 |

Протестировано с Ultralytics 8.4.1

Время вывода не включает предварительную и последующую обработку.

Link to this sectionВоспроизведи наши результаты#

Чтобы воспроизвести вышеуказанные тесты Ultralytics для всех форматов экспорта, запусти этот код:

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Benchmark YOLO26n speed and accuracy on the COCO128 dataset for all export formats

results = model.benchmark(data="coco128.yaml", imgsz=640)Обрати внимание, что результаты тестирования могут варьироваться в зависимости от конкретной конфигурации оборудования и программного обеспечения системы, а также от текущей нагрузки на систему во время запуска бенчмарков. Для получения наиболее достоверных результатов используй набор данных с большим количеством изображений, например data='coco.yaml' (5000 изображений для валидации).

Link to this sectionИспользование камеры Raspberry Pi#

При использовании Raspberry Pi в проектах компьютерного зрения может потребоваться получение видеопотока в реальном времени для выполнения инференса. Встроенный разъем MIPI CSI на Raspberry Pi позволяет подключать официальные модули камер Raspberry Pi. В этом руководстве мы использовали Raspberry Pi Camera Module 3 для получения видеопотоков и выполнения инференса с использованием моделей YOLO26.

Узнай больше о различных модулях камер, предлагаемых Raspberry Pi, а также как начать работу с модулями камер Raspberry Pi.

Raspberry Pi 5 использует разъемы CSI меньшего размера, чем Raspberry Pi 4 (15 контактов против 22), поэтому тебе понадобится адаптерный кабель с 15 на 22 контакта для подключения к камере Raspberry Pi.

Link to this sectionПроверь камеру#

Выполни следующую команду после подключения камеры к Raspberry Pi. Ты должен увидеть живой видеопоток с камеры в течение примерно 5 секунд.

rpicam-helloУзнай больше об использовании rpicam-hello в официальной документации Raspberry Pi

Link to this sectionИнференс с помощью камеры#

Существует 2 метода использования камеры Raspberry Pi для запуска инференса на моделях YOLO26.

Мы можем использовать picamera2, который поставляется предустановленным с Raspberry Pi OS, для доступа к камере и запуска инференса на моделях YOLO26.

import cv2

from picamera2 import Picamera2

from ultralytics import YOLO

# Initialize the Picamera2

picam2 = Picamera2()

picam2.preview_configuration.main.size = (1280, 720)

picam2.preview_configuration.main.format = "RGB888"

picam2.preview_configuration.align()

picam2.configure("preview")

picam2.start()

# Load the YOLO26 model

model = YOLO("yolo26n.pt")

while True:

# Capture frame-by-frame

frame = picam2.capture_array()

# Run YOLO26 inference on the frame

results = model(frame)

# Visualize the results on the frame

annotated_frame = results[0].plot()

# Display the resulting frame

cv2.imshow("Camera", annotated_frame)

# Break the loop if 'q' is pressed

if cv2.waitKey(1) == ord("q"):

break

# Release resources and close windows

cv2.destroyAllWindows()Проверь наш документ об источниках инференса, если хочешь изменить тип входного изображения/видео.

Link to this sectionЛучшие практики при использовании Raspberry Pi#

Есть несколько правил, которым стоит следовать для обеспечения максимальной производительности на Raspberry Pi при запуске YOLO26.

-

Используй SSD

При использовании Raspberry Pi в режиме 24/7 рекомендуется использовать SSD для системы, так как SD-карта не выдержит постоянной перезаписи и может выйти из строя. Благодаря встроенному разъему PCIe на Raspberry Pi 5 теперь ты можешь подключать SSD с помощью адаптера, например NVMe Base for Raspberry Pi 5.

-

Установка без графического интерфейса

При установке Raspberry Pi OS ты можешь не устанавливать среду рабочего стола (Raspberry Pi OS Lite), что позволит немного сэкономить оперативную память устройства, оставляя больше ресурсов для обработки задач компьютерного зрения.

-

Разгон Raspberry Pi

Если ты хочешь немного повысить производительность при запуске моделей Ultralytics YOLO26 на Raspberry Pi 5, ты можешь разогнать процессор с базовых 2.4 ГГц до 2.9 ГГц, а графический процессор — с 800 МГц до 1 ГГц. Если система станет нестабильной или начнет зависать, уменьшай значения разгона с шагом 100 МГц. Убедись, что обеспечено надлежащее охлаждение, так как разгон увеличивает тепловыделение и может привести к троттлингу.

a. Обнови программное обеспечение

sudo apt update && sudo apt dist-upgradeb. Открой файл конфигурации для редактирования

sudo nano /boot/firmware/config.txtc. Добавь следующие строки в конец файла

arm_freq=3000 gpu_freq=1000 force_turbo=1d. Сохрани и закрой, нажав CTRL + X, затем Y, и нажми ENTER

e. Перезагрузи Raspberry Pi

Link to this sectionСледующие шаги#

Ты успешно настроил YOLO на своей Raspberry Pi. Для дальнейшего обучения и поддержки посети документацию Ultralytics YOLO26 и Kashmir World Foundation.

Link to this sectionБлагодарности и цитирования#

Это руководство было изначально создано Daan Eeltink для Kashmir World Foundation, организации, занимающейся использованием YOLO для сохранения исчезающих видов. Мы признаем их новаторскую работу и образовательную направленность в области технологий обнаружения объектов.

Для получения дополнительной информации о деятельности Kashmir World Foundation ты можешь посетить их веб-сайт.

Link to this sectionЧасто задаваемые вопросы (FAQ)#

Link to this sectionКак установить Ultralytics YOLO26 на Raspberry Pi без использования Docker?#

Чтобы установить Ultralytics YOLO26 на Raspberry Pi без Docker, выполни следующие шаги:

- Обнови список пакетов и установи

pip:sudo apt update sudo apt install python3-pip -y pip install -U pip - Установи пакет Ultralytics с дополнительными зависимостями:

pip install ultralytics[export] - Перезагрузи устройство, чтобы применить изменения:

sudo reboot

Для подробных инструкций обратись к разделу Start without Docker.

Link to this sectionПочему мне стоит использовать формат NCNN для Ultralytics YOLO26 на Raspberry Pi для задач ИИ?#

Формат NCNN для Ultralytics YOLO26 отлично оптимизирован для мобильных и встраиваемых платформ, что делает его идеальным для запуска задач ИИ на устройствах Raspberry Pi. NCNN максимизирует производительность инференса за счет использования архитектуры ARM, обеспечивая более быструю и эффективную обработку по сравнению с другими форматами. Для получения дополнительных сведений о поддерживаемых вариантах экспорта посети страницу документации Ultralytics по вариантам развертывания.

Link to this sectionКак я могу конвертировать модель YOLO26 в формат NCNN для использования на Raspberry Pi?#

Ты можешь конвертировать модель PyTorch YOLO26 в формат NCNN с помощью Python или команд CLI:

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to NCNN format

model.export(format="ncnn") # creates 'yolo26n_ncnn_model'

# Load the exported NCNN model

ncnn_model = YOLO("yolo26n_ncnn_model")

# Run inference

results = ncnn_model("https://ultralytics.com/images/bus.jpg")Для получения подробной информации см. раздел Use NCNN on Raspberry Pi.

Link to this sectionКакие существуют аппаратные различия между Raspberry Pi 4 и Raspberry Pi 5, важные для запуска YOLO26?#

Ключевые различия включают:

- CPU: Raspberry Pi 4 использует 64-битный SoC Broadcom BCM2711, Cortex-A72, в то время как Raspberry Pi 5 использует 64-битный SoC Broadcom BCM2712, Cortex-A76.

- Максимальная частота CPU: Raspberry Pi 4 имеет максимальную частоту 1.8 ГГц, в то время как Raspberry Pi 5 достигает 2.4 ГГц.

- Память: Raspberry Pi 4 предлагает до 8 ГБ LPDDR4-3200 SDRAM, в то время как Raspberry Pi 5 оснащена LPDDR4X-4267 SDRAM, доступной в вариантах 4 ГБ и 8 ГБ.

Эти улучшения способствуют лучшим показателям производительности моделей YOLO26 на Raspberry Pi 5 по сравнению с Raspberry Pi 4. Обратись к таблице Raspberry Pi Series Comparison для получения более подробной информации.

Link to this sectionКак настроить модуль камеры Raspberry Pi для работы с Ultralytics YOLO26?#

Существует два метода настройки камеры Raspberry Pi для инференса YOLO26:

-

Использование

picamera2:import cv2 from picamera2 import Picamera2 from ultralytics import YOLO picam2 = Picamera2() picam2.preview_configuration.main.size = (1280, 720) picam2.preview_configuration.main.format = "RGB888" picam2.preview_configuration.align() picam2.configure("preview") picam2.start() model = YOLO("yolo26n.pt") while True: frame = picam2.capture_array() results = model(frame) annotated_frame = results[0].plot() cv2.imshow("Camera", annotated_frame) if cv2.waitKey(1) == ord("q"): break cv2.destroyAllWindows() -

Использование TCP-потока:

rpicam-vid -n -t 0 --inline --listen -o tcp://127.0.0.1:8888from ultralytics import YOLO model = YOLO("yolo26n.pt") results = model("tcp://127.0.0.1:8888")

Для получения подробных инструкций по настройке посети раздел Inference with Camera.