Link to this sectionDog-Pose 数据集#

Link to this section简介#

Ultralytics Dog-Pose 数据集是一个高质量且广泛的数据集,专为狗关键点检测而设计。该数据集包含 6,773 张训练图像和 1,703 张测试图像,为训练稳健的姿态估计模型提供了坚实的基础。

Watch: How to Train Ultralytics YOLO26 on the Stanford Dog Pose Estimation Dataset | Step-by-Step Tutorial

每张标注图像包含 24 个关键点,每个关键点有 3 个维度(x, y, 可见性),使其成为计算机视觉领域高级研究和开发的宝贵资源。

此数据集旨在与 Ultralytics Platform 和 YOLO26 配合使用。

Link to this section数据集结构#

-

拆分:6,773 张训练 / 1,703 张验证图像,并配有 YOLO 格式的标签文件。

-

关键点:每只狗 24 个,采用

(x, y, visibility)三元组表示。 -

布局:

datasets/dog-pose/ ├── images/{train,val} └── labels/{train,val}

Link to this section数据集 YAML#

YAML (Yet Another Markup Language) 文件用于定义数据集配置。它包含路径、关键点详细信息以及其他相关信息。对于 Dog-pose 数据集,dog-pose.yaml 可在 https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/dog-pose.yaml 获取。

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# Dogs dataset http://vision.stanford.edu/aditya86/ImageNetDogs/ by Stanford

# Documentation: https://docs.ultralytics.com/datasets/pose/dog-pose/

# Example usage: yolo train data=dog-pose.yaml

# parent

# ├── ultralytics

# └── datasets

# └── dog-pose ← downloads here (337 MB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: dog-pose # dataset root dir

train: images/train # train images (relative to 'path') 6773 images

val: images/val # val images (relative to 'path') 1703 images

# Keypoints

kpt_shape: [24, 3] # number of keypoints, number of dims (2 for x,y or 3 for x,y,visible)

# Classes

names:

0: dog

# Keypoint names per class

kpt_names:

0:

- front_left_paw

- front_left_knee

- front_left_elbow

- rear_left_paw

- rear_left_knee

- rear_left_elbow

- front_right_paw

- front_right_knee

- front_right_elbow

- rear_right_paw

- rear_right_knee

- rear_right_elbow

- tail_start

- tail_end

- left_ear_base

- right_ear_base

- nose

- chin

- left_ear_tip

- right_ear_tip

- left_eye

- right_eye

- withers

- throat

# Download script/URL (optional)

download: https://github.com/ultralytics/assets/releases/download/v0.0.0/dog-pose.zipLink to this section用法#

要使用 640 的图像尺寸在 Dog-pose 数据集上训练 YOLO26n-pose 模型 100 个 epochs,你可以使用以下代码片段。有关可用参数的完整列表,请参阅模型 Training 页面。

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="dog-pose.yaml", epochs=100, imgsz=640)Link to this section样本图像和标注#

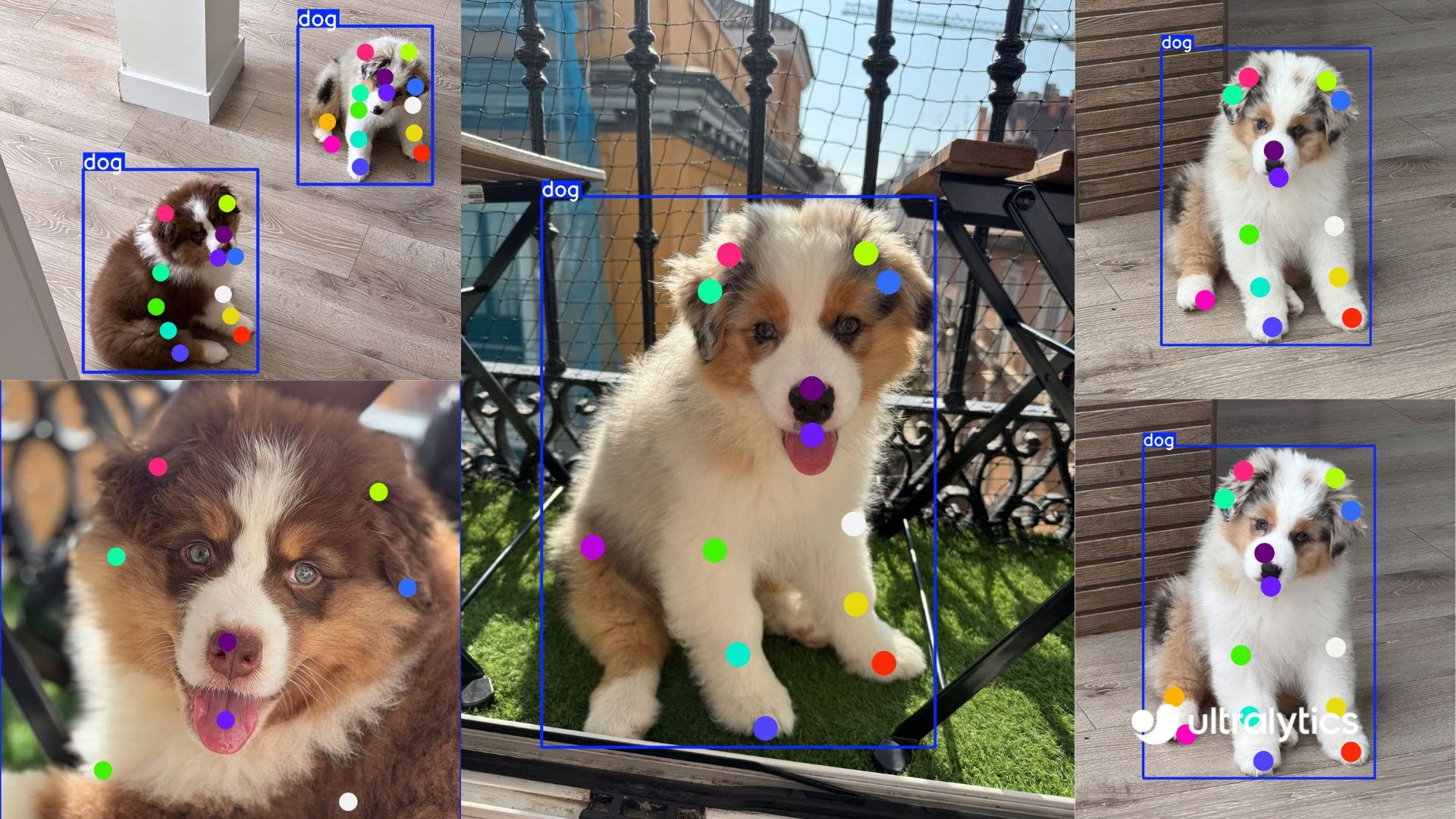

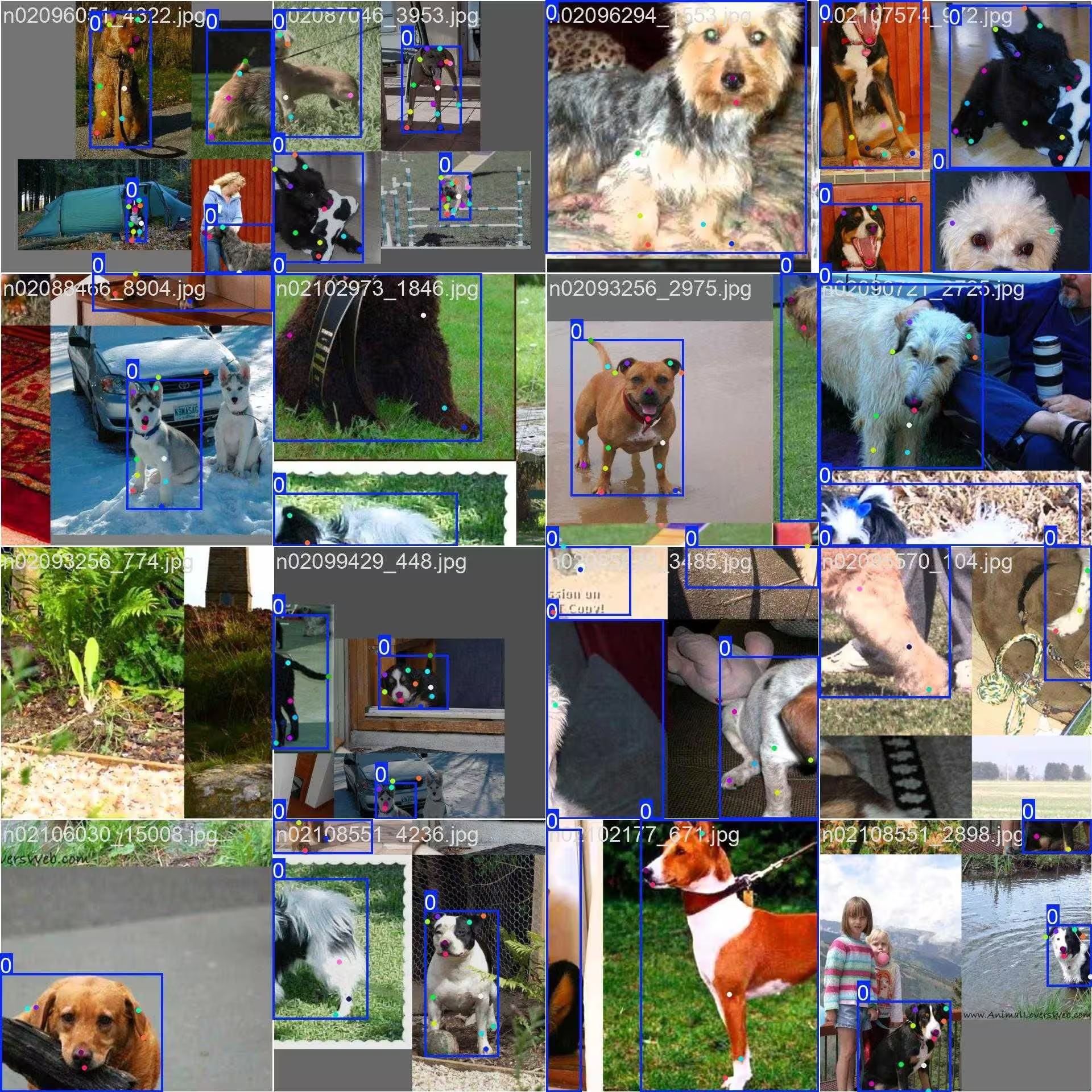

以下是来自 Dog-pose 数据集的一些图像示例及其对应的标注:

- 马赛克图像:此图像展示了一个由马赛克数据集图像组成的训练批次。马赛克是一种在训练期间使用的技术,它将多张图像合并为单张图像,以增加每个训练批次中物体和场景的多样性。这有助于提高模型对不同物体尺寸、宽高比和上下文的泛化能力。

该示例展示了 Dog-pose 数据集中图像的多样性和复杂性,以及在训练过程中使用马赛克(mosaicing)增强的好处。

Link to this section引用与致谢#

如果你在研究或开发工作中使用 Dog-pose 数据集,请引用以下论文:

@inproceedings{khosla2011fgvc,

title={Novel dataset for Fine-Grained Image Categorization},

author={Aditya Khosla and Nityananda Jayadevaprakash and Bangpeng Yao and Li Fei-Fei},

booktitle={First Workshop on Fine-Grained Visual Categorization (FGVC), IEEE Conference on Computer Vision and Pattern Recognition (CVPR)},

year={2011}

}

@inproceedings{deng2009imagenet,

title={ImageNet: A Large-Scale Hierarchical Image Database},

author={Jia Deng and Wei Dong and Richard Socher and Li-Jia Li and Kai Li and Li Fei-Fei},

booktitle={IEEE Computer Vision and Pattern Recognition (CVPR)},

year={2009}

}我们要感谢斯坦福团队为 computer vision 社区创建并维护了这一宝贵资源。有关 Dog-pose 数据集及其创建者的更多信息,请访问 Stanford Dogs Dataset 网站。

Link to this section常见问题解答#

Link to this section什么是 Dog-pose 数据集,它如何与 Ultralytics YOLO26 一起使用?#

Dog-Pose 数据集包含 6,773 张训练图像和 1,703 张测试图像,并标注了用于狗姿态估计的 24 个关键点。它专为使用 Ultralytics YOLO26 训练和验证模型而设计,支持动物行为分析、宠物监控和兽医研究等应用。该数据集全面的标注使其成为开发精准犬类姿态估计模型的理想选择。

Link to this section如何在 Ultralytics 中使用 Dog-pose 数据集训练 YOLO26 模型?#

要在 Dog-pose 数据集上以 640 的图像尺寸训练 YOLO26n-pose 模型 100 个 epochs,请参考以下示例:

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt")

# Train the model

results = model.train(data="dog-pose.yaml", epochs=100, imgsz=640)有关训练参数的完整列表,请参阅模型 Training 页面。

Link to this section使用 Dog-pose 数据集有什么好处?#

Dog-pose 数据集具有以下几项优势:

庞大且多样的数据集:拥有超过 8,400 张图像,提供了涵盖各种狗姿态、品种和背景的大量数据,能够实现稳健的模型训练和评估。

详细的关键点标注:每张图像包含 24 个关键点,每个关键点有 3 个维度(x, y, 可见性),为训练准确的姿态检测模型提供了精确的标注。

真实场景:包含来自不同环境的图像,增强了模型推广到真实应用(如 pet monitoring 和行为分析)的能力。

迁移学习优势:该数据集非常适合 transfer learning 技术,使得在人类姿态数据集上预训练的模型能够适应狗的特定特征。

有关其功能和用法的更多信息,请参阅 Dataset Introduction 部分。

Link to this section马赛克增强如何使使用 Dog-pose 数据集的 YOLO26 训练过程受益?#

马赛克(mosaicing),正如 Dog-pose 数据集的示例图像中所展示的那样,将多张图像合并成一张合成图,丰富了每个训练批次中对象和场景的多样性。这项技术有以下几点优势:

- 增加了每个批次中狗的姿态、大小和背景的多样性

- 提高了模型在不同背景和尺度下检测狗的能力

- 通过让模型接触更多样的视觉模式来增强泛化能力

- 通过创建训练示例的新颖组合来减少过拟合

这种方法可以产出在真实场景中表现更好的更稳健的模型。有关示例图像,请参阅 Sample Images and Annotations 部分。

Link to this section我在哪里可以找到 Dog-pose 数据集的 YAML 文件,以及如何使用它?#

Dog-pose 数据集的 YAML 文件位于 https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/dog-pose.yaml。该文件定义了数据集配置,包括路径、类别、关键点详细信息和其他相关信息。YAML 指定了每个关键点有 3 个维度的 24 个关键点,使其适用于详细的姿态估计任务。

要将此文件与 YOLO26 训练脚本一起使用,只需在训练命令中引用它,如 Usage 部分所示。数据集将在首次使用时自动下载,设置非常简单。

如需更多常见问题解答和详细文档,请访问 Ultralytics Documentation。