Link to this sectionSurveillance des entraînements avec Ultralytics YOLO26#

La surveillance des entraînements via l'estimation de pose avec Ultralytics YOLO26 améliore l'évaluation des exercices en suivant précisément les principaux points de repère et articulations du corps en temps réel. Cette technologie fournit un retour instantané sur la forme physique, suit les routines d'entraînement et mesure les indicateurs de performance, optimisant ainsi les séances d'entraînement pour les utilisateurs comme pour les entraîneurs.

Watch: How to Monitor Workout Exercises with Ultralytics YOLO | Squats, Leg Extension, Pushups and More

Link to this sectionAvantages de la surveillance des entraînements#

- Performance optimisée : Adapter les entraînements en fonction des données de surveillance pour de meilleurs résultats.

- Atteinte des objectifs : Suivre et ajuster les objectifs de remise en forme pour des progrès mesurables.

- Personnalisation : Plans d'entraînement personnalisés basés sur des données individuelles pour une efficacité optimale.

- Conscience de la santé : Détection précoce de modèles indiquant des problèmes de santé ou un surentraînement.

- Décisions éclairées : Décisions basées sur les données pour ajuster les routines et fixer des objectifs réalistes.

Link to this sectionApplications concrètes#

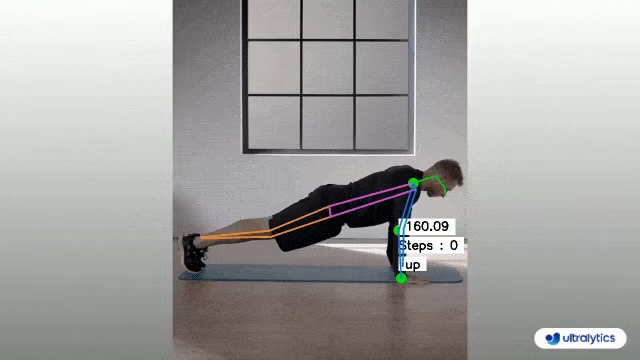

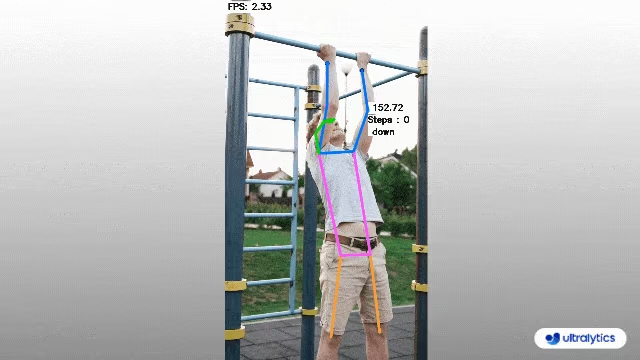

| Surveillance des entraînements | Surveillance des entraînements |

|---|---|

|  |

| Comptage des pompes | Comptage des tractions |

# Run a workout example

yolo solutions workout show=True

# Pass a source video

yolo solutions workout source="path/to/video.mp4"

# Use keypoints for pushups

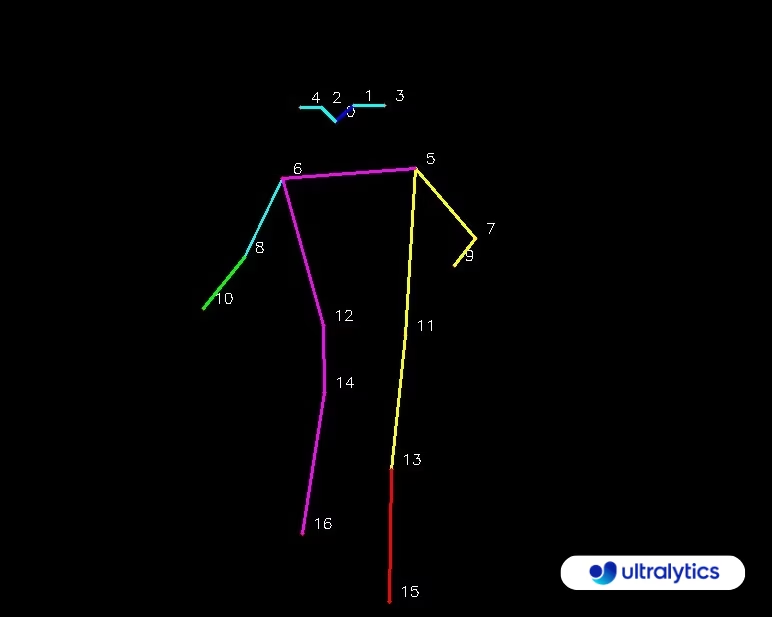

yolo solutions workout kpts="[6, 8, 10]"Link to this sectionCarte des points clés#

Link to this sectionArguments de AIGym#

Voici un tableau avec les arguments de AIGym :

| Argument | Type | Défaut | Description |

|---|---|---|---|

model | str | None | Chemin d'accès vers un fichier de modèle YOLO d'Ultralytics. |

up_angle | float | 145.0 | Seuil d'angle pour la posture 'vers le haut'. |

down_angle | int | 90 | Seuil d'angle pour la posture 'vers le bas'. |

kpts | list[int] | '[6, 8, 10]' | Liste de trois indices de points clés utilisés pour surveiller les exercices physiques. Ces points clés correspondent aux articulations ou parties du corps, comme les épaules, les coudes et les poignets, pour des exercices tels que les pompes, les tractions, les squats et les abdominaux. |

La solution AIGym prend également en charge une gamme de paramètres de suivi d'objets :

| Argument | Type | Défaut | Description |

|---|---|---|---|

tracker | str | 'botsort.yaml' | Spécifie l'algorithme de suivi à utiliser, par ex. bytetrack.yaml ou botsort.yaml. |

conf | float | 0.1 | Définit le seuil de confiance pour les détections ; des valeurs plus faibles permettent de suivre plus d'objets, mais peuvent inclure des faux positifs. |

iou | float | 0.7 | Définit le seuil d'Intersection sur Union (IoU) pour filtrer les détections qui se chevauchent. |

classes | list | None | Filtre les résultats par indice de classe. Par exemple, classes=[0, 2, 3] ne suit que les classes spécifiées. |

verbose | bool | True | Contrôle l'affichage des résultats de suivi, en fournissant une sortie visuelle des objets suivis. |

device | str | None | Spécifie le périphérique pour l'inférence (par ex. cpu, cuda:0 ou 0). Permet aux utilisateurs de choisir entre le CPU, un GPU spécifique ou d'autres dispositifs de calcul pour l'exécution du modèle. |

De plus, les paramètres de visualisation suivants peuvent être appliqués :

| Argument | Type | Défaut | Description |

|---|---|---|---|

show | bool | False | Si True, affiche les images ou vidéos annotées dans une fenêtre. Utile pour un retour visuel immédiat lors du développement ou des tests. |

line_width | int or None | None | Spécifie l'épaisseur de ligne des boîtes englobantes. Si None, l'épaisseur de ligne est automatiquement ajustée en fonction de la taille de l'image. Offre une personnalisation visuelle pour plus de clarté. |

show_conf | bool | True | Affiche le score de confiance pour chaque détection à côté de l'étiquette. Donne un aperçu de la certitude du modèle pour chaque détection. |

show_labels | bool | True | Affiche les étiquettes pour chaque détection dans la sortie visuelle. Permet une compréhension immédiate des objets détectés. |

Link to this sectionFAQ#

Link to this sectionComment surveiller mes entraînements avec Ultralytics YOLO26 ?#

Pour surveiller tes entraînements avec Ultralytics YOLO26, tu peux utiliser les fonctionnalités d'estimation de pose afin de suivre et d'analyser les principaux points de repère et articulations du corps en temps réel. Cela te permet de recevoir un retour instantané sur ta forme physique, de compter tes répétitions et de mesurer tes indicateurs de performance. Tu peux commencer en utilisant l'exemple de code fourni pour les pompes, les tractions ou les exercices abdominaux comme indiqué :

import cv2

from ultralytics import solutions

cap = cv2.VideoCapture("path/to/video.mp4")

assert cap.isOpened(), "Error reading video file"

w, h, fps = (int(cap.get(x)) for x in (cv2.CAP_PROP_FRAME_WIDTH, cv2.CAP_PROP_FRAME_HEIGHT, cv2.CAP_PROP_FPS))

gym = solutions.AIGym(

line_width=2,

show=True,

kpts=[6, 8, 10],

)

while cap.isOpened():

success, im0 = cap.read()

if not success:

print("Video frame is empty or processing is complete.")

break

results = gym(im0)

cv2.destroyAllWindows()Pour plus de personnalisation et de paramètres, tu peux consulter la section AIGym dans la documentation.

Link to this sectionQuels sont les avantages d'utiliser Ultralytics YOLO26 pour la surveillance des entraînements ?#

Utiliser Ultralytics YOLO26 pour la surveillance des entraînements offre plusieurs avantages clés :

- Performance optimisée : En adaptant les entraînements sur la base des données de surveillance, tu peux obtenir de meilleurs résultats.

- Atteinte des objectifs : Suis et ajuste facilement tes objectifs de remise en forme pour des progrès mesurables.

- Personnalisation : Obtiens des plans d'entraînement personnalisés basés sur tes données individuelles pour une efficacité optimale.

- Conscience de la santé : Détection précoce de modèles indiquant des problèmes de santé potentiels ou un surentraînement.

- Décisions éclairées : Prends des décisions basées sur les données pour ajuster tes routines et fixer des objectifs réalistes.

Tu peux regarder une démonstration vidéo sur YouTube pour voir ces avantages en action.

Link to this sectionQuelle est la précision d'Ultralytics YOLO26 dans la détection et le suivi des exercices ?#

Ultralytics YOLO26 est extrêmement précis pour détecter et suivre les exercices grâce à ses capacités d'estimation de pose à la pointe de la technologie. Il peut suivre avec précision les principaux points de repère et articulations du corps, fournissant un retour en temps réel sur la forme physique et les indicateurs de performance. Les poids pré-entraînés du modèle et son architecture robuste garantissent une précision et une fiabilité élevées. Pour des exemples concrets, consulte la section applications concrètes dans la documentation, qui présente le comptage des pompes et des tractions.

Link to this sectionPuis-je utiliser Ultralytics YOLO26 pour des routines d'entraînement personnalisées ?#

Oui, Ultralytics YOLO26 peut être adapté pour des routines d'entraînement personnalisées. La classe AIGym détecte les répétitions d'exercices en utilisant les arguments up_angle, down_angle et kpts. Tu peux spécifier des points clés et des angles pour détecter des exercices spécifiques. Voici un exemple de configuration :

from ultralytics import solutions

gym = solutions.AIGym(

line_width=2,

show=True,

kpts=[6, 8, 10], # For pushups - can be customized for other exercises

)Pour plus de détails sur la configuration des arguments, reporte-toi à la section Arguments AIGym. Cette flexibilité te permet de surveiller divers exercices et de personnaliser tes routines en fonction de tes objectifs de remise en forme.

Link to this sectionComment puis-je enregistrer le résultat de la surveillance des entraînements avec Ultralytics YOLO26 ?#

Pour enregistrer le résultat de la surveillance, tu peux modifier le code pour inclure un enregistreur vidéo qui sauvegarde les images traitées. Voici un exemple :

import cv2

from ultralytics import solutions

cap = cv2.VideoCapture("path/to/video.mp4")

assert cap.isOpened(), "Error reading video file"

w, h, fps = (int(cap.get(x)) for x in (cv2.CAP_PROP_FRAME_WIDTH, cv2.CAP_PROP_FRAME_HEIGHT, cv2.CAP_PROP_FPS))

video_writer = cv2.VideoWriter("workouts.avi", cv2.VideoWriter_fourcc(*"mp4v"), fps, (w, h))

gym = solutions.AIGym(

line_width=2,

show=True,

kpts=[6, 8, 10],

)

while cap.isOpened():

success, im0 = cap.read()

if not success:

print("Video frame is empty or processing is complete.")

break

results = gym(im0)

video_writer.write(results.plot_im)

cap.release()

video_writer.release()

cv2.destroyAllWindows()Cette configuration écrit la vidéo surveillée dans un fichier de sortie, te permettant de revoir tes performances d'entraînement plus tard ou de les partager avec des entraîneurs pour obtenir des retours supplémentaires.