Link to this sectionCOCO-Pose-Datensatz#

Der COCO-Pose-Datensatz ist eine spezialisierte Version des COCO-Datensatzes (Common Objects in Context), die für Pose-Estimation-Aufgaben entwickelt wurde. Er nutzt die Bilder und Labels der COCO Keypoints 2017, um das Training von Modellen wie YOLO für Pose-Estimation-Aufgaben zu ermöglichen.

Link to this sectionCOCO-Pose vortrainierte Modelle#

| Modell | Größe (Pixel) | mAPpose 50-95(e2e) | mAPpose 50(e2e) | Geschwindigkeit CPU ONNX (ms) | Geschwindigkeit T4 TensorRT10 (ms) | Parameter (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-pose | 640 | 57,2 | 83,3 | 40,3 ± 0,5 | 1,8 ± 0,0 | 2,9 | 7,5 |

| YOLO26s-pose | 640 | 63,0 | 86,6 | 85,3 ± 0,9 | 2,7 ± 0,0 | 10.4 | 23,9 |

| YOLO26m-pose | 640 | 68,8 | 89,6 | 218,0 ± 1,5 | 5,0 ± 0,1 | 21,5 | 73,1 |

| YOLO26l-pose | 640 | 70,4 | 90,5 | 275,4 ± 2,4 | 6,5 ± 0,1 | 25,9 | 91,3 |

| YOLO26x-pose | 640 | 71,6 | 91,6 | 565,4 ± 3,0 | 12,2 ± 0,2 | 57,6 | 201,7 |

Link to this sectionHauptfunktionen#

- COCO-Pose baut auf dem COCO Keypoints 2017-Datensatz auf, der 200.000 Bilder enthält, die mit Keypoints für Pose-Estimation-Aufgaben annotiert sind.

- Der Datensatz unterstützt 17 Keypoints für menschliche Figuren und ermöglicht so eine detaillierte Pose-Estimation.

- Wie COCO bietet er standardisierte Bewertungsmetriken, einschließlich der Object Keypoint Similarity (OKS) für Pose-Estimation-Aufgaben, wodurch er sich gut für den Vergleich der Modellleistung eignet.

Link to this sectionDatensatzstruktur#

Der COCO-Pose-Datensatz ist in drei Teilmengen unterteilt:

- Train2017: Diese Teilmenge enthält 56.599 Bilder aus dem COCO-Datensatz, die für das Training von Pose-Estimation-Modellen annotiert wurden.

- Val2017: Diese Teilmenge umfasst 2.346 Bilder, die zu Validierungszwecken während des Modelltrainings verwendet werden.

- Test2017: Dieser Teilbestand besteht aus Bildern, die zum Testen und Benchmarking der trainierten Modelle verwendet werden. Ground-Truth-Annotationen für diesen Teilbestand sind nicht öffentlich verfügbar, und die Ergebnisse werden zur Leistungsbewertung an den COCO evaluation server übermittelt.

Link to this sectionAnwendungen#

Der COCO-Pose-Datensatz wird speziell für das Training und die Evaluierung von Deep-Learning-Modellen bei Aufgaben der Keypoint-Erkennung und Pose-Estimation verwendet, wie z. B. OpenPose. Die große Anzahl annotierter Bilder und die standardisierten Bewertungsmetriken machen den Datensatz zu einer unverzichtbaren Ressource für Forscher und Anwender im Bereich Computer Vision, die sich auf Pose-Estimation konzentrieren.

Link to this sectionDatensatz-YAML#

Eine YAML-Datei (Yet Another Markup Language) wird verwendet, um die Dataset-Konfiguration zu definieren. Sie enthält Informationen über die Pfade des Datensatzes, Klassen und andere relevante Informationen. Im Fall des COCO-Pose-Datensatzes wird die coco-pose.yaml-Datei unter https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco-pose.yaml gepflegt.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 Keypoints dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/pose/coco/

# Example usage: yolo train data=coco-pose.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco-pose ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco-pose # dataset root dir

train: train2017.txt # train images (relative to 'path') 56599 images

val: val2017.txt # val images (relative to 'path') 2346 images

test: test-dev2017.txt # 20288 of 40670 images, submit to https://codalab.lisn.upsaclay.fr/competitions/7403

# Keypoints

kpt_shape: [17, 3] # number of keypoints, number of dims (2 for x,y or 3 for x,y,visible)

flip_idx: [0, 2, 1, 4, 3, 6, 5, 8, 7, 10, 9, 12, 11, 14, 13, 16, 15]

# Classes

names:

0: person

# Keypoint names per class

kpt_names:

0:

- nose

- left_eye

- right_eye

- left_ear

- right_ear

- left_shoulder

- right_shoulder

- left_elbow

- right_elbow

- left_wrist

- right_wrist

- left_hip

- right_hip

- left_knee

- right_knee

- left_ankle

- right_ankle

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

dir = Path(yaml["path"]) # dataset root dir

urls = [f"{ASSETS_URL}/coco2017labels-pose.zip"]

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)Link to this sectionVerwendung#

Um ein YOLO26n-pose-Modell auf dem COCO-Pose-Datensatz für 100 Epochen mit einer Bildgröße von 640 zu trainieren, kannst du die folgenden Code-Schnipsel verwenden. Eine umfassende Liste der verfügbaren Argumente findest du auf der Seite für das Modell-Training.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco-pose.yaml", epochs=100, imgsz=640)Link to this sectionBeispielbilder und Annotationen#

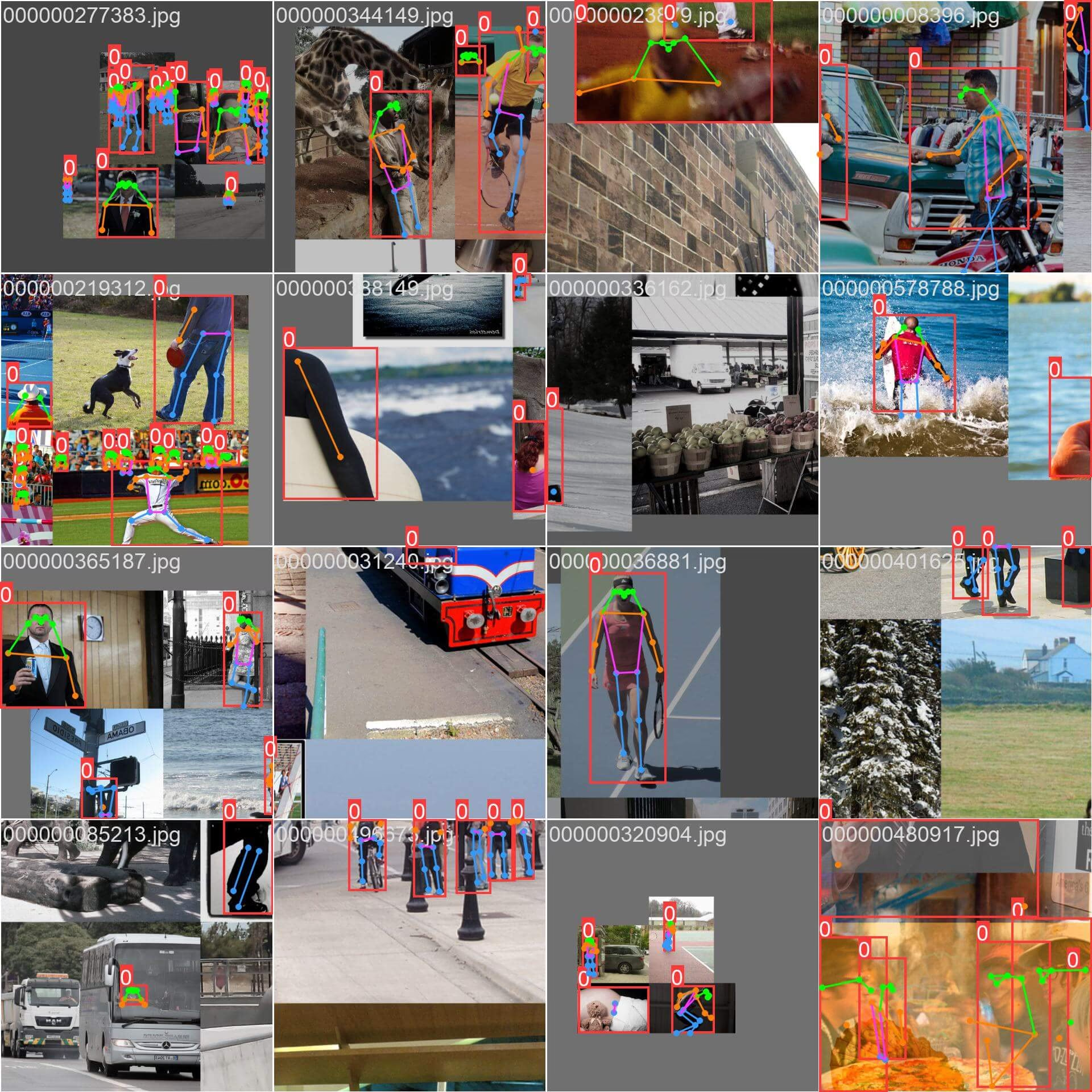

Der COCO-Pose-Datensatz enthält eine vielfältige Sammlung von Bildern mit menschlichen Figuren, die mit Keypoints annotiert sind. Hier sind einige Beispiele von Bildern aus dem Datensatz, zusammen mit den entsprechenden Annotationen:

- Mosaik-Bild: Dieses Bild zeigt einen Trainings-Batch, der aus mosaikierten Datensatz-Bildern besteht. Mosaicing ist eine Technik, die während des Trainings verwendet wird, um mehrere Bilder zu einem einzigen Bild zu kombinieren, um die Vielfalt der Objekte und Szenen innerhalb jedes Trainings-Batches zu erhöhen. Dies trägt dazu bei, die Fähigkeit des Modells zu verbessern, auf verschiedene Objektgrößen, Seitenverhältnisse und Kontexte zu generalisieren.

Das Beispiel verdeutlicht die Vielfalt und Komplexität der Bilder im COCO-Pose-Datensatz sowie die Vorteile der Verwendung von Mosaicing während des Trainingsprozesses.

Link to this sectionZitate und Danksagungen#

Wenn du den COCO-Pose-Datensatz in deiner Forschung oder Entwicklungsarbeit verwendest, zitiere bitte das folgende Paper:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Wir möchten dem COCO-Konsortium für die Erstellung und Pflege dieser wertvollen Ressource für die Computer-Vision-Community danken. Weitere Informationen über den COCO-Pose-Datensatz und seine Ersteller findest du auf der COCO-Datensatz-Website.

Link to this sectionFAQ#

Link to this sectionWas ist der COCO-Pose-Datensatz und wie wird er mit Ultralytics YOLO für Pose-Estimation verwendet?#

Der COCO-Pose-Datensatz ist eine spezialisierte Version des COCO-Datensatzes (Common Objects in Context), der für Pose-Estimation-Aufgaben entwickelt wurde. Er baut auf den Bildern und Annotationen von COCO Keypoints 2017 auf und ermöglicht das Training von Modellen wie Ultralytics YOLO für eine detaillierte Pose-Estimation. Du kannst den COCO-Pose-Datensatz beispielsweise verwenden, um ein YOLO26n-pose-Modell zu trainieren, indem du ein vortrainiertes Modell lädst und es mit einer YAML-Konfiguration trainierst. Beispiele für das Training findest du in der Training-Dokumentation.

Link to this sectionWie kann ich ein YOLO26-Modell auf dem COCO-Pose-Datensatz trainieren?#

Das Training eines YOLO26-Modells auf dem COCO-Pose-Datensatz kann entweder über Python oder CLI-Befehle erfolgen. Um zum Beispiel ein YOLO26n-pose-Modell für 100 Epochen mit einer Bildgröße von 640 zu trainieren, kannst du die folgenden Schritte befolgen:

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco-pose.yaml", epochs=100, imgsz=640)Weitere Details zum Trainingsprozess und zu den verfügbaren Argumenten findest du auf der Training-Seite.

Link to this sectionWelche verschiedenen Metriken bietet der COCO-Pose-Datensatz zur Bewertung der Modellleistung?#

Der COCO-Pose-Datensatz bietet mehrere standardisierte Bewertungsmetriken für Pose-Estimation-Aufgaben, ähnlich wie der ursprüngliche COCO-Datensatz. Zu den wichtigsten Metriken gehört die Object Keypoint Similarity (OKS), die die Genauigkeit der vorhergesagten Keypoints gegenüber Ground-Truth-Annotationen bewertet. Diese Metriken ermöglichen gründliche Leistungsvergleiche zwischen verschiedenen Modellen. Zum Beispiel haben die vortrainierten COCO-Pose-Modelle wie YOLO26n-pose, YOLO26s-pose und andere spezifische Leistungsmetriken, die in der Dokumentation aufgeführt sind, wie mAPpose50-95 und mAPpose50.

Link to this sectionWie ist der COCO-Pose-Datensatz strukturiert und unterteilt?#

Der COCO-Pose-Datensatz ist in drei Teilmengen unterteilt:

- Train2017: Enthält 56.599 COCO-Bilder, die für das Training von Pose-Estimation-Modellen annotiert wurden.

- Val2017: 2.346 Bilder für Validierungszwecke während des Modelltrainings.

- Test2017: Bilder, die zum Testen und Benchmarking trainierter Modelle verwendet werden. Ground-Truth-Annotationen für diesen Teilbestand sind nicht öffentlich verfügbar; Ergebnisse werden zur Leistungsbewertung an den COCO evaluation server übermittelt.

Diese Teilmengen helfen dabei, die Trainings-, Validierungs- und Testphasen effektiv zu organisieren. Konfigurationsdetails findest du in der Datei coco-pose.yaml, die auf GitHub verfügbar ist.

Link to this sectionWas sind die wichtigsten Funktionen und Anwendungen des COCO-Pose-Datensatzes?#

Der COCO-Pose-Datensatz erweitert die COCO Keypoints 2017-Annotationen um 17 Keypoints für menschliche Figuren, was eine detaillierte Pose-Estimation ermöglicht. Standardisierte Bewertungsmetriken (z. B. OKS) erleichtern den Vergleich verschiedener Modelle. Anwendungen des COCO-Pose-Datensatzes erstrecken sich über verschiedene Bereiche wie Sportanalytik, Gesundheitswesen und Mensch-Computer-Interaktion, überall dort, wo eine detaillierte Pose-Estimation menschlicher Figuren erforderlich ist. Für die praktische Anwendung kann der Einsatz vortrainierter Modelle, wie sie in der Dokumentation bereitgestellt werden (z. B. YOLO26n-pose), den Prozess erheblich vereinfachen (Wichtige Funktionen).

Wenn du den COCO-Pose-Datensatz in deiner Forschung oder Entwicklungsarbeit verwendest, zitiere bitte das Paper mit dem folgenden BibTeX-Eintrag.