COCO-Pose データセット

COCO-Pose データセットは、姿勢推定タスク用に設計された COCO (Common Objects in Context) データセットの特殊なバージョンです。COCO Keypoints 2017 の画像とラベルを活用して、YOLO のようなモデルの姿勢推定タスクでのトレーニングを可能にします。

COCO-Pose 事前学習済みモデル

| モデル | サイズ (ピクセル) | mAPpose 50-95(e2e) | mAPpose 50(e2e) | 速度 CPU ONNX (ms) | 速度 T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-pose | 640 | 57.2 | 83.3 | 40.3 ± 0.5 | 1.8 ± 0.0 | 2.9 | 7.5 |

| YOLO26s-pose | 640 | 63.0 | 86.6 | 85.3 ± 0.9 | 2.7 ± 0.0 | 10.4 | 23.9 |

| YOLO26m-pose | 640 | 68.8 | 89.6 | 218.0 ± 1.5 | 5.0 ± 0.1 | 21.5 | 73.1 |

| YOLO26l-pose | 640 | 70.4 | 90.5 | 275.4 ± 2.4 | 6.5 ± 0.1 | 25.9 | 91.3 |

| YOLO26x-pose | 640 | 71.6 | 91.6 | 565.4 ± 3.0 | 12.2 ± 0.2 | 57.6 | 201.7 |

主な特徴

- COCO-Pose は、姿勢推定タスク用のキーポイントがラベル付けされた 20万枚の画像を含む COCO Keypoints 2017 データセットを基盤としています。

- このデータセットは、人物に対して17個のキーポイントをサポートしており、詳細な姿勢推定を容易にします。

- COCO と同様に、姿勢推定タスク用の Object Keypoint Similarity (OKS) を含む標準化された評価メトリクスを提供しており、モデル性能の比較に適しています。

データセットの構造

COCO-Pose データセットは、3つのサブセットに分割されています。

- Train2017: このサブセットには、COCO データセットから56599枚の画像が含まれており、姿勢推定モデルのトレーニング用にアノテーションが付けられています。

- Val2017: このサブセットには、モデルのトレーニング中の検証を目的として使用される2346枚の画像があります。

- Test2017: このサブセットは、トレーニング済みモデルのテストおよびベンチマークに使用される画像で構成されています。このサブセットのグラウンドトゥルースアノテーションは公開されておらず、結果は性能評価のために COCO 評価サーバー に提出されます。

アプリケーション

COCO-Pose データセットは、OpenPose のようなキーポイント detect および姿勢推定タスクにおける ディープラーニング モデルのトレーニングと評価に特化して使用されます。このデータセットの大量のアノテーション付き画像と標準化された評価メトリクスは、姿勢推定に焦点を当てた コンピュータービジョン の研究者や実務家にとって不可欠なリソースとなっています。

データセット YAML

データセット構成を定義するために YAML (Yet Another Markup Language) ファイルが使用されます。これには、データセットのパス、クラス、およびその他の関連情報が含まれます。COCO-Pose データセットの場合、 coco-pose.yaml fileは以下で管理されています: https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco-pose.yaml.

ultralytics/cfg/datasets/coco-pose.yaml

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 Keypoints dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/pose/coco/

# Example usage: yolo train data=coco-pose.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco-pose ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco-pose # dataset root dir

train: train2017.txt # train images (relative to 'path') 56599 images

val: val2017.txt # val images (relative to 'path') 2346 images

test: test-dev2017.txt # 20288 of 40670 images, submit to https://codalab.lisn.upsaclay.fr/competitions/7403

# Keypoints

kpt_shape: [17, 3] # number of keypoints, number of dims (2 for x,y or 3 for x,y,visible)

flip_idx: [0, 2, 1, 4, 3, 6, 5, 8, 7, 10, 9, 12, 11, 14, 13, 16, 15]

# Classes

names:

0: person

# Keypoint names per class

kpt_names:

0:

- nose

- left_eye

- right_eye

- left_ear

- right_ear

- left_shoulder

- right_shoulder

- left_elbow

- right_elbow

- left_wrist

- right_wrist

- left_hip

- right_hip

- left_knee

- right_knee

- left_ankle

- right_ankle

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

dir = Path(yaml["path"]) # dataset root dir

urls = [f"{ASSETS_URL}/coco2017labels-pose.zip"]

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)

使用法

COCO-PoseデータセットでYOLO26n-poseモデルを画像サイズ640で100 エポックトレーニングするには、以下のコードスニペットを使用できます。利用可能な引数の包括的なリストについては、モデルのトレーニングページを参照してください。

学習の例

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco-pose.yaml", epochs=100, imgsz=640)

# Start training from a pretrained *.pt model

yolo pose train data=coco-pose.yaml model=yolo26n-pose.pt epochs=100 imgsz=640

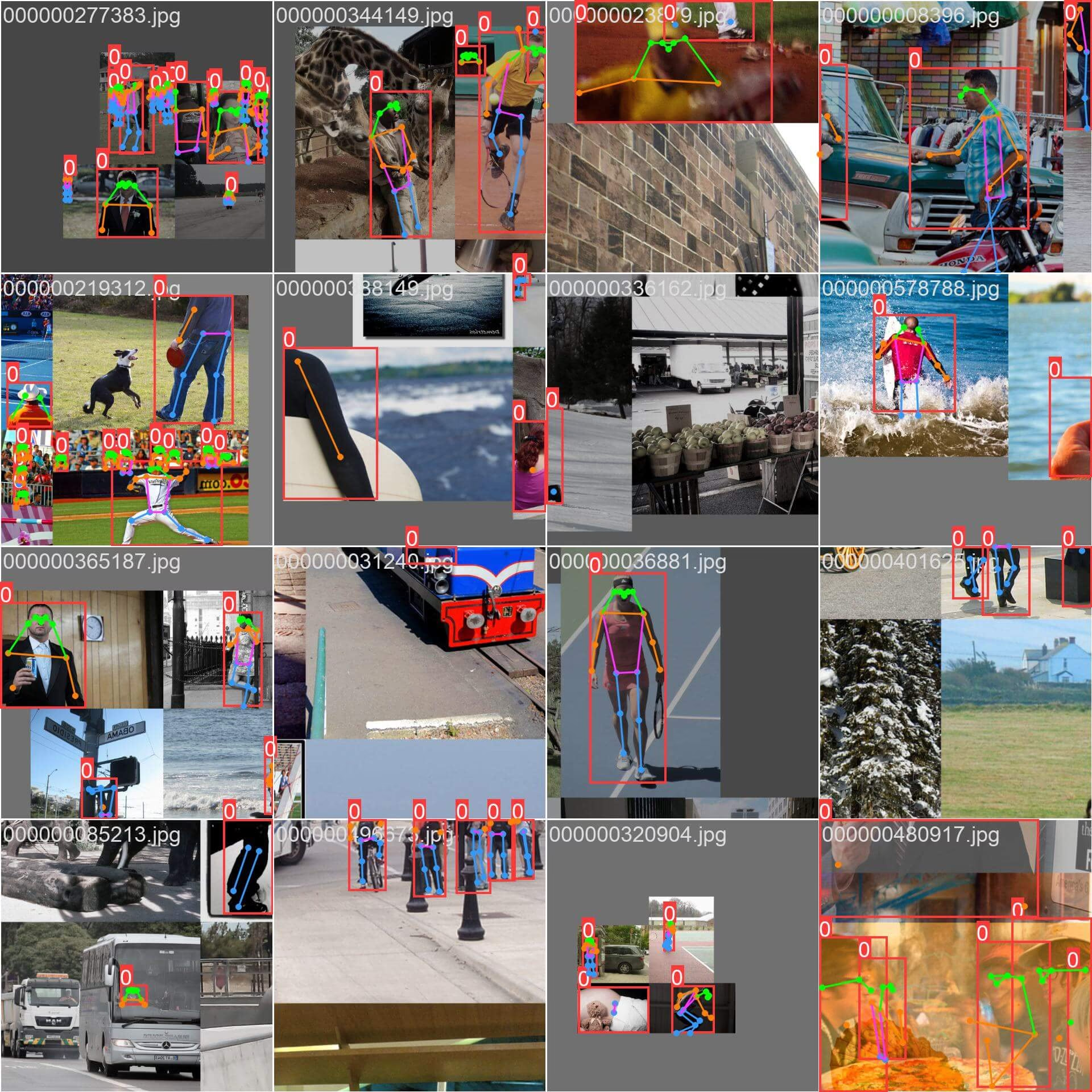

サンプル画像とアノテーション

COCO-Pose データセットには、キーポイントでアノテーションが付けられた人物像を含む多様な画像セットが含まれています。以下に、データセットからの画像とその対応するアノテーションの例を示します。

- モザイク化された画像: この画像は、モザイク化されたデータセット画像で構成されるトレーニングバッチを示しています。モザイキングは、各トレーニングバッチ内のオブジェクトとシーンの多様性を高めるために、複数の画像を1つの画像に結合するトレーニング中に使用される手法です。これにより、さまざまなオブジェクトのサイズ、アスペクト比、およびコンテキストに対するモデルの汎化能力が向上します。

この例は、COCO-Poseデータセット内の画像の多様性と複雑さ、および学習プロセス中にモザイキングを使用することの利点を示しています。

引用と謝辞

研究または開発作業でCOCO-Poseデータセットを使用する場合は、以下の論文を引用してください。

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

コンピュータービジョンコミュニティのためにこの貴重なリソースを作成し、維持しているCOCO Consortiumに感謝いたします。COCO-Poseデータセットとその作成者に関する詳細については、COCOデータセットのウェブサイトをご覧ください。

よくある質問

COCO-Pose データセットとは何ですか?また、姿勢推定のために Ultralytics YOLO とどのように使用されますか?

The COCO-Poseデータセットは、姿勢推定タスク用に設計されたCOCO(Common Objects in Context)データセットの特殊なバージョンです。COCO Keypoints 2017の画像とアノテーションを基盤としており、Ultralytics YOLOのようなモデルを詳細な姿勢推定のためにトレーニングすることを可能にします。例えば、COCO-Poseデータセットを使用して、事前学習済みモデルをロードし、yaml設定でトレーニングすることでYOLO26n-poseモデルをトレーニングできます。トレーニング例については、トレーニングドキュメントを参照してください。

COCO-PoseデータセットでYOLO26モデルをトレーニングするにはどうすればよいですか?

COCO-PoseデータセットでYOLO26モデルをトレーニングするには、pythonまたはCLIコマンドを使用できます。例えば、画像サイズ640で100エポックのYOLO26n-poseモデルをトレーニングするには、以下の手順に従ってください。

学習の例

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco-pose.yaml", epochs=100, imgsz=640)

# Start training from a pretrained *.pt model

yolo pose train data=coco-pose.yaml model=yolo26n-pose.pt epochs=100 imgsz=640

トレーニングプロセスと利用可能な引数の詳細については、トレーニングページを確認してください。

モデル性能を評価するために COCO-Pose データセットが提供する異なるメトリクスは何ですか?

COCO-Poseデータセットは、元のCOCOデータセットと同様に、姿勢推定タスク用のいくつかの標準化された評価指標を提供します。主要な指標には、予測されたキーポイントとグラウンドトゥルースアノテーションの精度を評価するObject Keypoint Similarity (OKS) が含まれます。これらの指標により、異なるモデル間の徹底的なパフォーマンス比較が可能になります。例えば、YOLO26n-pose、YOLO26s-poseなどのCOCO-Pose事前学習済みモデルには、mAPpose50-95やmAPpose50のような特定のパフォーマンス指標がドキュメントに記載されています。

COCO-Pose データセットの構造と分割はどのようになっていますか?

COCO-Pose データセットは、3つのサブセットに分割されています。

- Train2017: 姿勢推定モデルの学習用にアノテーションされた56599枚のCOCO画像が含まれています。

- Val2017: モデルのトレーニング中の検証を目的とした2346枚の画像。

- Test2017: 学習済みモデルのテストおよびベンチマークに使用される画像。このサブセットのグラウンドトゥルースアノテーションは公開されていません。結果は性能評価のためにCOCO評価サーバーに提出されます。

これらのサブセットは、トレーニング、検証、およびテストのフェーズを効果的に整理するのに役立ちます。構成の詳細については、以下をご覧ください。 coco-pose.yaml ファイルは以下で入手できます。 GitHub.

COCO-Pose データセットの主要な機能とアプリケーションは何ですか?

COCO-Poseデータセットは、COCO Keypoints 2017のアノテーションを拡張し、人物の17個のキーポイントを含めることで、詳細な姿勢推定を可能にします。標準化された評価指標(例:OKS)は、異なるモデル間の比較を容易にします。COCO-Poseデータセットの応用範囲は、スポーツ分析、ヘルスケア、ヒューマンコンピュータインタラクションなど、人物の詳細な姿勢推定が必要とされる様々な領域に及びます。実用的な利用では、ドキュメントに記載されているような事前学習済みモデル(例:YOLO26n-pose)を活用することで、プロセスを大幅に効率化できます(主な機能)。

研究または開発作業でCOCO-Poseデータセットを使用する場合は、以下のBibTeXエントリで論文を引用してください。