Ultralytics Platform

Ultralytics Platform es una plataforma integral de visión artificial de extremo a extremo que optimiza todo el flujo de trabajo de ML, desde la preparación de datos hasta el despliegue del modelo. Diseñada para equipos e individuos que necesitan soluciones de visión artificial listas para producción sin la complejidad de la infraestructura.

¿Qué es Ultralytics Platform?

Ultralytics Platform está diseñada para reemplazar las herramientas de ML fragmentadas con una solución unificada. Combina las capacidades de:

- Roboflow - Gestión y anotación de datos

- Weights & Biases - Seguimiento de experimentos

- SageMaker - Entrenamiento en la nube

- HuggingFace - Despliegue de modelos

- Arize - Monitorización

Plataforma todo en uno con soporte nativo para YOLO26 y YOLO11 .

Flujo de trabajo: Cargar → Anotar → Entrenar → Exportar → Implementar

La plataforma ofrece un flujo de trabajo integral:

graph LR

subgraph Data["📁 Data"]

A[Upload] --> B[Annotate]

B --> C[Analyze]

end

subgraph Train["🚀 Train"]

D[Configure] --> E[Train on GPU]

E --> F[View Metrics]

end

subgraph Deploy["🌐 Deploy"]

G[Export] --> H[Deploy Endpoint]

H --> I[Monitor]

end

Data --> Train --> Deploy| Etapa | Características |

|---|---|

| Cargar | Imágenes (50 MB), vídeos (1 GB), archivos ZIP (10 GB) con procesamiento automático. |

| Anotar | Herramientas manuales, anotación SAM , YOLO para los 5 tipos de tareas (consulte las tareas compatibles). |

| Entrenar | GPU en la nube (22 opciones, desde RTX 2000 Ada hasta B200), métricas en tiempo real, organización de proyectos. |

| Exportar | 17 formatos de implementación (ONNX, TensorRT, CoreML, TFLite, etc.; consulte los formatos compatibles) |

| Despliegue | 43 regiones globales con terminales dedicados, escalado automático y supervisión. |

Lo que puedes hacer:

- Sube imágenes, vídeos y archivos ZIP para crear conjuntos de datos de entrenamiento.

- Visualiza anotaciones con superposiciones interactivas para los 5 tipos YOLO (consulta las tareas compatibles).

- Entrena modelos en 22 GPU en la nube con métricas en tiempo real.

- Exportación a 17 formatos de implementación (ONNX, TensorRT, CoreML, TFLite, etc.)

- Implemente en 43 regiones globales con terminales dedicados con un solo clic.

- Supervisar el progreso de la formación, el estado de la implementación y las métricas de uso.

- Colabora haciendo públicos los proyectos y conjuntos de datos para la comunidad.

Infraestructura multirregional

Sus datos permanecen en su región. La plataforma Ultralytics opera infraestructura en tres regiones globales:

| Región | Etiqueta | Ubicación | Ideal para |

|---|---|---|---|

| EE. UU. | América | Iowa, EE. UU. | Usuarios de América, el más rápido para América |

| UE | Europa, Oriente Medio y África | Bélgica, Europa | Usuarios europeos, cumplimiento del RGPD |

| AP | Asia-Pacífico | Hong Kong, Asia-Pacífico | Usuarios de Asia-Pacífico, latencia más baja de APAC |

Usted selecciona su región durante la incorporación, y todos sus datos, modelos y despliegues permanecen en esa región.

Región Permanente

La región de datos no se puede cambiar después de crear la cuenta. Durante el proceso de incorporación, la plataforma mide la latencia de cada región y recomienda la más cercana. Elige con cuidado.

Características clave

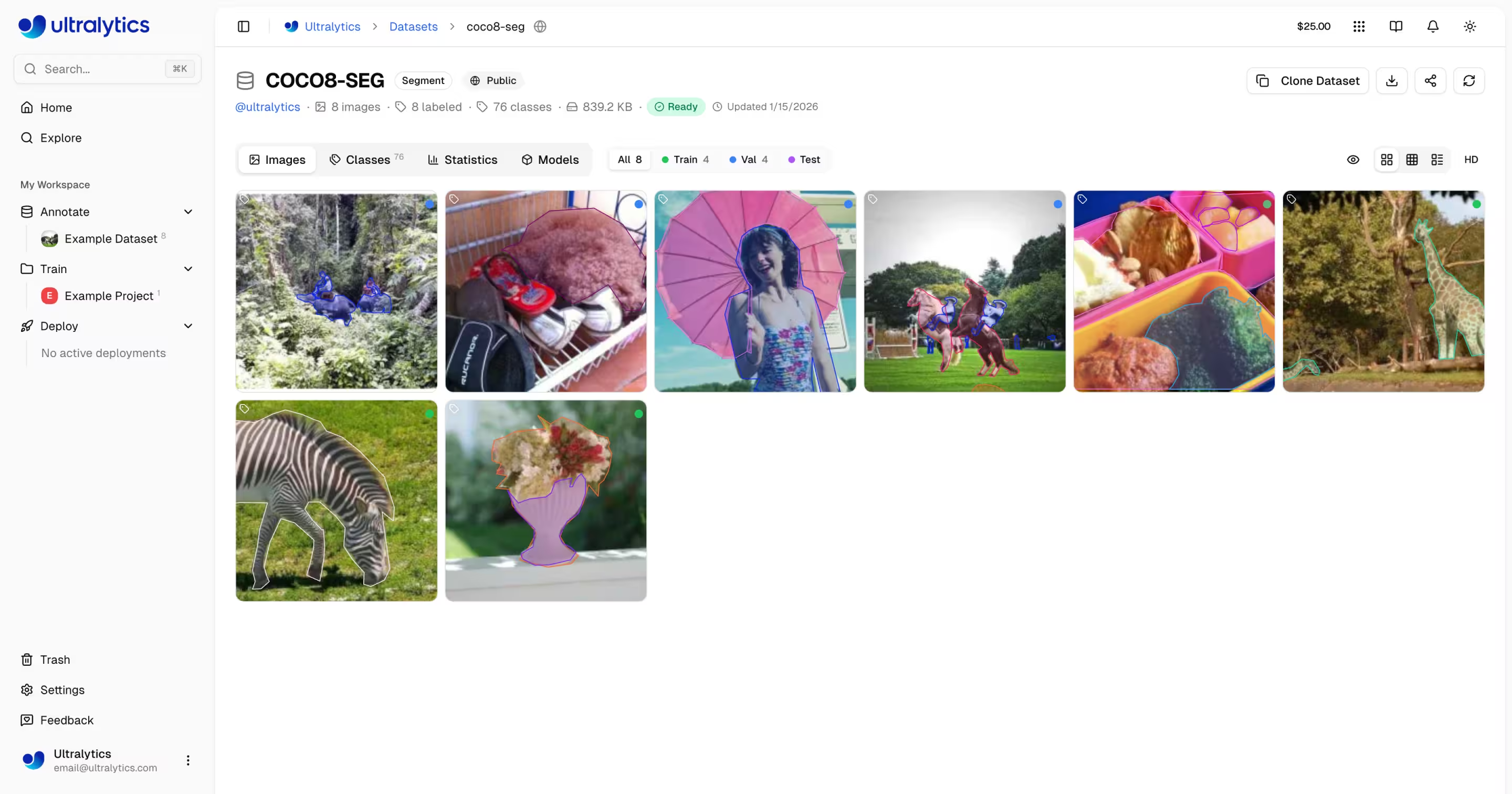

Preparación de datos

- Gestión de Conjuntos de Datos: Suba imágenes, videos o archivos ZIP con procesamiento automático

- Editor de anotaciones: Anotación manual para los 5 tipos YOLO (detect, segment, pose, OBB, classify; ver tareas compatibles).

- Plantillas de esqueletos: Plantillas de esqueletos integradas (persona, mano, cara, perro, caja) y personalizadas para la anotación de poses con un solo clic.

- AnotaciónSAM : anotación inteligente basada en clics con 5 modelos: SAM .SAM (Tiny, Small, Base, Large) y el nuevo SAM para una precisión máxima. Cambie de modelo por imagen desde la barra de herramientas de anotación.

- Auto-Anotación: Utilice modelos entrenados para pre-etiquetar nuevos datos

- Control de versiones de conjuntos de datos: cree instantáneas NDJSON numeradas con descripciones para un entrenamiento reproducible.

- Estadísticas: Distribución de clases, mapas de calor de ubicación y análisis de dimensiones

graph LR

A[Upload ZIP/Images/Video] --> B[Auto-Process]

B --> C[Browse & Filter]

C --> D{Annotate}

D --> E[Manual Tools]

D --> F[SAM Smart]

D --> G[YOLO Auto-Label]

E --> H[Train-Ready Dataset]

F --> H

G --> HTipos de Tarea Compatibles

El editor de anotaciones admite los 5 tipos YOLO : detect (cuadros delimitadores), segment (polígonos), pose (puntos clave), OBB (cajas orientadas) y classify (etiquetas a nivel de imagen). Cada tipo de tarea tiene herramientas de dibujo y atajos de teclado específicos.

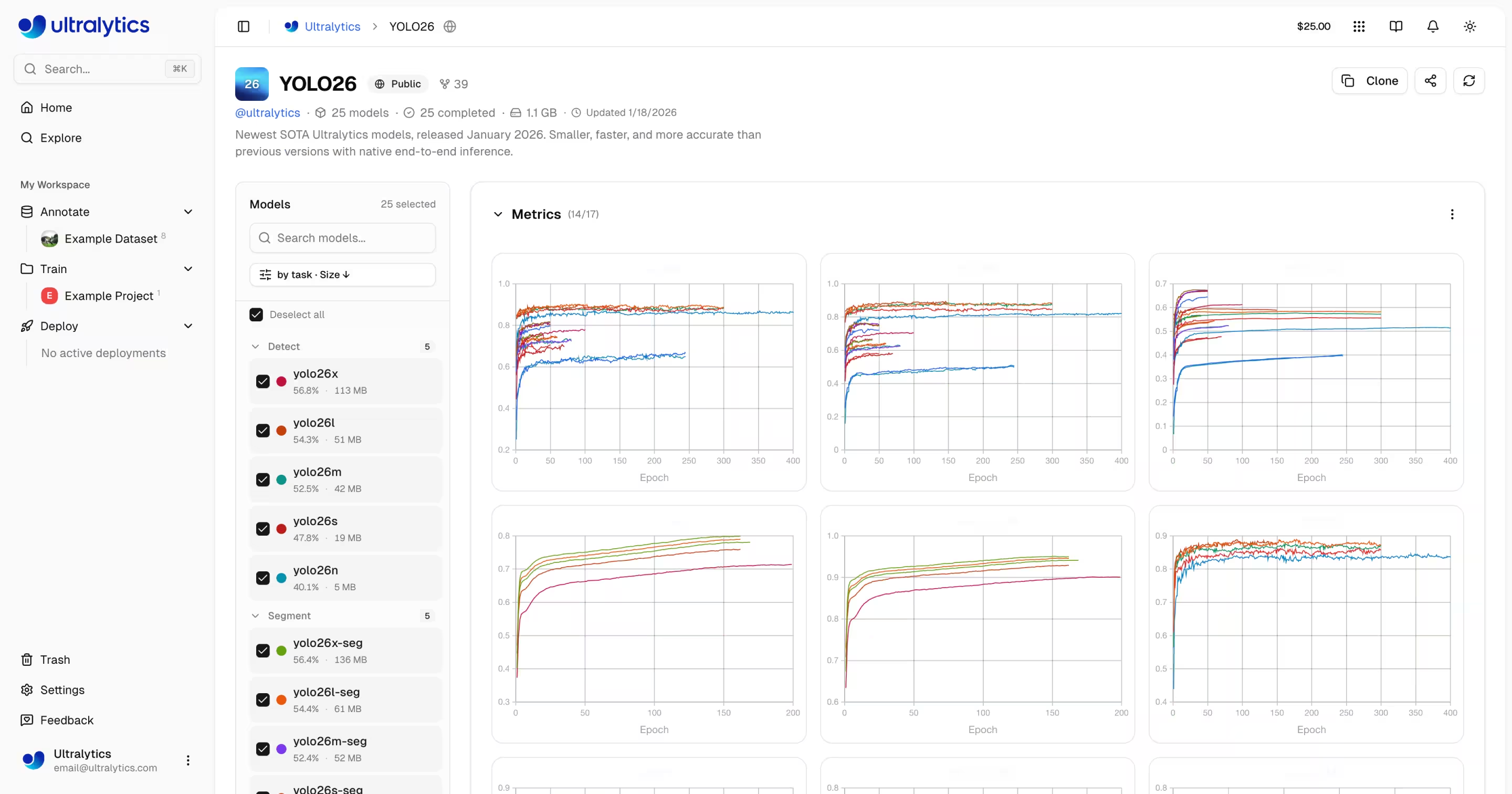

Entrenamiento de modelos

- Formación en la nube: aprenda a utilizar 22 GPU en la nube con métricas en tiempo real.

- Entrenamiento remoto: Entrena en cualquier lugar y transmite las métricas a la plataforma (estilo W&B).

- Organización de Proyectos: Agrupe modelos relacionados, compare experimentos, realice seguimiento de la actividad

- 17 formatos de exportación: ONNX, TensorRT, CoreML, TFLite y más (consulte los formatos compatibles).

Puede entrenar modelos a través de la interfaz de usuario web (entrenamiento en la nube) o desde su propio equipo (entrenamiento remoto):

- Navegue a su proyecto

- Haga clic

Train Model - Seleccionar conjunto de datos, modelo, GPU y épocas.

- Supervise las curvas y métricas de pérdidas en tiempo real.

# Install ultralytics

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="your_api_key"

# Train and stream metrics to the platform

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "your_api_key"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Metrics stream to Platform automatically

Despliegue

- Pruebas de Inferencia: Pruebe modelos directamente en el navegador con imágenes personalizadas

- Endpoints Dedicados: Despliegue en 43 regiones globales con autoescalado

- Monitoreo: Métricas en tiempo real, registros de solicitudes y paneles de rendimiento

graph LR

A[Trained Model] --> B{Action}

B --> C[Browser Predict]

B --> D[Export Format]

B --> E[Deploy Endpoint]

D --> F[ONNX / TensorRT / CoreML / TFLite / ...]

E --> G[43 Global Regions]

G --> H[API Endpoint URL]

H --> I[Monitor & Scale]Una vez implementado, llame a su punto final desde cualquier lenguaje:

import requests

url = "https://your-endpoint-url/predict"

headers = {"Authorization": "Bearer your_api_key"}

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, files={"file": f})

print(response.json())

curl -X POST "https://your-endpoint-url/predict" \

-H "Authorization: Bearer your_api_key" \

-F "file=@image.jpg"

const form = new FormData();

form.append("file", fileInput.files[0]);

const response = await fetch("https://your-endpoint-url/predict", {

method: "POST",

headers: { Authorization: "Bearer your_api_key" },

body: form,

});

const results = await response.json();

console.log(results);

Gestión de cuentas

- Equipos y organizaciones: colabora con los miembros del equipo, gestiona funciones e invita a otros usuarios.

- API Keys: Gestión segura de claves para entrenamiento remoto y acceso a la API

- Créditos y Facturación: Entrenamiento de pago por uso con precios transparentes

- Feed de actividad: Realiza un seguimiento de todos los eventos y acciones de la cuenta.

- Papelera y restauración: eliminación temporal durante 30 días con recuperación de elementos.

- Cumplimiento GDPR: Exportación de datos y eliminación de cuentas

Niveles del plan

| Característica | Gratuito | Pro (29 $/mes) | Empresarial |

|---|---|---|---|

| Crédito de Registro | 5 $ / 25 $* | - | Personalizado |

| Crédito mensual | - | 30 $ por asiento al mes | Personalizado |

| Modelos | 100 | 500 | Ilimitado |

| Formaciones simultáneas | 3 | 10 | Ilimitado |

| Despliegues | 3 | 10 (arranque en caliente) | Ilimitado |

| Almacenamiento | 100 GB | 500 GB | Ilimitado |

| Equipos | - | Hasta 5 miembros | Hasta 50 |

| Soporte | Comunidad | Prioridad | Dedicado |

*5 $ al registrarse, o 25 $ con un correo electrónico corporativo/de trabajo verificado.

Enlaces rápidos

Empiece con estos recursos:

- Inicio Rápido: Cree su primer proyecto y entrene un modelo en minutos

- Conjuntos de Datos: Suba y gestione sus datos de entrenamiento

- Anotación: Etiquete sus datos con herramientas manuales y asistidas por IA

- Proyectos: Organice sus modelos y experimentos

- Entrenamiento en la Nube: Entrene en GPUs en la nube

- Inferencia: Pruebe sus modelos

- Endpoints: Despliegue modelos a producción

- Monitorización: track el rendimiento del despliegue

- API Keys: Gestione el acceso a la API

- Facturación: Créditos y pago

- Actividad: Realizar un seguimiento de los eventos de la cuenta.

- Papelera: Recuperar elementos eliminados

- REST API: Referencia de la API

Preguntas frecuentes

¿Cómo empiezo con Ultralytics Platform?

Para empezar con Ultralytics Platform:

- Registrarse: Cree una cuenta en platform.ultralytics.com

- Seleccionar Región: Elija su región de datos (EE. UU., UE o AP) durante la incorporación

- Subir Conjunto de Datos: Vaya a la sección de Conjuntos de Datos para subir sus datos

- Entrenar Modelo: Cree un proyecto y empiece a entrenar en GPUs en la nube

- Desplegar: Pruebe su modelo y despliegue a un endpoint dedicado

Para una guía detallada, consulte la página de Inicio Rápido.

¿Cuáles son los beneficios de Ultralytics Platform?

Ultralytics Platform ofrece:

- Flujo de Trabajo Unificado: Datos, entrenamiento y despliegue en un solo lugar

- Multirregión: Residencia de datos en regiones de EE. UU., UE o AP

- Entrenamiento sin código: Entrene modelos avanzados de YOLO sin escribir código

- Métricas en tiempo real: Transmita el progreso del entrenamiento y supervise las implementaciones

- 43 Regiones de despliegue: Despliegue modelos cerca de sus usuarios en todo el mundo

- 5 tipos de tareas: compatibilidad con detección, segmentación, pose, OBB y clasificación (consulte la documentación de tareas).

- Anotación asistida por IA: SAM y autoetiquetado para acelerar la preparación de datos

¿Qué opciones de GPU están disponibles para el entrenamiento en la nube?

La Plataforma Ultralytics es compatible con múltiples tipos de GPU para el entrenamiento en la nube:

| GPU | VRAM | Costo por hora | Ideal para |

|---|---|---|---|

| RTX 2000 Ada | 16 GB | $0.24 | Conjuntos de datos pequeños, pruebas |

| RTX A4500 | 20 GB | $0.24 | Conjuntos de datos pequeños y medianos |

| RTX A5000 | 24 GB | $0.26 | Conjuntos de datos medianos |

| RTX 4000 Ada | 20 GB | $0.38 | Conjuntos de datos medianos |

| L4 | 24 GB | $0.39 | Inferencia optimizada |

| A40 | 48 GB | $0.40 | Tamaños de lotes más grandes |

| RTX 3090 | 24 GB | $0.46 | Formación general |

| RTX A6000 | 48 GB | $0.49 | Modelos grandes |

| RTX 4090 | 24 GB | $0.59 | Excelente relación calidad-precio |

| RTX 6000 Ada | 48 GB | $0.77 | Entrenamiento por lotes grandes |

| L40S | 48 GB | $0.86 | Entrenamiento por lotes grandes |

| RTX 5090 | 32 GB | $0.89 | Última generación |

| L40 | 48 GB | $0.99 | Modelos grandes |

| A100 PCIe | 80 GB | $1.39 | Formación en producción |

| A100 SXM | 80 GB | $1.49 | Formación en producción |

| RTX PRO 6000 | 96 GB | $1.89 | Recomendado por defecto |

| H100 PCIe | 80 GB | $2.39 | Entrenamiento más rápido |

| H100 SXM | 80 GB | $2.69 | Entrenamiento más rápido |

| H100 NVL | 94 GB | $3.07 | Entrenamiento de alta memoria |

| H200 NVL | 143 GB | $3.39 | Memoria máxima |

| H200 SXM | 141 GB | $3.59 | Máximo rendimiento |

| B200 | 180 GB | $4.99 | Modelos más grandes |

Consulte Formación en la nube para obtener información completa sobre precios y GPU .

¿Cómo funciona el entrenamiento remoto?

Puedes entrenar modelos en tu propio hardware y transmitir métricas en tiempo real a la plataforma, de forma similar a Weights & Biases.

Requisito de Versión del Paquete

La integración con Platform requiere ultralytics>= 8.4.14. Las versiones anteriores NO funcionarán con Platform.

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="your_api_key"

# Train with project/name to stream metrics

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "your_api_key"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Train using a Platform dataset directly

export ULTRALYTICS_API_KEY="your_api_key"

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 project=username/my-project name=exp1

Consulte Entrenamiento en la Nube para obtener más detalles sobre el entrenamiento remoto.

¿Qué herramientas de anotación están disponibles?

La Plataforma incluye un editor de anotaciones con todas las funciones, compatible con:

- Herramientas manuales: Cuadros delimitadores, polígonos, puntos clave con plantillas de esqueleto, cuadros orientados, clasificación.

- Plantillas esqueléticas: coloca todos los puntos clave a la vez utilizando plantillas integradas (persona, mano, cara, perro, caja) o personalizadas.

- AnotaciónSAM : haga clic para generar máscaras precisas; elija entre SAM .1 Tiny/Small/Base/Large o el nuevo SAM a través del selector de modelos de la barra de herramientas.

- Atajos de teclado: Flujos de trabajo eficientes con teclas de acceso rápido

| Atajo | Acción |

|---|---|

V | Seleccionar modo |

S | Modo de anotación SAM |

A | Modo de anotación automática |

1 - 9 | Seleccionar clase por número |

Delete | Eliminar anotación seleccionada |

Ctrl+Z | Deshacer |

Ctrl+Y | Rehacer |

Escape | Cancelar acción actual |

Consulte Anotación para la guía completa.

¿Qué formatos de exportación son compatibles?

La plataforma admite 17 formatos de implementación:

| Formato | Extensión de archivo | Caso de uso |

|---|---|---|

| ONNX | .onnx | Despliegue multiplataforma |

| TorchScript | .torchscript | Implementación de C++ |

| OpenVINO | _openvino_model | Intel |

| TensorRT | .engine | GPU conGPU NVIDIA |

| CoreML | .mlpackage | Dispositivos Apple |

| TFLite | .tflite | Dispositivos móviles/periféricos |

| TF SavedModel | _saved_model | Ecosistema TensorFlow |

| TF GraphDef | .pb | TensorFlow |

| PaddlePaddle | _paddle_model | Ecosistema Baidu |

| NCNN | _ncnn_model | Móvil (Android) |

| Edge TPU | _edgetpu.tflite | Dispositivos Google |

| TF.js | _web_model | Despliegue en navegador |

| MNN | .mnn | Alibaba móvil |

| RKNN | _rknn_model | Rockchip NPU |

| IMX500 | _imx_model | Sensor Sony IMX500 |

| Axelera | _axelera_model | Aceleradores de IA Axelera |

| ExecuTorch | _executorch_model | PyTorch |

Consulte Exportación de modelos, la guía del modo Exportar y el índice de integraciones para ver las opciones específicas de cada formato.

Solución de problemas

Problemas con los conjuntos de datos

| Problema | Solución |

|---|---|

| El conjunto de datos no se procesará. | Comprueba que el formato del archivo sea compatible (JPEG, PNG, WebP, etc.). Tamaño máximo del archivo: imágenes 50 MB, vídeos 1 GB, ZIP 10 GB. |

| Anotaciones faltantes | Verifique que las etiquetas estén en su lugar. formato YOLO con .txt archivos que coinciden con los nombres de los archivos de imagen |

| «Se requiere división del tren» | Añadir train/ carpeta a la estructura de su conjunto de datos, o cree divisiones en Configuración del conjunto de datos |

| Nombres de clase indefinidos | Añadir un data.yaml archivo con names: lista (véase formato YOLO), o definir clases en la configuración del conjunto de datos. |

Cuestiones relacionadas con la formación

| Problema | Solución |

|---|---|

| El entrenamiento no comenzará. | Comprueba el saldo de crédito en Ajustes > Facturación. Se requiere saldo positivo. |

| Error de memoria insuficiente | Reduzca el tamaño del lote, utilice un modelo más pequeño (n/s) o seleccione GPU más VRAM. |

| Métricas deficientes | Comprueba la calidad del conjunto de datos, aumenta los períodos, prueba el aumento de datos, verifica el equilibrio de clases. |

| Entrenamiento lento | Selecciona GPU más rápida, reduce el tamaño de la imagen y comprueba que el conjunto de datos no esté saturado. |

Problemas de implementación

| Problema | Solución |

|---|---|

| El punto final no responde. | Comprueba el estado del punto final (Listo frente a Detenido). El arranque en frío puede tardar entre 5 y 15 segundos. |

| 401 No autorizado | Verifica que la clave API sea correcta y tenga los ámbitos necesarios. |

| Inferencia lenta | Comprueba el tamaño del modelo, considera TensorRT , selecciona una región más cercana. |

| Error en la exportación | Algunos formatos requieren arquitecturas de modelo específicas. Prueba ONNX para obtener la mayor compatibilidad posible. |

Preguntas frecuentes

¿Puedo cambiar mi nombre de usuario después de registrarme?

No, los nombres de usuario son permanentes y no se pueden cambiar. Elígelo con cuidado durante el registro.

¿Puedo cambiar mi región de datos?

No, la región de datos se selecciona durante el registro y no se puede cambiar. Para cambiar de región, cree una nueva cuenta y vuelva a cargar sus datos.

¿Cómo puedo conseguir más créditos?

Ve a Configuración > Facturación > Añadir créditos. Compra créditos por valor de entre 5 y 1000 dólares. Los créditos comprados nunca caducan.

¿Qué sucede si el entrenamiento falla?

Solo se le cobrará por el tiempo de computación completado. Los puntos de control se guardan y puede reanudar el entrenamiento.

¿Puedo descargar mi modelo entrenado?

Sí, haz clic en el icono de descarga en cualquier página de modelo para descargar el .pt archivo o formatos exportados.

¿Cómo puedo compartir mi trabajo públicamente?

Edita la configuración de tu proyecto o conjunto de datos y cambia la visibilidad a «Público». El contenido público aparece en la página Explorar.

¿Cuáles son los límites de tamaño de los archivos?

Imágenes: 50 MB, vídeos: 1 GB, archivos ZIP: 10 GB. Para archivos más grandes, divídelos en varias subidas.

¿Cuánto tiempo se conservan los elementos eliminados en la Papelera?

30 días. Después de ese plazo, los elementos se eliminan de forma permanente y no se pueden recuperar.

¿Puedo utilizar los modelos de la plataforma con fines comerciales?

Los planes Free y Pro utilizan la licencia AGPL. Para uso comercial sin los requisitos de la AGPL, póngase en contacto conultralytics para obtener una licencia Enterprise.