Ultralytics Plattform

Ultralytics Platform ist eine umfassende End-to-End-Plattform für Computer Vision, die den gesamten ML-Workflow von der Datenvorbereitung bis zur Modellbereitstellung optimiert. Entwickelt für Teams und Einzelpersonen, die produktionsreife Computer-Vision-Lösungen ohne die Komplexität der Infrastruktur benötigen.

Was ist die Ultralytics Platform?

Die Ultralytics Platform wurde entwickelt, um fragmentierte ML-Tools durch eine einheitliche Lösung zu ersetzen. Sie vereint die Funktionen von:

- Roboflow – Datenmanagement und -annotation

- Weights & Biases – Experiment-Tracking

- SageMaker – Cloud-Training

- HuggingFace – Modell-Deployment

- Arize – Monitoring

Alles in einer Plattform mit nativer Unterstützung für YOLO26- und YOLO11-Modelle.

Workflow: Hochladen → Annotieren → Trainieren → Exportieren → Bereitstellen

Die Plattform bietet einen End-to-End-Workflow:

graph LR

subgraph Data["📁 Data"]

A[Upload] --> B[Annotate]

B --> C[Analyze]

end

subgraph Train["🚀 Train"]

D[Configure] --> E[Train on GPU]

E --> F[View Metrics]

end

subgraph Deploy["🌐 Deploy"]

G[Export] --> H[Deploy Endpoint]

H --> I[Monitor]

end

Data --> Train --> Deploy| Phase | Funktionen |

|---|---|

| Hochladen | Bilder (50 MB), Videos (1 GB) und Datensatzdateien (ZIP, TAR einschließlich .tar.gz/.tgz, NDJSON) mit automatischer Verarbeitung |

| Annotieren | Manuelle Werkzeuge für alle 5 Aufgabentypen sowie „Smart Annotation“ mit SAM YOLO zur detect, segment und OBB (siehe unterstützte Aufgaben) |

| Trainieren | Cloud-GPUs (20 kostenlos + 3 Pro-exklusiv), Echtzeit-Metriken, Projektorganisation |

| Export | 17 Bereitstellungsformate (ONNX, TensorRT, CoreML, TFLite usw.; siehe unterstützte Formate) |

| Bereitstellung | 43 globale Regionen mit dedizierten Endpunkten, Auto-Scaling, Monitoring |

Was Sie tun können:

- Hochladen von Bildern, Videos und Datensatzdateien zur Erstellung von Trainingsdatensätzen

- Visualisieren Sie Annotationen mit interaktiven Overlays für alle 5 YOLO-Aufgabentypen (siehe unterstützte Aufgaben)

- Trainieren Sie Modelle auf Cloud-GPUs (20 kostenlos, 23 mit Pro) mit Echtzeit-Metriken

- Exportieren Sie in 17 Bereitstellungsformate (ONNX, TensorRT, CoreML, TFLite usw.)

- Bereitstellen in 43 globale Regionen mit dedizierten One-Click-Endpunkten

- Überwachen von Trainingsfortschritt, Bereitstellungszustand und Nutzungsmetriken

- Kollaborieren durch die Veröffentlichung von Projekten und Datensätzen für die Community

Multi-Region-Infrastruktur

Ihre Daten bleiben in Ihrer Region. Die Ultralytics Platform betreibt Infrastruktur in drei globalen Regionen:

| Region | Label | Standort | Am besten geeignet für |

|---|---|---|---|

| USA | Amerika | Iowa, USA | Nutzer in Amerika, am schnellsten für Amerika |

| EU | Europa, Mittlerer Osten & Afrika | Belgien, Europa | Europäische Nutzer, DSGVO-Konformität |

| AP | Asien-Pazifik | Hongkong, Asien-Pazifik | Nutzer im Asien-Pazifik-Raum, niedrigste APAC-Latenz |

Sie wählen Ihre Region während des Onboardings, und all Ihre Daten, Modelle und Deployments verbleiben in dieser Region.

Region ist dauerhaft

Ihre Datenregion kann nach der Kontoerstellung nicht mehr geändert werden. Während des Onboardings misst die Plattform die Latenz zu jeder Region und empfiehlt die nächstgelegene. Wählen Sie sorgfältig.

Hauptmerkmale

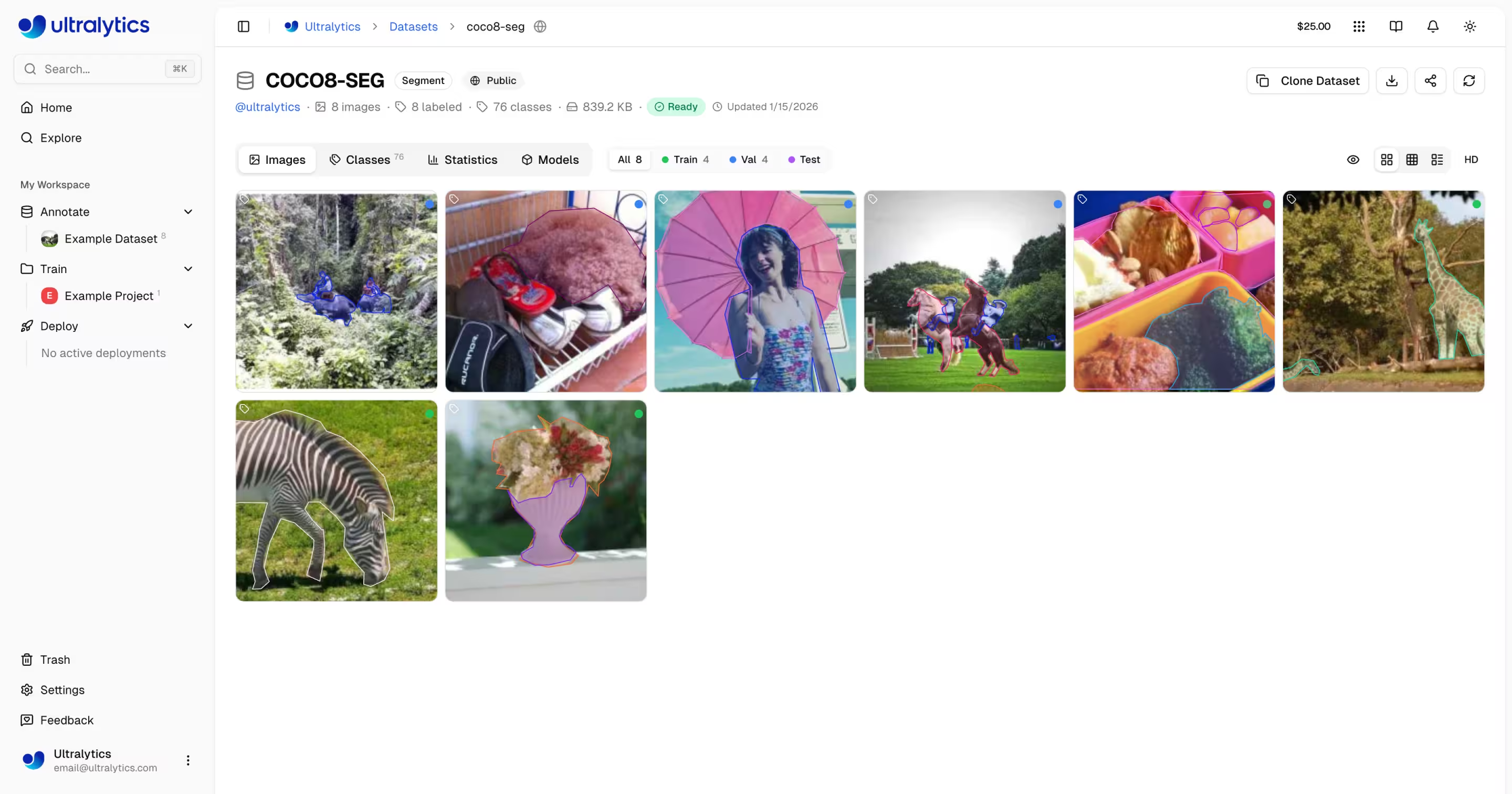

Datenvorbereitung

- Datensatzverwaltung: Bilder, Videos oder Datensatzdateien mit automatischer Verarbeitung hochladen

- Annotations-Editor: Manuelle Annotation für alle 5 YOLO-Aufgabentypen (detect, segment, pose, obb, classify; siehe unterstützte Aufgaben)

- Skelett-Vorlagen: Integrierte (Person, Hand, Gesicht, Hund, Box) und benutzerdefinierte Skelett-Vorlagen für die Pose-Annotation mit einem Klick

- Intelligente Annotation: Nutzen Sie SAM .1 (Tiny, Small, Base, Large), SAM , vortrainierteYOLO oder Ihre eigenen, feinabgestimmten YOLO aus der Annotations-Symbolleiste für detect, segment und OBB-Aufgaben

- Datensatz-Versionierung: Erstellen Sie nummerierte NDJSON-Snapshots mit Beschreibungen für reproduzierbares Training

- Statistiken: Klassenverteilung, Standort-Heatmaps und Dimensionsanalyse

graph LR

A[Upload Dataset/Images/Video] --> B[Auto-Process]

B --> C[Browse & Filter]

C --> D{Annotate}

D --> E[Manual Tools]

D --> F[SAM Smart]

D --> G[YOLO Auto-Label]

E --> H[Train-Ready Dataset]

F --> H

G --> HUnterstützte Aufgabentypen

Der Annotations-Editor unterstützt alle 5 YOLO-Aufgabentypen: detect (Bounding Boxes), segment (Polygone), pose (Keypoints), obb (orientierte Boxen) und classify (Bild-Labels). Jeder Aufgabentyp verfügt über spezielle Zeichenwerkzeuge und Tastenkombinationen.

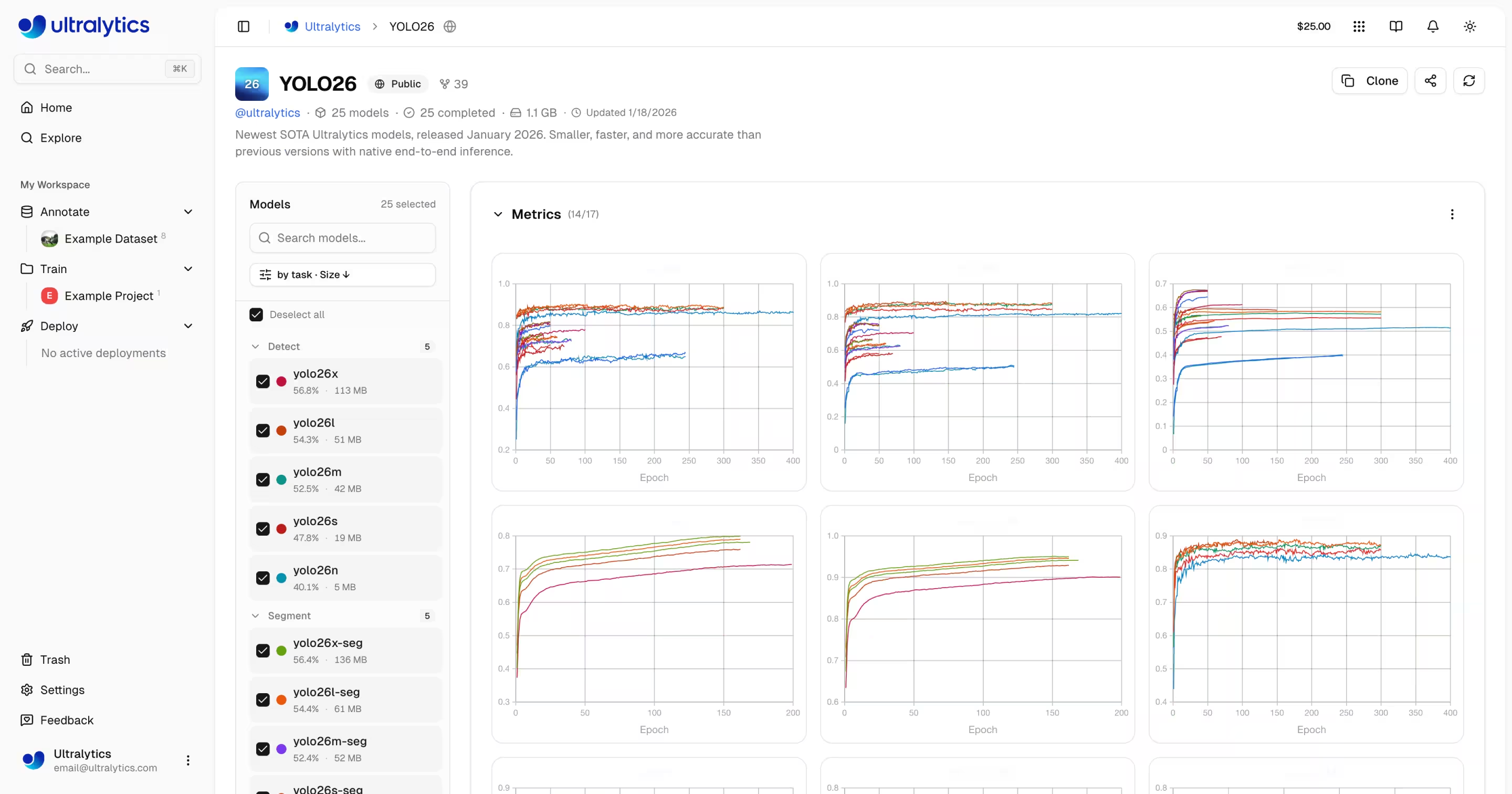

Modelltraining

- Cloud-Training: Trainieren Sie auf Cloud-GPUs (20 kostenlos, 23 mit Pro) mit Echtzeit-Metriken

- Remote-Training: Trainieren Sie überall und streamen Sie Metriken an die Plattform (im W&B-Stil)

- Projektorganisation: Gruppieren Sie verwandte Modelle, vergleichen Sie Experimente, tracken Sie Aktivitäten

- 17 Exportformate: ONNX, TensorRT, CoreML, TFLite und mehr (siehe unterstützte Formate)

Sie können Modelle entweder über die Web-Benutzeroberfläche (Cloud Training) oder von Ihrem eigenen Rechner (Remote Training) trainieren:

- Navigieren Sie zu Ihrem Projekt

- Klicken Sie

Train Model - Wählen Sie Datensatz, Modell, GPU und Epochen aus

- Überwachen Sie Echtzeit-Verlustkurven und -Metriken

# Install ultralytics

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train and stream metrics to the platform

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Metrics stream to Platform automatically

Bereitstellung

- Inferenz-Tests: Testen Sie Modelle direkt im Browser mit benutzerdefinierten Bildern

- Dedizierte Endpunkte: Bereitstellung in 43 globalen Regionen mit Auto-Scaling

- Monitoring: Echtzeit-Metriken, Anfrageprotokolle und Performance-Dashboards

graph LR

A[Trained Model] --> B{Action}

B --> C[Browser Predict]

B --> D[Export Format]

B --> E[Deploy Endpoint]

D --> F[ONNX / TensorRT / CoreML / TFLite / ...]

E --> G[43 Global Regions]

G --> H[API Endpoint URL]

H --> I[Monitor & Scale]Nach der Bereitstellung können Sie Ihren Endpunkt aus jeder Sprache aufrufen:

import requests

url = "https://your-endpoint-url/predict"

headers = {"Authorization": "Bearer YOUR_API_KEY"}

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, files={"file": f})

print(response.json())

curl -X POST "https://your-endpoint-url/predict" \

-H "Authorization: Bearer YOUR_API_KEY" \

-F "file=@image.jpg"

const form = new FormData();

form.append("file", fileInput.files[0]);

const response = await fetch("https://your-endpoint-url/predict", {

method: "POST",

headers: { Authorization: "Bearer YOUR_API_KEY" },

body: form,

});

const results = await response.json();

console.log(results);

Kontoverwaltung

- Teams & Organisationen: Arbeiten Sie mit Teammitgliedern zusammen, verwalten Sie Rollen und Einladungen

- API-Schlüssel: Sichere Schlüsselverwaltung für Remote-Training und API-Zugriff

- Guthaben & Abrechnung: Pay-as-you-go-Training mit transparenter Preisgestaltung

- Aktivitäts-Feed: trackt alle Kontoereignisse und -aktionen

- Papierkorb & Wiederherstellung: 30-tägiges Soft-Delete mit Elementwiederherstellung

- DSGVO-Konformität: Datenexport und Kontolöschung

Plankategorien

| Merkmal | Kostenlos | Pro (29 $/Monat) | Enterprise |

|---|---|---|---|

| Anmeldeguthaben | $5 / $25* | - | Benutzerdefiniert |

| Monatliches Guthaben | - | $30/Platz/Monat | Benutzerdefiniert |

| Modelle | 100 | 500 | Unbegrenzt |

| Gleichzeitige Trainings | 3 | 10 | Unbegrenzt |

| Bereitstellungen | 3 | 10 | Unbegrenzt |

| Speicher | 100 GB | 500 GB | Unbegrenzt |

| Cloud-GPU-Typen | 20 | 23 (inkl. H200/B200) | 23 |

| Teams | - | Bis zu 5 Mitglieder | Bis zu 50 |

| Support | Community | Priorität | Dediziert |

*$5 bei der Anmeldung, oder $25 mit einer verifizierten Firmen-/Arbeits-E-Mail.

Schnellzugriffe

Beginnen Sie mit diesen Ressourcen:

- Schnellstart: Erstellen Sie Ihr erstes Projekt und trainieren Sie ein Modell in wenigen Minuten

- Datensätze: Laden Sie Ihre Trainingsdaten hoch und verwalten Sie sie

- Annotation: Labeln Sie Ihre Daten mit manuellen und KI-gestützten Tools

- Projekte: Organisieren Sie Ihre Modelle und Experimente

- Cloud-Training: Trainieren Sie auf Cloud-GPUs

- Inferenz: Testen Sie Ihre Modelle

- Endpunkte: Stellen Sie Modelle in der Produktion bereit

- Monitoring: Tracken Sie die Bereitstellungs-Performance

- API-Schlüssel: Verwalten Sie den API-Zugriff

- Abrechnung: Guthaben und Zahlung

- Aktivität: trackt Kontoereignisse

- Papierkorb: Gelöschte Elemente wiederherstellen

- REST API: API-Referenz

FAQ

Wie fange ich mit der Ultralytics Platform an?

Um mit Ultralytics Platform zu beginnen:

- Registrieren: Erstellen Sie ein Konto unter platform.ultralytics.com

- Region auswählen: Wählen Sie Ihre Datenregion (USA, EU oder AP) während des Onboardings

- Datensatz hochladen: Navigieren Sie zum Bereich Datensätze, um Ihre Daten hochzuladen

- Modell trainieren: Erstellen Sie ein Projekt und beginnen Sie mit dem Training auf Cloud-GPUs

- Bereitstellen: Testen Sie Ihr Modell und stellen Sie es auf einem dedizierten Endpunkt bereit

Eine detaillierte Anleitung finden Sie auf der Quickstart-Seite.

Welche Vorteile bietet die Ultralytics Platform?

Ultralytics Platform bietet:

- Vereinheitlichter Workflow: Daten, Training und Bereitstellung an einem Ort

- Multi-Region: Datenresidenz in den Regionen USA, EU oder AP

- No-Code-Training: Trainieren Sie fortschrittliche YOLO-Modelle ohne Code zu schreiben

- Echtzeit-Metriken: Streamen Sie den Trainingsfortschritt und überwachen Sie Bereitstellungen

- 43 Bereitstellungsregionen: Stellen Sie Modelle weltweit nah an Ihren Nutzern bereit

- 5 Aufgabentypen: Unterstützung für detection, segmentation, pose, obb und classification (siehe Aufgaben-Dokumentation)

- KI-gestützte Annotation: Intelligente Annotation mit SAM YOLO zur Beschleunigung der Datenaufbereitung

Welche GPU-Optionen stehen für das Cloud-Training zur Verfügung?

Ultralytics Platform unterstützt verschiedene GPU-Typen für das Cloud-Training:

| GPU | Generation | VRAM | Kosten/Stunde | Am besten geeignet für |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Kleine Datensätze, zum Testen |

| RTX A4500 | Ampere | 20 GB | $0.25 | Kleine bis mittlere Datensätze |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Mittlere Datensätze |

| RTX A5000 | Ampere | 24 GB | $0.27 | Mittlere Datensätze |

| L4 | Ada | 24 GB | $0.39 | Für Inferenz optimiert |

| A40 | Ampere | 48 GB | $0.40 | Größere Batch-Größen |

| RTX 3090 | Ampere | 24 GB | $0.46 | Allgemeines Training |

| RTX A6000 | Ampere | 48 GB | $0.49 | Große Modelle |

| RTX PRO 4500 | Blackwell | 32 GB | $0.54 | Hervorragendes Preis-Leistungs-Verhältnis |

| RTX 4090 | Ada | 24 GB | $0.59 | Bestes Preis-Leistungs-Verhältnis |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Training mit großen Batches |

| L40S | Ada | 48 GB | $0.86 | Training mit großen Batches |

| RTX 5090 | Blackwell | 32 GB | $0.89 | Neueste Consumer-Generation |

| L40 | Ada | 48 GB | $0.99 | Große Modelle |

| A100 PCIe | Ampere | 80 GB | $1.39 | Produktionstraining |

| A100 SXM | Ampere | 80 GB | $1.49 | Produktionstraining |

| RTX PRO 6000 | Blackwell | 96 GB | $1.69 | Empfohlener Standard |

| H100 PCIe | Hopper | 80 GB | $2.39 | Hochleistungs-Training |

| H100 SXM | Hopper | 80 GB | $2.69 | Schnellstes Training |

| H100 NVL | Hopper | 94 GB | $3.07 | Maximale Leistung |

| H200 NVL | Hopper | 143 GB | $3.39 | Maximaler Speicher (Pro+) |

| H200 SXM | Hopper | 141 GB | $3.59 | Maximale Leistung (Pro+) |

| B200 | Blackwell | 180 GB | $4.99 | Größte Modelle (Pro+) |

Siehe Cloud-Training für vollständige Preisgestaltung und GPU-Optionen.

Wie funktioniert Remote-Training?

Sie können Modelle auf Ihrer eigenen Hardware trainieren und Echtzeit-Metriken an die Plattform streamen, ähnlich wie bei Weights & Biases.

Anforderung an die Paketversion

Für die Plattformintegration ist ultralytics>=8.4.14 erforderlich. Niedrigere Versionen funktionieren NICHT mit der Plattform.

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train with project/name to stream metrics

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Train using a Platform dataset directly

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 project=username/my-project name=exp1

Weitere Details zum Remote-Training finden Sie unter Cloud Training.

Welche Annotationstools stehen zur Verfügung?

Die Plattform umfasst einen voll ausgestatteten Annotationseditor, der Folgendes unterstützt:

- Manuelle Werkzeuge: Bounding Boxes, Polygone, Keypoints mit Skelett-Vorlagen, orientierte Boxes, Klassifizierung

- Skelett-Vorlagen: Platzieren Sie alle Keypoints gleichzeitig mit integrierten (Person, Hand, Gesicht, Hund, Box) oder benutzerdefinierten Vorlagen

- Intelligente Annotation: Verwenden Sie SAM .1 oder SAM für die klickbasierte Annotation oder führen Sie vortrainierteYOLO und Ihre eigenen feinabgestimmten YOLO über die Symbolleiste aus, um detect, segment und OBBs zu berechnen.

- Tastenkombinationen: Effiziente Workflows mit Hotkeys

| Tastenkombination | Aktion |

|---|---|

V | Modus auswählen |

S | SAM Smart-Annotation-Modus |

A | Auto-Annotationsmodus |

1 - 9 | Klasse nach Nummer auswählen |

Delete | Ausgewählte Annotation löschen |

Ctrl+Z | Rückgängig |

Ctrl+Y | Wiederherstellen |

Escape | Aktuelle Aktion abbrechen |

Die vollständige Anleitung finden Sie unter Annotation.

Welche Exportformate werden unterstützt?

Die Plattform unterstützt 17 Bereitstellungsformate:

| Format | Dateierweiterung | Anwendungsfall |

|---|---|---|

| ONNX | .onnx | Plattformübergreifende Bereitstellung |

| TorchScript | .torchscript | C++-Bereitstellung |

| OpenVINO | _openvino_model | Intel-Hardware |

| TensorRT | .engine | NVIDIA GPU-Inferenz |

| CoreML | .mlpackage | Apple-Geräte |

| TFLite | .tflite | Mobile/Edge-Geräte |

| TF SavedModel | _saved_model | TensorFlow-Ökosystem |

| TF GraphDef | .pb | TensorFlow Legacy |

| PaddlePaddle | _paddle_model | Baidu-Ökosystem |

| NCNN | _ncnn_model | Mobil (Android/ARM) |

| Edge TPU | _edgetpu.tflite | Google Coral-Geräte |

| TF.js | _web_model | Browser-Bereitstellung |

| MNN | .mnn | Alibaba mobil |

| RKNN | _rknn_model | Rockchip NPU |

| IMX500 | _imx_model | Sony IMX500 Sensor |

| Axelera | _axelera_model | Axelera AI-Beschleuniger |

| ExecuTorch | _executorch_model | PyTorch mobil |

Siehe Modell-Export, den Leitfaden zum Exportmodus und den Integrationsindex für formatspezifische Optionen.

Fehlerbehebung

Probleme mit Datensätzen

| Problem | Lösung |

|---|---|

| Datensatz wird nicht verarbeitet | Überprüfen Sie, ob das Dateiformat unterstützt wird (JPEG, PNG, WebP usw.). Maximale Dateigröße: Bilder 50 MB, Videos 1 GB, Datensätze 10 GB (Free) / 20 GB (Pro) / 50 GB (Enterprise) |

| Fehlende Annotationen | Vergewissern Sie sich, dass die Labels in YOLO-Format mit .txt Dateien, die den Bilddateinamen entsprechen |

| „Trainings-Split erforderlich“ | Hinzufügen train/ Ordner Ihrer Datensatzstruktur vorhanden sind, oder erstellen Sie Splits in Datensatzeinstellungen |

| Klassennamen undefiniert | Fügen Sie ein data.yaml Datei mit names: Liste (siehe YOLO-Format), oder definieren Sie Klassen in den Datensatzeinstellungen |

Trainingsprobleme

| Problem | Lösung |

|---|---|

| Training startet nicht | Guthaben in Einstellungen > Abrechnung prüfen. Positives Guthaben erforderlich. |

| Speicherfehler | Reduzieren Sie die Batch-Größe, verwenden Sie ein kleineres Modell (n/s) oder wählen Sie eine GPU mit mehr VRAM. |

| Schlechte Metriken | Überprüfen Sie die Dataset-Qualität, erhöhen Sie die Epochen, versuchen Sie Datenaugmentation, verifizieren Sie die Klassenbalance. |

| Training langsam | Wählen Sie eine schnellere GPU, reduzieren Sie die Bildgröße, stellen Sie sicher, dass das Dataset keinen Engpass darstellt. |

Bereitstellungsprobleme

| Problem | Lösung |

|---|---|

| Endpunkt antwortet nicht | Endpunktstatus prüfen (Bereit vs. Gestoppt). Kaltstart kann 5-15 Sekunden dauern. |

| 401 Nicht autorisiert | Vergewissern Sie sich, dass der API-Schlüssel korrekt ist und die erforderlichen Berechtigungen besitzt. |

| Langsame Inferenz | Überprüfen Sie die Modellgröße, erwägen Sie den TensorRT-Export, wählen Sie eine näher gelegene Region. |

| Export fehlgeschlagen | Einige Formate erfordern spezifische Modellarchitekturen. Versuchen Sie ONNX für die breiteste Kompatibilität. |

Häufig gestellte Fragen

Kann ich meinen Benutzernamen nach der Registrierung ändern?

Nein, Benutzernamen sind permanent und können nicht geändert werden. Wählen Sie sorgfältig bei der Registrierung.

Kann ich meine Datenregion ändern?

Nein, die Datenregion wird bei der Registrierung ausgewählt und kann nicht geändert werden. Um die Region zu wechseln, erstellen Sie ein neues Konto und laden Sie Ihre Daten erneut hoch.

Wie erhalte ich mehr Credits?

Gehen Sie zu Einstellungen > Abrechnung > Credits hinzufügen. Kaufen Sie Credits von 5 $ bis 1000 $. Gekaufte Credits verfallen nie.

Was passiert, wenn das Training fehlschlägt?

Ihnen wird nur die abgeschlossene Rechenzeit berechnet. Checkpoints werden gespeichert, und Sie können das Training fortsetzen.

Kann ich mein trainiertes Modell herunterladen?

Ja, klicken Sie auf das Download-Symbol auf jeder Modellseite, um die .pt Datei oder exportierte Formate herunterzuladen.

Wie teile ich meine Arbeit öffentlich?

Bearbeiten Sie Ihre Projekt- oder Datensatz-Einstellungen und schalten Sie die Sichtbarkeit auf „Öffentlich“. Öffentliche Inhalte erscheinen auf der Erkundungsseite.

Welche Dateigrößenbeschränkungen gibt es?

Bilder: 50 MB, Videos: 1 GB, Datensätze: 10 GB bei der kostenlosen Version, 20 GB bei der Pro-Version, 50 GB bei der Enterprise-Version. Größere Dateien sollten in mehrere Uploads aufgeteilt werden.

Wie lange bleiben gelöschte Elemente im Papierkorb?

30 Tage. Danach werden Elemente dauerhaft gelöscht und können nicht wiederhergestellt werden.

Kann ich Plattform-Modelle kommerziell nutzen?

Kostenlose und Pro-Pläne verwenden die AGPL-Lizenz. Für die kommerzielle Nutzung ohne AGPL-Anforderungen kontaktieren Sie sales@ultralytics.com für eine Enterprise-Lizenzierung.