Link to this sectionUltralytics YOLO26을 사용한 속도 측정 🚀#

Link to this section속도 측정(Speed Estimation)이란 무엇입니까?#

속도 측정은 특정 상황 내에서 객체의 이동 속도를 계산하는 과정으로, 컴퓨터 비전 애플리케이션에서 자주 사용됩니다. Ultralytics YOLO26을 사용하면 이제 객체 추적과 함께 거리 및 시간 데이터를 활용하여 객체 속도를 계산할 수 있으며, 이는 교통 모니터링 및 감시와 같은 작업에 매우 중요합니다. 속도 측정의 정확도는 다양한 애플리케이션의 효율성과 신뢰성에 직접적인 영향을 미치며, 지능형 시스템 및 실시간 의사결정 프로세스 발전의 핵심 요소가 됩니다.

Watch: Speed Estimation using Ultralytics YOLO26

속도 측정에 대한 더 깊은 통찰력을 얻으려면 당사의 블로그 게시물을 확인하십시오: 컴퓨터 비전 프로젝트에서의 속도 측정을 위한 Ultralytics YOLO

Link to this section속도 측정의 이점#

- 효율적인 교통 제어: 정확한 속도 측정은 교통 흐름을 관리하고, 안전을 강화하며, 도로의 혼잡을 줄이는 데 도움이 됩니다.

- 정밀한 자율 주행: 자율 주행 자동차와 같은 자율 시스템에서 신뢰할 수 있는 속도 측정은 안전하고 정확한 차량 주행을 보장합니다.

- 향상된 감시 보안: 감시 분석에서의 속도 측정은 비정상적인 행동이나 잠재적인 위협을 식별하여 보안 조치의 효과를 개선합니다.

Link to this section실제 세계에서의 활용 사례#

| 교통 | 교통 |

|---|---|

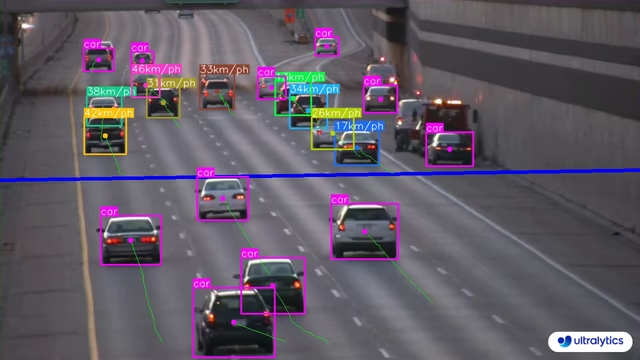

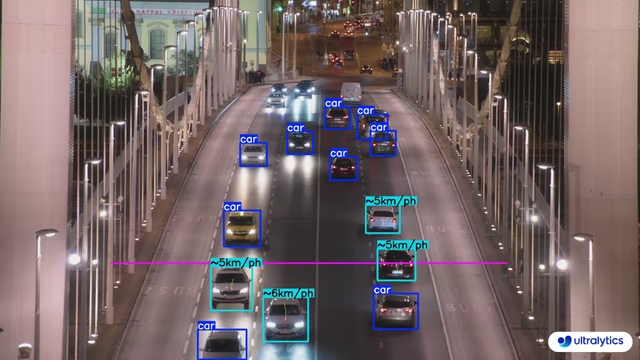

|  |

| Ultralytics YOLO26을 사용한 도로 위 속도 측정 | Ultralytics YOLO26을 사용한 교량 위 속도 측정 |

속도는 추정치입니다

속도는 추정치이며 완전히 정확하지 않을 수 있습니다. 또한, 측정 결과는 카메라 사양 및 관련 요인에 따라 달라질 수 있습니다.

# Run a speed example

yolo solutions speed show=True

# Pass a source video

yolo solutions speed source="path/to/video.mp4"

# Adjust meter per pixel value based on camera configuration

yolo solutions speed meter_per_pixel=0.05Link to this sectionSpeedEstimator 인수#

다음은 SpeedEstimator 인수를 설명하는 표입니다:

| 인수 | 유형 | 기본값 | 설명 |

|---|---|---|---|

model | str | None | Ultralytics YOLO 모델 파일 경로입니다. |

fps | float | 30.0 | 속도 계산에 사용되는 초당 프레임 수입니다. |

max_hist | int | 5 | 속도/방향 계산을 위해 객체별로 추적할 최대 기록 포인트 수입니다. |

meter_per_pixel | float | 0.05 | 픽셀 거리를 실제 단위로 변환하는 데 사용되는 스케일링 계수입니다. |

max_speed | int | 120 | 시각적 오버레이에서 표시되는 최대 속도 제한(경고 등에 사용됨)입니다. |

SpeedEstimator 솔루션은 track 매개변수 사용을 지원합니다:

| 인수 | 유형 | 기본값 | 설명 |

|---|---|---|---|

tracker | str | 'botsort.yaml' | 사용할 추적 알고리즘을 지정합니다. 기본 옵션은 다음과 같습니다: botsort.yaml, bytetrack.yaml, ocsort.yaml, deepocsort.yaml, fasttrack.yaml, tracktrack.yaml. |

conf | float | 0.1 | 탐지에 대한 신뢰도 임계값을 설정합니다. 값이 낮을수록 더 많은 객체가 추적되지만 잘못된 긍정 탐지(false positives)가 포함될 수 있습니다. |

iou | float | 0.7 | 겹치는 탐지를 필터링하기 위한 Intersection over Union (IoU) 임계값을 설정합니다. |

classes | list | None | 클래스 인덱스로 결과를 필터링합니다. 예를 들어, classes=[0, 2, 3]은 지정된 클래스만 추적합니다. |

verbose | bool | True | 추적 결과 표시를 제어하여 추적된 객체의 시각적 출력을 제공합니다. |

device | str | None | 추론을 위한 장치(예: cpu, cuda:0 또는 0)를 지정합니다. 사용자가 모델 실행을 위해 CPU, 특정 GPU 또는 기타 컴퓨팅 장치를 선택할 수 있도록 합니다. |

또한, 다음과 같은 시각화 옵션이 지원됩니다:

| 인수 | 유형 | 기본값 | 설명 |

|---|---|---|---|

show | bool | False | True일 경우, 주석이 달린 이미지나 비디오를 창에 표시합니다. 개발 또는 테스트 중 즉각적인 시각적 피드백을 확인하는 데 유용합니다. |

line_width | int or None | None | 바운딩 박스의 선 굵기를 지정합니다. None일 경우, 선 굵기가 이미지 크기에 따라 자동으로 조정됩니다. 명확성을 위해 시각적 커스터마이징을 제공합니다. |

show_conf | bool | True | 각 탐지에 대한 신뢰도 점수를 레이블과 함께 표시합니다. 각 탐지에 대한 모델의 확신도를 파악할 수 있습니다. |

show_labels | bool | True | 시각적 출력에서 각 탐지에 대한 레이블을 표시합니다. 탐지된 객체를 즉시 이해할 수 있도록 합니다. |

Link to this sectionFAQ#

Link to this sectionUltralytics YOLO26을 사용하여 객체 속도를 어떻게 측정합니까?#

Ultralytics YOLO26을 이용한 객체 속도 측정은 객체 탐지와 추적 기술을 결합하여 이루어집니다. 먼저, YOLO26 모델을 사용하여 각 프레임에서 객체를 탐지해야 합니다. 그런 다음 프레임 전반에 걸쳐 이러한 객체를 추적하여 시간 경과에 따른 이동을 계산합니다. 마지막으로, 프레임 간 객체의 이동 거리와 프레임 속도를 사용하여 속도를 추정합니다.

예시:

import cv2

from ultralytics import solutions

cap = cv2.VideoCapture("path/to/video.mp4")

w, h, fps = (int(cap.get(x)) for x in (cv2.CAP_PROP_FRAME_WIDTH, cv2.CAP_PROP_FRAME_HEIGHT, cv2.CAP_PROP_FPS))

video_writer = cv2.VideoWriter("speed_estimation.avi", cv2.VideoWriter_fourcc(*"mp4v"), fps, (w, h))

# Initialize SpeedEstimator

speedestimator = solutions.SpeedEstimator(

model="yolo26n.pt",

show=True,

)

while cap.isOpened():

success, im0 = cap.read()

if not success:

break

results = speedestimator(im0)

video_writer.write(results.plot_im)

cap.release()

video_writer.release()

cv2.destroyAllWindows()자세한 내용은 공식 블로그 게시물을 참조하십시오.

Link to this section교통 관리 분야에서 속도 측정을 위해 Ultralytics YOLO26을 사용할 때의 이점은 무엇입니까?#

속도 측정을 위해 Ultralytics YOLO26을 사용하면 교통 관리 분야에서 다음과 같은 중요한 이점을 얻을 수 있습니다:

- 안전 강화: 차량 속도를 정확하게 추정하여 과속을 감지하고 도로 안전을 개선합니다.

- 실시간 모니터링: YOLO26의 실시간 객체 탐지 기능을 활용하여 교통 흐름과 혼잡을 효과적으로 모니터링합니다.

- 확장성: 엣지 디바이스부터 서버까지 다양한 하드웨어 구성에 모델을 배포하여 대규모 구현을 위한 유연하고 확장 가능한 솔루션을 보장합니다.

더 많은 애플리케이션 사례는 속도 측정의 이점을 참조하십시오.

Link to this sectionYOLO26을 TensorFlow 또는 PyTorch와 같은 다른 AI 프레임워크와 통합할 수 있습니까?#

네, YOLO26은 TensorFlow 및 PyTorch와 같은 다른 AI 프레임워크와 통합할 수 있습니다. Ultralytics는 ONNX, TensorRT, CoreML과 같은 다양한 형식으로 YOLO26 모델을 내보내는 기능을 지원하여 다른 ML 프레임워크와의 원활한 상호 운용성을 보장합니다.

YOLO26 모델을 ONNX 형식으로 내보내는 방법:

yolo export model=yolo26n.pt format=onnx모델 내보내기에 대한 자세한 내용은 내보내기 가이드에서 확인하십시오.

Link to this sectionUltralytics YOLO26을 사용한 속도 측정은 얼마나 정확합니까?#

Ultralytics YOLO26을 사용한 속도 측정의 정확도는 객체 추적 품질, 비디오의 해상도 및 프레임 속도, 환경 변수를 포함한 여러 요인에 따라 달라집니다. 속도 추정기는 신뢰할 수 있는 추정치를 제공하지만, 프레임 처리 속도와 객체 가림 현상의 차이로 인해 100% 정확하지 않을 수 있습니다.

참고: 항상 오차 범위를 고려하고 가능하면 지상 실측(ground truth) 데이터로 추정치를 검증하십시오.

For further accuracy improvement tips, check the Arguments SpeedEstimator section.