Link to this sectionНабор данных COCO-Seg#

Набор данных COCO-Seg, являющийся расширением набора данных COCO (Common Objects in Context), специально разработан для помощи в исследованиях в области сегментации экземпляров. Он использует те же изображения, что и COCO, но содержит более подробные аннотации сегментации. Этот набор данных является важнейшим ресурсом для исследователей и разработчиков, работающих над задачами сегментации экземпляров, особенно для обучения моделей Ultralytics YOLO.

Link to this sectionПредобученные модели COCO-Seg#

| Модель | размер (пиксели) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Скорость CPU ONNX (мс) | Скорость T4 TensorRT10 (мс) | параметры (М) | FLOPs (Б) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Link to this sectionКлючевые особенности#

- COCO-Seg сохраняет оригинальные 330 тыс. изображений из COCO.

- Набор данных состоит из тех же 80 категорий объектов, что и в оригинальном наборе данных COCO.

- Аннотации теперь включают более подробные маски сегментации экземпляров для каждого объекта на изображениях.

- COCO-Seg предоставляет стандартизированные метрики оценки, такие как средняя точность (mAP) для обнаружения объектов и средняя полнота (mAR) для задач сегментации экземпляров, что позволяет эффективно сравнивать производительность моделей.

Link to this sectionСтруктура набора данных#

Набор данных COCO-Seg разделен на три подмножества:

- Train2017: 118 тыс. изображений для обучения моделей сегментации экземпляров.

- Val2017: 5 тыс. изображений, используемых для валидации в процессе разработки модели.

- Test2017: 20 тысяч изображений, используемых для бенчмаркинга. Разметка ground-truth для этого подмножества не является общедоступной, поэтому для получения оценки твои предсказания нужно отправить на сервер оценки COCO.

Link to this sectionПрименение#

COCO-Seg широко используется для обучения и оценки моделей глубокого обучения в области сегментации экземпляров, таких как модели YOLO. Большое количество аннотированных изображений, разнообразие категорий объектов и стандартизированные метрики оценки делают его незаменимым ресурсом для исследователей и специалистов в области компьютерного зрения.

Link to this sectionYAML набора данных#

Для определения конфигурации набора данных используется файл YAML (Yet Another Markup Language). Он содержит информацию о путях к набору данных, классах и другую релевантную информацию. В случае с набором данных COCO-Seg файл coco.yaml поддерживается по адресу https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco # dataset root dir

train: train2017.txt # train images (relative to 'path') 118287 images

val: val2017.txt # val images (relative to 'path') 5000 images

test: test-dev2017.txt # 20288 of 40670 images, submit via https://cocodataset.org/#detection-eval

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

segments = True # segment or box labels

dir = Path(yaml["path"]) # dataset root dir

urls = [ASSETS_URL + ("/coco2017labels-segments.zip" if segments else "/coco2017labels.zip")] # labels

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)Link to this sectionИспользование#

Чтобы обучить модель YOLO26n-seg на наборе данных COCO-Seg в течение 100 эпох с размером изображения 640, ты можешь использовать следующие фрагменты кода. Полный список доступных аргументов смотри на странице Обучение модели.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionПримеры изображений и аннотации#

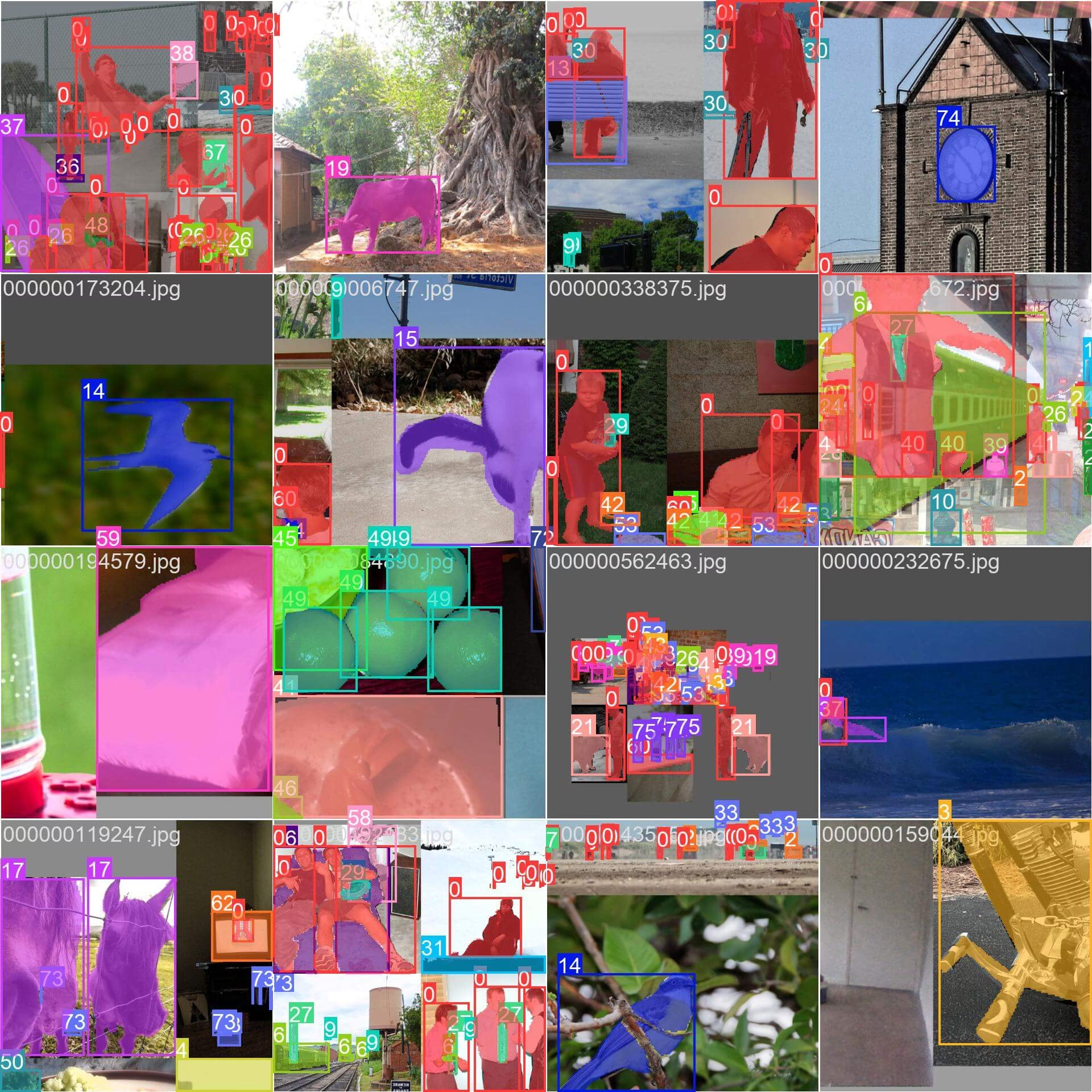

COCO-Seg, как и его предшественник COCO, содержит разнообразный набор изображений с различными категориями объектов и сложными сценами. Однако COCO-Seg представляет более подробные маски сегментации экземпляров для каждого объекта на изображениях. Вот несколько примеров изображений из этого набора данных вместе с соответствующими масками сегментации экземпляров:

- Мозаичное изображение: это изображение демонстрирует обучающий пакет, состоящий из мозаичных изображений набора данных. Мозаика — это техника, используемая во время обучения, которая объединяет несколько изображений в одно, чтобы увеличить разнообразие объектов и сцен в каждом обучающем пакете. Это помогает модели лучше обобщать данные для объектов разных размеров, соотношений сторон и контекстов.

Пример демонстрирует разнообразие и сложность изображений в наборе данных COCO-Seg, а также преимущества использования мозаики в процессе обучения.

Link to this sectionЦитирование и благодарности#

Если ты используешь набор данных COCO-Seg в своей исследовательской или проектной работе, пожалуйста, сошлися на оригинальную статью COCO и укажи на расширение до COCO-Seg:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Мы выражаем благодарность консорциуму COCO за создание и поддержку этого бесценного ресурса для сообщества компьютерного зрения. Для получения дополнительной информации о наборе данных COCO и его создателях посети веб-сайт набора данных COCO.

Link to this sectionFAQ#

Link to this sectionЧто такое набор данных COCO-Seg и чем он отличается от оригинального набора данных COCO?#

Набор данных COCO-Seg является расширением оригинального набора данных COCO (Common Objects in Context), специально разработанным для задач сегментации экземпляров. Хотя он использует те же изображения, что и набор данных COCO, COCO-Seg включает в себя более подробные аннотации сегментации, что делает его мощным ресурсом для исследователей и разработчиков, сосредоточенных на сегментации экземпляров объектов.

Link to this sectionКак я могу обучить модель YOLO26 с использованием набора данных COCO-Seg?#

Чтобы обучить модель YOLO26n-seg на наборе данных COCO-Seg в течение 100 эпох с размером изображения 640, ты можешь использовать следующие фрагменты кода. Для получения подробного списка доступных аргументов обратись к странице Обучение модели.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionКаковы ключевые особенности набора данных COCO-Seg?#

Набор данных COCO-Seg включает несколько ключевых особенностей:

- Сохраняет оригинальные 330 тыс. изображений из набора данных COCO.

- Аннотирует те же 80 категорий объектов, что и в оригинальном COCO.

- Предоставляет более подробные маски сегментации экземпляров для каждого объекта.

- Использует стандартизированные метрики оценки, такие как средняя точность (mAP) для обнаружения объектов и средняя полнота (mAR) для задач сегментации экземпляров.

Link to this sectionКакие предобученные модели доступны для COCO-Seg и каковы их метрики производительности?#

Набор данных COCO-Seg поддерживает несколько предобученных моделей сегментации YOLO26 с различными метриками производительности. Вот сводка доступных моделей и их ключевых метрик:

| Модель | размер (пиксели) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Скорость CPU ONNX (мс) | Скорость T4 TensorRT10 (мс) | параметры (М) | FLOPs (Б) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Эти модели варьируются от легкой YOLO26n-seg до более мощной YOLO26x-seg, предлагая различные компромиссы между скоростью и точностью для соответствия различным требованиям приложений. Для получения дополнительной информации о выборе модели посети страницу моделей Ultralytics.

Link to this sectionКак структурирован набор данных COCO-Seg и какие подмножества он содержит?#

Набор данных COCO-Seg разделен на три подмножества для конкретных нужд обучения и оценки:

- Train2017: Содержит 118 тыс. изображений, используемых в основном для обучения моделей сегментации экземпляров.

- Val2017: Включает 5 тыс. изображений, используемых для валидации в процессе обучения.

- Test2017: Включает 20 тысяч изображений, зарезервированных для тестирования и бенчмаркинга обученных моделей. Обрати внимание, что разметка ground-truth для этого подмножества не является общедоступной, а результаты производительности отправляются на сервер оценки COCO для анализа.

Для небольших экспериментов ты также можешь рассмотреть использование набора данных COCO8-seg, который представляет собой компактную версию, содержащую всего 8 изображений из набора COCO train 2017.