Link to this sectionUltralytics YOLO11#

Link to this sectionОбзор#

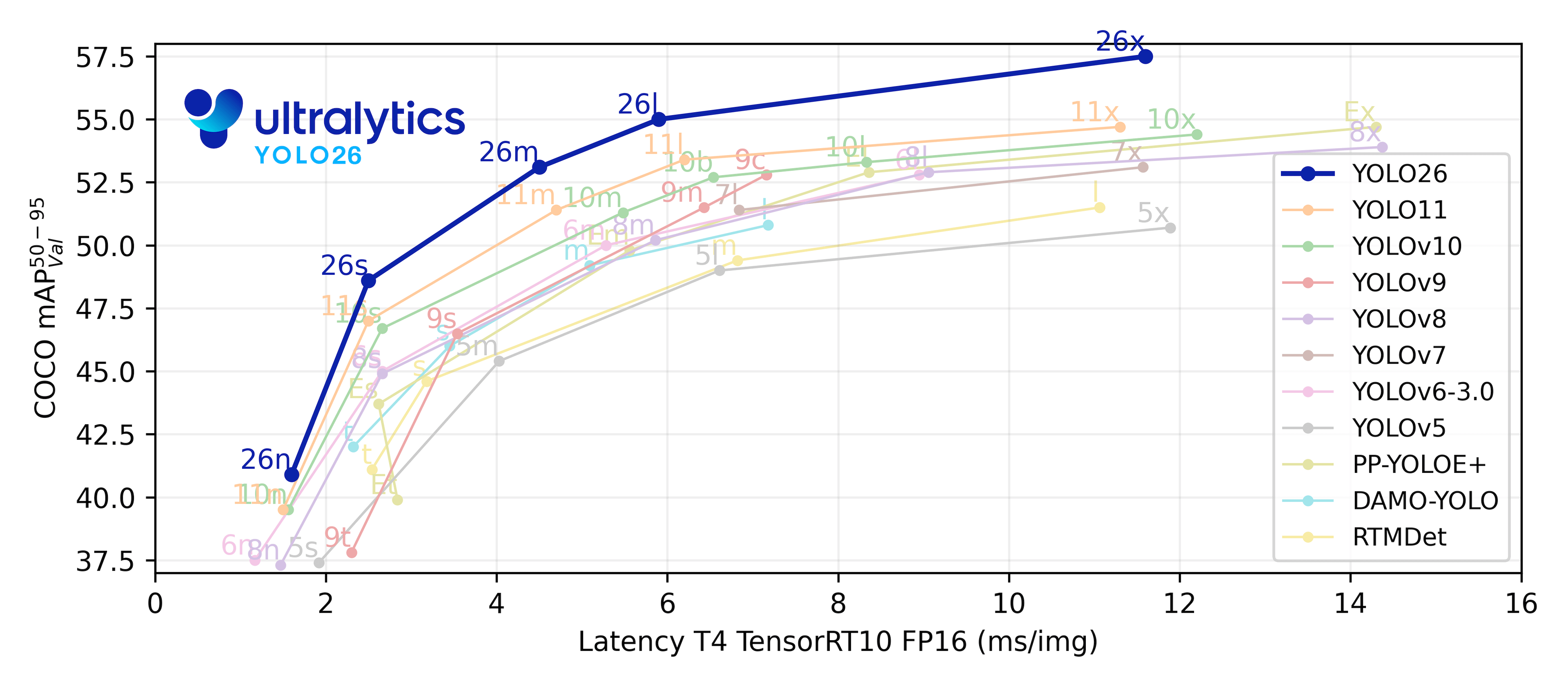

YOLO11 был выпущен компанией Ultralytics 10 сентября 2024 года, обеспечивая превосходную точность, скорость и эффективность. Развивая впечатляющие достижения предыдущих версий YOLO, YOLO11 представляет значительные улучшения в архитектуре и методах обучения, что делает его универсальным выбором для широкого спектра задач компьютерного зрения. Ознакомься с YOLO26 для использования новейшей модели Ultralytics с инференсом без NMS и оптимизированным развертыванием на периферийных устройствах.

Ultralytics YOLO11 🚀 Podcast generated by NotebookLM

Watch: How to Use Ultralytics YOLO11 for Object Detection and Tracking | How to Benchmark | YOLO11 RELEASED🚀

Изучай и запускай модели YOLO11 прямо на Ultralytics Platform.

Link to this sectionОсновные характеристики#

- Улучшенное извлечение признаков: YOLO11 использует улучшенную архитектуру backbone и neck, что повышает возможности извлечения признаков для более точного обнаружения объектов и выполнения сложных задач.

- Оптимизировано для эффективности и скорости: YOLO11 внедряет доработанные архитектурные решения и оптимизированные конвейеры обучения, обеспечивая более высокую скорость обработки при сохранении оптимального баланса между точностью и производительностью.

- Более высокая точность при меньшем количестве параметров: Благодаря достижениям в проектировании моделей, YOLO11m достигает более высокой средней точности (mAP) на наборе данных COCO, используя при этом на 22% меньше параметров, чем YOLOv8m, что делает его вычислительно эффективным без ущерба для точности.

- Адаптивность к различным средам: YOLO11 можно легко развернуть в различных средах, включая периферийные устройства, облачные платформы и системы, поддерживающие графические процессоры NVIDIA, что обеспечивает максимальную гибкость.

- Широкий спектр поддерживаемых задач: Будь то обнаружение объектов, сегментация экземпляров, классификация изображений, оценка позы или ориентированное обнаружение объектов (OBB), YOLO11 разработан для решения разнообразных задач компьютерного зрения.

Link to this sectionПоддерживаемые задачи и режимы#

YOLO11 расширяет линейку универсальных моделей, заложенную ранними релизами Ultralytics YOLO, предлагая улучшенную поддержку для различных задач компьютерного зрения:

| Модель | Имена файлов | Задача | Логический вывод | Валидация | Обучение | Экспорт (Export) |

|---|---|---|---|---|---|---|

| YOLO11 | yolo11n.pt yolo11s.pt yolo11m.pt yolo11l.pt yolo11x.pt | Детекция | ✅ | ✅ | ✅ | ✅ |

| YOLO11-seg | yolo11n-seg.pt yolo11s-seg.pt yolo11m-seg.pt yolo11l-seg.pt yolo11x-seg.pt | Сегментация экземпляров | ✅ | ✅ | ✅ | ✅ |

| YOLO11-pose | yolo11n-pose.pt yolo11s-pose.pt yolo11m-pose.pt yolo11l-pose.pt yolo11x-pose.pt | Поза/Ключевые точки | ✅ | ✅ | ✅ | ✅ |

| YOLO11-obb | yolo11n-obb.pt yolo11s-obb.pt yolo11m-obb.pt yolo11l-obb.pt yolo11x-obb.pt | Ориентированная детекция | ✅ | ✅ | ✅ | ✅ |

| YOLO11-cls | yolo11n-cls.pt yolo11s-cls.pt yolo11m-cls.pt yolo11l-cls.pt yolo11x-cls.pt | Классификация | ✅ | ✅ | ✅ | ✅ |

В этой таблице представлен обзор вариантов моделей YOLO11, демонстрирующий их применимость в конкретных задачах и совместимость с рабочими режимами, такими как Inference, Validation, Training и Export. Эта гибкость делает YOLO11 подходящим для широкого спектра приложений компьютерного зрения, от обнаружения в реальном времени до сложных задач сегментации.

Link to this sectionМетрики производительности#

Смотри документацию по детекции для примеров использования этих моделей, обученных на COCO, которые включают 80 предобученных классов.

| Модель | размер (пиксели) | mAPval 50-95 | Скорость CPU ONNX (мс) | Скорость T4 TensorRT10 (мс) | параметры (М) | FLOPs (Б) |

|---|---|---|---|---|---|---|

| YOLO11n | 640 | 39.5 | 56.1 ± 0.8 | 1.5 ± 0.0 | 2.6 | 6.5 |

| YOLO11s | 640 | 47.0 | 90.0 ± 1.2 | 2.5 ± 0.0 | 9.4 | 21.5 |

| YOLO11m | 640 | 51.5 | 183.2 ± 2.0 | 4.7 ± 0.1 | 20.1 | 68.0 |

| YOLO11l | 640 | 53.4 | 238.6 ± 1.4 | 6.2 ± 0.1 | 25.3 | 86.9 |

| YOLO11x | 640 | 54.7 | 462.8 ± 6.7 | 11.3 ± 0.2 | 56.9 | 194.9 |

Link to this sectionПримеры использования#

В этом разделе представлены простые примеры обучения и инференса YOLO11. Полную документацию по этим и другим режимам см. на страницах документации Predict, Train, Val и Export.

Обрати внимание, что приведенный ниже пример относится к моделям YOLO11 Detect для обнаружения объектов. Информацию о других поддерживаемых задачах см. в документации по сегментации, классификации, OBB и оценке позы.

Предобученные PyTorch модели в формате *.pt, а также конфигурационные файлы *.yaml, можно передавать в класс YOLO() для создания экземпляра модели в Python:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO11n model

model = YOLO("yolo11n.pt")

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO11n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")Link to this sectionЦитирование и благодарности#

Ultralytics не публиковала официальную исследовательскую работу по YOLO11 из-за быстро развивающегося характера моделей. Мы фокусируемся на развитии технологий и повышении удобства их использования, а не на создании статической документации. Самую актуальную информацию об архитектуре, функциях и использовании YOLO см. в нашем репозитории GitHub и документации.

Если ты используешь YOLO11 или другое программное обеспечение из этого репозитория в своей работе, пожалуйста, сошлися на него, используя следующий формат:

@software{yolo11_ultralytics,

author = {Glenn Jocher and Jing Qiu},

title = {Ultralytics YOLO11},

version = {11.0.0},

year = {2024},

url = {https://github.com/ultralytics/ultralytics},

orcid = {0000-0001-5950-6979, 0000-0003-3783-7069},

license = {AGPL-3.0}

}Пожалуйста, обрати внимание, что DOI находится на рассмотрении и будет добавлен в цитирование, как только станет доступен. Модели YOLO11 предоставляются по лицензиям AGPL-3.0 и Enterprise.

Link to this sectionЧасто задаваемые вопросы (FAQ)#

Link to this sectionВ чем заключаются основные улучшения в Ultralytics YOLO11 по сравнению с YOLOv8?#

Ultralytics YOLO11 представляет несколько значительных достижений по сравнению с YOLOv8. Ключевые улучшения включают:

- Улучшенное извлечение признаков: YOLO11 использует улучшенную архитектуру бэкбона и неков, расширяя возможности извлечения признаков для более точного обнаружения объектов.

- Оптимизированная эффективность и скорость: Усовершенствованный архитектурный дизайн и оптимизированные конвейеры обучения обеспечивают более высокую скорость обработки при сохранении баланса между точностью и производительностью.

- Более высокая точность при меньшем количестве параметров: YOLO11m достигает более высокого среднего средней точности (mAP) на наборе данных COCO, используя на 22% меньше параметров, чем YOLOv8m, что делает его вычислительно эффективным без ущерба для точности.

- Адаптивность к различным средам: YOLO11 можно развертывать в различных средах, включая граничные (edge) устройства, облачные платформы и системы, поддерживающие GPU NVIDIA.

- Широкий спектр поддерживаемых задач: YOLO11 поддерживает разнообразные задачи компьютерного зрения, такие как обнаружение объектов, сегментация экземпляров, классификация изображений, оценка позы и ориентированное обнаружение объектов (OBB).

Link to this sectionКак обучить модель YOLO11 для обнаружения объектов?#

Обучение модели YOLO11 для обнаружения объектов можно выполнить с помощью Python или CLI команд. Ниже приведены примеры для обоих методов:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO11n model

model = YOLO("yolo11n.pt")

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)Для получения более подробных инструкций обратись к документации Train.

Link to this sectionКакие задачи могут выполнять модели YOLO11?#

Модели YOLO11 универсальны и поддерживают широкий спектр задач компьютерного зрения, включая:

- Обнаружение объектов: Идентификация и определение местоположения объектов на изображении.

- Сегментация экземпляров: Обнаружение объектов и очерчивание их границ.

- Классификация изображений: Категоризация изображений по заранее определенным классам.

- Оценка позы: Обнаружение и отслеживание ключевых точек на теле человека.

- Ориентированное обнаружение объектов (OBB): Обнаружение объектов с учетом вращения для более высокой точности.

Для получения дополнительной информации о каждой задаче см. документацию Detection, Instance Segmentation, Classification, Pose Estimation и Oriented Detection.

Link to this sectionКак YOLO11 достигает более высокой точности при меньшем количестве параметров?#

YOLO11 достигает более высокой точности при меньшем количестве параметров благодаря достижениям в дизайне моделей и методах оптимизации. Улучшенная архитектура позволяет эффективно извлекать и обрабатывать признаки, что приводит к более высокому среднему среднему значению точности (mAP) на наборах данных, таких как COCO, при использовании на 22% меньшего количества параметров, чем в YOLOv8m. Это делает YOLO11 вычислительно эффективным без ущерба для точности, что позволяет развертывать его на устройствах с ограниченными ресурсами.

Link to this sectionМожно ли развернуть YOLO11 на граничных устройствах?#

Да, YOLO11 спроектирован для адаптивности к различным средам, включая граничные устройства. Его оптимизированная архитектура и эффективные возможности обработки делают его подходящим для развертывания на граничных устройствах, облачных платформах и системах, поддерживающих GPU NVIDIA. Эта гибкость гарантирует, что YOLO11 можно использовать в разнообразных приложениях, от обнаружения в реальном времени на мобильных устройствах до сложных задач сегментации в облачных средах. Для получения более подробной информации о вариантах развертывания обратись к документации Export.