Link to this sectionCOCO-Seg-Datensatz#

Der COCO-Seg-Datensatz, eine Erweiterung des COCO (Common Objects in Context)-Datensatzes, wurde speziell entwickelt, um die Forschung im Bereich Instanzsegmentierung zu unterstützen. Er verwendet dieselben Bilder wie COCO, führt jedoch detailliertere Segmentierungsannotationen ein. Dieser Datensatz ist eine entscheidende Ressource für Forscher und Entwickler, die an Instanzsegmentierungsaufgaben arbeiten, insbesondere für das Training von Ultralytics YOLO-Modellen.

Link to this sectionCOCO-Seg vortrainierte Modelle#

| Modell | Größe (Pixel) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Geschwindigkeit CPU ONNX (ms) | Geschwindigkeit T4 TensorRT10 (ms) | Parameter (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52,5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54,4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Link to this sectionHauptfunktionen#

- COCO-Seg behält die ursprünglichen 330.000 Bilder aus COCO bei.

- Der Datensatz besteht aus denselben 80 Objektkategorien, die auch im ursprünglichen COCO-Datensatz enthalten sind.

- Die Annotationen enthalten nun detailliertere Instanzsegmentierungsmasken für jedes Objekt in den Bildern.

- COCO-Seg bietet standardisierte Bewertungsmetriken wie mean Average Precision (mAP) für die Objekterkennung und mean Average Recall (mAR) für Instanzsegmentierungsaufgaben, was einen effektiven Vergleich der Modellleistung ermöglicht.

Link to this sectionDatensatzstruktur#

Der COCO-Seg-Datensatz ist in drei Teilmengen unterteilt:

- Train2017: 118.000 Bilder für das Training von Instanzsegmentierungsmodellen.

- Val2017: 5.000 Bilder, die während der Modellentwicklung zur Validierung verwendet werden.

- Test2017: 20K Bilder für Benchmarking verwendet. Ground-truth-Annotationen für diese Teilmenge sind nicht öffentlich verfügbar, daher müssen Vorhersagen zur Bewertung an den COCO evaluation server übermittelt werden.

Link to this sectionAnwendungen#

COCO-Seg wird häufig zum Training und zur Evaluierung von Deep Learning-Modellen für die Instanzsegmentierung verwendet, wie etwa bei YOLO-Modellen. Die große Anzahl annotierter Bilder, die Vielfalt der Objektkategorien und die standardisierten Bewertungsmetriken machen ihn zu einer unverzichtbaren Ressource für Forscher und Anwender im Bereich Computer Vision.

Link to this sectionDatensatz-YAML#

Eine YAML-Datei (Yet Another Markup Language) wird verwendet, um die Konfiguration des Datensatzes zu definieren. Sie enthält Informationen zu den Pfaden des Datensatzes, den Klassen und weitere relevante Details. Im Fall des COCO-Seg-Datensatzes wird die coco.yaml-Datei unter https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco.yaml gepflegt.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco # dataset root dir

train: train2017.txt # train images (relative to 'path') 118287 images

val: val2017.txt # val images (relative to 'path') 5000 images

test: test-dev2017.txt # 20288 of 40670 images, submit via https://cocodataset.org/#detection-eval

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

segments = True # segment or box labels

dir = Path(yaml["path"]) # dataset root dir

urls = [ASSETS_URL + ("/coco2017labels-segments.zip" if segments else "/coco2017labels.zip")] # labels

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)Link to this sectionVerwendung#

Um ein YOLO26n-seg-Modell auf dem COCO-Seg-Datensatz für 100 Epochen mit einer Bildgröße von 640 zu trainieren, kannst du die folgenden Code-Snippets verwenden. Eine vollständige Liste der verfügbaren Argumente findest du auf der Seite Training für Modelle.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionBeispielbilder und Annotationen#

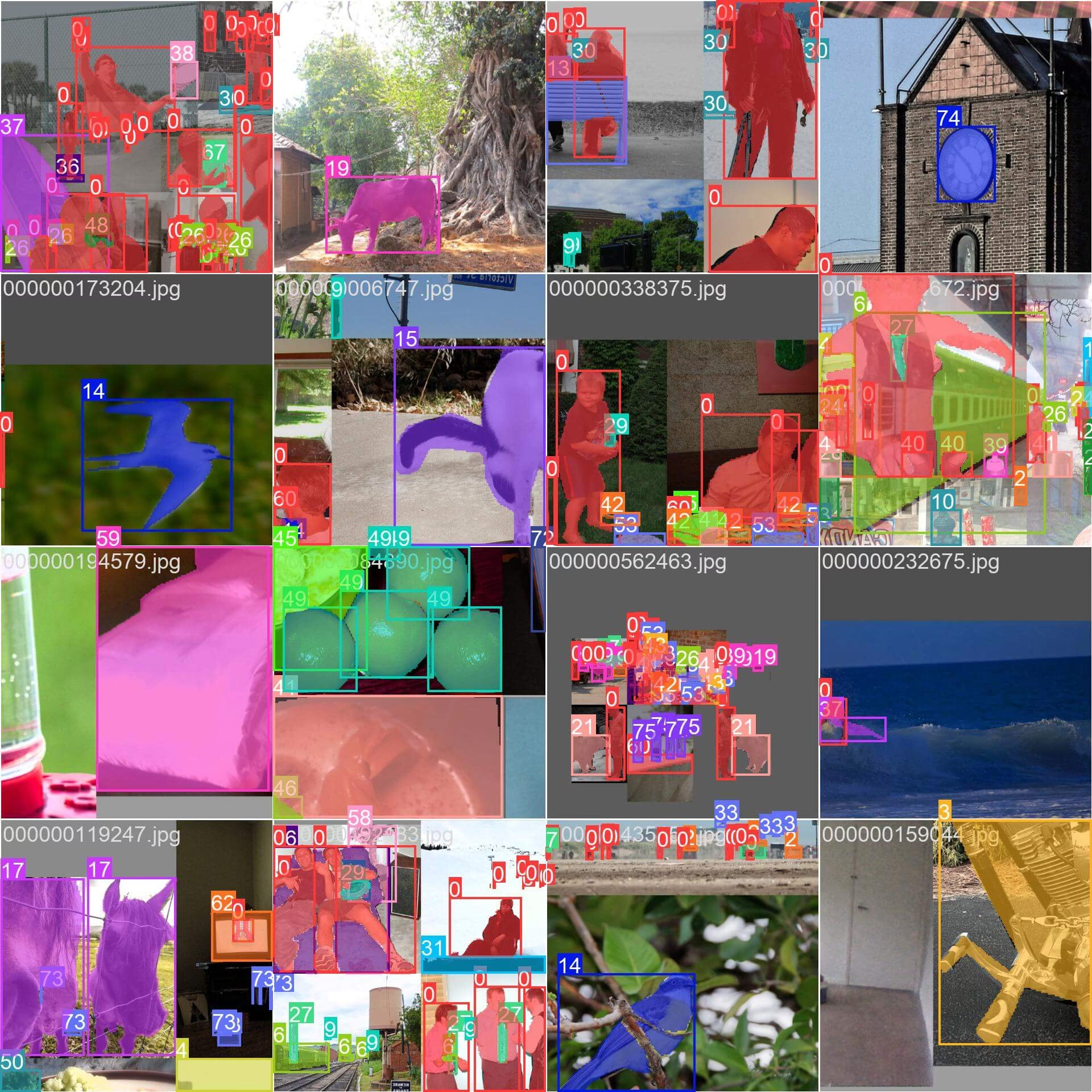

COCO-Seg enthält, wie sein Vorgänger COCO, eine vielfältige Menge an Bildern mit verschiedenen Objektkategorien und komplexen Szenen. COCO-Seg führt jedoch detailliertere Instanzsegmentierungsmasken für jedes Objekt in den Bildern ein. Hier sind einige Beispiele für Bilder aus dem Datensatz zusammen mit den entsprechenden Instanzsegmentierungsmasken:

- Mosaik-Bild: Dieses Bild zeigt einen Trainingsbatch, der aus mosaikierten Datensatzbildern besteht. Mosaicing ist eine Technik, die während des Trainings verwendet wird, um mehrere Bilder zu einem einzigen Bild zu kombinieren, um die Vielfalt der Objekte und Szenen innerhalb jedes Trainingsbatches zu erhöhen. Dies unterstützt die Fähigkeit des Modells, auf verschiedene Objektgrößen, Seitenverhältnisse und Kontexte zu generalisieren.

Das Beispiel verdeutlicht die Vielfalt und Komplexität der Bilder im COCO-Seg-Datensatz sowie die Vorteile des Mosaikings während des Trainingsprozesses.

Link to this sectionZitate und Danksagungen#

Wenn du den COCO-Seg-Datensatz in deiner Forschungs- oder Entwicklungsarbeit verwendest, zitiere bitte das ursprüngliche COCO-Paper und erkenne die Erweiterung zu COCO-Seg an:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Wir danken dem COCO-Konsortium für die Erstellung und Pflege dieser wertvollen Ressource für die Computer-Vision-Community. Weitere Informationen über den COCO-Datensatz und seine Ersteller findest du auf der COCO-Datensatz-Website.

Link to this sectionFAQ#

Link to this sectionWas ist der COCO-Seg-Datensatz und wie unterscheidet er sich vom ursprünglichen COCO-Datensatz?#

Der COCO-Seg-Datensatz ist eine Erweiterung des ursprünglichen COCO-Datensatzes (Common Objects in Context), der speziell für Instanzsegmentierungsaufgaben entwickelt wurde. Während er dieselben Bilder wie der COCO-Datensatz verwendet, enthält COCO-Seg detailliertere Segmentierungsannotationen, was ihn zu einer leistungsstarken Ressource für Forscher und Entwickler macht, die sich auf die Objektinstanzsegmentierung konzentrieren.

Link to this sectionWie kann ich ein YOLO26-Modell mit dem COCO-Seg-Datensatz trainieren?#

Um ein YOLO26n-seg-Modell auf dem COCO-Seg-Datensatz für 100 Epochen mit einer Bildgröße von 640 zu trainieren, kannst du die folgenden Code-Snippets verwenden. Eine detaillierte Liste der verfügbaren Argumente findest du auf der Seite Training für Modelle.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionWas sind die Hauptmerkmale des COCO-Seg-Datensatzes?#

Der COCO-Seg-Datensatz umfasst mehrere Hauptmerkmale:

- Behält die ursprünglichen 330.000 Bilder aus dem COCO-Datensatz bei.

- Annotiert dieselben 80 Objektkategorien, die auch im ursprünglichen COCO gefunden wurden.

- Bietet detailliertere Instanzsegmentierungsmasken für jedes Objekt.

- Verwendet standardisierte Bewertungsmetriken wie mean Average Precision (mAP) für die Objekterkennung und mean Average Recall (mAR) für Instanzsegmentierungsaufgaben.

Link to this sectionWelche vortrainierten Modelle sind für COCO-Seg verfügbar und wie sind ihre Leistungsmetriken?#

Der COCO-Seg-Datensatz unterstützt mehrere vortrainierte YOLO26-Segmentierungsmodelle mit unterschiedlichen Leistungsmetriken. Hier ist eine Zusammenfassung der verfügbaren Modelle und ihrer wichtigsten Metriken:

| Modell | Größe (Pixel) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Geschwindigkeit CPU ONNX (ms) | Geschwindigkeit T4 TensorRT10 (ms) | Parameter (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52,5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54,4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Diese Modelle reichen vom leichtgewichtigen YOLO26n-seg bis zum leistungsstärkeren YOLO26x-seg und bieten unterschiedliche Abwägungen zwischen Geschwindigkeit und Genauigkeit, um verschiedenen Anwendungsanforderungen gerecht zu werden. Weitere Informationen zur Modellauswahl findest du auf der Ultralytics-Modellseite.

Link to this sectionWie ist der COCO-Seg-Datensatz strukturiert und welche Teilmengen enthält er?#

Der COCO-Seg-Datensatz ist für spezifische Trainings- und Evaluierungsanforderungen in drei Teilmengen unterteilt:

- Train2017: Enthält 118.000 Bilder, die hauptsächlich für das Training von Instanzsegmentierungsmodellen verwendet werden.

- Val2017: Umfasst 5.000 Bilder, die während des Trainingsprozesses zur Validierung genutzt werden.

- Test2017: Umfasst 20K Bilder, die zum Testen und Benchmarking trainierter Modelle reserviert sind. Beachte, dass Ground-truth-Annotationen für diese Teilmenge nicht öffentlich verfügbar sind und Leistungsergebnisse zur Auswertung an den COCO evaluation server übermittelt werden.

Für kleinere Experimente kannst du auch den COCO8-seg-Datensatz in Betracht ziehen, eine kompakte Version, die nur 8 Bilder aus dem COCO-Train-2017-Set enthält.