Link to this sectionMonitorización#

Ultralytics Platform proporciona monitorización para endpoints desplegados. Realiza un seguimiento de las métricas de solicitud, visualiza registros y comprueba el estado de salud con el sondeo automático.

Link to this sectionPanel de despliegues#

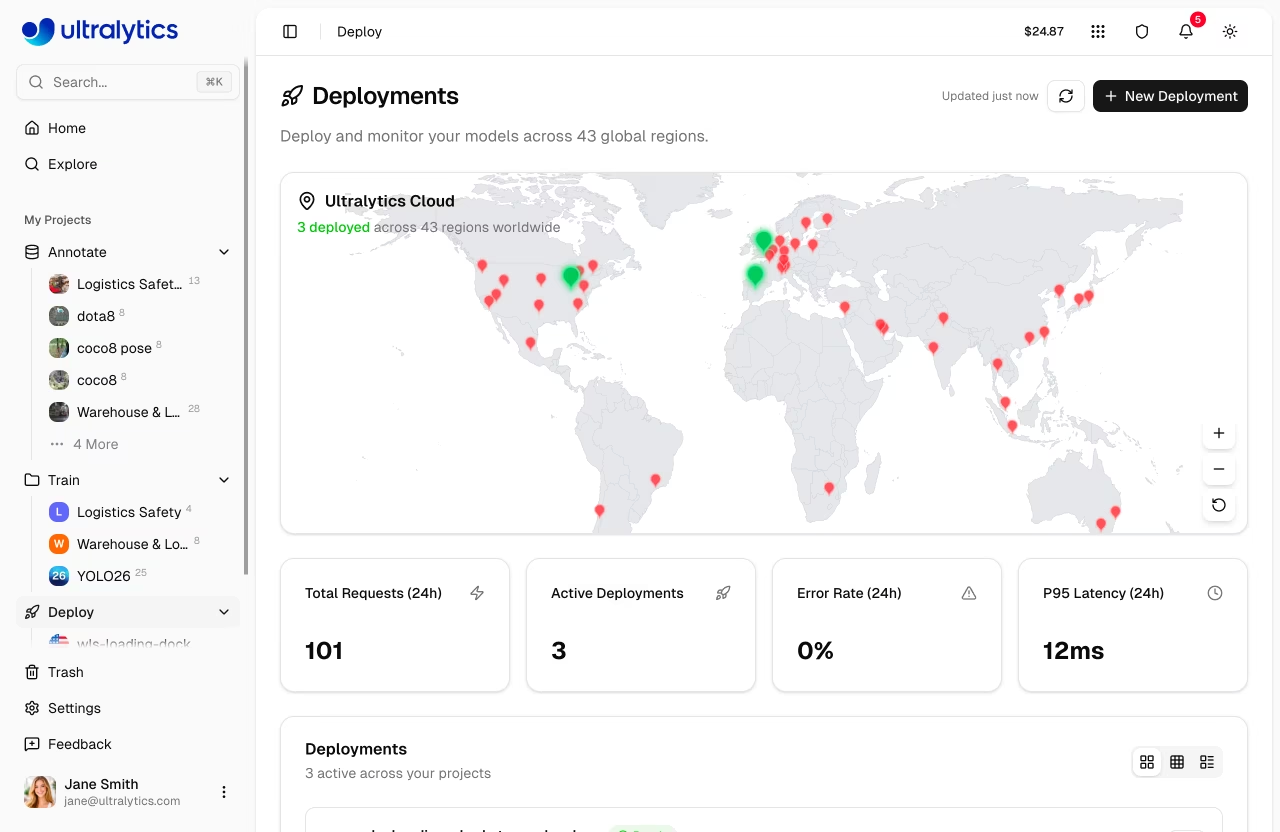

La página Deploy en la barra lateral sirve como panel de control de monitorización para todos tus despliegues. Combina el mapa mundial, métricas generales y la gestión de despliegues en una única vista. Consulta Dedicated Endpoints para crear y gestionar despliegues.

graph TB

subgraph Dashboard

Map[World Map] --- Cards[Overview Cards]

Cards --- List[Deployments List]

end

subgraph "Per Deployment"

Metrics[Metrics Row]

Health[Health Check]

Logs[Logs Tab]

Code[Code Tab]

Predict[Predict Tab]

end

List --> Metrics

List --> Health

List --> Logs

List --> Code

List --> Predict

style Dashboard fill:#f5f5f5,color:#333

style Map fill:#2196F3,color:#fff

style Cards fill:#FF9800,color:#fff

style List fill:#4CAF50,color:#fffLink to this sectionTarjetas de resumen#

Cuatro tarjetas de resumen en la parte superior de la página muestran:

| Métrica | Descripción |

|---|---|

| Solicitudes totales (24h) | Solicitudes a través de todos los endpoints |

| Despliegues activos | Endpoints actualmente en ejecución |

| Tasa de error (24h) | Porcentaje de solicitudes fallidas |

| Latencia P95 (24h) | Tiempo de respuesta en el percentil 95 |

La tarjeta de tasa de error se resalta en rojo cuando la tasa supera el 5%. Comprueba la pestaña Logs en los despliegues individuales para diagnosticar errores.

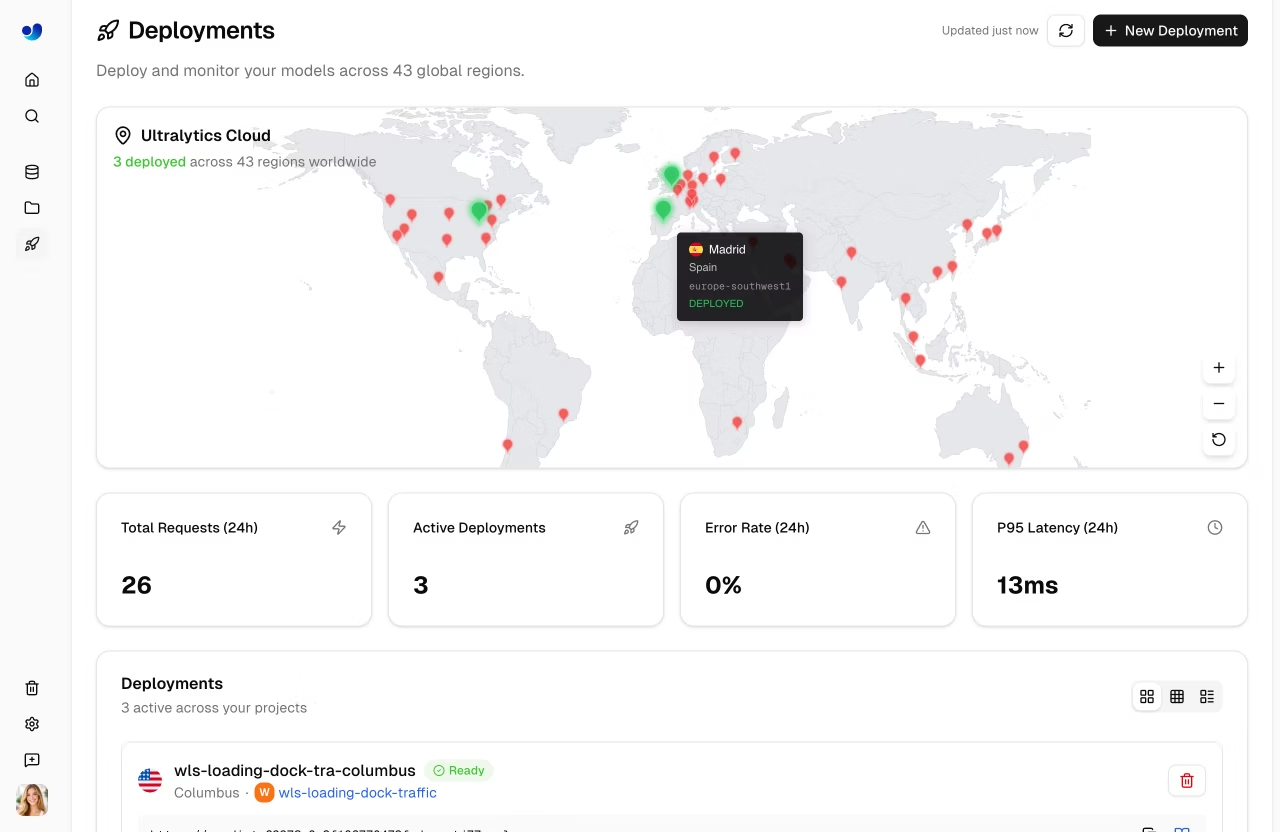

Link to this sectionMapa mundial#

El mapa mundial interactivo muestra:

- Marcadores de región para las 43 regiones disponibles

- Marcadores verdes para las regiones desplegadas

- Marcadores azules animados para regiones con despliegues activos en progreso

- El tamaño del marcador varía según el estado del despliegue y la latencia

Link to this sectionLista de despliegues#

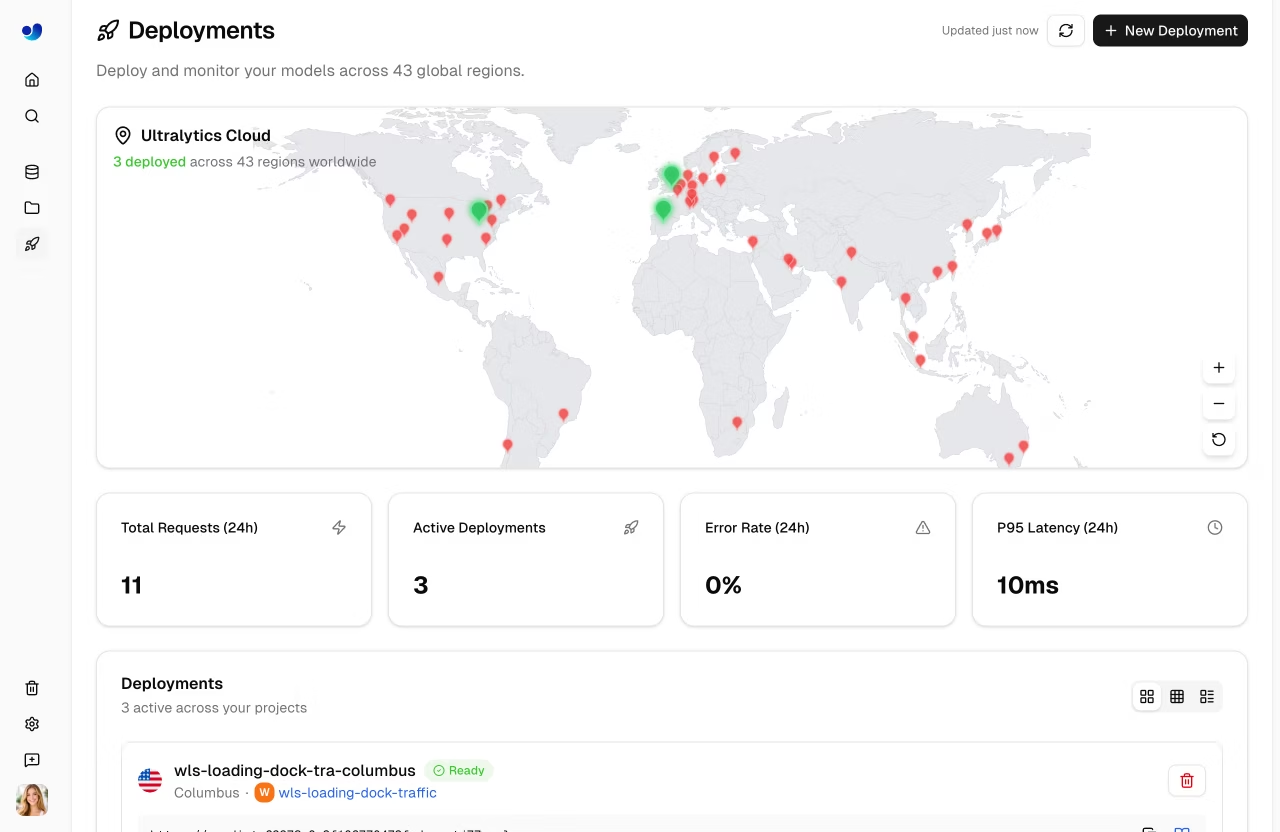

Debajo de las tarjetas de resumen, la lista de despliegues muestra todos los endpoints de tus proyectos. Utiliza el selector de modo de vista para cambiar entre:

| Vista | Descripción |

|---|---|

| Tarjetas | Tarjetas detalladas con pestañas de métricas, registros, código y predicción |

| Compacto | Cuadrícula de tarjetas pequeñas (1-4 columnas) con métricas clave |

| Tabla | DataTable con columnas ordenables: Nombre, Región, Estado, Solicitudes, P95, Errores |

El panel realiza un sondeo cada 15 segundos para obtener actualizaciones del estado del despliegue. Cuando los despliegues se encuentran en un estado de transición (creating, deploying o stopping), el sondeo aumenta a cada 3 segundos. Los gráficos de métricas se actualizan cada 60 segundos. Haz clic en el botón de refrescar para obtener actualizaciones inmediatas.

Link to this sectionMétricas por despliegue#

Cada tarjeta de despliegue (en la vista de tarjetas) muestra métricas en tiempo real:

Link to this sectionFila de métricas#

| Métrica | Descripción |

|---|---|

| Solicitudes | Número de solicitudes (24h) con icono |

| Latencia P95 | Tiempo de respuesta en el percentil 95 |

| Tasa de error | Porcentaje de solicitudes fallidas |

Las métricas se obtienen del endpoint de la API de sparkline y se actualizan cada 60 segundos.

Link to this sectionComprobación de estado#

Los despliegues en ejecución muestran un indicador de comprobación de estado:

| Indicador | Significado |

|---|---|

| Corazón verde | Saludable: muestra la latencia de respuesta |

| Corazón rojo | No saludable: muestra el mensaje de error |

| Icono giratorio | Comprobación de estado en progreso |

Las comprobaciones de estado se reintentan automáticamente cada 20 segundos cuando no son saludables. Haz clic en el icono de refrescar para activar manualmente una comprobación de estado. La comprobación utiliza un tiempo de espera de 55 segundos para adaptarse a arranques en frío en endpoints con escalado a cero.

La comprobación de estado utiliza un tiempo de espera de 55 segundos para contabilizar los arranques en frío en endpoints con escalado a cero (hasta ~45 segundos en el peor de los casos). Una vez que el endpoint se calienta, las comprobaciones de estado se completan en milisegundos.

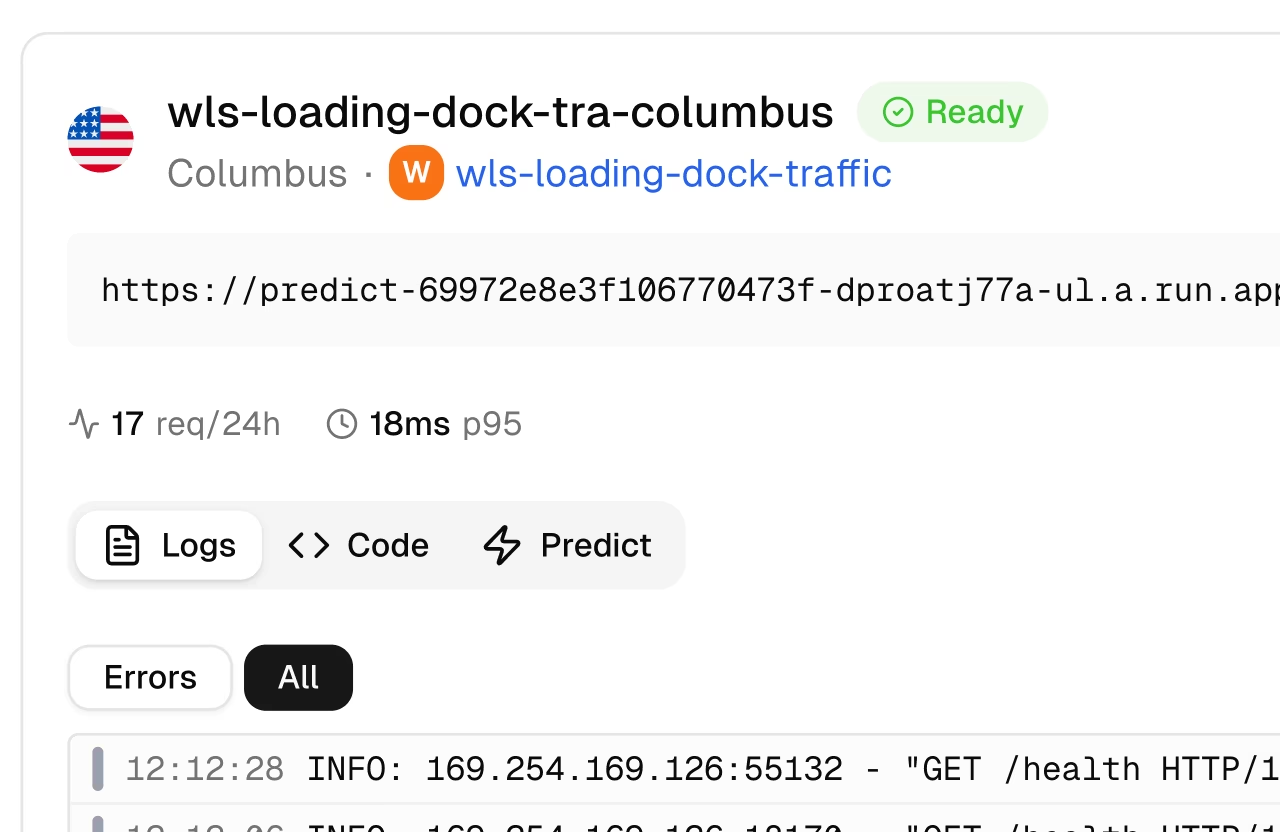

Link to this sectionRegistros#

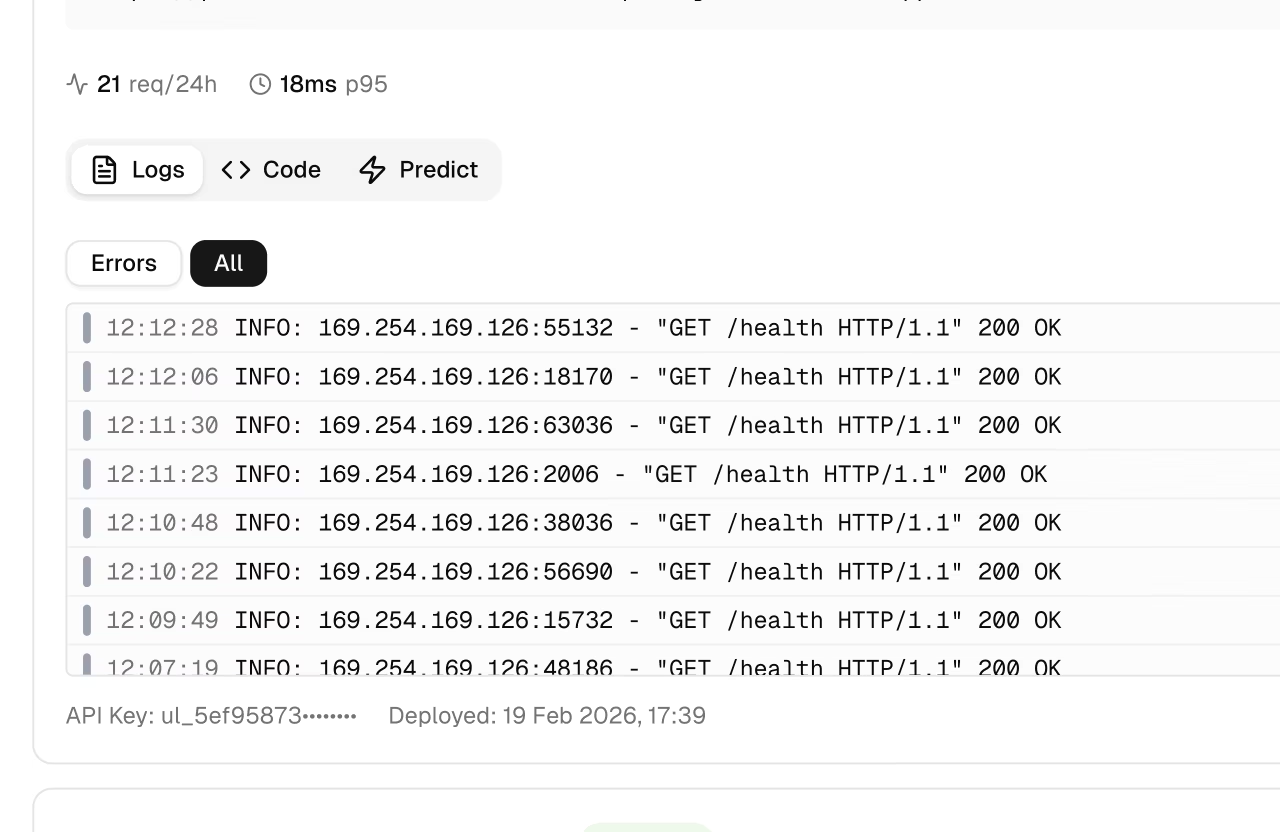

Cada tarjeta de despliegue incluye una pestaña Logs para ver las entradas de registro recientes:

Link to this sectionEntradas de registro#

Cada entrada de registro muestra:

| Campo | Descripción |

|---|---|

| Severidad | Barra codificada por colores (ver abajo) |

| Marca de tiempo | Hora de solicitud (formato local) |

| Mensaje | Contenido del registro |

| Información HTTP | Código de estado y latencia (si procede) |

Filtra los registros por severidad usando los botones de filtro:

| Nivel | Color | Descripción |

|---|---|---|

| DEBUG | Gris | Mensajes de depuración |

| INFO | Azul | Solicitudes normales |

| WARNING | Amarillo | Problemas no críticos |

| ERROR | Rojo | Solicitudes fallidas |

| CRITICAL | Rojo oscuro | Fallos críticos |

La interfaz muestra las 20 entradas más recientes. La API tiene un límite por defecto de 50 entradas por solicitud (máximo 200).

Al investigar errores: haz clic primero en Errores para filtrar las entradas ERROR y WARNING, luego revisa las marcas de tiempo y los códigos de estado HTTP. Copia los registros al portapapeles para compartirlos con tu equipo.

Link to this sectionEjemplos de código#

Cada tarjeta de despliegue incluye una pestaña Code que muestra código de API listo para usar con tu URL de endpoint real y clave de API:

import requests

# Deployment endpoint

url = "https://predict-abc123.run.app/predict"

# Headers with your deployment API key

headers = {"Authorization": "Bearer YOUR_API_KEY"}

# Inference parameters

data = {"conf": 0.25, "iou": 0.7, "imgsz": 640}

# Send image for inference

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, data=data, files={"file": f})

print(response.json())Al visualizar la pestaña Code en la plataforma, tu URL de endpoint real y tu clave de API se rellenan automáticamente. Copia el código y ejecútalo directamente. Consulta API Keys para generar una clave.

Link to this sectionInferencia de despliegue#

La pestaña Predict en cada tarjeta de implementación proporciona un panel de predicción integrado: la misma interfaz que la pestaña Predict del modelo, pero ejecutando la inferencia a través del endpoint de implementación en lugar del servicio compartido. Esto es útil para probar un endpoint implementado directamente desde el navegador. Consulta Inference para ver los detalles de los parámetros y los formatos de respuesta.

Link to this sectionEndpoints de la API#

Link to this sectionDescripción general de la monitorización#

GET /api/monitoringDevuelve métricas agregadas para todas las implementaciones propiedad del usuario autenticado. Reconoce el espacio de trabajo mediante el parámetro de consulta opcional owner.

Link to this sectionMétricas de implementación#

GET /api/deployments/{deploymentId}/metrics?sparkline=true&range=24hDevuelve datos de minigráficos (sparkline) y métricas de resumen para una implementación específica. Intervalo de actualización: 60 segundos.

| Parámetro | Tipo | Descripción |

|---|---|---|

sparkline | bool | Incluir datos de minigráficos |

range | cadena | Intervalo de tiempo: 1h, 6h, 24h, 7d o 30d |

Link to this sectionRegistros de implementación#

GET /api/deployments/{deploymentId}/logs?limit=50&severity=ERROR,WARNINGDevuelve entradas de registro recientes con filtro de gravedad y paginación opcionales.

| Parámetro | Tipo | Descripción |

|---|---|---|

limit | entero | Máximo de entradas a devolver (predeterminado: 50, máximo: 200) |

severity | cadena | Filtro de gravedad separado por comas |

pageToken | cadena | Token de paginación de la respuesta anterior |

Link to this sectionEstado de la implementación#

GET /api/deployments/{deploymentId}/healthDevuelve el estado de la comprobación de salud junto con la latencia de respuesta.

{

"healthy": true,

"status": 200,

"latencyMs": 142,

"serverTiming": { "db": 8, "ping": 142, "total": 150 }

}Link to this sectionOptimización del rendimiento#

Usa los datos de monitorización para optimizar tus implementaciones:

Si la latencia es demasiado alta:

- Comprueba el número de instancias (quizás necesites más)

- Verifica que el tamaño del modelo sea el adecuado

- Considera una región más cercana

- Comprueba los tamaños de las imágenes enviadas

Cambia de imgsz=1280 a imgsz=640 para obtener una aceleración de ~4x con una pérdida de precisión mínima en la mayoría de los casos de uso. Implementa en una región más cercana a tus usuarios para reducir la latencia de red.

Link to this sectionFAQ#

Link to this section¿Cuánto tiempo se retienen los datos?#

| Tipo de dato | Retención |

|---|---|

| Metrics | 30 días |

| Registros (Logs) | 7 días |

Link to this section¿Puedo configurar una monitorización externa?#

Sí, las URL de los endpoints funcionan con herramientas de monitorización externas:

- Monitorización de tiempo de actividad (Pingdom, UptimeRobot)

- Herramientas de APM (Datadog, New Relic)

- Comprobaciones de salud personalizadas mediante el endpoint

/health

Link to this section¿Qué tan precisos son los números de latencia?#

Las métricas de latencia miden:

- P50: Tiempo medio de respuesta

- P95: Percentil 95

- P99: Percentil 99

Estos representan el tiempo de procesamiento del lado del servidor, sin incluir la latencia de red para tus usuarios.

Link to this section¿Por qué mis métricas están retrasadas?#

Las métricas tienen un retraso de ~2 minutos debido a:

- La canalización de agregación de métricas

- Ventanas de agregación

- Caché del panel de control

Para una depuración en tiempo real, consulta los registros, que son casi instantáneos.

Link to this section¿Puedo monitorizar varios endpoints juntos?#

Sí, la página de implementaciones muestra todos los endpoints con tarjetas de resumen agregadas. Utiliza la vista de tabla para comparar el rendimiento entre implementaciones.