Segmentazione di istanza

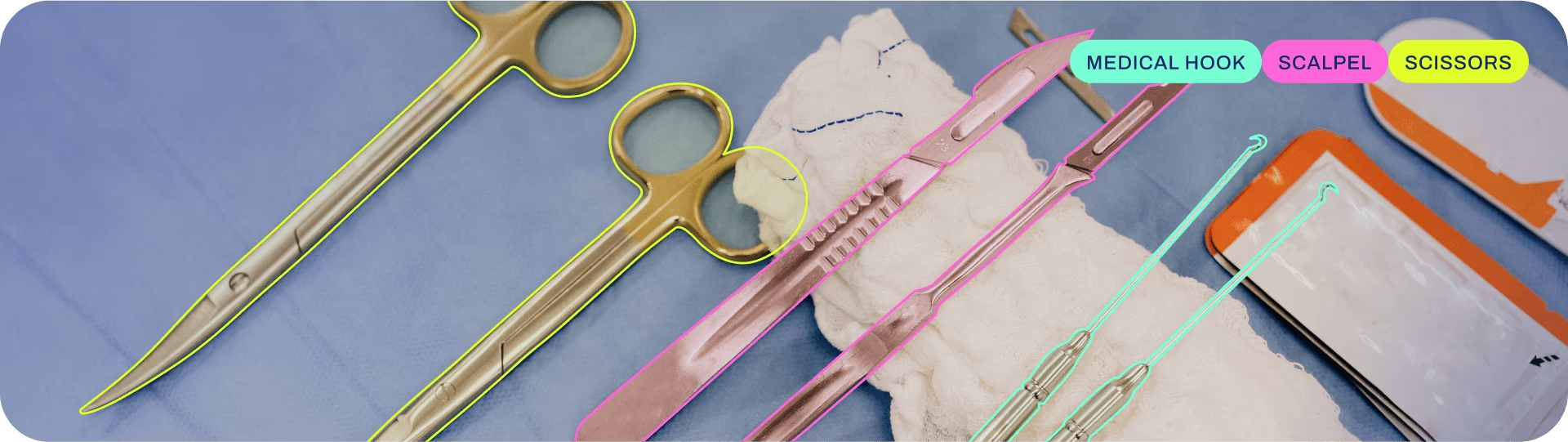

La segmentazione di istanza fa un passo avanti rispetto al rilevamento di oggetti e comporta l'identificazione di singoli oggetti in un'immagine e la loro segmentazione dal resto dell'immagine.

L'output di un modello di segmentazione di istanza è un insieme di maschere o contorni che delineano ogni oggetto nell'immagine, insieme alle etichette di classe e ai punteggi di confidenza per ogni oggetto. La segmentazione di istanza è utile quando hai bisogno di sapere non solo dove si trovano gli oggetti in un'immagine, ma anche qual è la loro forma esatta.

Watch: Run Segmentation with Pretrained Ultralytics YOLO Model in Python.

I modelli YOLO26 Segment utilizzano il suffisso -seg, ad esempio yolo26n-seg.pt, e sono preaddestrati su COCO.

Modelli

Qui sono mostrati i modelli Segment preaddestrati di YOLO26. I modelli Detect, Segment e Pose sono preaddestrati sul dataset COCO, i modelli Semantic sono preaddestrati su Cityscapes e i modelli Classify sono preaddestrati sul dataset ImageNet.

I modelli si scaricano automaticamente dall'ultima release di Ultralytics al primo utilizzo.

| Modello | dimensione (pixel) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Velocità CPU ONNX (ms) | Velocità T4 TensorRT10 (ms) | parametri (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

- I valori mAPval si riferiscono a un singolo modello a scala singola sul dataset COCO val2017.

Riproduci conyolo val segment data=coco.yaml device=0 - Velocità mediata sulle immagini di convalida COCO utilizzando un'istanza Amazon EC2 P4d.

Riproduci conyolo val segment data=coco.yaml batch=1 device=0|cpu - I valori di Parametri e FLOPs sono per il modello fuso dopo

model.fuse(), che unisce i layer Conv e BatchNorm e, per i modelli end2end, rimuove l'head di rilevamento ausiliario one-to-many. I checkpoint pre-addestrati mantengono l'architettura di training completa e potrebbero mostrare conteggi più elevati.

Addestramento

Addestra YOLO26n-seg sul dataset COCO8-seg per 100 epoche con dimensione immagine 640. Per un elenco completo degli argomenti disponibili, consulta la pagina Configurazione.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.yaml") # build a new model from YAML

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

model = YOLO("yolo26n-seg.yaml").load("yolo26n-seg.pt") # build from YAML and transfer weights

# Train the model

results = model.train(data="coco8-seg.yaml", epochs=100, imgsz=640)Vedi i dettagli completi della modalità train nella pagina Train. I modelli di segmentazione possono anche essere addestrati su GPU cloud tramite Ultralytics Platform.

Formato dataset

Il formato del dataset di segmentazione YOLO può essere trovato in dettaglio nella Guida ai Dataset. Per convertire il tuo dataset esistente da altri formati (come COCO, ecc.) al formato YOLO, utilizza lo strumento JSON2YOLO di Ultralytics. Puoi anche creare maschere di segmentazione su Ultralytics Platform utilizzando strumenti poligonali e l'annotazione intelligente basata su SAM.

Validazione

Convalida l' accuratezza del modello YOLO26n-seg addestrato sul dataset COCO8-seg. Non sono necessari argomenti poiché il model mantiene i suoi data di addestramento e gli argomenti come attributi del modello.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load an official model

model = YOLO("path/to/best.pt") # load a custom model

# Validate the model

metrics = model.val() # no arguments needed, dataset and settings remembered

metrics.box.map # map50-95(B)

metrics.box.map50 # map50(B)

metrics.box.map75 # map75(B)

metrics.box.maps # a list containing mAP50-95(B) for each category

metrics.box.image_metrics # per-image metrics dictionary for det with precision, recall, F1, TP, FP, and FN

metrics.seg.map # map50-95(M)

metrics.seg.map50 # map50(M)

metrics.seg.map75 # map75(M)

metrics.seg.maps # a list containing mAP50-95(M) for each category

metrics.seg.image_metrics # per-image metrics dictionary for seg with precision, recall, F1, TP, FP, and FNPredict

Usa un modello YOLO26n-seg addestrato per eseguire previsioni sulle immagini.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load an official model

model = YOLO("path/to/best.pt") # load a custom model

# Predict with the model

results = model("https://ultralytics.com/images/bus.jpg") # predict on an image

# Access the results

for result in results:

xy = result.masks.xy # mask polygons in pixel coordinates

xyn = result.masks.xyn # normalized mask polygons

masks = result.masks.data # binary masks, shape (N,H,W), dtype torch.uint8Vedi i dettagli completi della modalità predict nella pagina Previsione.

Output Risultati

La segmentazione di istanza YOLO restituisce un oggetto Results per immagine. Ogni risultato memorizza le previsioni a livello di oggetto, dove ogni istanza rilevata ha la propria maschera binaria, classe, confidenza e riquadro.

| Attributo | Tipo | Forma | Descrizione |

|---|---|---|---|

result.masks | Masks | (N) | Maschere di istanza. |

result.masks.data | torch.uint8 | (N,H,W) | Maschere binarie, valori 0 o 1. |

result.masks.xy | np.float32 | list[(P,2)] | Poligoni dei pixel. |

result.masks.xyn | np.float32 | list[(P,2)] | Poligoni normalizzati. |

result.boxes | Boxes | (N) | Riquadri/classi/confidenze delle istanze. |

result.boxes.cls | torch.float32 | (N,) | ID di classe; convertiti in int per i nomi. |

Per i campi Results specifici per attività per ogni compito, vedi la sezione Risultati di Previsione per Attività.

In cosa differisce dalla segmentazione semantica

La segmentazione di istanza è una segmentazione a livello di oggetto: due auto producono due maschere, due riquadri e due punteggi di confidenza. La segmentazione semantica è una classificazione a livello di pixel: quelle stesse auto diventano pixel con lo stesso ID di classe in una mappa di classe delle dimensioni dell'immagine, senza riquadri per oggetto, confidenze o elenchi di poligoni predefiniti.

Esportazione

Esporta un modello YOLO26n-seg in un formato diverso come ONNX, CoreML, ecc.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load an official model

model = YOLO("path/to/best.pt") # load a custom-trained model

# Export the model

model.export(format="onnx")I formati di esportazione YOLO26-seg disponibili sono nella tabella sottostante. Puoi esportare in qualsiasi formato utilizzando l'argomento format, ad esempio format='onnx' o format='engine'. Puoi eseguire previsioni o convalide direttamente sui modelli esportati, ad esempio yolo predict model=yolo26n-seg.onnx. Gli esempi di utilizzo vengono mostrati per il tuo modello dopo il completamento dell'esportazione.

| Formato | Argomento format | Modello | Metadati | Argomenti |

|---|---|---|---|---|

| PyTorch | - | yolo26n-seg.pt | ✅ | - |

| TorchScript | torchscript | yolo26n-seg.torchscript | ✅ | imgsz, half, dynamic, optimize, nms, batch, device |

| ONNX | onnx | yolo26n-seg.onnx | ✅ | imgsz, half, dynamic, simplify, opset, nms, batch, device |

| OpenVINO | openvino | yolo26n-seg_openvino_model/ | ✅ | imgsz, half, dynamic, int8, nms, batch, data, fraction, device |

| TensorRT | engine | yolo26n-seg.engine | ✅ | imgsz, half, dynamic, simplify, workspace, int8, nms, batch, data, fraction, device |

| CoreML | coreml | yolo26n-seg.mlpackage | ✅ | imgsz, dynamic, half, int8, nms, batch, device |

| TF SavedModel | saved_model | yolo26n-seg_saved_model/ | ✅ | imgsz, keras, int8, nms, batch, data, fraction, device |

| TF GraphDef | pb | yolo26n-seg.pb | ❌ | imgsz, batch, device |

| TF Lite | tflite | yolo26n-seg.tflite | ✅ | imgsz, half, int8, nms, batch, data, fraction, device |

| TF Edge TPU | edgetpu | yolo26n-seg_edgetpu.tflite | ✅ | imgsz, int8, data, fraction, device |

| TF.js | tfjs | yolo26n-seg_web_model/ | ✅ | imgsz, half, int8, nms, batch, data, fraction, device |

| PaddlePaddle | paddle | yolo26n-seg_paddle_model/ | ✅ | imgsz, batch, device |

| MNN | mnn | yolo26n-seg.mnn | ✅ | imgsz, batch, int8, half, device |

| NCNN | ncnn | yolo26n-seg_ncnn_model/ | ✅ | imgsz, half, batch, device |

| IMX500 | imx | yolo26n-seg_imx_model/ | ✅ | imgsz, int8, data, fraction, nms, device |

| RKNN | rknn | yolo26n-seg_rknn_model/ | ✅ | imgsz, batch, name, device |

| ExecuTorch | executorch | yolo26n-seg_executorch_model/ | ✅ | imgsz, batch, device |

| Axelera | axelera | yolo26n-seg_axelera_model/ | ✅ | imgsz, batch, int8, data, fraction, device |

| DeepX | deepx | yolo26n-seg_deepx_model/ | ✅ | imgsz, int8, data, optimize, device |

Consulta i dettagli completi su export nella pagina Export.

FAQ

Come addestro un modello di segmentazione YOLO26 su un dataset personalizzato?

Per addestrare un modello di segmentazione YOLO26 su un dataset personalizzato, devi prima preparare il tuo dataset nel formato di segmentazione YOLO. Puoi utilizzare strumenti come JSON2YOLO per convertire dataset da altri formati. Una volta che il tuo dataset è pronto, puoi addestrare il modello utilizzando comandi Python o CLI:

from ultralytics import YOLO

# Load a pretrained YOLO26 segment model

model = YOLO("yolo26n-seg.pt")

# Train the model

results = model.train(data="path/to/your_dataset.yaml", epochs=100, imgsz=640)Controlla la pagina Configurazione per ulteriori argomenti disponibili.

Qual è la differenza tra rilevamento di oggetti e segmentazione di istanza in YOLO26?

Il rilevamento di oggetti identifica e localizza gli oggetti all'interno di un'immagine disegnando riquadri di delimitazione attorno ad essi, mentre la segmentazione di istanza non solo identifica i riquadri di delimitazione, ma delinea anche la forma esatta di ogni oggetto. I modelli di segmentazione di istanza YOLO26 forniscono maschere o contorni che delineano ogni oggetto rilevato, il che è particolarmente utile per attività in cui conoscere la forma precisa degli oggetti è importante, come l'imaging medico o la guida autonoma.

Perché usare YOLO26 per la segmentazione di istanza?

Ultralytics YOLO26 è un modello all'avanguardia riconosciuto per la sua elevata precisione e prestazioni in tempo reale, che lo rendono ideale per le attività di segmentazione di istanza. I modelli YOLO26 Segment vengono forniti preaddestrati sul dataset COCO, garantendo prestazioni robuste su una varietà di oggetti. Inoltre, YOLO supporta funzionalità di addestramento, convalida, previsione ed esportazione con un'integrazione perfetta, rendendolo estremamente versatile sia per la ricerca che per le applicazioni industriali.

Come carico e convalido un modello di segmentazione YOLO preaddestrato?

Caricare e convalidare un modello di segmentazione YOLO preaddestrato è semplice. Ecco come puoi farlo usando sia Python che CLI:

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n-seg.pt")

# Validate the model

metrics = model.val()

print("Mean Average Precision for boxes:", metrics.box.map)

print("Mean Average Precision for masks:", metrics.seg.map)Questi passaggi ti forniranno metriche di convalida come la Mean Average Precision (mAP), cruciale per valutare le prestazioni del modello.

Come posso esportare un modello di segmentazione YOLO in formato ONNX?

Esportare un modello di segmentazione YOLO in formato ONNX è semplice e può essere eseguito utilizzando comandi Python o CLI:

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n-seg.pt")

# Export the model to ONNX format

model.export(format="onnx")Per maggiori dettagli sull'esportazione in vari formati, consulta la pagina Export.