Link to this sectionConjunto de dados COCO128#

Link to this sectionIntrodução#

O COCO128 da Ultralytics é um pequeno, mas versátil conjunto de dados de detecção de objetos composto pelas primeiras 128 imagens do conjunto COCO train 2017. Este conjunto de dados é ideal para testar e depurar modelos de detecção de objetos, ou para experimentar novas abordagens de detecção. Com 128 imagens, é pequeno o suficiente para ser facilmente gerenciável, porém diverso o suficiente para testar pipelines de treinamento em busca de erros e atuar como uma verificação de sanidade antes de treinar conjuntos de dados maiores.

Watch: Ultralytics COCO Dataset Overview

Este conjunto de dados destina-se ao uso com a Plataforma Ultralytics e YOLO26.

Link to this sectionYAML do Dataset#

Um arquivo YAML (Yet Another Markup Language) é usado para definir a configuração do conjunto de dados. Ele contém informações sobre os caminhos, classes e outras informações relevantes do conjunto de dados. No caso do conjunto de dados COCO128, o arquivo coco128.yaml é mantido em https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco128.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO128 dataset https://www.kaggle.com/datasets/ultralytics/coco128 (first 128 images from COCO train2017) by Ultralytics

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco128.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco128 ← downloads here (7 MB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco128 # dataset root dir

train: images/train2017 # train images (relative to 'path') 128 images

val: images/train2017 # val images (relative to 'path') 128 images

test: # test images (optional)

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: https://github.com/ultralytics/assets/releases/download/v0.0.0/coco128.zipLink to this sectionUtilização#

Para treinar um modelo YOLO26n no conjunto de dados COCO128 por 100 épocas com um tamanho de imagem de 640, você pode usar os seguintes trechos de código. Para uma lista abrangente de argumentos disponíveis, consulte a página de Treinamento do modelo.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco128.yaml", epochs=100, imgsz=640)Link to this sectionAmostra de Imagens e Anotações#

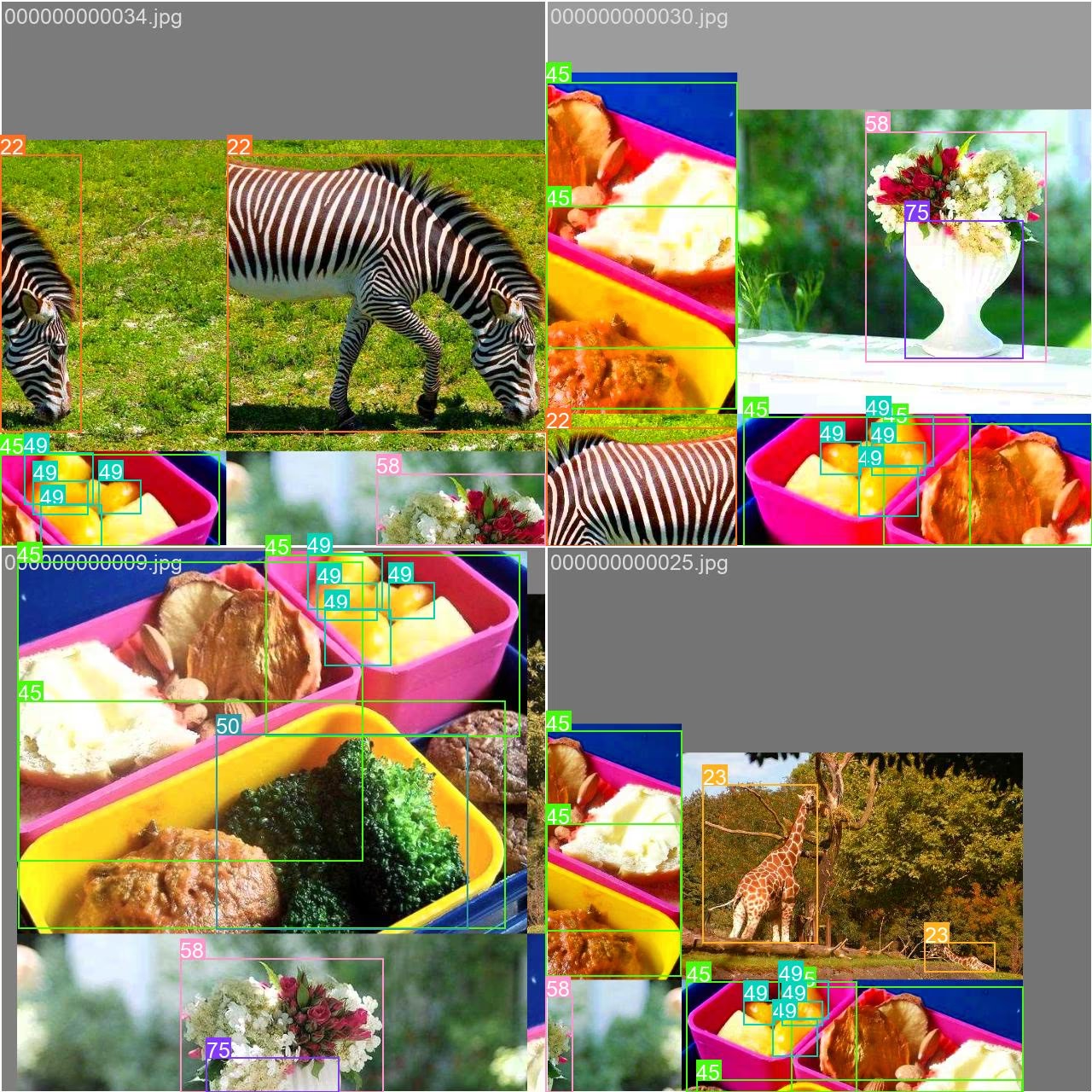

Aqui estão alguns exemplos de imagens do conjunto de dados COCO128, juntamente com suas anotações correspondentes:

- Imagem em mosaico: Esta imagem demonstra um lote de treino composto por imagens do conjunto de dados em mosaico. A técnica de mosaico é um método utilizado durante o treino que combina várias imagens numa única para aumentar a variedade de objetos e cenas dentro de cada lote de treino. Isto ajuda a melhorar a capacidade do modelo de generalizar para diferentes tamanhos de objetos, proporções e contextos.

O exemplo mostra a variedade e a complexidade das imagens no conjunto de dados COCO128 e os benefícios de usar a mosaicação durante o processo de treinamento.

Link to this sectionCitações e Agradecimentos#

Se utilizares o conjunto de dados COCO no teu trabalho de investigação ou desenvolvimento, por favor cita o seguinte artigo:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Gostaríamos de agradecer ao Consórcio COCO por criar e manter este recurso valioso para a comunidade de visão computacional. Para mais informações sobre o conjunto de dados COCO e seus criadores, visite o site do conjunto de dados COCO.

Link to this sectionFAQ#

Link to this sectionPara que serve o conjunto de dados Ultralytics COCO128?#

O conjunto de dados Ultralytics COCO128 é um subconjunto compacto contendo as primeiras 128 imagens do conjunto de dados COCO train 2017. É usado principalmente para testar e depurar modelos de detecção de objetos, experimentar novas abordagens de detecção e validar pipelines de treinamento antes de escalar para conjuntos de dados maiores. Seu tamanho gerenciável o torna perfeito para iterações rápidas, ao mesmo tempo em que oferece diversidade suficiente para ser um caso de teste significativo.

Link to this sectionComo treino um modelo YOLO26 usando o conjunto de dados COCO128?#

Para treinar um modelo YOLO26 no conjunto de dados COCO128, você pode usar Python ou comandos CLI. Veja como:

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n.pt")

# Train the model

results = model.train(data="coco128.yaml", epochs=100, imgsz=640)Para mais opções e parâmetros de treinamento, consulte a documentação de Treinamento.

Link to this sectionQuais são os benefícios de usar o aumento de mosaico (mosaic augmentation) com o COCO128?#

O aumento de mosaico, conforme mostrado nas imagens de exemplo, combina várias imagens de treinamento em uma única imagem composta. Esta técnica oferece vários benefícios ao treinar com o COCO128:

- Aumenta a variedade de objetos e contextos dentro de cada lote de treinamento

- Melhora a generalização do modelo em diferentes tamanhos de objetos e proporções

- Melhora o desempenho de detecção para objetos em várias escalas

- Maximiza a utilidade de um pequeno conjunto de dados criando amostras de treinamento mais diversas

Esta técnica é particularmente valiosa para conjuntos de dados menores como o COCO128, ajudando os modelos a aprender características mais robustas a partir de dados limitados.

Link to this sectionComo o COCO128 se compara a outras variantes do conjunto de dados COCO?#

O COCO128 (128 imagens) situa-se entre o COCO8 (8 imagens) e o conjunto de dados COCO completo (mais de 118 mil imagens) em termos de tamanho:

- COCO8: Contém apenas 8 imagens (4 de treino, 4 de validação) - ideal para testes rápidos e depuração

- COCO128: Contém 128 imagens - equilibrado entre tamanho e diversidade

- COCO Completo: Contém mais de 118 mil imagens de treinamento - abrangente, mas requer muitos recursos

O COCO128 oferece um bom meio-termo, oferecendo mais diversidade que o COCO8, enquanto permanece muito mais gerenciável do que o conjunto de dados COCO completo para experimentação e desenvolvimento inicial de modelos.

Link to this sectionPosso usar o COCO128 para tarefas além da detecção de objetos?#

Embora o COCO128 seja projetado principalmente para detecção de objetos, as anotações do conjunto de dados podem ser adaptadas para outras tarefas de visão computacional:

- Segmentação de instâncias: Usando as máscaras de segmentação fornecidas nas anotações

- Detecção de pontos-chave (keypoints): Para imagens contendo pessoas com anotações de pontos-chave

- Aprendizado por transferência (transfer learning): Como ponto de partida para o ajuste fino (fine-tuning) de modelos para tarefas personalizadas

Para tarefas especializadas como segmentação, considere usar variantes criadas para esse fim, como o COCO8-seg, que incluem as anotações apropriadas.