YOLO26 모델을 TFLite Edge TPU 형식으로 내보내는 방법 배우기

모바일 또는 임베디드 시스템과 같이 컴퓨팅 성능이 제한적인 장치에 컴퓨터 비전 모델을 배포하는 것은 까다로울 수 있습니다. 더 빠른 성능에 최적화된 모델 형식을 사용하면 프로세스가 단순해집니다. TensorFlow LiteEdge TPU 또는 TFLite Edge TPU 모델 형식은 최소한의 전력을 사용하면서 신경망에 빠른 성능을 제공하도록 설계되었습니다.

TFLite Edge TPU 형식으로 내보내기 기능은 Ultralytics YOLO26 모델을 고속 및 저전력 추론에 최적화할 수 있도록 합니다. 이 가이드에서는 모델을 TFLite Edge TPU 형식으로 변환하는 과정을 안내하여 다양한 모바일 및 임베디드 장치에서 모델이 잘 작동하도록 돕습니다.

TFLite Edge TPU로 내보내야 하는 이유

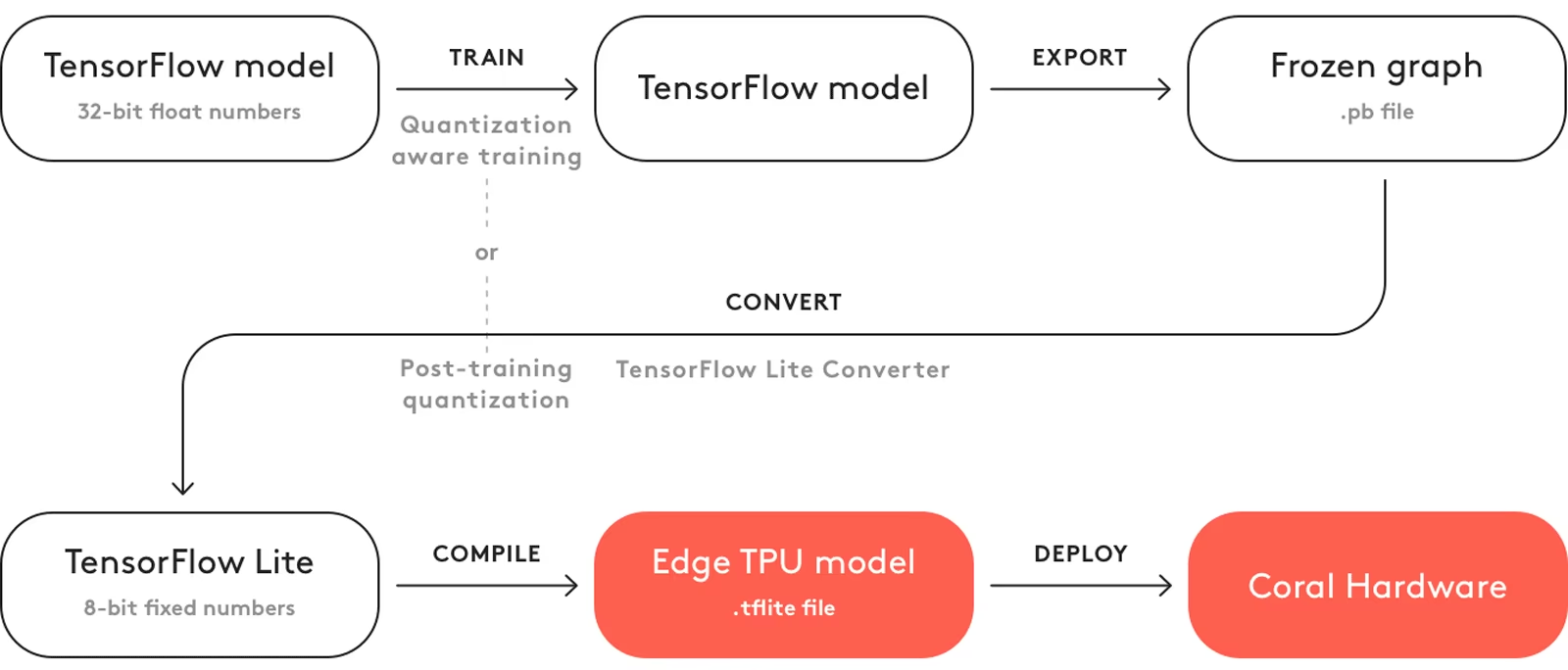

TensorFlow Edge TPU로 모델을 내보내면 머신 러닝 작업이 빠르고 효율적으로 수행됩니다. 이 기술은 제한된 전력, 컴퓨팅 리소스 및 연결성을 가진 애플리케이션에 적합합니다. Edge TPU는 Google에서 제공하는 하드웨어 가속기입니다. 에지 장치에서 TensorFlow Lite 모델의 속도를 높입니다. 아래 이미지는 관련된 프로세스의 예입니다.

Edge TPU는 양자화된 모델과 함께 작동합니다. 양자화는 정확도를 크게 잃지 않고 모델을 더 작고 빠르게 만듭니다. 이는 에지 컴퓨팅의 제한된 리소스에 이상적이며, 지연 시간을 줄이고 클라우드 종속성 없이 로컬에서 빠른 데이터 처리를 가능하게 하여 애플리케이션이 신속하게 응답할 수 있도록 합니다. 로컬 처리는 또한 원격 서버로 전송되지 않으므로 사용자 데이터를 비공개로 안전하게 유지합니다.

TFLite Edge TPU의 주요 기능

다음은 TFLite Edge TPU가 개발자에게 훌륭한 모델 형식 선택이 되도록 하는 주요 기능입니다.

엣지 디바이스에서의 최적화된 성능: TFLite Edge TPU는 양자화, 모델 최적화, 하드웨어 가속 및 컴파일러 최적화를 통해 고속 신경망 성능을 구현합니다. 최소한의 아키텍처는 더 작은 크기와 비용 효율성에 기여합니다.

높은 연산 처리량: TFLite Edge TPU는 특수 하드웨어 가속과 효율적인 런타임 실행을 결합하여 높은 연산 처리량을 달성합니다. 이는 엣지 디바이스에서 엄격한 성능 요구 사항을 가진 머신러닝 모델을 배포하는 데 매우 적합합니다.

효율적인 행렬 계산: TensorFlow Edge TPU는 신경망 계산에 중요한 행렬 연산에 최적화되어 있습니다. 이러한 효율성은 특히 수많은 복잡한 행렬 곱셈과 변환을 필요로 하는 머신 러닝 모델에서 핵심적입니다.

TFLite Edge TPU를 사용한 배포 옵션

YOLO26 모델을 TFLite Edge TPU 형식으로 내보내는 방법을 알아보기 전에, TFLite Edge TPU 모델이 주로 어디에 사용되는지 이해해 봅시다.

TFLite Edge TPU는 머신러닝 모델을 위한 다양한 배포 옵션을 제공합니다.

온-디바이스 배포: TensorFlow Edge TPU 모델은 모바일 및 임베디드 장치에 직접 배포할 수 있습니다. 온디바이스 배포를 사용하면 모델을 애플리케이션 번들에 포함하거나 필요에 따라 다운로드하여 클라우드 연결이 필요 없이 하드웨어에서 직접 실행할 수 있습니다.

클라우드 TensorFlow TPU를 사용한 엣지 컴퓨팅: 엣지 장치의 처리 능력이 제한적인 경우, TensorFlow Edge TPU는 TPU가 장착된 클라우드 서버로 추론 작업을 오프로드할 수 있습니다.

하이브리드 배포: 하이브리드 접근 방식은 장치 내 배포와 클라우드 배포를 결합하여 머신 러닝 모델 배포를 위한 다재다능하고 확장 가능한 솔루션을 제공합니다. 장점으로는 빠른 응답을 위한 장치 내 처리와 더 복잡한 계산을 위한 클라우드 컴퓨팅이 있습니다.

YOLO26 모델을 TFLite Edge TPU로 내보내기

YOLO26 모델을 TensorFlow Edge TPU로 변환하여 모델 호환성 및 배포 유연성을 확장할 수 있습니다.

설치

필수 패키지를 설치하려면 다음을 실행합니다.

설치

# Install the required package for YOLO26

pip install ultralytics

설치 과정과 관련된 자세한 지침 및 모범 사례는 Ultralytics 설치 가이드를 확인하십시오. YOLO26에 필요한 패키지를 설치하는 동안 어려움이 발생하면 해결책과 팁을 얻기 위해 일반적인 문제 가이드를 참조하십시오.

사용법

모든 Ultralytics YOLO26 모델은 기본적으로 내보내기를 지원하도록 설계되어 선호하는 배포 워크플로에 쉽게 통합할 수 있습니다. 애플리케이션에 가장 적합한 설정을 선택하려면 지원되는 내보내기 형식 및 구성 옵션의 전체 목록을 볼 수 있습니다.

사용법

from ultralytics import YOLO

# Load the YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to TFLite Edge TPU format

model.export(format="edgetpu") # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Load the exported TFLite Edge TPU model

edgetpu_model = YOLO("yolo26n_full_integer_quant_edgetpu.tflite")

# Run inference

results = edgetpu_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TFLite Edge TPU format

yolo export model=yolo26n.pt format=edgetpu # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Run inference with the exported model

yolo predict model=yolo26n_full_integer_quant_edgetpu.tflite source='https://ultralytics.com/images/bus.jpg'

인수 내보내기

| 인수 | 유형 | 기본값 | 설명 |

|---|---|---|---|

format | str | 'edgetpu' | 다양한 배포 환경과의 호환성을 정의하는 내보낸 모델의 대상 형식입니다. |

imgsz | int 또는 tuple | 640 | 모델 입력에 대한 원하는 이미지 크기입니다. 정사각형 이미지의 경우 정수이거나 튜플일 수 있습니다. (height, width) 특정 크기의 경우. |

device | str | None | 내보내기 장치를 지정합니다: CPU (device=cpu)입니다. |

팁

EdgeTPU로 내보낼 때는 x86 Linux 시스템을 사용해야 합니다.

내보내기 프로세스에 대한 자세한 내용은 내보내기에 대한 Ultralytics 문서 페이지를 참조하십시오.

내보낸 YOLO26 TFLite Edge TPU 모델 배포

Ultralytics YOLO26 모델을 TFLite Edge TPU 형식으로 성공적으로 내보낸 후, 이제 배포할 수 있습니다. TFLite Edge TPU 모델을 실행하기 위한 주요 권장 첫 번째 단계는 이전 사용 코드 스니펫에 설명된 대로 YOLO("model_edgetpu.tflite") 메서드를 사용하는 것입니다.

그러나 TFLite Edge TPU 모델 배포에 대한 심층적인 지침은 다음 자료를 참조하십시오.

Ultralytics YOLO26와 함께 라즈베리 파이에서 Coral Edge TPU 사용하기: 향상된 머신러닝 기능을 위해 Coral Edge TPU를 라즈베리 파이와 통합하는 방법을 알아보세요.

코드 예제: 프로젝트를 시작하기 위한 실용적인 TensorFlow Edge TPU 배포 예제에 액세스하십시오.

python으로 Edge TPU에서 추론 실행: 설정 및 사용 지침을 포함하여 Edge TPU 애플리케이션을 위한 TensorFlow Lite python API 사용 방법을 살펴봅니다.

요약

이 가이드에서는 Ultralytics YOLO26 모델을 TFLite Edge TPU 형식으로 내보내는 방법을 배웠습니다. 위에 언급된 단계를 따르면 컴퓨터 비전 애플리케이션의 속도와 성능을 향상시킬 수 있습니다.

사용법에 대한 자세한 내용은 Edge TPU 공식 웹사이트를 참조하십시오.

또한, 다른 Ultralytics YOLO26 통합에 대한 자세한 내용은 통합 가이드 페이지를 방문하세요. 그곳에서 귀중한 자료와 통찰력을 얻을 수 있습니다.

FAQ

YOLO26 모델을 TFLite Edge TPU 형식으로 어떻게 내보내나요?

YOLO26 모델을 TFLite Edge TPU 형식으로 내보내려면 다음 단계를 따르세요:

사용법

from ultralytics import YOLO

# Load the YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to TFLite Edge TPU format

model.export(format="edgetpu") # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Load the exported TFLite Edge TPU model

edgetpu_model = YOLO("yolo26n_full_integer_quant_edgetpu.tflite")

# Run inference

results = edgetpu_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TFLite Edge TPU format

yolo export model=yolo26n.pt format=edgetpu # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Run inference with the exported model

yolo predict model=yolo26n_full_integer_quant_edgetpu.tflite source='https://ultralytics.com/images/bus.jpg'

모델을 다른 형식으로 내보내는 방법에 대한 자세한 내용은 내보내기 가이드를 참조하십시오.

YOLO26 모델을 TFLite Edge TPU로 내보내는 것의 이점은 무엇인가요?

YOLO26 모델을 TFLite Edge TPU로 내보내면 여러 이점이 있습니다:

- 최적화된 성능: 최소한의 전력 소비로 고속 신경망 성능을 달성합니다.

- 지연 시간 단축: 클라우드 종속성 없이 빠른 로컬 데이터 처리.

- 향상된 개인 정보 보호: 로컬 처리를 통해 사용자 데이터를 비공개로 안전하게 유지합니다.

따라서 장치의 전력 및 계산 리소스가 제한된 에지 컴퓨팅의 응용 분야에 이상적입니다. 내보내야 하는 이유에 대해 자세히 알아보십시오.

모바일 및 임베디드 장치에 TFLite Edge TPU 모델을 배포할 수 있나요?

예, TensorFlow Lite Edge TPU 모델은 모바일 및 임베디드 장치에 직접 배포할 수 있습니다. 이 배포 방식을 사용하면 모델이 하드웨어에서 직접 실행되어 더 빠르고 효율적인 추론이 가능합니다. 통합 예제는 Raspberry Pi에 Coral Edge TPU 배포에 대한 가이드를 참조하십시오.

TFLite Edge TPU 모델의 일반적인 사용 사례는 무엇인가요?

TFLite Edge TPU 모델의 일반적인 사용 사례는 다음과 같습니다.

- 스마트 카메라: 실시간 이미지 및 비디오 분석 기능 향상.

- IoT 장치: 스마트 홈 및 산업 자동화를 지원합니다.

- 의료: 의료 영상 및 진단 가속화.

- 소매: 재고 관리 및 고객 행동 분석 개선.

이러한 애플리케이션은 TFLite Edge TPU 모델의 고성능 및 저전력 소비의 이점을 얻습니다. 사용 시나리오에 대해 더 알아보십시오.

TFLite Edge TPU 모델을 내보내거나 배포하는 동안 발생하는 문제를 어떻게 해결할 수 있나요?

TFLite Edge TPU 모델을 내보내거나 배포하는 동안 문제가 발생하면, 문제 해결 팁을 위해 일반적인 문제 가이드를 참조하십시오. 이 가이드는 원활한 작동을 보장하는 데 도움이 되는 일반적인 문제와 해결책을 다룹니다. 추가 지원을 받으려면 도움말 센터를 방문하십시오.