快速入门指南:NVIDIA Jetson与Ultralytics YOLO26

本综合指南提供了在NVIDIA Jetson设备上部署Ultralytics YOLO26的详细演练。此外,它还展示了性能基准,以证明YOLO26在这些小型而强大的设备上的能力。

新的产品支持

我们已使用最新的 NVIDIA Jetson AGX Thor Developer Kit 更新了本指南,该套件可提供高达 2070 FP4 TFLOPS 的 AI 计算能力和 128 GB 内存,功耗可在 40 W 至 130 W 之间配置。它比 NVIDIA Jetson AGX Orin 提供高出 7.5 倍以上的 AI 计算能力,能效提高 3.5 倍,可无缝运行最流行的 AI 模型。

观看: 如何在NVIDIA Jetson设备上使用Ultralytics YOLO26

注意

本指南已在以下设备上进行测试:NVIDIA Jetson AGX Thor Developer Kit (Jetson T5000)(运行最新稳定版JetPack JP7.0)、NVIDIA Jetson AGX Orin Developer Kit (64GB)(运行JetPack JP6.2)、NVIDIA Jetson Orin Nano Super Developer Kit(运行JetPack JP6.1)、Seeed Studio reComputer J4012(基于NVIDIA Jetson Orin NX 16GB,运行JetPack JP6.0/JetPack JP5.1.3)以及Seeed Studio reComputer J1020 v2(基于NVIDIA Jetson Nano 4GB,运行JetPack JP4.6.1)。预计它将兼容所有NVIDIA Jetson硬件系列,包括最新和传统设备。

什么是 NVIDIA Jetson?

NVIDIA Jetson 是一系列嵌入式计算板,旨在将加速 AI(人工智能)计算引入边缘设备。这些紧凑而强大的设备围绕 NVIDIA 的 GPU 架构构建,可以直接在设备上运行复杂的 AI 算法和深度学习模型,而无需依赖云计算资源。Jetson 板常用于机器人、自动驾驶汽车、工业自动化以及其他需要以低延迟和高效率在本地执行 AI 推理的应用。此外,这些板基于 ARM64 架构,与传统的 GPU 计算设备相比,功耗更低。

NVIDIA Jetson 系列对比

NVIDIA Jetson AGX Thor 是基于 NVIDIA Blackwell 架构的 NVIDIA Jetson 系列的最新迭代产品,与前几代产品相比,它极大地提高了 AI 性能。下表比较了生态系统中的一些 Jetson 设备。

| Jetson AGX Thor(T5000) | Jetson AGX Orin 64GB | Jetson Orin NX 16GB | Jetson Orin Nano Super | Jetson AGX Xavier | Jetson Xavier NX | Jetson Nano | |

|---|---|---|---|---|---|---|---|

| AI 性能 | 2070 TFLOPS | 275 TOPS | 100 TOPS | 67 TOPS | 32 TOPS | 21 TOPS | 472 GFLOPS |

| GPU | 具有 96 个 Tensor Core 的 2560 核 NVIDIA Blackwell 架构 GPU | 2048 核 NVIDIA Ampere 架构 GPU,带 64 个 Tensor Core | 1024 核 NVIDIA Ampere 架构 GPU,带 32 个 Tensor Core | 1024 核 NVIDIA Ampere 架构 GPU,带 32 个 Tensor Core | 512 核 NVIDIA Volta 架构 GPU,带 64 个 Tensor Core | 384 核 NVIDIA Volta™ 架构 GPU,带 48 个 Tensor Core | 128核 NVIDIA Maxwell™ 架构 GPU |

| GPU 最大频率 | 1.57 GHz | 1.3 GHz | 918 MHz | 1020 MHz | 1377 MHz | 1100 MHz | 921MHz |

| CPU | 14 核 Arm® Neoverse®-V3AE 64-bit CPU 1MB L2 + 16MB L3 | 12核 NVIDIA Arm® Cortex A78AE v8.2 64位 CPU,3MB L2 + 6MB L3 | 8核 NVIDIA Arm® Cortex A78AE v8.2 64位 CPU,2MB L2 + 4MB L3 | 6核 Arm® Cortex®-A78AE v8.2 64位 CPU,1.5MB L2 + 4MB L3 | 8核 NVIDIA Carmel Arm®v8.2 64位 CPU,8MB L2 + 4MB L3 | 6核 NVIDIA Carmel Arm®v8.2 64位 CPU,6MB L2 + 4MB L3 | 四核 Arm® Cortex®-A57 MPCore 处理器 |

| CPU 最大频率 | 2.6 GHz | 2.2 GHz | 2.0 GHz | 1.7 GHz | 2.2 GHz | 1.9 GHz | 1.43GHz |

| 内存 | 128GB 256-bit LPDDR5X 273GB/s | 64GB 256位 LPDDR5 204.8GB/s | 16GB 128位 LPDDR5 102.4GB/s | 8GB 128-bit LPDDR5 102 GB/s | 32GB 256位 LPDDR4x 136.5GB/s | 8GB 128位 LPDDR4x 59.7GB/s | 4GB 64-bit LPDDR4 25.6GB/s |

有关更详细的比较表,请访问NVIDIA Jetson 官方页面的“比较规格”部分。

什么是 NVIDIA JetPack?

为 Jetson 模块提供支持的 NVIDIA JetPack SDK 是最全面的解决方案,它提供了完整的开发环境,用于构建端到端加速 AI 应用程序并缩短上市时间。JetPack 包括带有引导加载程序的 Jetson Linux、Linux 内核、Ubuntu 桌面环境以及一整套用于加速 GPU 计算、多媒体、图形和计算机视觉的库。它还包括主机和开发工具包的示例、文档和开发人员工具,并支持更高级别的 SDK,例如用于流视频分析的 DeepStream、用于机器人的 Isaac 和用于会话 AI 的 Riva。

将 JetPack 刷写到 NVIDIA Jetson

获得NVIDIA Jetson设备后的第一步是将NVIDIA JetPack刷写到设备上。刷写NVIDIA Jetson设备有几种不同的方法。

- 如果您拥有官方 NVIDIA 开发套件,例如 Jetson AGX Thor 开发套件,您可以下载镜像并准备一个可启动的 USB 盘,将 JetPack 刷写到随附的 SSD。

- 如果您拥有官方的NVIDIA开发套件,例如Jetson Orin Nano开发者套件,您可以下载镜像并准备一张带有JetPack的SD卡来启动设备。

- 如果您拥有任何其他 NVIDIA 开发套件,您可以使用 SDK 管理器将 JetPack 刷入设备。

- 如果您拥有 Seeed Studio reComputer J4012 设备,您可以将 JetPack 刷入自带的 SSD;如果您拥有 Seeed Studio reComputer J1020 v2 设备,您可以将 JetPack 刷入 eMMC/SSD。

- 如果您拥有任何其他由 NVIDIA Jetson 模块供电的第三方设备,建议遵循命令行刷写。

注意

对于上述方法 1、4 和 5,在刷写系统并启动设备后,请在设备终端输入 "sudo apt update && sudo apt install nvidia-jetpack -y" 以安装所有剩余所需的 JetPack 组件。

基于 Jetson 设备的 JetPack 支持

下表重点列出了不同 NVIDIA Jetson 设备支持的 NVIDIA JetPack 版本。

| JetPack 4 | JetPack 5 | JetPack 6 | JetPack 7 | |

|---|---|---|---|---|

| Jetson Nano | ✅ | ❌ | ❌ | ❌ |

| Jetson TX2 | ✅ | ❌ | ❌ | ❌ |

| Jetson Xavier NX | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Xavier | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Orin | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin NX | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin Nano | ❌ | ✅ | ✅ | ❌ |

| Jetson AGX Thor | ❌ | ❌ | ❌ | ✅ |

Docker 快速入门

在NVIDIA Jetson上开始使用Ultralytics YOLO26的最快方式是运行Jetson的预构建docker镜像。请参考上表,根据您拥有的Jetson设备选择JetPack版本。

t=ultralytics/ultralytics:latest-jetson-jetpack4

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack5

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack6

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-nvidia-arm64

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

完成此操作后,跳至 在 NVIDIA Jetson 上使用 TensorRT 部分。

本地安装入门

对于没有 Docker 的原生安装,请参考以下步骤。

在JetPack 7.0上运行

安装 Ultralytics 软件包

这里我们将在 Jetson 上安装 Ultralytics 包及其可选依赖项,以便我们可以将 PyTorch 模型导出为其他不同的格式。我们将主要关注 NVIDIA TensorRT 导出,因为 TensorRT 将确保我们能够充分发挥 Jetson 设备的性能。

更新软件包列表,安装 pip 并升级到最新版本

sudo apt update sudo apt install python3-pip -y pip install -U pip安装

ultralytics带有可选依赖项的 pip 软件包pip install ultralytics[export]重新启动设备

sudo reboot

安装 PyTorch 和 Torchvision

上述 Ultralytics 安装将安装 Torch 和 Torchvision。然而,通过 pip 安装的这两个软件包不兼容在搭载 JetPack 7.0 和 CUDA 13 的 Jetson AGX Thor 上运行。因此,我们需要手动安装它们。

安装 torch 和 torchvision 根据JP7.0

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu130

安装 onnxruntime-gpu

字段 onnxruntime-gpu 托管在PyPI上的包不包含 aarch64 Jetson 的二进制文件。因此,我们需要手动安装此软件包。某些导出需要此软件包。

在此我们将下载并安装 onnxruntime-gpu 1.24.0 使用 Python3.12 支持。

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.24.0-cp312-cp312-linux_aarch64.whl

在 JetPack 6.1 上运行

安装 Ultralytics 软件包

这里我们将在 Jetson 上安装 Ultralytics 包及其可选依赖项,以便我们可以将 PyTorch 模型导出为其他不同的格式。我们将主要关注 NVIDIA TensorRT 导出,因为 TensorRT 将确保我们能够充分发挥 Jetson 设备的性能。

更新软件包列表,安装 pip 并升级到最新版本

sudo apt update sudo apt install python3-pip -y pip install -U pip安装

ultralytics带有可选依赖项的 pip 软件包pip install ultralytics[export]重新启动设备

sudo reboot

安装 PyTorch 和 Torchvision

上述 Ultralytics 安装将安装 Torch 和 Torchvision。然而,通过 pip 安装的这两个软件包与基于 ARM64 架构的 Jetson 平台不兼容。因此,我们需要手动安装预构建的 PyTorch pip wheel,并从源代码编译或安装 Torchvision。

安装 torch 2.10.0 和 torchvision 0.25.0 根据JP6.1

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.10.0-cp310-cp310-linux_aarch64.whl

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.25.0-cp310-cp310-linux_aarch64.whl

注意

访问 Jetson 的 PyTorch 页面 以访问适用于不同 JetPack 版本的 PyTorch 的所有不同版本。 有关 PyTorch、Torchvision 兼容性的更详细列表,请访问 PyTorch 和 Torchvision 兼容性页面。

安装 cuDSS 修复与以下相关的依赖问题 torch 2.10.0

wget https://developer.download.nvidia.com/compute/cudss/0.7.1/local_installers/cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo dpkg -i cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo cp /var/cudss-local-tegra-repo-ubuntu2204-0.7.1/cudss-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cudss

安装 onnxruntime-gpu

字段 onnxruntime-gpu 托管在PyPI上的包不包含 aarch64 Jetson 的二进制文件。因此,我们需要手动安装此软件包。某些导出需要此软件包。

您可以找到所有可用的 onnxruntime-gpu 软件包,按 JetPack 版本、python 版本和其他兼容性详细信息进行组织,位于 Jetson Zoo ONNX Runtime 兼容性矩阵.

关于 JetPack 6 使用 Python 3.10 支持,您可以安装 onnxruntime-gpu 1.23.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.23.0-cp310-cp310-linux_aarch64.whl

或者,对于 onnxruntime-gpu 1.20.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.20.0-cp310-cp310-linux_aarch64.whl

在 JetPack 5.1.2 上运行

安装 Ultralytics 软件包

在这里,我们将在 Jetson 上安装 Ultralytics 包以及可选的依赖项,以便我们可以将 PyTorch 模型导出为其他不同的格式。我们将主要关注 NVIDIA TensorRT 导出,因为 TensorRT 将确保我们能够从 Jetson 设备中获得最佳性能。

更新软件包列表,安装 pip 并升级到最新版本

sudo apt update sudo apt install python3-pip -y pip install -U pip安装

ultralytics带有可选依赖项的 pip 软件包pip install ultralytics[export]重新启动设备

sudo reboot

安装 PyTorch 和 Torchvision

上述 Ultralytics 安装将安装 Torch 和 Torchvision。然而,通过 pip 安装的这两个软件包与基于 ARM64 架构的 Jetson 平台不兼容。因此,我们需要手动安装预构建的 PyTorch pip wheel,并从源代码编译或安装 Torchvision。

卸载当前安装的 PyTorch 和 Torchvision

pip uninstall torch torchvision安装

torch 2.1.0和torchvision 0.16.2根据JP5.1.2pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.1.0a0+41361538.nv23.06-cp38-cp38-linux_aarch64.whl pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.16.2+c6f3977-cp38-cp38-linux_aarch64.whl

注意

访问 Jetson 的 PyTorch 页面 以访问适用于不同 JetPack 版本的 PyTorch 的所有不同版本。 有关 PyTorch、Torchvision 兼容性的更详细列表,请访问 PyTorch 和 Torchvision 兼容性页面。

安装 onnxruntime-gpu

字段 onnxruntime-gpu 托管在PyPI上的包不包含 aarch64 Jetson 的二进制文件。因此,我们需要手动安装此软件包。某些导出需要此软件包。

您可以找到所有可用的 onnxruntime-gpu 软件包,按 JetPack 版本、python 版本和其他兼容性详细信息进行组织,位于 Jetson Zoo ONNX Runtime 兼容性矩阵。在这里,我们将下载并安装 onnxruntime-gpu 1.17.0 使用 Python3.8 支持。

wget https://nvidia.box.com/shared/static/zostg6agm00fb6t5uisw51qi6kpcuwzd.whl -O onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

pip install onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

注意

onnxruntime-gpu 将自动恢复 numpy 版本到最新版本。因此,我们需要重新安装 numpy 到 1.23.5 通过执行以下命令来修复问题:

pip install numpy==1.23.5

在 NVIDIA Jetson 上使用 TensorRT

在 Ultralytics 支持的所有模型导出格式中,TensorRT 在 NVIDIA Jetson 设备上提供最高的推理性能,使其成为我们对 Jetson 部署的首要推荐。有关设置说明和高级用法,请参阅我们专门的 TensorRT 集成指南。

将模型转换为 TensorRT 并运行推理

PyTorch格式的YOLO26n模型被转换为TensorRT,以使用导出的模型运行推理。

示例

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT

model.export(format="engine") # creates 'yolo26n.engine'

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format

yolo export model=yolo26n.pt format=engine # creates 'yolo26n.engine'

# Run inference with the exported model

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

注意

访问导出页面以访问将模型导出为不同模型格式时的其他参数

使用 NVIDIA 深度学习加速器 (DLA)

NVIDIA 深度学习加速器 (DLA) 是一种内置于 NVIDIA Jetson 设备中的专用硬件组件,可优化深度学习推理,从而提高能效和性能。通过将任务从 GPU 卸载(从而释放 GPU 以进行更密集的处理),DLA 使模型能够以更低的功耗运行,同时保持高吞吐量,这非常适合嵌入式系统和实时 AI 应用。

以下 Jetson 设备配备了 DLA 硬件:

| Jetson 设备 | DLA 核心 | DLA 最大频率 |

|---|---|---|

| Jetson AGX Orin 系列 | 2 | 1.6 GHz |

| Jetson Orin NX 16GB | 2 | 614 MHz |

| Jetson Orin NX 8GB | 1 | 614 MHz |

| Jetson AGX Xavier 系列 | 2 | 1.4 GHz |

| Jetson Xavier NX 系列 | 2 | 1.1 GHz |

示例

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT with DLA enabled (only works with FP16 or INT8)

model.export(format="engine", device="dla:0", half=True) # dla:0 or dla:1 corresponds to the DLA cores

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format with DLA enabled (only works with FP16 or INT8)

# Once DLA core number is specified at export, it will use the same core at inference

yolo export model=yolo26n.pt format=engine device="dla:0" half=True # dla:0 or dla:1 corresponds to the DLA cores

# Run inference with the exported model on the DLA

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

注意

当使用 DLA 导出时,某些层可能不支持在 DLA 上运行,并将回退到 GPU 执行。这种回退会引入额外的延迟,并影响整体推理性能。因此,与完全在 GPU 上运行的 TensorRT 相比,DLA 的主要目的不是减少推理延迟,而是提高吞吐量和提高能源效率。

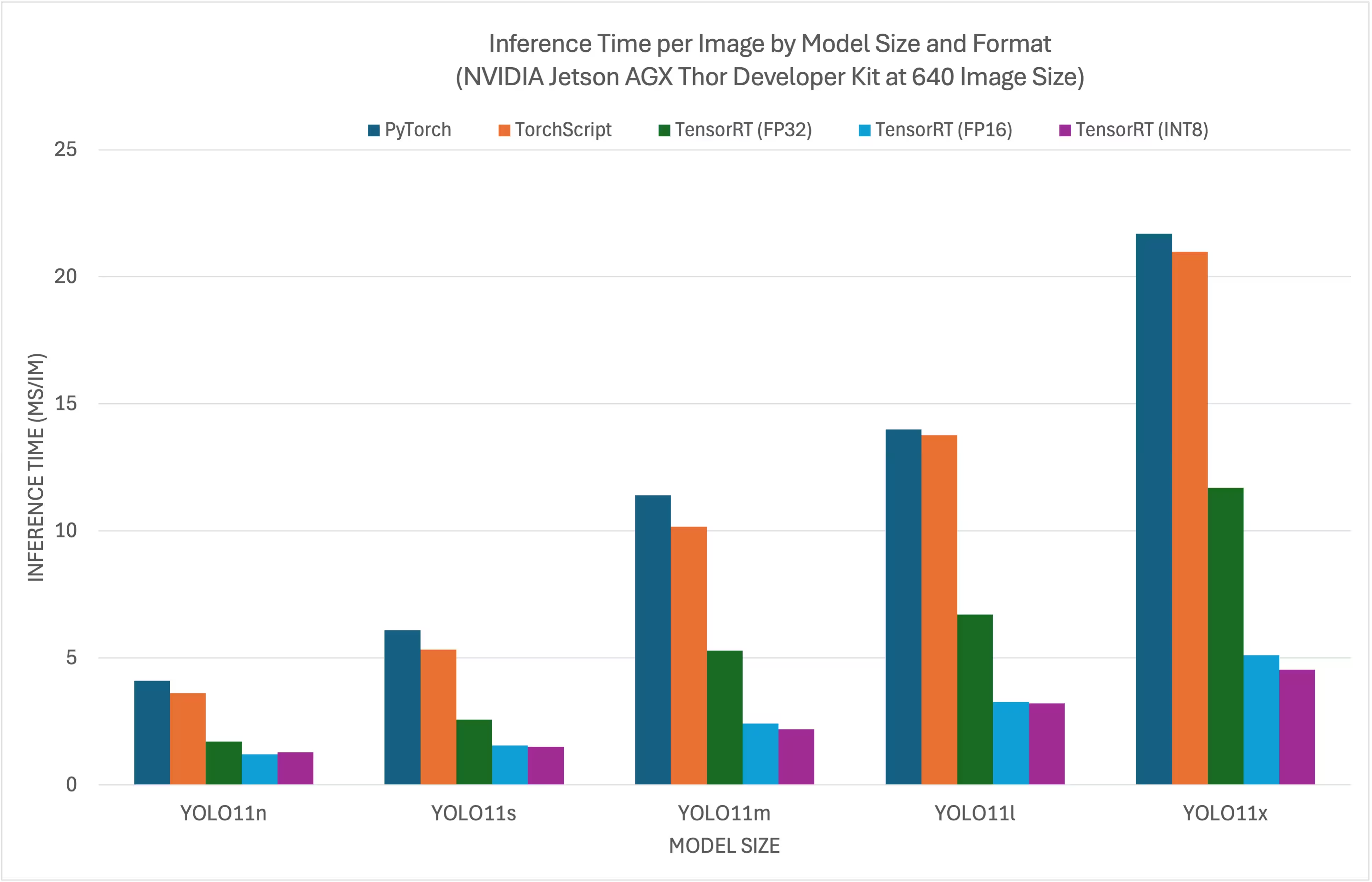

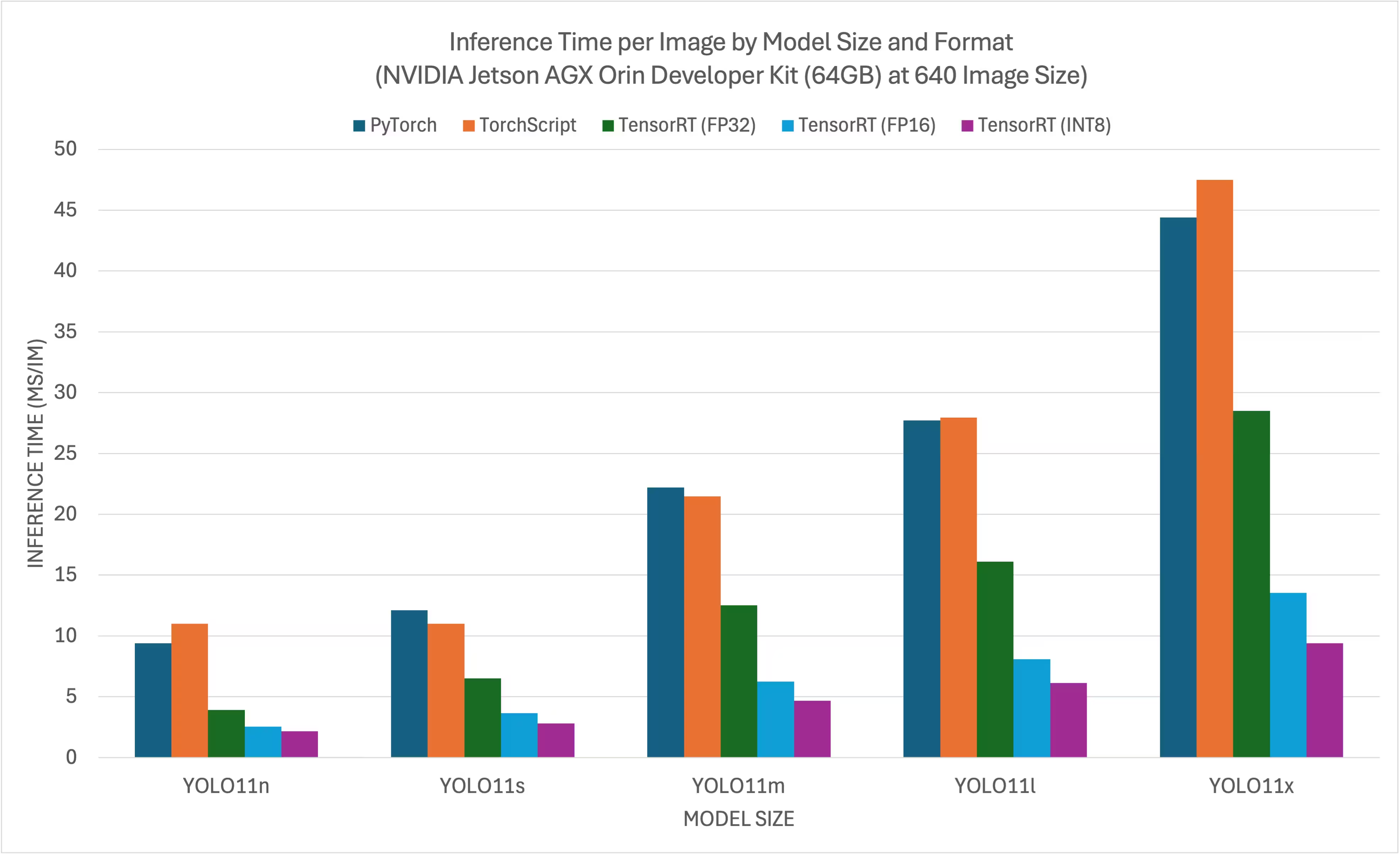

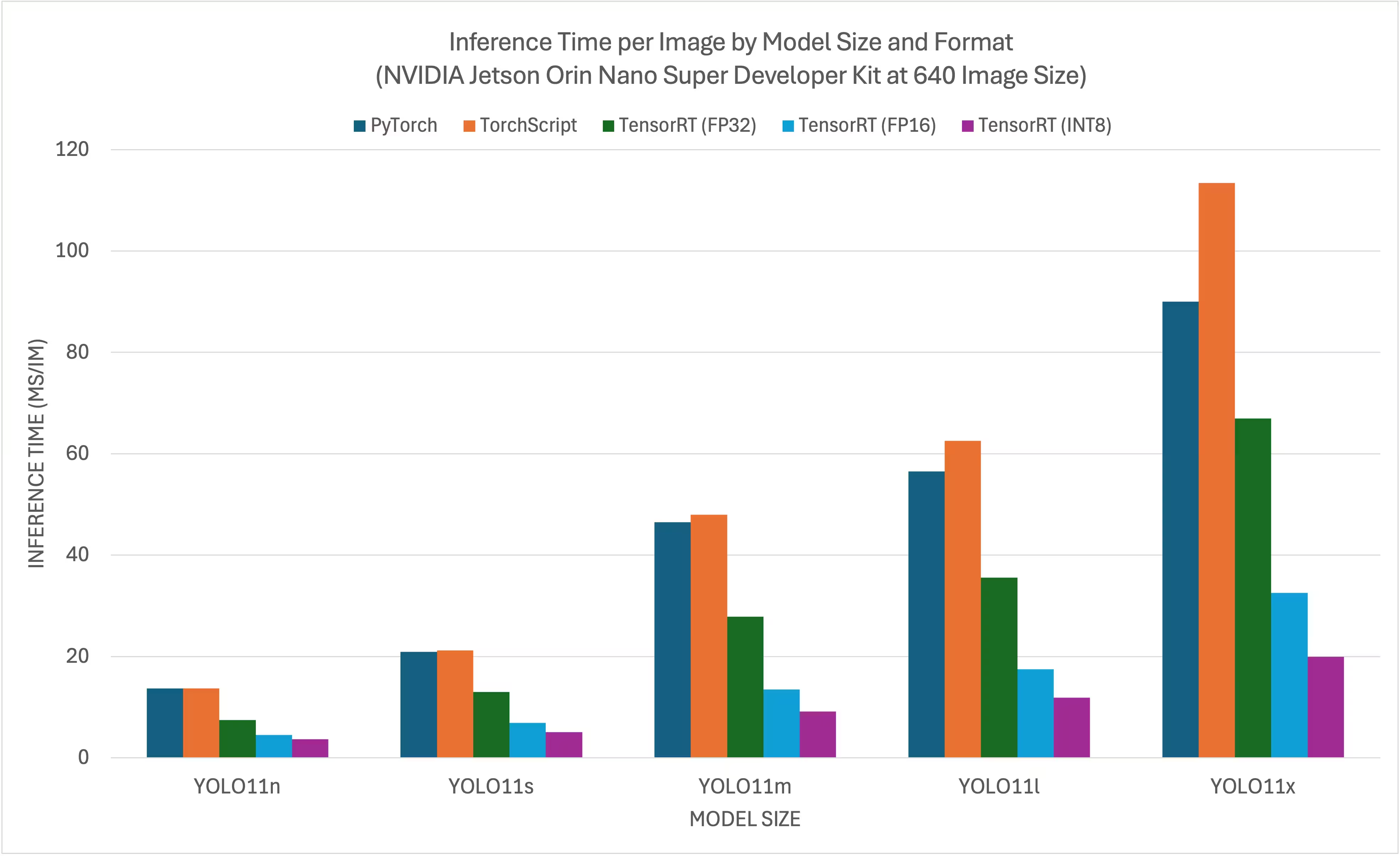

NVIDIA Jetson YOLO11/ YOLO26 基准测试

YOLO11/YOLO26 基准测试由 Ultralytics 团队在 11 种不同的模型格式上运行,测量速度和 准确性:PyTorch、TorchScript、ONNX、OpenVINO、TensorRT、TF SavedModel、TF GraphDef、TF Lite、MNN、NCNN、ExecuTorch。基准测试在 NVIDIA Jetson AGX Thor 开发套件、NVIDIA Jetson AGX Orin 开发套件 (64GB)、NVIDIA Jetson Orin Nano 超级开发套件和由 Jetson Orin NX 16GB 设备驱动的 Seeed Studio reComputer J4012 上运行,采用 FP32 精度,默认输入图像大小为 640。

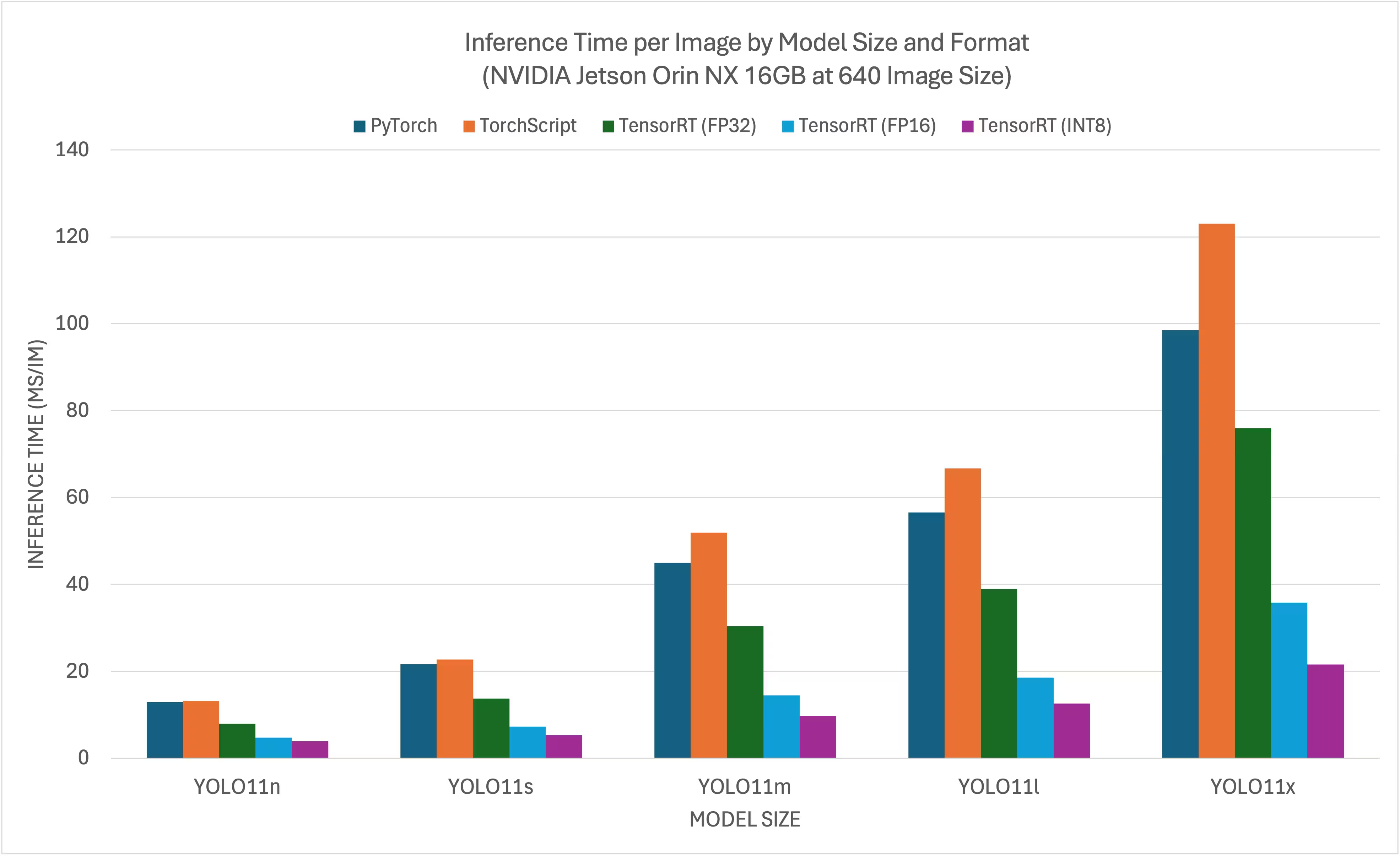

对比图表

尽管所有模型导出都可在NVIDIA Jetson上运行,但我们只在下面的对比图中包含了PyTorch、TorchScript、TensorRT,因为它们利用了Jetson上的GPU,并保证能产生最佳结果。所有其他导出仅利用CPU,其性能不如上述三种。您可以在此图表后的部分找到所有导出的基准测试结果。

NVIDIA Jetson AGX Thor 开发者套件

NVIDIA Jetson AGX Orin 开发者套件 (64GB)

NVIDIA Jetson Orin Nano Super Developer Kit

NVIDIA Jetson Orin NX 16GB

详细的对比表格

下表显示了针对五种不同模型(YOLO11n、YOLO11s、YOLO11m、YOLO11l、YOLO11x)在 11 种不同格式(PyTorch、TorchScript、ONNX、OpenVINO、TensorRT、TF SavedModel、TF GraphDef、TF Lite、MNN、NCNN、ExecuTorch)下的基准测试结果,提供了每种组合的状态、大小、mAP50-95(B) 指标和推理时间。

NVIDIA Jetson AGX Thor 开发者套件

性能

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4798 | 7.39 |

| TorchScript | ✅ | 9.8 | 0.4789 | 4.21 |

| ONNX | ✅ | 9.5 | 0.4767 | 6.58 |

| OpenVINO | ✅ | 10.1 | 0.4794 | 17.50 |

| TensorRT (FP32) | ✅ | 13.9 | 0.4791 | 1.90 |

| TensorRT (FP16) | ✅ | 7.6 | 0.4797 | 1.39 |

| TensorRT (INT8) | ✅ | 6.5 | 0.4273 | 1.52 |

| TF SavedModel | ✅ | 25.7 | 0.4764 | 47.24 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 45.98 |

| TF Lite | ✅ | 9.9 | 0.4764 | 182.04 |

| MNN | ✅ | 9.4 | 0.4784 | 21.83 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 7.99 |

| TorchScript | ✅ | 36.8 | 0.5664 | 6.01 |

| ONNX | ✅ | 36.5 | 0.5666 | 9.31 |

| OpenVINO | ✅ | 38.5 | 0.5656 | 35.56 |

| TensorRT (FP32) | ✅ | 38.9 | 0.5664 | 2.95 |

| TensorRT (FP16) | ✅ | 21.0 | 0.5650 | 1.77 |

| TensorRT (INT8) | ✅ | 13.5 | 0.5010 | 1.75 |

| TF SavedModel | ✅ | 96.6 | 0.5665 | 88.87 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 89.20 |

| TF Lite | ✅ | 36.9 | 0.5665 | 604.25 |

| MNN | ✅ | 36.4 | 0.5651 | 53.75 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 10.76 |

| TorchScript | ✅ | 78.5 | 0.6217 | 10.57 |

| ONNX | ✅ | 78.2 | 0.6211 | 14.91 |

| OpenVINO | ✅ | 82.2 | 0.6204 | 86.27 |

| TensorRT (FP32) | ✅ | 82.2 | 0.6230 | 5.56 |

| TensorRT (FP16) | ✅ | 41.6 | 0.6209 | 2.58 |

| TensorRT (INT8) | ✅ | 24.3 | 0.5595 | 2.49 |

| TF SavedModel | ✅ | 205.8 | 0.6229 | 200.96 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 203.00 |

| TF Lite | ✅ | 78.6 | 0.6229 | 1867.12 |

| MNN | ✅ | 78.0 | 0.6176 | 142.00 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 13.34 |

| TorchScript | ✅ | 95.5 | 0.6248 | 13.86 |

| ONNX | ✅ | 95.0 | 0.6247 | 18.44 |

| OpenVINO | ✅ | 99.9 | 0.6238 | 106.67 |

| TensorRT (FP32) | ✅ | 99.0 | 0.6249 | 6.74 |

| TensorRT (FP16) | ✅ | 50.3 | 0.6243 | 3.34 |

| TensorRT (INT8) | ✅ | 29.0 | 0.5708 | 3.24 |

| TF SavedModel | ✅ | 250.0 | 0.6245 | 259.74 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 263.42 |

| TF Lite | ✅ | 95.4 | 0.6245 | 2367.83 |

| MNN | ✅ | 94.8 | 0.6272 | 174.39 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6565 | 20.92 |

| TorchScript | ✅ | 213.5 | 0.6595 | 21.76 |

| ONNX | ✅ | 212.9 | 0.6590 | 26.72 |

| OpenVINO | ✅ | 223.6 | 0.6620 | 205.27 |

| TensorRT (FP32) | ✅ | 217.2 | 0.6593 | 12.29 |

| TensorRT (FP16) | ✅ | 112.1 | 0.6611 | 5.16 |

| TensorRT (INT8) | ✅ | 58.9 | 0.5222 | 4.72 |

| TF SavedModel | ✅ | 559.2 | 0.6593 | 498.85 |

| TF GraphDef | ✅ | 213.0 | 0.6593 | 507.43 |

| TF Lite | ✅ | 213.3 | 0.6593 | 5134.22 |

| MNN | ✅ | 212.8 | 0.6625 | 347.84 |

使用 Ultralytics 8.4.7 进行基准测试

注意

推理时间不包括预处理/后处理。

NVIDIA Jetson AGX Orin 开发者套件 (64GB)

性能

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 11.58 |

| TorchScript | ✅ | 9.8 | 0.4770 | 4.60 |

| ONNX | ✅ | 9.5 | 0.4770 | 9.87 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 28.80 |

| TensorRT (FP32) | ✅ | 11.5 | 0.0450 | 4.18 |

| TensorRT (FP16) | ✅ | 7.9 | 0.0450 | 2.62 |

| TensorRT (INT8) | ✅ | 5.4 | 0.4640 | 2.30 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 71.10 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 70.02 |

| TF Lite | ✅ | 9.9 | 0.4760 | 227.94 |

| MNN | ✅ | 9.4 | 0.4760 | 32.46 |

| NCNN | ✅ | 9.3 | 0.4810 | 29.93 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 13.18 |

| TorchScript | ✅ | 36.8 | 0.5670 | 11.48 |

| ONNX | ✅ | 36.5 | 0.5660 | 13.47 |

| OpenVINO | ✅ | 36.7 | 0.5650 | 58.30 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5660 | 6.82 |

| TensorRT (FP16) | ✅ | 21.9 | 0.5660 | 3.76 |

| TensorRT (INT8) | ✅ | 12.5 | 0.5480 | 2.98 |

| TF SavedModel | ✅ | 92.2 | 0.5660 | 145.62 |

| TF GraphDef | ✅ | 36.5 | 0.5660 | 146.26 |

| TF Lite | ✅ | 36.9 | 0.5660 | 753.52 |

| MNN | ✅ | 36.4 | 0.5650 | 79.50 |

| NCNN | ✅ | 36.4 | 0.5700 | 58.73 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 19.36 |

| TorchScript | ✅ | 78.5 | 0.6230 | 20.02 |

| ONNX | ✅ | 78.2 | 0.6230 | 25.40 |

| OpenVINO | ✅ | 78.3 | 0.6190 | 130.76 |

| TensorRT (FP32) | ✅ | 80.2 | 0.6220 | 12.60 |

| TensorRT (FP16) | ✅ | 42.5 | 0.6220 | 6.24 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5820 | 4.72 |

| TF SavedModel | ✅ | 196.3 | 0.6230 | 306.76 |

| TF GraphDef | ✅ | 78.2 | 0.6230 | 314.23 |

| TF Lite | ✅ | 78.5 | 0.6230 | 2331.63 |

| MNN | ✅ | 78.0 | 0.6220 | 206.93 |

| NCNN | ✅ | 78.0 | 0.6220 | 143.03 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 23.53 |

| TorchScript | ✅ | 95.5 | 0.6250 | 24.23 |

| ONNX | ✅ | 95.0 | 0.6250 | 31.73 |

| OpenVINO | ✅ | 95.3 | 0.6240 | 162.80 |

| TensorRT (FP32) | ✅ | 97.3 | 0.6250 | 15.90 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6240 | 7.93 |

| TensorRT (INT8) | ✅ | 29.9 | 0.5920 | 5.97 |

| TF SavedModel | ✅ | 238.4 | 0.6250 | 394.30 |

| TF GraphDef | ✅ | 95.0 | 0.6250 | 398.63 |

| TF Lite | ✅ | 95.4 | 0.6250 | 2925.27 |

| MNN | ✅ | 94.8 | 0.6250 | 255.87 |

| NCNN | ✅ | 94.8 | 0.6320 | 177.70 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 114 | 0.6610 | 38.37 |

| TorchScript | ✅ | 213.5 | 0.6590 | 41.23 |

| ONNX | ✅ | 212.9 | 0.6590 | 52.03 |

| OpenVINO | ✅ | 213.2 | 0.6590 | 300.40 |

| TensorRT (FP32) | ✅ | 215.2 | 0.6590 | 28.43 |

| TensorRT (FP16) | ✅ | 110.3 | 0.6570 | 13.50 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6080 | 9.33 |

| TF SavedModel | ✅ | 533.3 | 0.6590 | 738.60 |

| TF GraphDef | ✅ | 212.9 | 0.6590 | 785.70 |

| TF Lite | ✅ | 217.6 | 0.6900 | 6476.80 |

| MNN | ✅ | 213.3 | 0.6590 | 519.77 |

| NCNN | ✅ | 212.8 | 0.6670 | 300.00 |

基于Ultralytics .4.32 进行基准测试

注意

推理时间不包括预处理/后处理。

NVIDIA Jetson Orin Nano Super Developer Kit

性能

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 15.60 |

| TorchScript | ✅ | 9.8 | 0.4770 | 12.60 |

| ONNX | ✅ | 9.5 | 0.4760 | 15.76 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 56.23 |

| TensorRT (FP32) | ✅ | 11.3 | 0.4770 | 7.53 |

| TensorRT (FP16) | ✅ | 8.1 | 0.4800 | 4.57 |

| TensorRT (INT8) | ✅ | 5.3 | 0.4490 | 3.80 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 118.33 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 116.30 |

| TF Lite | ✅ | 9.9 | 0.4760 | 286.00 |

| MNN | ✅ | 9.4 | 0.4760 | 68.77 |

| NCNN | ✅ | 9.3 | 0.4810 | 47.50 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 22.83 |

| TorchScript | ✅ | 36.8 | 0.5670 | 21.83 |

| ONNX | ✅ | 36.5 | 0.5664 | 26.29 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 127.09 |

| TensorRT (FP32) | ✅ | 38.2 | 0.5664 | 13.60 |

| TensorRT (FP16) | ✅ | 21.3 | 0.5649 | 7.17 |

| TensorRT (INT8) | ✅ | 12.7 | 0.5468 | 5.25 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 263.69 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 268.21 |

| TF Lite | ✅ | 36.9 | 0.5665 | 949.63 |

| MNN | ✅ | 36.4 | 0.5644 | 184.68 |

| NCNN | ✅ | 36.4 | 0.5697 | 107.48 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 44.43 |

| TorchScript | ✅ | 78.5 | 0.6230 | 44.00 |

| ONNX | ✅ | 78.2 | 0.6225 | 53.44 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 303.26 |

| TensorRT (FP32) | ✅ | 80.0 | 0.6217 | 28.19 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 13.59 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 9.30 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 636.03 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 659.57 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2905.17 |

| MNN | ✅ | 78.0 | 0.6168 | 500.09 |

| NCNN | ✅ | 78.0 | 0.6224 | 332.39 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 60.97 |

| TorchScript | ✅ | 95.5 | 0.6250 | 56.20 |

| ONNX | ✅ | 95.0 | 0.6247 | 68.12 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 397.84 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 35.88 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 17.42 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 11.83 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 835.83 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 852.16 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3650.85 |

| MNN | ✅ | 94.8 | 0.6257 | 612.37 |

| NCNN | ✅ | 94.8 | 0.6323 | 405.45 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 98.44 |

| TorchScript | ✅ | 214.0 | 0.6593 | 98.0 |

| ONNX | ✅ | 212.9 | 0.6595 | 122.43 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 760.72 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 67.17 |

| TensorRT (FP16) | ✅ | 110.2 | 0.6637 | 32.60 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6170 | 19.99 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1647.06 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1670.30 |

| TF Lite | ✅ | 213.3 | 0.6590 | 8066.30 |

| MNN | ✅ | 212.8 | 0.6600 | 1227.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 782.24 |

基于Ultralytics .4.33 进行基准测试

注意

推理时间不包括预处理/后处理。

NVIDIA Jetson Orin NX 16GB

性能

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4799 | 13.90 |

| TorchScript | ✅ | 9.8 | 0.4787 | 11.60 |

| ONNX | ✅ | 9.5 | 0.4763 | 14.18 |

| OpenVINO | ✅ | 9.6 | 0.4819 | 40.19 |

| TensorRT (FP32) | ✅ | 11.4 | 0.4770 | 7.01 |

| TensorRT (FP16) | ✅ | 8.0 | 0.4789 | 4.13 |

| TensorRT (INT8) | ✅ | 5.5 | 0.4489 | 3.49 |

| TF SavedModel | ✅ | 24.6 | 0.4764 | 92.34 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 92.06 |

| TF Lite | ✅ | 9.9 | 0.4764 | 254.43 |

| MNN | ✅ | 9.4 | 0.4760 | 48.55 |

| NCNN | ✅ | 9.3 | 0.4805 | 34.31 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 20.40 |

| TorchScript | ✅ | 36.8 | 0.5664 | 19.20 |

| ONNX | ✅ | 36.5 | 0.5664 | 24.35 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 88.18 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5664 | 12.62 |

| TensorRT (FP16) | ✅ | 21.5 | 0.5652 | 6.41 |

| TensorRT (INT8) | ✅ | 12.6 | 0.5468 | 4.78 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 195.16 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 197.57 |

| TF Lite | ✅ | 36.9 | 0.5665 | 827.48 |

| MNN | ✅ | 36.4 | 0.5649 | 123.47 |

| NCNN | ✅ | 36.4 | 0.5697 | 74.04 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 38.60 |

| TorchScript | ✅ | 78.5 | 0.6227 | 40.50 |

| ONNX | ✅ | 78.2 | 0.6225 | 48.87 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 205.69 |

| TensorRT (FP32) | ✅ | 80.1 | 0.6217 | 24.69 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 11.66 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 8.22 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 451.48 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 460.94 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2555.53 |

| MNN | ✅ | 78.0 | 0.6217 | 333.33 |

| NCNN | ✅ | 78.0 | 0.6224 | 214.60 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 48.60 |

| TorchScript | ✅ | 95.5 | 0.6249 | 51.60 |

| ONNX | ✅ | 95.0 | 0.6247 | 61.95 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 272.47 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 31.64 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 14.77 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 10.49 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 596.46 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 606.10 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3275.55 |

| MNN | ✅ | 94.8 | 0.6247 | 408.15 |

| NCNN | ✅ | 94.8 | 0.6323 | 262.99 |

| 格式 | 状态 | 磁盘占用空间 (MB) | mAP50-95(B) | 推理时间 (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 84.40 |

| TorchScript | ✅ | 213.5 | 0.6594 | 91.20 |

| ONNX | ✅ | 212.9 | 0.6595 | 109.34 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 520.88 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 57.18 |

| TensorRT (FP16) | ✅ | 109.7 | 0.6632 | 26.76 |

| TensorRT (INT8) | ✅ | 60.0 | 0.6170 | 17.32 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1170.50 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1217.87 |

| TF Lite | ✅ | 213.3 | 0.6593 | 7247.11 |

| MNN | ✅ | 212.8 | 0.6591 | 820.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 534.30 |

基于Ultralytics .4.33 进行基准测试

注意

推理时间不包括预处理/后处理。

浏览 Seeed Studio 在不同版本的 NVIDIA Jetson 硬件上运行的更多基准测试。

复现我们的结果

要在所有导出格式上重现上述 Ultralytics 基准测试,请运行以下代码:

示例

from ultralytics import YOLO

# Load a YOLO11n PyTorch model

model = YOLO("yolo11n.pt")

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

results = model.benchmark(data="coco128.yaml", imgsz=640)

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

yolo benchmark model=yolo11n.pt data=coco128.yaml imgsz=640

请注意,基准测试结果可能因系统的具体硬件和软件配置而异,也可能因运行基准测试时系统的当前工作负载而异。为了获得最可靠的结果,请使用包含大量图像的数据集,例如: data='coco.yaml' (5000 张验证图像)。

使用 NVIDIA Jetson 时的最佳实践

在使用 NVIDIA Jetson 时,有一些最佳实践需要遵循,以在运行 YOLO26 的 NVIDIA Jetson 上实现最大性能。

启用 MAX 功率模式

在 Jetson 上启用 MAX 功率模式将确保所有 CPU、GPU 核心都已打开。

sudo nvpmodel -m 0启用 Jetson 时钟

启用 Jetson 时钟将确保所有 CPU、GPU 核心都以其最大频率进行时钟频率。

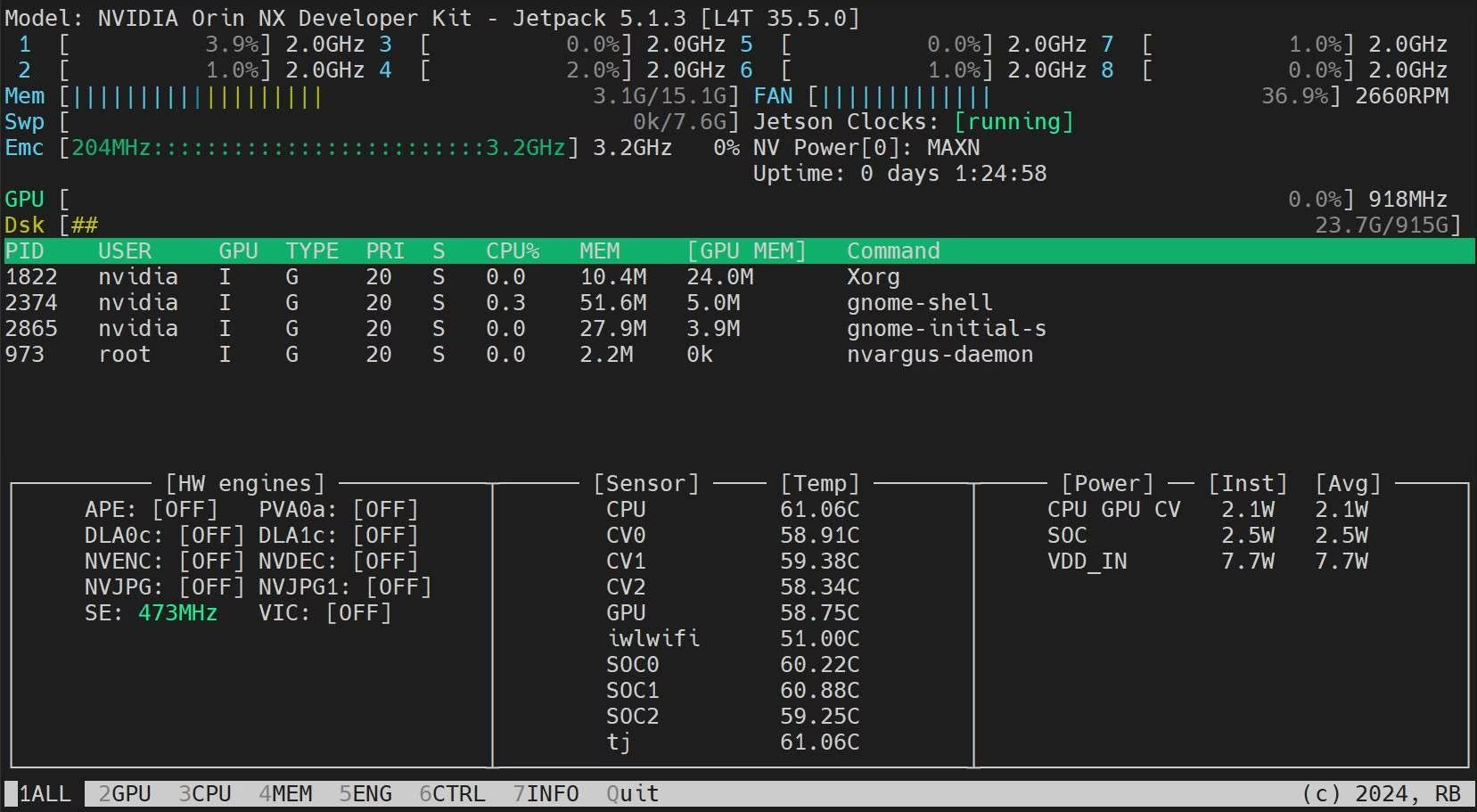

sudo jetson_clocks安装 Jetson Stats 应用程序

我们可以使用 jetson stats 应用程序来监控系统组件的温度,并检查其他系统详细信息,例如查看 CPU、GPU、RAM 使用率,更改电源模式,设置为最大时钟,检查 JetPack 信息。

sudo apt update sudo pip install jetson-stats sudo reboot jtop

NVIDIA 的内存优化技巧

在 Jetson 设备上,可用内存通常是限制因素,尤其是在内存较小的型号上,例如 Jetson Orin Nano(8 GB)或 Orin NX 8 GB。以下技巧是一些实用且风险较低的调整方案,综合实施后可释放数百兆字节的内存,从而让您能够运行更大的YOLO 或支持更多的并行工作负载。如需全面了解相关内容,请参阅NVIDIA 关于在 Jetson 上最大化内存效率的文章。

1. 切换至无头(无图形界面)启动

如果您的 Jetson 是通过 SSH 连接的,或者作为生产设备运行且未连接显示器,则禁用桌面环境和显示服务器可释放多达865 MB的内存:

sudo systemctl set-default multi-user.target

sudo reboot

若要稍后恢复桌面:

sudo systemctl set-default graphical.target

sudo reboot

2. 禁用未使用的系统服务

非必要的后台服务(蓝牙、连接管理器、未使用的硬件守护进程)合计占用约32 MB内存。请列出正在运行的服务,并禁用部署中不需要的任何服务:

# List running services

systemctl list-units --type=service --state=running

# Disable a service

sudo systemctl disable <service-name>

3. 分析内存使用情况

在进行优化之前,请先确定哪些进程实际上正在占用内存。 procrank 按 PSS(比例集大小)对进程进行排序,该指标比 RSS(驻留集大小,即进程映射的物理内存页总数,包括与其他进程共享的页面)更能准确反映每个进程的实际内存占用情况:

git clone https://github.com/csimmonds/procrank_linux.git

cd procrank_linux && make

sudo ./procrank

要查看每个进程的GPU NvMap(CUDA管道)分配情况:

sudo cat /sys/kernel/debug/nvmap/iovmm/clients

4. 在生产环境中不显示结果地运行推理

对于无需实时预览功能的推理管道,仅通过禁用显示相关组件(Tiler、OSD、DisplaySink),即可为管道节省200 多 MB的空间。使用Ultralytics YOLO 时,请禁用查看器,并将结果写入磁盘:

示例

from ultralytics import YOLO

model = YOLO("yolo11n.engine")

# show=False prevents any display window; save=True writes annotated output to disk

results = model.predict(source="video.mp4", show=False, save=True)

yolo predict model=yolo11n.engine source=video.mp4 show=False save=True

累积影响

| 优化 | 节省的内存(约) |

|---|---|

| 禁用桌面图形用户界面 | 约865 MB |

| 禁用未使用的操作系统服务 | 约32 MB |

| 无头推理管道(无显示) | ~200+ MB |

| 总计(轻松获胜) | ~1 GB+ |

在针对内存受限设备部署TensorRT 模型时,结合这些改动尤为重要——这可能决定了能否将更大的模型变体装入内存。

下一步

如需进一步学习和支持,请参阅Ultralytics YOLO26文档。

常见问题

如何将 Ultralytics YOLO26 部署到 NVIDIA Jetson 设备上?

在 NVIDIA Jetson 设备上部署 Ultralytics YOLO26 是一个简单的过程。首先,使用 NVIDIA JetPack SDK 刷写您的 Jetson 设备。然后,可以使用预构建的 Docker 镜像进行快速设置,或者手动安装所需的软件包。每种方法的详细步骤可在 Docker 快速入门 和 原生安装入门 部分找到。

在 NVIDIA Jetson 设备上,YOLO11 模型的性能基准测试结果如何?

YOLO11 模型已在各种 NVIDIA Jetson 设备上进行了基准测试,显示出显著的性能改进。例如,TensorRT 格式提供了最佳的推理性能。详细比较表部分中的表格提供了不同模型格式下 mAP50-95 和推理时间等性能指标的全面视图。

为什么我应该在NVIDIA Jetson上使用TensorRT部署YOLO26?

由于其最佳性能,强烈建议在NVIDIA Jetson上部署YOLO26模型时使用TensorRT。它通过利用Jetson的GPU能力来加速推理,确保最高效率和速度。有关如何转换为TensorRT并运行推理的更多信息,请参阅在NVIDIA Jetson上使用TensorRT部分。

如何在 NVIDIA Jetson 上安装 PyTorch 和 Torchvision?

要在 NVIDIA Jetson 上安装 PyTorch 和 Torchvision,首先卸载任何可能通过 pip 安装的现有版本。然后,手动为 Jetson 的 ARM64 架构安装兼容的 PyTorch 和 Torchvision 版本。有关此过程的详细说明,请参见安装 PyTorch 和 Torchvision部分。

在NVIDIA Jetson上使用YOLO26时,最大化性能的最佳实践是什么?

为在NVIDIA Jetson上使用YOLO26时最大化性能,请遵循以下最佳实践:

- 启用 MAX Power Mode 以利用所有 CPU 和 GPU 核心。

- 启用 Jetson Clocks 以在最大频率下运行所有核心。

- 安装 Jetson Stats 应用程序以监控系统指标。

有关命令和其他详细信息,请参阅使用 NVIDIA Jetson 时的最佳实践部分。

如何在NVIDIA 上释放内存以运行更大的YOLO ?

在内存较少的 Jetson 设备上,可用内存往往是性能瓶颈。以下三个简单的方法结合起来,可释放超过 1 GB 的内存:

- 切换至无头启动 (

sudo systemctl set-default multi-user.target) 以关闭桌面图形用户界面(节省约 865 MB)。 - 禁用未使用的服务,例如蓝牙或连接管理器(可节省约 32 MB 空间)。

- 在不连接显示器的情况下运行推理 通过设置

show=False在你的YOLO中predict该调用避免了分配显示管道内存(节省约200+ MB)。

使用 procrank 以分析每个进程的内存使用情况,并 sudo cat /sys/kernel/debug/nvmap/iovmm/clients 检查GPU 。请参阅 内存优化技巧 请参阅该部分以获取完整详情。

为什么我在 JetPack 6 上导出的TensorRT 无法启用 end2end?

随 JetPack 6 一起发布的TensorRT .3.0 存在一个已知问题,该问题会导致在以下情况下无法构建 INT8 引擎: end2end=True 已启用。当Ultralytics 此组合时,它会自动禁用 end2end 分支,以确保导出成功。

要恢复端到端 INT8 导出功能,请将TensorRT 升级TensorRT 新版本(例如 10.7.0 及以上):

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/arm64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get install -y tensorrt

升级后,请重新运行导出操作。更多详情请参阅GitHub 问题 #23841。