YOLOv5 快速入门 🚀

与 Ultralytics YOLOv5 一起踏上实时目标检测的动态领域!本指南旨在作为人工智能爱好者和专业人士掌握 YOLOv5 的综合起点。从初始设置到高级训练技术,我们都能满足您的需求。在本指南结束时,您将掌握使用最先进的深度学习方法自信地将 YOLOv5 实施到您的项目中的知识。让我们点燃引擎,翱翔进入 YOLOv5!

安装

克隆 YOLOv5 仓库 并建立环境,为启动做好准备。这确保安装所有必需的 requirements。检查您是否已准备好 Python>=3.8.0 和 PyTorch>=1.8 以便启动。这些基础工具对于有效运行 YOLOv5 至关重要。

git clone https://github.com/ultralytics/yolov5 # clone repository

cd yolov5

pip install -r requirements.txt # install dependencies

使用 PyTorch Hub 进行推理

体验 YOLOv5 PyTorch Hub 推理的简易性,模型 可以从最新的 YOLOv5 版本 中无缝下载。此方法利用 PyTorch 的强大功能,简化了模型加载和执行过程,从而轻松获得预测结果。

import torch

# Model loading

model = torch.hub.load("ultralytics/yolov5", "yolov5s") # Can be 'yolov5n' - 'yolov5x6', or 'custom'

# Inference on images

img = "https://ultralytics.com/images/zidane.jpg" # Can be a file, Path, PIL, OpenCV, numpy, or list of images

# Run inference

results = model(img)

# Display results

results.print() # Other options: .show(), .save(), .crop(), .pandas(), etc. Explore these in the Predict mode documentation.

使用 detect.py 进行推理

Harness detect.py 用于多功能 推理 来自各种来源。它会自动获取 模型 来自最新的 YOLOv5 发布 并轻松保存结果。此脚本非常适合命令行使用,并将 YOLOv5 集成到更大的系统中,支持图像、视频、目录、网络摄像头,甚至 实时流.

python detect.py --weights yolov5s.pt --source 0 # webcam

python detect.py --weights yolov5s.pt --source image.jpg # image

python detect.py --weights yolov5s.pt --source video.mp4 # video

python detect.py --weights yolov5s.pt --source screen # screenshot

python detect.py --weights yolov5s.pt --source path/ # directory

python detect.py --weights yolov5s.pt --source list.txt # list of images

python detect.py --weights yolov5s.pt --source list.streams # list of streams

python detect.py --weights yolov5s.pt --source 'path/*.jpg' # glob pattern

python detect.py --weights yolov5s.pt --source 'https://youtu.be/LNwODJXcvt4' # YouTube video

python detect.py --weights yolov5s.pt --source 'rtsp://example.com/media.mp4' # RTSP, RTMP, HTTP stream

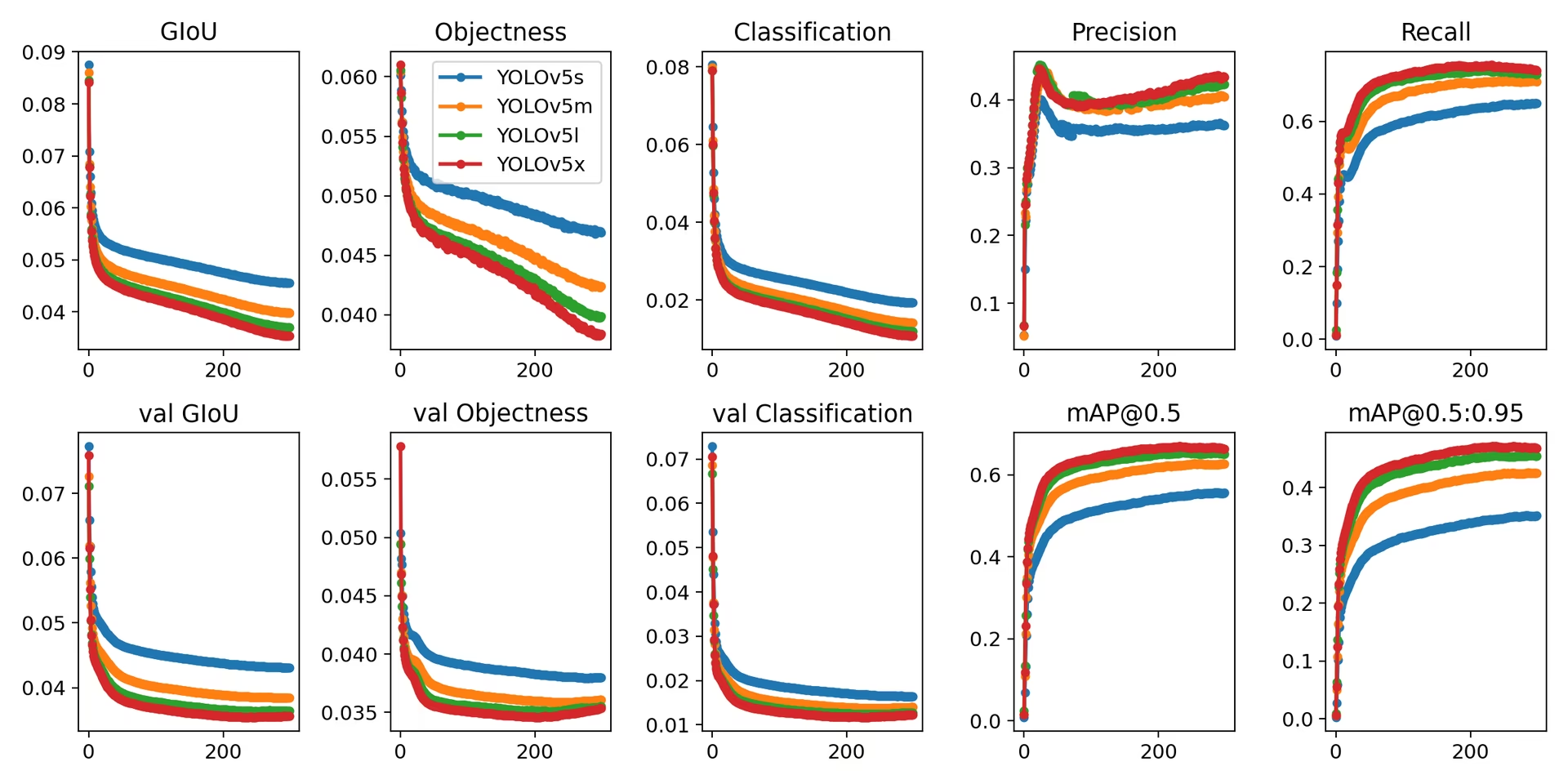

训练

复现 YOLOv5 COCO 数据集 通过遵循以下步骤进行基准测试 训练说明 如下。必要的 模型 和 数据集 (例如 coco128.yaml 或完整版 coco.yaml)直接从最新的 YOLOv5 中提取 发布。在V100上训练YOLOv5n/s/m/l/x GPU 通常分别需要 1/2/4/6/8 天(请注意 多 GPU 训练 设置工作更快)。通过使用尽可能高的值来最大化性能 --batch-size 或使用 --batch-size -1 用于 YOLOv5 自动批处理 功能,可自动找到最佳 批次大小。以下的批处理大小是V100-16GB GPU的理想选择。请参考我们的 配置指南 有关模型配置文件的详细信息(*.yaml)。

# Train YOLOv5n on COCO128 for 3 epochs

python train.py --data coco128.yaml --epochs 3 --weights yolov5n.pt --batch-size 128

# Train YOLOv5s on COCO for 300 epochs

python train.py --data coco.yaml --epochs 300 --weights '' --cfg yolov5s.yaml --batch-size 64

# Train YOLOv5m on COCO for 300 epochs

python train.py --data coco.yaml --epochs 300 --weights '' --cfg yolov5m.yaml --batch-size 40

# Train YOLOv5l on COCO for 300 epochs

python train.py --data coco.yaml --epochs 300 --weights '' --cfg yolov5l.yaml --batch-size 24

# Train YOLOv5x on COCO for 300 epochs

python train.py --data coco.yaml --epochs 300 --weights '' --cfg yolov5x.yaml --batch-size 16

总而言之,YOLOv5 不仅是目标检测的先进工具,也是机器学习通过视觉理解改变我们与世界互动方式的强大力量的证明。随着您逐步学习本指南并将 YOLOv5 应用于您的项目,请记住您正处于技术革命的最前沿,能够在计算机视觉领域取得卓越成就。如果您需要更多见解或来自其他远见者的支持,欢迎访问我们的GitHub 仓库,那里汇聚了蓬勃发展的开发者和研究人员社区。探索更多资源,例如用于无需代码进行数据集管理和模型训练的Ultralytics Platform,或查看我们的解决方案页面以获取实际应用和灵感。不断探索,不断创新,享受 YOLOv5 的奇妙之处。祝您 detect 愉快!🌠🔍