Link to this sectionMeilleures pratiques pour le déploiement de modèles#

Link to this sectionIntroduction#

Le déploiement de modèle est l'étape dans un projet de vision par ordinateur qui fait passer un modèle de la phase de développement à une application réelle. Il existe diverses options de déploiement de modèles : le déploiement dans le cloud offre évolutivité et facilité d'accès, le déploiement en périphérie (edge) réduit la latence en rapprochant le modèle de la source de données, et le déploiement local garantit la confidentialité et le contrôle. Le choix de la bonne stratégie dépend des besoins de ton application, en équilibrant vitesse, sécurité et évolutivité.

Watch: How to Optimize and Deploy AI Models: Best Practices, Troubleshooting, and Security Considerations

Il est également important de suivre les meilleures pratiques lors du déploiement d'un modèle, car celui-ci peut avoir un impact significatif sur l'efficacité et la fiabilité de ses performances. Dans ce guide, nous nous concentrerons sur la façon de t'assurer que le déploiement de ton modèle soit fluide, efficace et sécurisé.

Link to this sectionOptions de déploiement de modèles#

Bien souvent, une fois qu'un modèle est entraîné, évalué et testé, il doit être converti dans des formats spécifiques pour être déployé efficacement dans divers environnements, comme le cloud, la périphérie (edge) ou des appareils locaux.

Avec YOLO26, tu peux exporter ton modèle vers divers formats selon tes besoins de déploiement. Par exemple, exporter YOLO26 vers ONNX est simple et idéal pour transférer des modèles entre frameworks. Pour explorer davantage d'options d'intégration et assurer un déploiement fluide dans différents environnements, visite notre hub d'intégration de modèles.

Link to this sectionChoisir un environnement de déploiement#

Choisir où déployer ton modèle de vision par ordinateur dépend de multiples facteurs. Différents environnements ont des avantages et des défis uniques, il est donc essentiel de choisir celui qui correspond le mieux à tes besoins.

Link to this sectionDéploiement dans le cloud#

Le déploiement dans le cloud est idéal pour les applications qui doivent monter en charge rapidement et traiter de grandes quantités de données. Des plateformes comme AWS, Google Cloud et Azure facilitent la gestion de tes modèles, de l'entraînement au déploiement. Elles offrent des services comme AWS SageMaker, Google AI Platform et Azure Machine Learning pour t'aider tout au long du processus.

Cependant, utiliser le cloud peut être coûteux, surtout avec une utilisation élevée des données, et tu pourrais faire face à des problèmes de latence si tes utilisateurs sont loin des centres de données. Pour gérer les coûts et les performances, il est important d'optimiser l'utilisation des ressources et d'assurer la conformité avec les règles de confidentialité des données.

Link to this sectionDéploiement en périphérie (edge)#

Le déploiement en périphérie fonctionne bien pour les applications nécessitant des réponses en temps réel et une faible latence, particulièrement dans les endroits ayant un accès limité ou nul à Internet. Déployer des modèles sur des appareils de périphérie comme des smartphones ou des gadgets IoT garantit un traitement rapide et garde les données locales, ce qui améliore la confidentialité. Le déploiement en périphérie économise également la bande passante grâce à la réduction des données envoyées vers le cloud.

Cependant, les appareils de périphérie ont souvent une puissance de traitement limitée, tu devras donc optimiser tes modèles. Des outils comme TensorFlow Lite et NVIDIA Jetson peuvent t'aider. Malgré les avantages, maintenir et mettre à jour de nombreux appareils peut être difficile.

Link to this sectionDéploiement local#

Le déploiement local est préférable lorsque la confidentialité des données est critique ou lorsqu'il n'y a pas d'accès Internet fiable ou inexistant. Exécuter des modèles sur des serveurs locaux ou des ordinateurs de bureau te donne un contrôle total et garde tes données sécurisées. Cela peut également réduire la latence si le serveur est proche de l'utilisateur.

Cependant, la mise à l'échelle en local peut être difficile et la maintenance peut prendre du temps. Utiliser des outils comme Docker pour la conteneurisation et Kubernetes pour la gestion peut aider à rendre les déploiements locaux plus efficaces. Des mises à jour et une maintenance régulières sont nécessaires pour que tout fonctionne correctement.

Link to this sectionConteneurisation pour un déploiement rationalisé#

La conteneurisation est une approche puissante qui empaquette ton modèle et toutes ses dépendances dans une unité standardisée appelée conteneur. Cette technique assure des performances cohérentes dans différents environnements et simplifie le processus de déploiement.

Link to this sectionAvantages de l'utilisation de Docker pour le déploiement de modèles#

Docker est devenu le standard de l'industrie pour la conteneurisation dans les déploiements d'apprentissage automatique pour plusieurs raisons :

- Cohérence de l'environnement : Les conteneurs Docker encapsulent ton modèle et toutes ses dépendances, éliminant le problème du "ça fonctionne sur ma machine" en assurant un comportement cohérent à travers les environnements de développement, de test et de production.

- Isolation : Les conteneurs isolent les applications les unes des autres, empêchant les conflits entre différentes versions de logiciels ou bibliothèques.

- Portabilité : Les conteneurs Docker peuvent s'exécuter sur n'importe quel système qui prend en charge Docker, facilitant le déploiement de tes modèles sur différentes plateformes sans modification.

- Évolutivité : Les conteneurs peuvent être facilement mis à l'échelle en fonction de la demande, et des outils d'orchestration comme Kubernetes peuvent automatiser ce processus.

- Contrôle de version : Les images Docker peuvent être versionnées, te permettant de suivre les changements et de revenir aux versions précédentes si nécessaire.

Link to this sectionImplémentation de Docker pour le déploiement de YOLO26#

Pour conteneuriser ton modèle YOLO26, tu peux créer un Dockerfile qui spécifie toutes les dépendances et configurations nécessaires. Voici un exemple de base :

FROM ultralytics/ultralytics:latest

WORKDIR /app

# Copy your model and any additional files

COPY ./models/yolo26.pt /app/models/

COPY ./scripts /app/scripts/

# Set up any environment variables

ENV MODEL_PATH=/app/models/yolo26.pt

# Command to run when the container starts

CMD ["python", "/app/scripts/predict.py"]Cette approche garantit que le déploiement de ton modèle est reproductible et cohérent dans différents environnements, réduisant considérablement le problème du "ça fonctionne sur ma machine" qui entrave souvent les processus de déploiement.

Link to this sectionTechniques d'optimisation de modèles#

Optimiser ton modèle de vision par ordinateur l'aide à fonctionner efficacement, surtout lors du déploiement dans des environnements avec des ressources limitées comme les appareils de périphérie. Voici quelques techniques clés pour optimiser ton modèle.

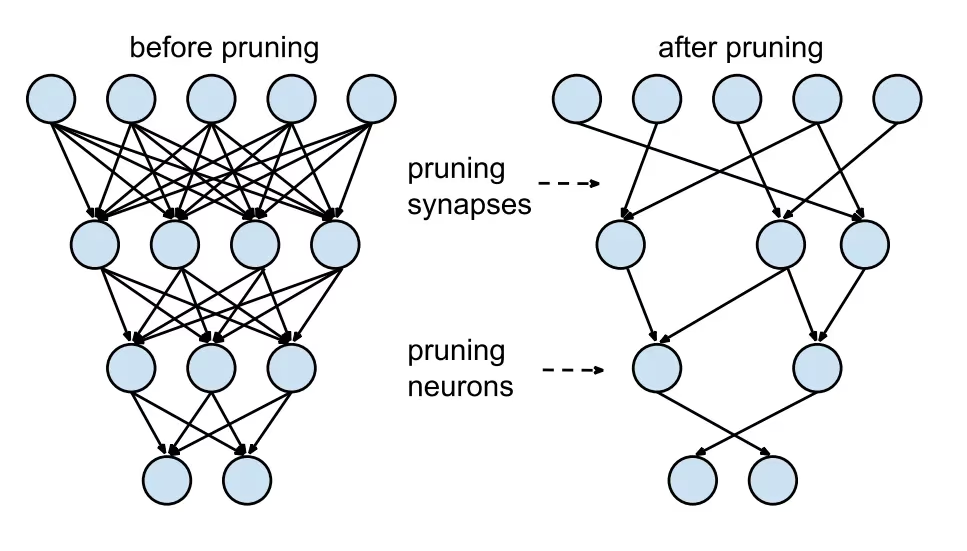

Link to this sectionÉlagage de modèle (Pruning)#

L'élagage réduit la taille du modèle en supprimant les poids qui contribuent peu au résultat final. Cela rend le modèle plus petit et plus rapide sans affecter significativement la précision. L'élagage implique l'identification et l'élimination des paramètres inutiles, aboutissant à un modèle plus léger qui nécessite moins de puissance de calcul. C'est particulièrement utile pour déployer des modèles sur des appareils aux ressources limitées.

Link to this sectionQuantification de modèle#

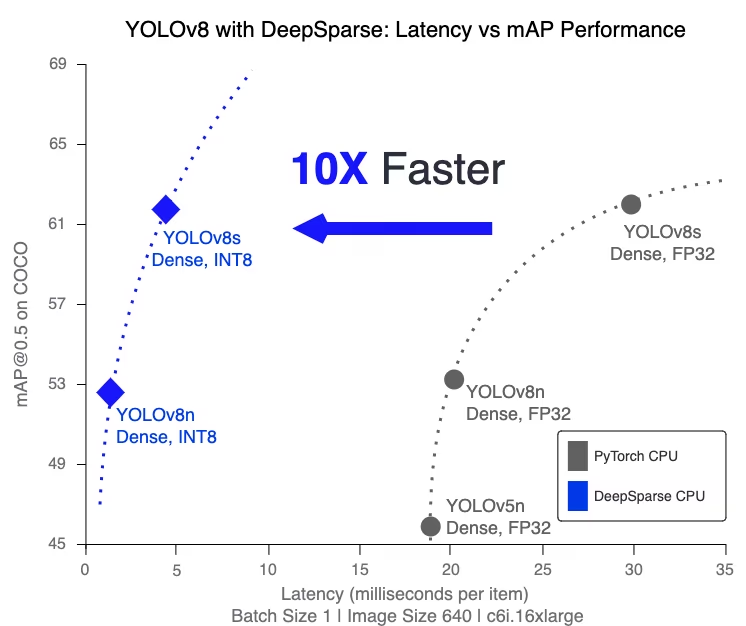

La quantification convertit les poids et les activations du modèle d'une précision élevée (comme les nombres flottants 32 bits) à une précision inférieure (comme les entiers 8 bits). En réduisant la taille du modèle, cela accélère l'inférence. L'entraînement conscient de la quantification (QAT) est une méthode où le modèle est entraîné en gardant la quantification à l'esprit, préservant mieux la précision que la quantification post-entraînement. En gérant la quantification pendant la phase d'entraînement, le modèle apprend à s'adapter à une précision inférieure, maintenant ses performances tout en réduisant les demandes de calcul.

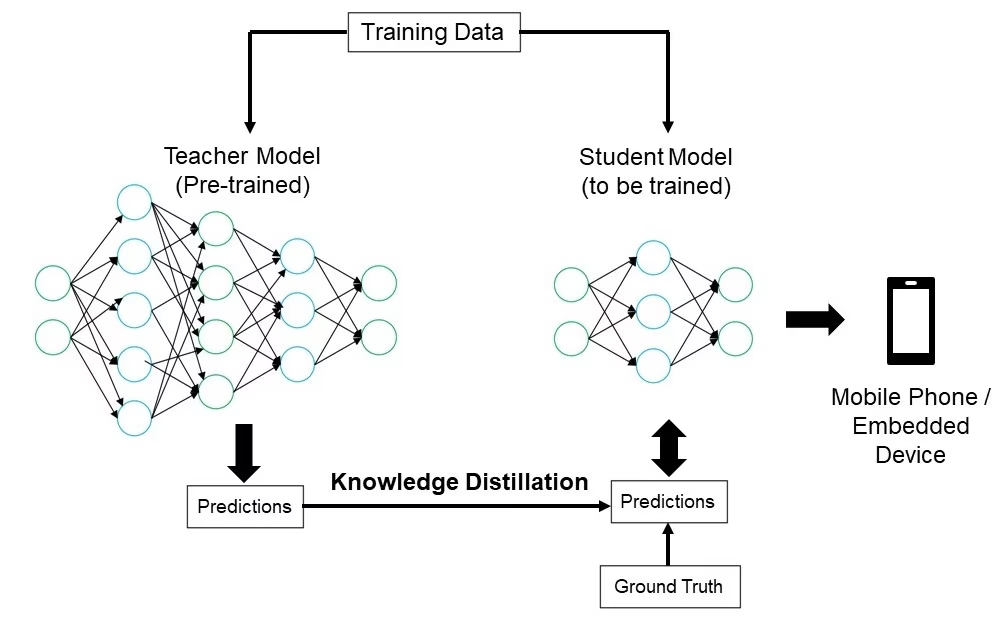

Link to this sectionDistillation de connaissances#

La distillation de connaissances implique d'entraîner un modèle plus petit et plus simple (l'étudiant) à imiter les sorties d'un modèle plus grand et plus complexe (l'enseignant). Le modèle étudiant apprend à approximer les prédictions de l'enseignant, résultant en un modèle compact qui conserve une grande partie de la précision de l'enseignant. Cette technique est bénéfique pour créer des modèles efficaces adaptés au déploiement sur des appareils de périphérie aux ressources contraintes.

Link to this sectionDépannage des problèmes de déploiement#

Tu peux faire face à des défis lors du déploiement de tes modèles de vision par ordinateur, mais comprendre les problèmes courants et leurs solutions peut rendre le processus plus fluide. Voici quelques conseils généraux de dépannage et meilleures pratiques pour t'aider à naviguer dans les problèmes de déploiement.

Link to this sectionTon modèle est moins précis après le déploiement#

Faire l'expérience d'une baisse de précision de ton modèle après le déploiement peut être frustrant. Ce problème peut provenir de divers facteurs. Voici quelques étapes pour t'aider à identifier et résoudre le problème :

- Vérifie la cohérence des données : Vérifie que les données que ton modèle traite après le déploiement sont cohérentes avec les données sur lesquelles il a été entraîné. Les différences dans la distribution, la qualité ou le format des données peuvent impacter significativement les performances.

- Valide les étapes de prétraitement : Vérifie que toutes les étapes de prétraitement appliquées pendant l'entraînement sont également appliquées de manière cohérente lors du déploiement. Cela inclut le redimensionnement des images, la normalisation des valeurs de pixels et d'autres transformations de données.

- Évalue l'environnement du modèle : Assure-toi que les configurations matérielles et logicielles utilisées lors du déploiement correspondent à celles utilisées pendant l'entraînement. Les différences dans les bibliothèques, les versions et les capacités matérielles peuvent introduire des écarts.

- Surveille l'inférence du modèle : Enregistre les entrées et sorties à diverses étapes du pipeline d'inférence pour détecter toute anomalie. Cela peut aider à identifier des problèmes comme la corruption des données ou une mauvaise gestion des sorties du modèle.

- Révise l'exportation et la conversion du modèle : Réexporte le modèle et assure-toi que le processus de conversion maintient l'intégrité des poids et de l'architecture du modèle.

- Teste avec un jeu de données contrôlé : Déploie le modèle dans un environnement de test avec un jeu de données que tu contrôles et compare les résultats avec la phase d'entraînement. Tu peux identifier si le problème vient de l'environnement de déploiement ou des données.

Lors du déploiement de YOLO26, plusieurs facteurs peuvent affecter la précision du modèle. Convertir des modèles vers des formats comme TensorRT implique des optimisations telles que la quantification des poids et la fusion de couches, qui peuvent causer de légères pertes de précision. Utiliser FP16 (demi-précision) au lieu de FP32 (pleine précision) peut accélérer l'inférence mais peut introduire des erreurs de précision numérique. De plus, les contraintes matérielles, comme celles sur le Jetson Nano, avec des nombres de cœurs CUDA inférieurs et une bande passante mémoire réduite, peuvent impacter les performances.

Link to this sectionLes inférences prennent plus de temps que prévu#

Lors du déploiement de modèles d'apprentissage automatique, il est important qu'ils fonctionnent efficacement. Si les inférences prennent plus de temps que prévu, cela peut affecter l'expérience utilisateur et l'efficacité de ton application. Voici quelques étapes pour t'aider à identifier et résoudre le problème :

- Implémente des exécutions d'échauffement (Warm-up) : Les exécutions initiales incluent souvent une surcharge de configuration, ce qui peut fausser les mesures de latence. Effectue quelques inférences d'échauffement avant de mesurer la latence. Exclure ces exécutions initiales fournit une mesure plus précise des performances du modèle.

- Optimise le moteur d'inférence : Vérifie deux fois que le moteur d'inférence est entièrement optimisé pour ton architecture GPU spécifique. Utilise les derniers pilotes et versions logicielles adaptés à ton matériel pour assurer une performance maximale et une compatibilité optimale.

- Utilise le traitement asynchrone : Le traitement asynchrone peut aider à gérer les charges de travail plus efficacement. Utilise des techniques de traitement asynchrone pour gérer plusieurs inférences simultanément, ce qui peut aider à distribuer la charge et réduire les temps d'attente.

- Profile le pipeline d'inférence : Identifier les goulots d'étranglement dans le pipeline d'inférence peut aider à localiser la source des délais. Utilise des outils de profilage pour analyser chaque étape du processus d'inférence, en identifiant et en traitant toute étape causant des délais significatifs, comme des couches inefficaces ou des problèmes de transfert de données.

- Utilise la précision appropriée : Utiliser une précision plus élevée que nécessaire peut ralentir les temps d'inférence. Expérimente avec l'utilisation d'une précision inférieure, comme FP16 (demi-précision), au lieu de FP32 (pleine précision). Bien que FP16 puisse réduire le temps d'inférence, garde également à l'esprit que cela peut impacter la précision du modèle.

Si tu rencontres ce problème lors du déploiement de YOLO26, considère que YOLO26 propose diverses tailles de modèles, telles que YOLO26n (nano) pour les appareils ayant une capacité mémoire inférieure et YOLO26x (extra-large) pour des GPU plus puissants. Choisir la bonne variante de modèle pour ton matériel peut aider à équilibrer l'utilisation de la mémoire et le temps de traitement.

Garde également à l'esprit que la taille des images d'entrée impacte directement l'utilisation de la mémoire et le temps de traitement. Des résolutions plus faibles réduisent l'utilisation de la mémoire et accélèrent l'inférence, tandis que des résolutions plus élevées améliorent la précision mais nécessitent plus de mémoire et de puissance de traitement.

Link to this sectionConsidérations de sécurité dans le déploiement de modèles#

Un autre aspect important du déploiement est la sécurité. La sécurité de tes modèles déployés est critique pour protéger les données sensibles et la propriété intellectuelle. Voici quelques meilleures pratiques que tu peux suivre concernant le déploiement sécurisé de modèles.

Link to this sectionTransmission sécurisée des données#

S'assurer que les données envoyées entre les clients et les serveurs sont sécurisées est très important pour éviter qu'elles ne soient interceptées ou consultées par des parties non autorisées. Tu peux utiliser des protocoles de chiffrement comme TLS (Transport Layer Security) pour chiffrer les données pendant qu'elles sont transmises. Même si quelqu'un intercepte les données, il ne pourra pas les lire. Tu peux aussi utiliser le chiffrement de bout en bout qui protège les données de la source jusqu'à la destination, afin que personne entre les deux ne puisse y accéder.

Link to this sectionContrôles d'accès#

Il est essentiel de contrôler qui peut accéder à ton modèle et à ses données pour prévenir toute utilisation non autorisée. Utilise des méthodes d'authentification fortes pour vérifier l'identité des utilisateurs ou systèmes essayant d'accéder au modèle, et considère l'ajout d'une sécurité supplémentaire avec l'authentification multi-facteurs (MFA). Configure un contrôle d'accès basé sur les rôles (RBAC) pour attribuer des permissions basées sur les rôles des utilisateurs, afin que les personnes n'aient accès qu'à ce dont elles ont besoin. Conserve des journaux d'audit détaillés pour suivre tous les accès et modifications apportés au modèle et à ses données, et révise régulièrement ces journaux pour repérer toute activité suspecte.

Link to this sectionObfuscation de modèle#

Protéger ton modèle contre la rétro-ingénierie ou l'utilisation abusive peut se faire via l'obfuscation de modèle. Cela implique de chiffrer les paramètres du modèle, tels que les poids et les biais dans les réseaux de neurones, pour rendre difficile la compréhension ou la modification du modèle par des individus non autorisés. Tu peux également obfusquer l'architecture du modèle en renommant les couches et les paramètres ou en ajoutant des couches factices, rendant plus difficile pour les attaquants de faire de la rétro-ingénierie. Tu peux également servir le modèle dans un environnement sécurisé, comme une enclave sécurisée ou en utilisant un environnement d'exécution de confiance (TEE), ce qui peut fournir une couche de protection supplémentaire lors de l'inférence.

Link to this sectionPartage tes idées avec tes pairs#

Faire partie d'une communauté de passionnés de vision par ordinateur peut t'aider à résoudre des problèmes et à apprendre plus rapidement. Voici quelques moyens de te connecter, d'obtenir de l'aide et de partager des idées.

Link to this sectionRessources communautaires#

- GitHub Issues : Explore le dépôt GitHub YOLO26 et utilise l'onglet Issues pour poser des questions, signaler des bugs et suggérer de nouvelles fonctionnalités. La communauté et les mainteneurs sont très actifs et prêts à aider.

- Serveur Discord Ultralytics : Rejoins le serveur Discord Ultralytics pour discuter avec d'autres utilisateurs et développeurs, obtenir du support et partager tes expériences.

Link to this sectionDocumentation officielle#

- Documentation Ultralytics YOLO26 : Visite la documentation officielle YOLO26 pour des guides détaillés et des conseils utiles sur divers projets de vision par ordinateur.

Utiliser ces ressources t'aidera à résoudre les défis et à rester à jour avec les dernières tendances et pratiques dans la communauté de la vision par ordinateur.

Link to this sectionConclusion et prochaines étapes#

Nous avons parcouru quelques meilleures pratiques à suivre lors du déploiement de modèles de vision par ordinateur. En sécurisant les données, en contrôlant les accès et en obfusquant les détails du modèle, tu peux protéger les informations sensibles tout en gardant tes modèles fonctionnant sans heurts. Nous avons également discuté de la manière d'aborder des problèmes courants comme la précision réduite et les inférences lentes en utilisant des stratégies telles que les exécutions d'échauffement, l'optimisation des moteurs, le traitement asynchrone, le profilage des pipelines et le choix de la précision appropriée.

Après avoir déployé ton modèle, l'étape suivante serait de surveiller, maintenir et documenter ton application. Une surveillance régulière aide à détecter et corriger les problèmes rapidement, la maintenance garde tes modèles à jour et fonctionnels, et une bonne documentation suit tous les changements et mises à jour. Ces étapes t'aideront à atteindre les objectifs de ton projet de vision par ordinateur.

Link to this sectionFAQ#

Link to this sectionQuelles sont les meilleures pratiques pour déployer un modèle d'apprentissage automatique en utilisant Ultralytics YOLO26 ?#

Déployer un modèle d'apprentissage automatique, particulièrement avec Ultralytics YOLO26, implique plusieurs meilleures pratiques pour assurer l'efficacité et la fiabilité. Tout d'abord, choisis l'environnement de déploiement qui convient à tes besoins : cloud, périphérie (edge) ou local. Optimise ton modèle à travers des techniques comme l'élagage, la quantification et la distillation de connaissances pour un déploiement efficace dans des environnements aux ressources contraintes. Envisage d'utiliser la conteneurisation avec Docker pour assurer la cohérence à travers différents environnements. Enfin, assure-toi que la cohérence des données et les étapes de prétraitement s'alignent avec la phase d'entraînement pour maintenir les performances. Tu peux également te référer aux options de déploiement de modèles pour des directives plus détaillées.

Link to this sectionComment puis-je dépanner les problèmes de déploiement courants avec les modèles Ultralytics YOLO26 ?#

Le dépannage des problèmes de déploiement peut être divisé en quelques étapes clés. Si la précision de ton modèle baisse après le déploiement, vérifie la cohérence des données, valide les étapes de prétraitement et assure-toi que l'environnement matériel/logiciel correspond à ce que tu as utilisé pendant l'entraînement. Pour des temps d'inférence lents, effectue des exécutions d'échauffement, optimise ton moteur d'inférence, utilise le traitement asynchrone et profile ton pipeline d'inférence. Réfère-toi au dépannage des problèmes de déploiement pour un guide détaillé sur ces meilleures pratiques.

Link to this sectionComment l'optimisation d'Ultralytics YOLO26 améliore-t-elle les performances du modèle sur les appareils de périphérie ?#

Optimiser les modèles Ultralytics YOLO26 pour les appareils de périphérie implique d'utiliser des techniques comme l'élagage pour réduire la taille du modèle, la quantification pour convertir les poids en une précision inférieure et la distillation de connaissances pour entraîner des modèles plus petits imitant les plus grands. Ces techniques garantissent que le modèle fonctionne efficacement sur des appareils ayant une puissance de calcul limitée. Des outils comme TensorFlow Lite et NVIDIA Jetson sont particulièrement utiles pour ces optimisations. Apprends-en plus sur ces techniques dans notre section sur l'optimisation de modèle.

Link to this sectionQuelles sont les considérations de sécurité pour déployer des modèles d'apprentissage automatique avec Ultralytics YOLO26 ?#

La sécurité est primordiale lors du déploiement de modèles d'apprentissage automatique. Assure une transmission sécurisée des données en utilisant des protocoles de chiffrement comme TLS. Implémente des contrôles d'accès robustes, y compris une authentification forte et un contrôle d'accès basé sur les rôles (RBAC). Les techniques d'obfuscation de modèle, telles que le chiffrement des paramètres du modèle et le service des modèles dans un environnement sécurisé comme un environnement d'exécution de confiance (TEE), offrent une protection supplémentaire. Pour des pratiques détaillées, réfère-toi aux considérations de sécurité.

Link to this sectionComment choisir le bon environnement de déploiement pour mon modèle Ultralytics YOLO26 ?#

Sélectionner l'environnement de déploiement optimal pour ton modèle Ultralytics YOLO26 dépend des besoins spécifiques de ton application. Le déploiement dans le cloud offre évolutivité et facilité d'accès, le rendant idéal pour les applications avec des volumes de données élevés. Le déploiement en périphérie est préférable pour les applications à faible latence nécessitant des réponses en temps réel, en utilisant des outils comme TensorFlow Lite. Le déploiement local convient aux scénarios nécessitant une confidentialité des données et un contrôle stricts. Pour une vue d'ensemble complète de chaque environnement, consulte notre section sur le choix d'un environnement de déploiement.